Val

2.7K posts

Google vient de publier un papier qui compresse les LLMs à 3 bits. 8x plus rapide, 6x moins de mémoire. Zéro perte de performance 🤯🤯🤯

Le truc c'est que la méthode est élégante au point d'en être presque triviale une fois qu'on la comprend.

Ça s'appelle TurboQuant. Je vous vulgarise tout le paper :

Déjà, le problème de base.

Quand un LLM génère du texte, il doit se "souvenir" de tout ce qu'il a lu et écrit avant. Ce système de mémoire s'appelle le KV cache (key-value cache).

Imaginez un étudiant qui prend des notes ultra détaillées pendant un cours. Plus le cours est long, plus ses notes prennent de place sur son bureau. À un moment il n'a plus de place pour écrire.

C'est exactement ce qui se passe avec les LLMs : plus le contexte est long, plus le KV cache explose en mémoire. C'est un des plus gros bottlenecks de l'inférence aujourd'hui.

La solution classique c'est la quantization. L'idée est simple : au lieu de stocker chaque nombre avec une précision extrême (32 bits, genre 3.14159265...), tu le stockes avec moins de précision (4 bits, genre "~3").

C'est comme passer d'une photo RAW de 50 MB à un JPEG de 2 MB. Tu perds un peu de détail mais visuellement c'est quasi pareil.

Le problème c'est que les méthodes classiques de quantization trichent un peu. Pour chaque petit bloc de données compressé, elles doivent stocker des "constantes de calibration" en pleine précision.

C'est comme si pour chaque photo JPEG vous deviez garder un petit post-it en haute résolution à côté qui dit "voilà comment décoder cette image".

Ces post-its rajoutent 1 à 2 bits par nombre. Quand tu essaies de compresser à 2 ou 3 bits, cet overhead représente une part énorme de ta mémoire totale. Ça annule une bonne partie du gain.

TurboQuant résout ça en deux étapes.

Étape 1 : PolarQuant.

Au lieu de décrire un vecteur avec des coordonnées classiques (X, Y, Z), tu le convertis en coordonnées polaires : une distance + un angle.

C'est comme remplacer "va 3 rues à l'est puis 4 rues au nord" par "va 5 rues direction 37 degrés". Même info, format plus compact.

L'astuce c'est qu'avant de faire ça, tu appliques une rotation aléatoire sur tes vecteurs. Ça rend leur distribution prévisible et uniforme. Du coup tu n'as plus besoin de stocker les fameuses constantes de calibration, la géométrie fait le travail toute seule.

Étape 2 : QJL (Quantized Johnson-Lindenstrauss).

Après PolarQuant il reste une petite erreur résiduelle. QJL la corrige avec 1 seul bit par nombre.

Le principe vient d'un théorème mathématique qui dit qu'on peut projeter des données de haute dimension dans un espace plus petit tout en préservant les distances entre les points.

QJL pousse ça à l'extrême : il réduit chaque valeur projetée à juste son signe (+1 ou -1). Un seul bit. Et grâce à un estimateur spécial qui combine la query en haute précision avec ces données ultra compressées, le modèle calcule toujours des scores d'attention précis.

Les résultats sont assez dingues.

Sur les benchmarks long-context (LongBench, Needle in a Haystack, RULER...) avec Gemma et Mistral : zéro perte de performance à 3 bits. Le KV cache est réduit d'un facteur 6x. Et sur H100, le calcul des scores d'attention est jusqu'à 8x plus rapide qu'en 32 bits.

Le tout sans aucun fine-tuning ou entraînement supplémentaire. Tu branches, ça marche.

Et le plus intéressant : ça ne sert pas qu'aux LLMs.

TurboQuant surpasse aussi les méthodes state of the art en vector search, c'est à dire la techno qui permet de chercher par similarité dans des bases de milliards de vecteurs (ce qui fait tourner Google Search, les systèmes de recommandation, le RAG...).

Mon take : l'inférence c'est là où se joue la vraie bataille économique de l'AI.

Les marges de toute l'industrie dépendent du coût par token en production. Un gain de 6 à 8x sur la mémoire et la vitesse d'inférence, sans aucune perte de qualité, ça change fondamentalement l'équation.

Ce type de recherche ne fait pas de bruit sur Twitter mais son impact business est potentiellement supérieur à celui d'un nouveau foundation model.

GIF

Français

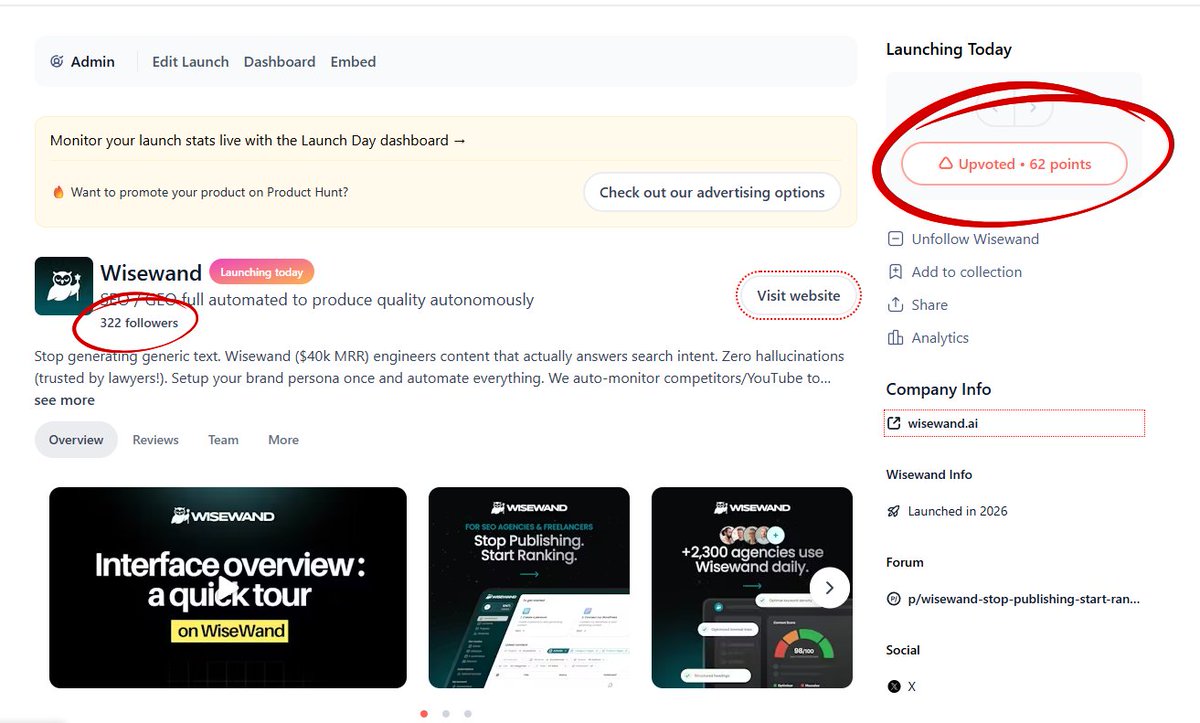

@alcons0 @ZalidanTV Exactement. Et s’ils ont fait ça c’est que c’est un vrai sujet. Google fait la même chose en mettant plus de poids aux interactions des gens connectés à leur compte Google et qui ont de l’ancienneté…

Français

@ZalidanTV @vbernard06 comment PH est censé faire la différence entre un nouveau compte créé par un humain vs bot, qui upvote le même jour?

Français

@ZalidanTV Je comprends ton point de vue mais tu ne vois que ton propre cas et pas la majorité des lancements par bots.

Tu imagines bien que les mecs ont réfléchis, ne sont probablement pas con et on mis en place le moyen qui est le plus efficace pour protéger la qualité de leur service

Français

@vbernard06 la preuve que c'est de la merde, puisqu'on a des vrais votes, des vrais feedback et que notre lancement est mort dans l'oeuf.

Français

@dsampaolo @PascalDubruille Oui c’est le problème des avocats. Eux, ils gagnent à chaque fois, tu ne peux quasiment pas contrôler le temps passé et plus c’est long plus ils gagnent…

Français

@PascalDubruille J'en arrive à forcer l'avocat à me donner par écrit des preuves de son travail, ça sent le sapin.

Français

MERCI pour ce score exceptionnel - le meilleur pour toutes les villes françaises de + de 30 000 habitants ! - qui ne me confère que des DEVOIRS.

Dans une ville aussi importante et contrastée que Cannes (taux de pauvreté de sept points supérieur à la moyenne nationale, revenu median inférieur à toutes les moyennes locales comme française, etc, mais aussi ville internationale et avec des quartiers huppés comme pauvres), face cette fois-ci à une liste d’union de la gauche et au RN, ce résultat est la preuve qu’une proposition politique solide sur ses principes, porteuse de concret mais aussi d’idées et de personnalités nouvelles, venant du terrain, peut l’emporter.

Portons la voix d’une droite INDÉPENDANTE et GAGNANTE POUR LA FRANCE.

Français

@barryfabien @SMX_Paris LinkedIn fait aussi de gros efforts sur ces sujets ces depuis quelques mois 😅

Français

Si ce qu'on a vu se confirme Google va faire mal. En espérant que ce ne soit pas pour ce soir, besoin de dormir après le @SMX_Paris🤞

Français

De quoi vous parlez, Caliméro ? Vous avez joué au Premier ministre imaginaire sur toutes les antennes de France et de Navarre pendant 3 mois ! 😂

Lucie Castets@CastetsLucie

Dans cette campagne municipale, sommes-nous à armes égales ? Évidemment que non. TF1 lance la campagne de Mme Knafo au 20h. Causeur lui offre une campagne d'affichage la semaine de l'élection. Les algorithmes de X et TikTok se mettent gratuitement à son service. 1/3

Français

Thread à dérouler :)

(oui, je suis assez fier de ce qu'on a pondu en interne)

Didier Sampaolo@dsampaolo

Pour structurer son activité de Knowledge Manager, @kakocreation a conçu un Agent IA qui lui sert de coach/professeur IA interactif, mis en musique par @DoudouMoii et votre serviteur. (il n'est pas à vendre, mais on peut en discuter) En savoir plus : lvlup.fr/blog/agent-ia-…

Français

@dr_l_alexandre Bonjour @dr_l_alexandre

Pour quelle raison avez-vous fait ce choix ? Quels usages ?

Français

90m€ de TVA à l’achat .

Entretien annuel : 10m€ de TVA

350 000 de masse salariale par mois … qui , si la loi française n’était pas debile pourrait faire rentrer 100 000 de charges mensuelles sans problème .

Faites vos calculs

Après quand je vois l’ambiance je comprends qu’il veuille un moyen de s’évader

L'Humanité@humanite_fr

Bernard Arnault, qui redoutait la taxe Zucman, a commandé un nouveau yacht de 143 mètres pour 550 millions d’euros Le billet de Maurice Ulrich ➡️ l.humanite.fr/SxR

Français

@vbernard06 @marseille Je crois que c'est pour prouver que je suis en vie (sinon y'aurait mention de mon décès dessus...).

Français

.@marseille Loin de moi l'idée d'être lourd, mais mon acte de naissance, il vous faut combien de temps pour me l'envoyer ? J'en ai un peu besoin urgemment et ça fait 8 jours que j'attends...

Français

@seo_mintavocado @sarddou J’ai commencé à tester en 2024…

Je connais bien.

Je parle de Heygen notamment

Français

@vbernard06 @sarddou Fait un podcast avec NotebookLM et comprend que le game est terminé

Français