lcomplete

1.4K posts

lcomplete

@xlcomplete

开发者 / 投资者 / 玩家。 building: https://t.co/bJgq4a5pmH newsletter: https://t.co/D9ReQw0cp6 ✨ @MoodStarApp

Katılım Ocak 2013

522 Takip Edilen7.9K Takipçiler

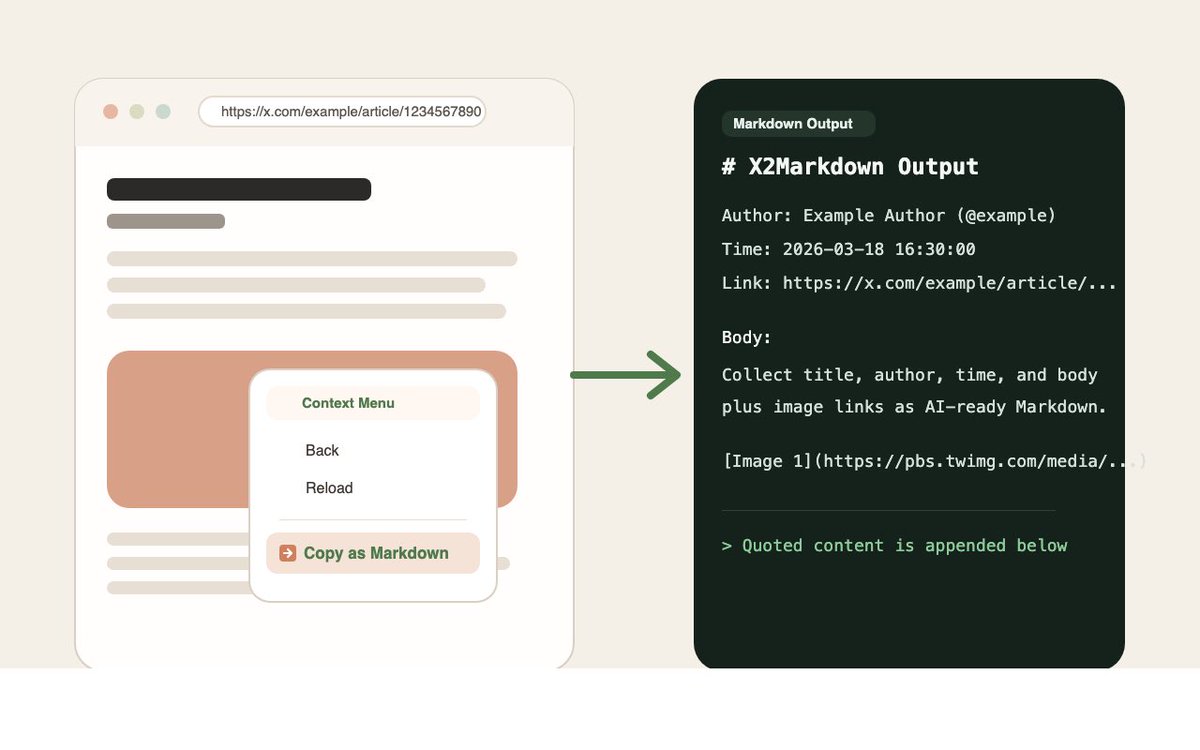

悄咪咪又随想编程了一个插件

可以一键把 x 上的推文、长文复制成 md 格式

然后丢到 notion、notebooklm、obsidian 里面

笔记党的福音

chromewebstore.google.com/detail/x2markd…

中文

我对 kimi 的印象不太好,去年年中的时候,几乎所有的 AI 都能回答对爱因斯坦斑马难题,只有 kimi 还答不出来。

最近看推上挺多夸的,所以试了一下 kimi k2.5,效果简直让我大跌眼睛,在 claude 中使用,让它更新 v0.6.1 的版本说明,居然给我把标题改成了 v0.7.0,内容也全都是错的,运行的还慢,换成 glm-5,一下就做好了。

再让它执行一个简单的双语翻译任务,不开 thinking 的情况下,居然只返回一种语言。

我用的是阿里云 coding plan 里的 kimi-k2.5 模型,难道跟官方的效果差距很大?还是说这模型本身就比另外俩差一点。

国产模型使用不多,目前我个人感觉 glm 5 > minimax 2.5 > kimi k2.5。

中文

@mobailabs GLM-5 和 MiniMax 我也是通过阿里云 coding plan 使用的,感觉还可以。我抽空试试 kimi 官方的看看。

中文

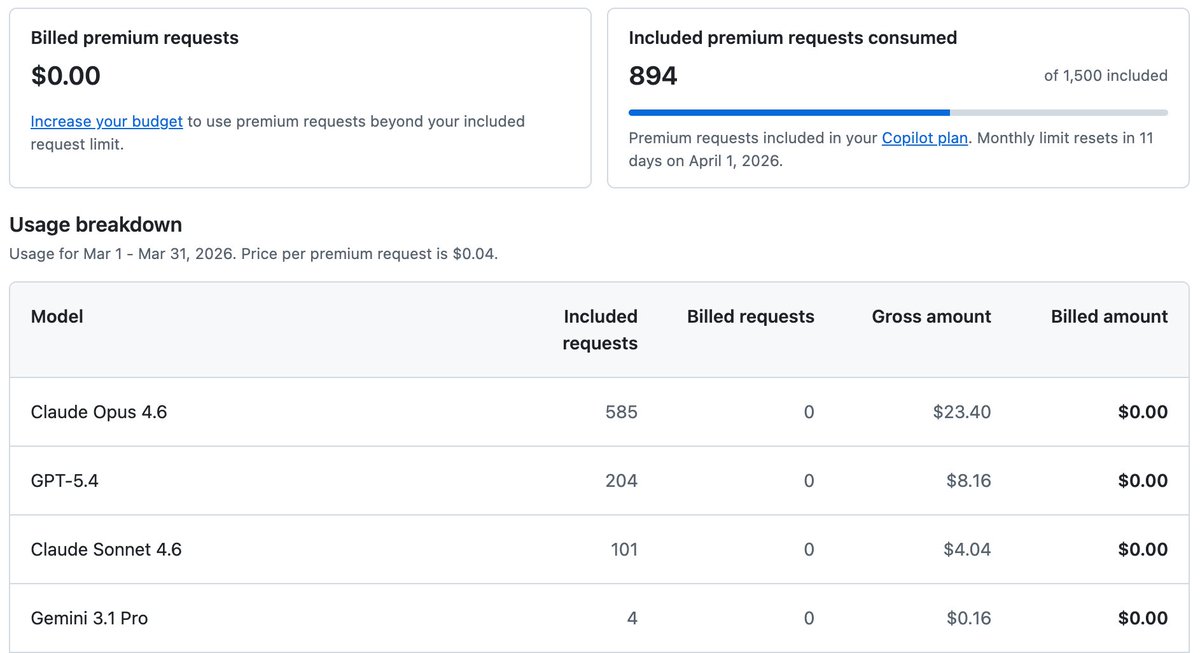

珍惜 Github Copilot 现在的按次数收费模式吧。

Copilot 里的 GPT 5.4 模型,上下文窗口有 400K,比 ChatGPT Plus 订阅里的还大,在设置中也可以开启 xhigh。

另外,个人感觉 Copilot 现在不比 OpenCode 效果差,OpenCode 经常会简单任务都消耗掉多个 request。

Charles@ycjcl

不折腾 Claude 订阅了,转向给 Github Copilot 充钱!

中文