Radnou

430 posts

Radnou

@RadnouTech

Dev passionné · AI, Apple, Open Source · #AI #Tech Je teste, je casse, je partage

We just released Gemma 4 — our most intelligent open models to date. Built from the same world-class research as Gemini 3, Gemma 4 brings breakthrough intelligence directly to your own hardware for advanced reasoning and agentic workflows. Released under a commercially permissive Apache 2.0 license so anyone can build powerful AI tools. 🧵↓

For some legal reasons, we would like to rename OpenClaude. Whats your name suggestions?

BREAKING: Apple is scared of vibe coding they removed Anything from the App Store so we moved app building to iMessage good luck removing this one, Apple

7 000 euros pour une naissance, 27 000 euros pour un cancer du poumon… Faut-il dire aux Français combien coûte leur santé ? ➡️ l.leparisien.fr/PgwJ

🚨🇫🇷 FLASH INFO Le fisc a épluché les commandes Deliveroo de Samir Nasri pour prouver qu’il vivait en France Les enquêteurs se sont appuyés sur un élément inattendu : ses livraisons de repas En 2022, l’ancien international aurait commandé plus de 200 fois à Paris Un détail qui a pesé lourd pour contester son statut d’expatrié à Dubaï Avec ses nombreux séjours en France et ses biens immobiliers, le fisc estime que son “centre de vie” reste sur le territoire Résultat : plus de 5 millions d’euros réclamés. Samir Nasri conteste ce redressement Source : Les Échos

"Donnez-moi un autre pays que la France qui a un tel niveau de vie, un tel niveau de liberté, un tel niveau de sécurité sociale ? Quel autre État a autant mis d’argent dans ses services publics ces sept dernières années ?" Merci @AgnesRunacher pour cette piqûre de rappel 👏🇫🇷

🇫🇷 TRIBUNE. Cette fuite de talents menace la souveraineté technologique de la France ➡️ trib.al/eMA82Id

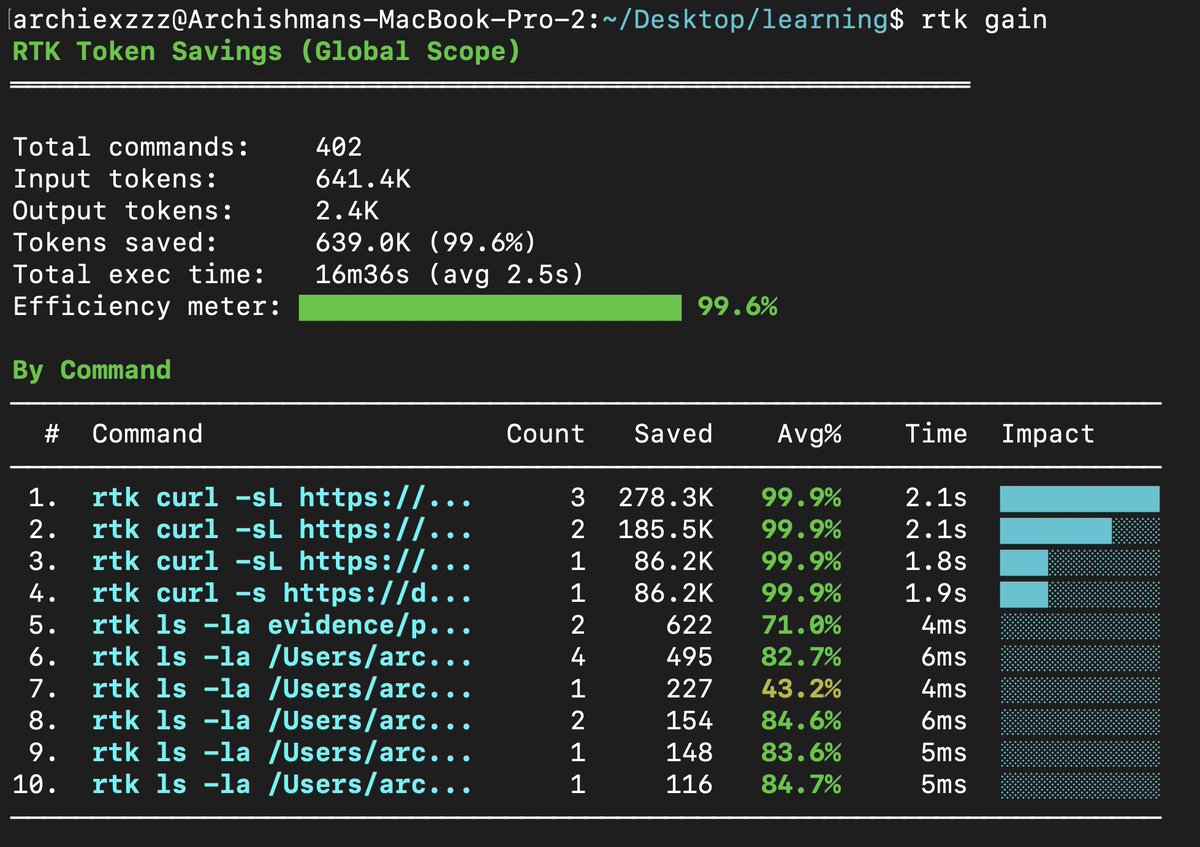

J’avais pas fait de grosses sessions code depuis un moment et effectivement la nouvelle limite Claude code c’est chaud

Je viens d'installer Gemma 4 26B et 31B sur un MacBook Pro M5 Pro avec 48 Go de RAM et la différence avec Gemini est quasiment invisible pour les tâches simples, notamment niveau vitesse. Je sais que tout le monde n'est pas un adepte d'IA locale, mais le potentiel est fou. Seul bémol : il faut vraiment beaucoup de RAM. Les modèles 16 Go ou 18 Go de RAM seront limités aux plus petits LLM pendant encore longtemps.