RC retweetou

I want to share four of the most frequent skills I use on Claude. They've been significantly helpful for me to digest documents and data. Feel free to install and try them out.

• diagram it — Reads any content → picks best diagram type (flowchart, structural, timeline, tree, concept map) → renders an Excalidraw diagram inline in chat

• nano this — Reads an uploaded doc → sends to Gemini image generation with Swiss Pulse design prompt → returns a polished infographic PNG

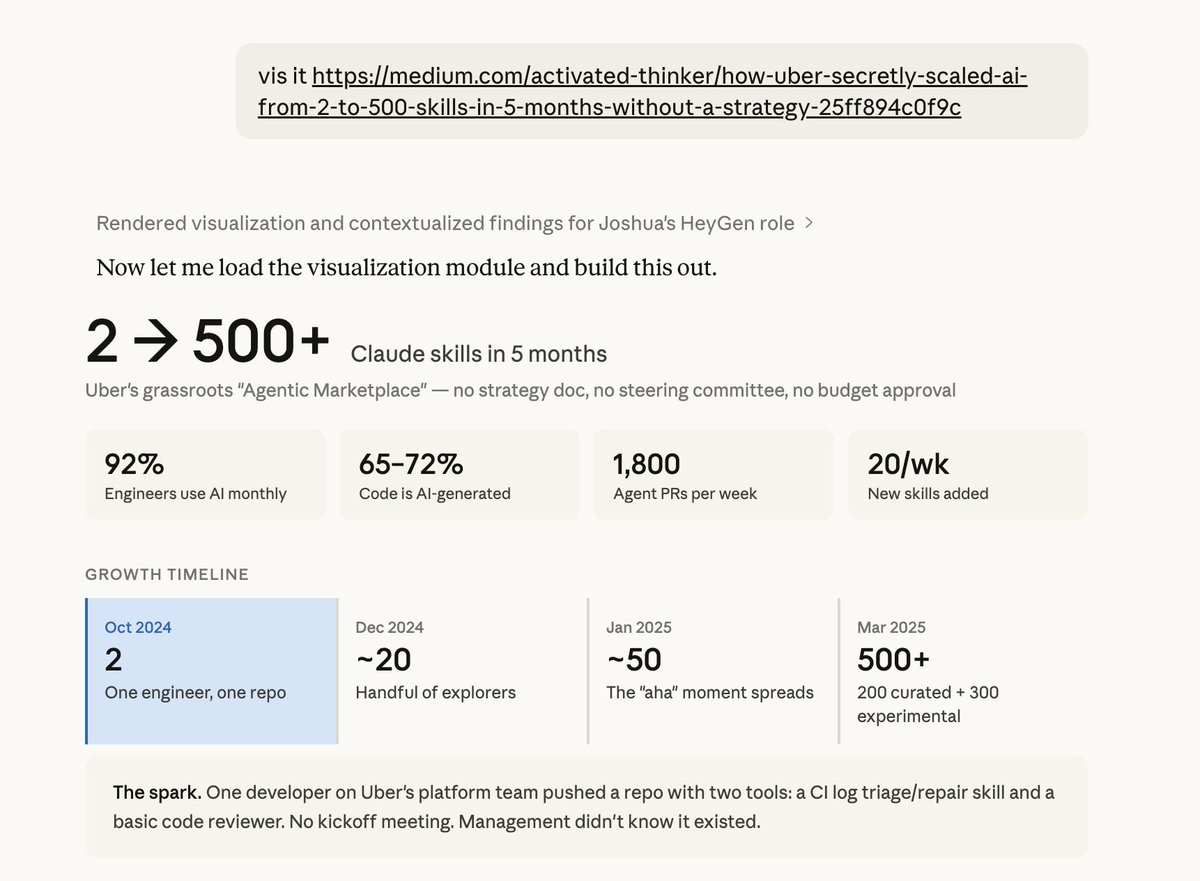

• vis it — Reads any content → picks best visual format (chart, timeline, explainer, pipeline, comparison) → renders an interactive widget inline in chat

• ver it — Reads any content → builds Swiss Pulse interactive HTML (hero metric, stats, Chart.js graph, dark mode) → returns shareable link

To use any of them, just type the command + paste a URL, attach a doc, or reference something in conversation. That's it.

Example:

English