宝玉

31.4K posts

宝玉

@dotey

Prompt Engineer, dedicated to learning and disseminating knowledge about AI, software engineering, and engineering management.

Pets. Now in Codex. Use /pet to wake your pet.

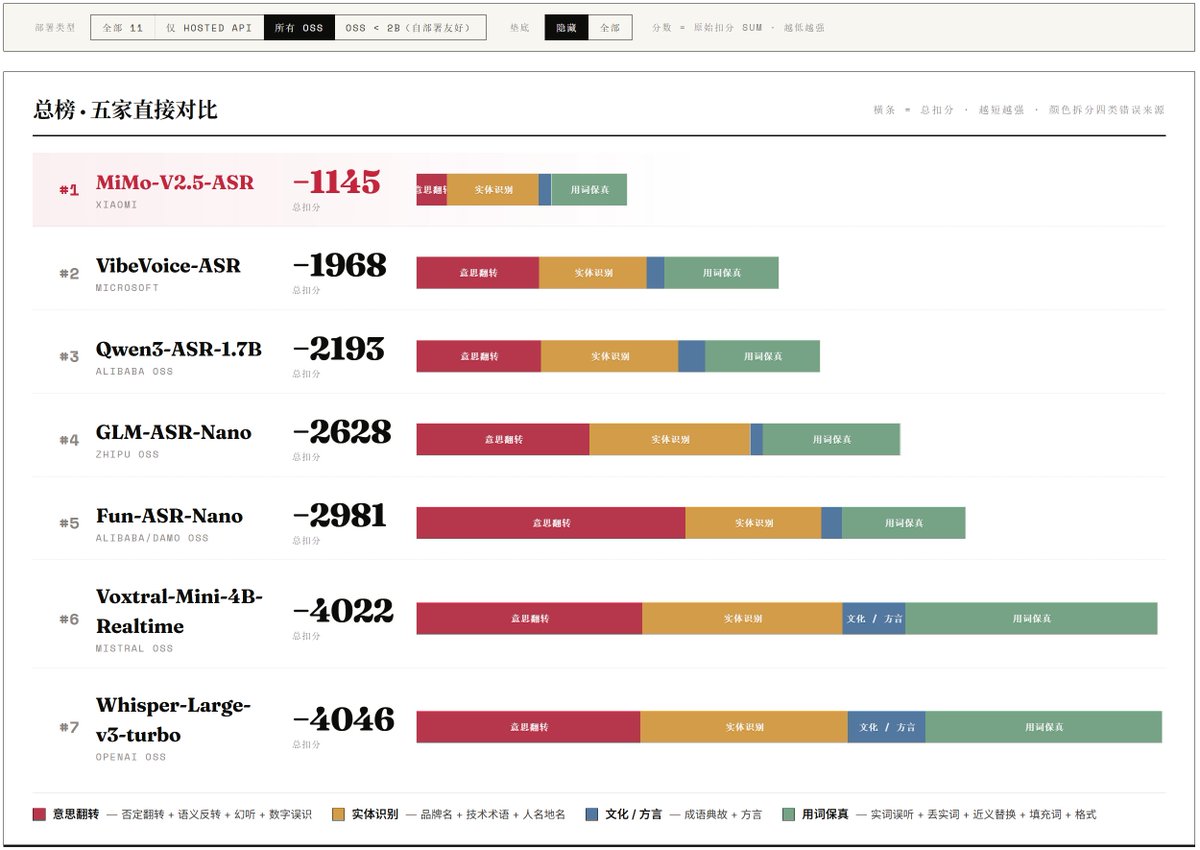

最好的中文语音转文字模型是什么? 我拿私有数据集测了一轮, 小米@XiaomiMiMo 最新的 MiMo-V2.5-ASR 拿下第一, 超过之前最稳的 ElevenLabs Scribe v2 和 Qwen3-ASR-Flash Doubao ASR 继续坐 GPT-4o-mini-transcribe 那桌

这个也太屌了! 这个中国开发者在飞机上用 MacBook 本地跑 Llama 70B,整整 11 小时没有网络,处理了完整的客户项目。 他坐在跨大西洋航班的靠窗位置,设备是 MacBook Pro M4,64GB 内存。机上 WiFi 要价 25 美元,他拒绝了。 没有云端 API,没有连接 Anthropic 或 OpenAI 的服务器,完全没有互联网。 只有一台本地运行的 Llama 3.3 70B(bf16)和他自己写的编排脚本。 模型通过 llama.cpp 运行。生成速度 71 tokens/秒,上下文约 60,000 tokens,内存占用 48.6 GiB / 64 GiB,起飞时电池剩余 3 小时 21 分钟。 起飞前他给编排器写了这样的系统提示: "你是一个运行在单台 MacBook 上的离线编排器。没有网络。你唯一的资源是 /Users/dev/work 下的本地文件、localhost:8080 的 Llama 70B 推理服务,以及 3 小时 21 分钟的电池预算。处理 /Users/dev/work/queue.jsonl 中的任务队列(每行一个客户任务)。对每个任务:起草 → 运行本地评估 → 保存产物到 /Users/dev/work/done/。每 12 个任务保存一次上下文检查点,以便更换电池后恢复。仅在队列为空或电池低于 5% 时停止。" 所以这个系统完全清楚自己运行在什么资源上。 它知道自己未来 11 小时没有外部连接。它知道自己的内存和电池都是有限的。它知道在飞机降落之前不会有人类介入。 系统跑在一个循环里。从队列取任务,推理,保存产物,写检查点。一个接一个。 当电池低于 5% 时,编排器自动暂停,等待笔记本切换到备用充电宝,然后从最后一个检查点恢复。 这是系统在飞行中的日志: "saved context checkpoint 8 of 12 (pos_min = 488, pos_max = 50118, size = 62.813 MiB)" "restored context checkpoint (pos_min = 488, pos_max = 50118)" "prompt processing progress: n_tokens = 50 / 60818" "task 37016 done | tps = 71 s tokens text → /Users/dev/work/done/proposal_westside.md" 窗外是云层、蓝天,没有 WiFi。托盘上是一台 MacBook,一个打开的终端,两个屏幕,一个 localhost 推理服务。 这是过去一年里我见过的最漂亮的离线 AI 工作流: 11 小时飞行,WiFi 费用 0 美元,所有客户队列在降落前全部清空。 这个故事的核心不是技术多牛(llama.cpp 跑 70B 现在很常规),而是一个完整的离线自主工作流,编排器理解自己的资源约束,自动管理电池和检查点,没人干预干了 11 小时。 这种"self-aware computing"的感觉确实挺酷的! x.com/i/status/20499…

it's still experimental so we hide it a bit, but in the codex app, try: > what have i been doing very inefficiently on my computer (according to Chronicle). make some recommendations. be direct. tell me what i need to hear.

ran a codex session yesterday. closed the laptop at minute 57. came back 5.5 hours later. /goal had already resumed on its own. it injected its own developer message ("Continue working toward the active thread goal") and kept going. no re-prompt. no recovery steps. i opened the lid and it was four turns in. the full session: 6h 44min wall time, ~41 min actual model compute. 6.8M cumulative input tokens at 94% cache hit. final status TASK_COMPLETE. all four target end-to-end test scenarios passed. this is /goal in codex v0.128.0. it's the ralph loop, made first-class. native persistence, runtime continuation, tui controls. the goal survives sleeps, network drops, deliberate pauses. you don't have to be there. what surprised me: the prompt is the contract. mine was 600+ words. structured xml blocks, a reading list, working rules, anti-pattern fences, a done_when block. "/goal do thing" is not the interface. the prompt is. tectontide.com/en/blog/codex-… would love to hear what you think.

一个熟练掌握数据结构和算法的高手,和一个水平一般但认真写Docstring的人,谁用AI写代码更快更好?答案可能让你不舒服:后者赢面更大。因为AI辅助编程的核心产出不再是代码,而是注释。

/goal also lands in Codex CLI 0.128.0. Our take on the Ralph loop: keep a goal alive across turns. Don't stop until it's achieved. Built by my co-worker and OpenAI mentor Eric Traut, aka the Pyright guy. One of the GOATs I get to work with daily.

Apple accidentally left Claude.md files in today's Apple Support app update (v5.13)

请问有没有好用的 Ralph Loop for Codex? 类似于 Claude Code 的 Ralph Wiggum Plugin github.com/anthropics/cla… 用过 oh my codex,给我装了一坨 MCP,魔改了我的 codex Custom instructions,我个人很不喜欢这种。

鲸鱼兄弟们好,我是做 DeepSeek-TUI 的那个美国佬。 说真的,特别想跟国内的鲸鱼兄弟们一起混——但我的翻墙技能仅限于写代码,微信到现在都没搞定,属实有点丢人。 求各位大佬帮个忙: 1)帮忙转发扩散一下,让这个开源终端工具翻过高墙被兄弟们看到 2)顺手帮我验证个微信号,我想建个群,大家一起聊 DeepSeek、聊开源、聊怎么把 agent 做得更好 作为交换,我发誓死守 cargo install 这条安装路径,绝不让任何一个兄弟受 npm 的苦。 顺带一提,这段话是 DeepSeek 帮我润色的——感谢鲸鱼赐我流利中文 🙏 github.com/Hmbown/DeepSee…