Telan

30 posts

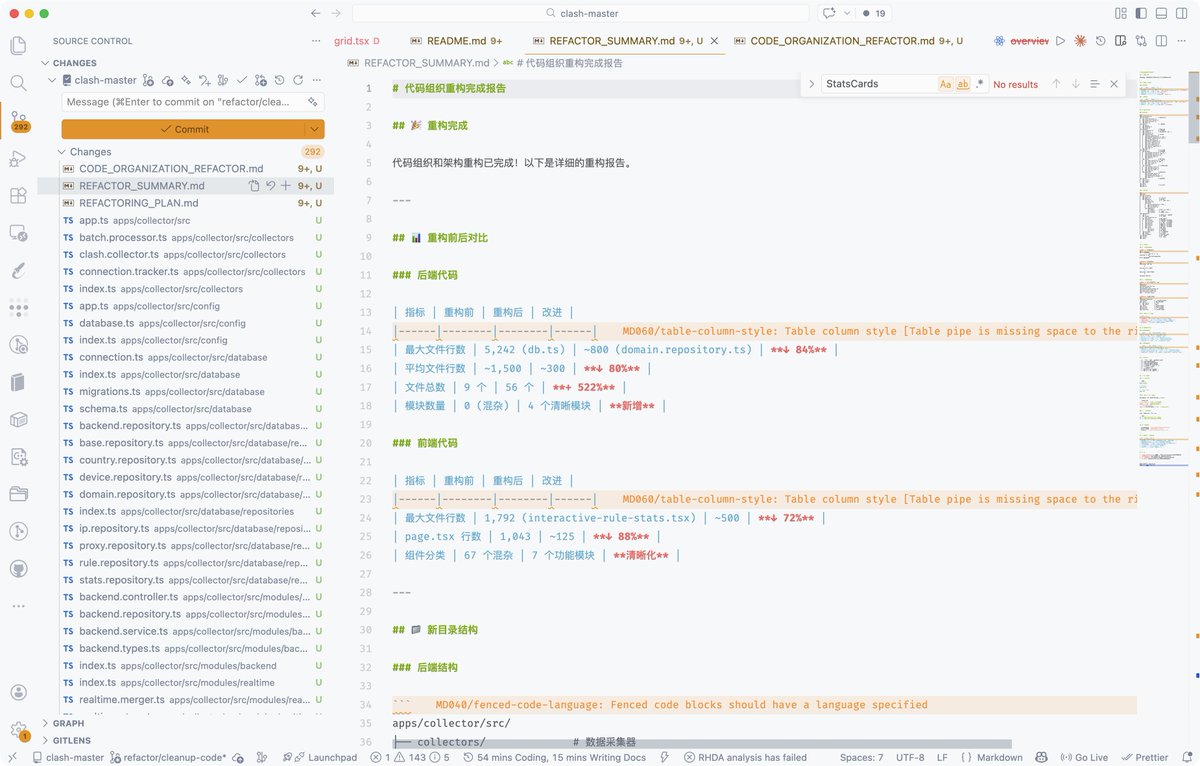

大家一直吐槽 LobeChat 切换慢,卡顿,之前我一直觉得是我们 next 的用法不对,所以一直在尝试各种写法,从 RSC、平行路由、拦截路由,一直到动静态渲染、路由段重写等等方案。 2 年时间硬生生从 next 小白变成了 next 专家,但还是没有效解决页面切换卡顿的问题。而最近把两个路由段(discover 和 settings)换成了 react-router ,做了 SPA 改造,瞬间不卡了😅 所以 2.0 准备全量改造成 SPA 了 现在回过头来看就是陪 Next 踩了两年 RSC 的坑 😌 paperclover.net/blog/webdev/on…

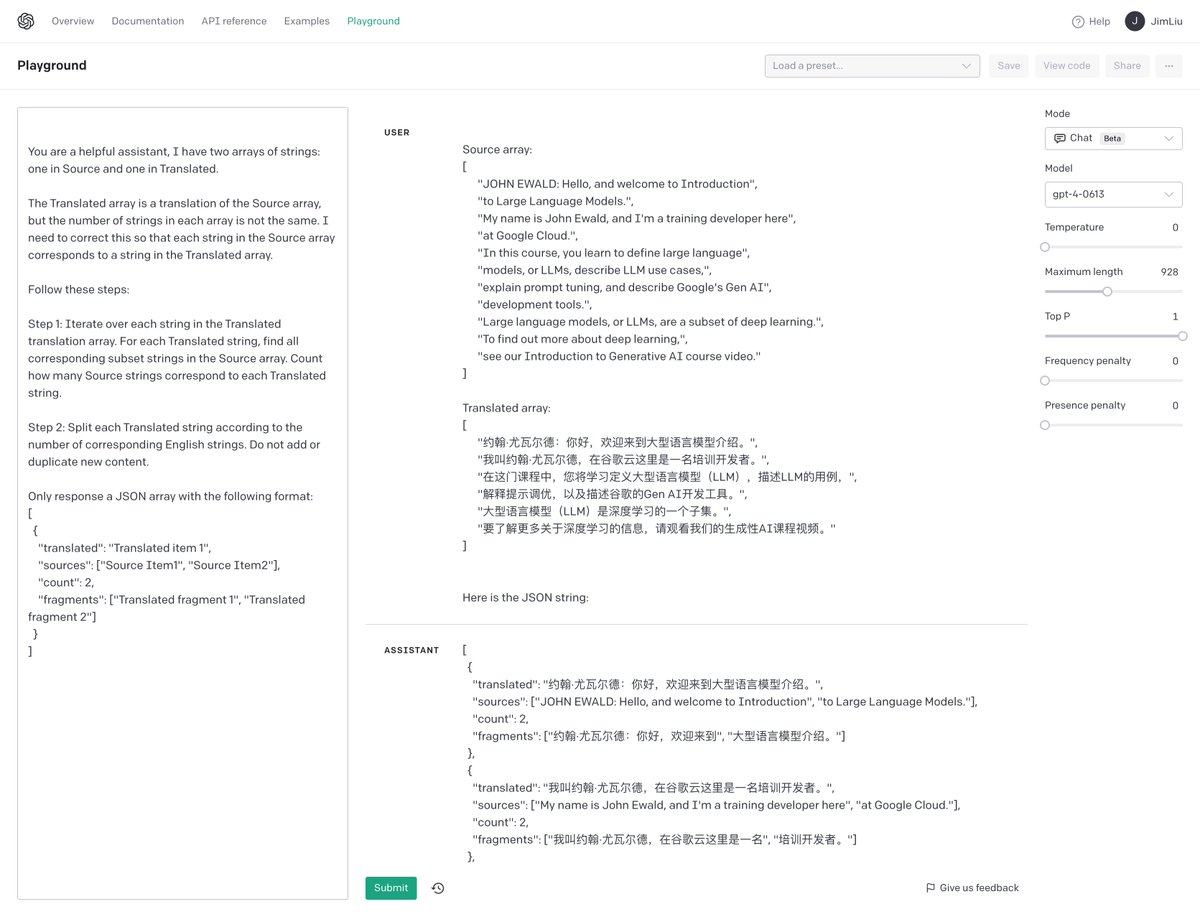

给有兴趣学Prompt的同学一个思考题:假设我现在有两个字符串数组,一个英文的数组一个是翻译后的中文数组,但是英文数组长度是11个,中文数组只有6个(翻译时合并了),现在问题是,怎么样让LLM帮助纠正这种错误,基于英文数组的内容把中文数组也变成11个? 这个问题我能用GPT-4解决,但是GPT-3.5还搞不定。过几天在这条推文下面公布我的答案,成功率相当高,但是成本也不低,像下面的输入输出一次都接近0.1美元了。 Tip:给GPT时间思考 以下为参考的示例数据: --------------- Source array: [ "JOHN EWALD: Hello, and welcome to Introduction", "to Large Language Models.", "My name is John Ewald, and I'm a training developer here", "at Google Cloud.", "In this course, you learn to define large language", "models, or LLMs, describe LLM use cases,", "explain prompt tuning, and describe Google's Gen AI", "development tools.", "Large language models, or LLMs, are a subset of deep learning.", "To find out more about deep learning,", "see our Introduction to Generative AI course video." ] Translated array: [ "约翰·尤瓦尔德:你好,欢迎来到大型语言模型介绍。", "我叫约翰·尤瓦尔德,在谷歌云这里是一名培训开发者。", "在这门课程中,您将学习定义大型语言模型(LLM),描述LLM的用例,", "解释提示调优,以及描述谷歌的Gen AI开发工具。", "大型语言模型(LLM)是深度学习的一个子集。", "要了解更多关于深度学习的信息,请观看我们的生成性AI课程视频。" ]