Naka-pin na Tweet

Ren

272 posts

Ren

@FakeMaidenMaker

🧠 First Principle Thinking 🔨 Build in Public 🤖 AI 开发者 📈 量化策略研究者 持续分享 AI/科技/投资/创业 领域干货内容

Virginia, USA Sumali Mart 2025

151 Sinusundan295 Mga Tagasunod

@lidangzzz 落到具体项目这个skill该怎么用呢。之前的工作流已经被各种design plan build review debug占满了

中文

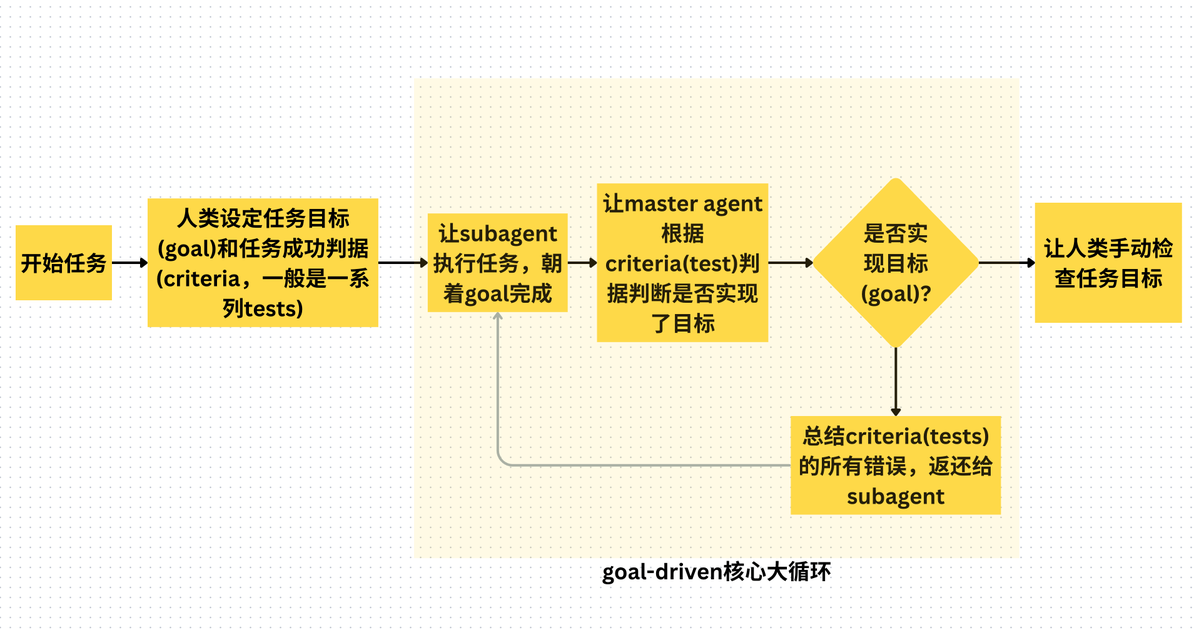

所以我反复反复反复讲,为什么claude code、codex的唯一正确用法,就是goal-driven

goal-driven

goal-driven

goal-driven

github.com/lidangzzz/goal…

只有人类设置

一个目标(goal)

一个判据(criteria,比如几百个unit test)

一个master agent执行判据,监督subagent

一个subagent无限循环工作

才能把人的工作彻底解放出来。

这是控制理论的负反馈机制在coding agent的最简单、最成功实践,

这是convex optimization在dual agent system里最直白表达,goal就是目标函数,criteria就是gradient descent,

这是reinforcement learning的最古典哲学。

这是维纳、香农、Stephen Boyd三个人联合托梦告诉我的。

响马@xicilion

没有谁该 first,至少很长一段时间,AI 和人类在开发中的关系,是结对关系。谁也离不开谁。 哪种完全撒手让 AI 从头干到尾的,看起来很潮,实际上是执行人根本不知道自己想要什么,也根本不知道 AI 在干什么。因为 AI 干出什么,他们都会觉得超出预期。

中文

@Graceruansu 双鱼毁双子,两个都是变动宫星座(双子风象变动,双鱼水象变动),都拥有双重/多重人格,都很聪明、适应力强、情绪起伏大,本质完全相反:

双子理性多变、双鱼感性梦幻,结果往往是初期互相吸引、后期互相折磨,最终变成“最痛的伤害”。

中文

总想做点什么,却总是执行力不够?

那就别再一个人硬扛了。

我们准备开一个 30天出摊挑战训练营。

不是让你进群听课,

也不是让你来围观。

就是拉一批人,狠狠干30天。

这30天我们一起做两件事:

一个是 夸克网盘拉新,先碰到真实收益;

一个是 Twitter持续出摊,把执行力练出来。

很多人不是没项目。

是总想着开始,结果干两天就停。

真正缺的,往往不是方法,

是有人盯着你,把节奏拉起来。

所以这次规则直截了当:

99进群,不是学费,先放我们这儿30天。

30天内做出一笔真实收益,退你100。

30天内没做出来,但你确实认真做满30天,退你99。

当然,也不是完全没有条件:

1. 你得有 Twitter 蓝V账号,粉丝大于 777。

2. 进群7天还不上手做,直接踢出群,不退费。

3. 划水、断更、敷衍执行,30天后不退费。

我们不想收一堆“我先看看”的人。

我们想找的是那种,愿意先信一次,也愿意真干30天的人。

而且这事不是大家互相抢那点存量。

是一起做增量,去赚甲方的钱。

哪怕你现在还没吃到 X 的收益,

这个项目本身也能做出钱来。

说到底,

这个训练营最值钱的,未必只是网盘拉新。

更重要的是,30天结束以后,

你可能真的把“持续出摊”这件事练出来了。

想围观的别来。

想认真干一轮,把自己逼上正轨的,来。

想同行的,过来加v :Davinci0777

中文

我来拆穿这个骗局吧。

anthropic训练好的超级大且厉害的mythos,但是有两个顾虑,

一个是这个模型inference成本创新高,一旦对公众放开了,算力必然成为巨大瓶颈,于是仅仅先卖给business用户,

一个是这个模型空前强大,必然会有开源友商不断蒸馏,于是直接供应给可信客户,别人都彻底别用了,

但是anthropic不可能公开这么说,

于是就想了个借口,“这个mythos搞了好多漏洞出来,你们公众一旦用了,就会产生严重的攻击,坏人们肯定天天挖漏洞,挖完漏洞就欺负你们,所以我不给你们开放,是为了你们老百姓好”,

其实做cybersecurity的人,早就用各种垃圾模型挖漏洞了,轮不到mythos来抢饭碗,

但是这个“为了你们安全,为了你们好”的借口,听上去非常伟大光明正确,于是傻逼一样的公众也就接受了anthropic的这个借口。

就这么简单。

中文

@FakeMaidenMaker 哥,夫妻俩体制内,父母都有退休金,这种家庭绝对不普通

不过如果不追求啥的话,只要能赚钱在老家真的很舒服,一点都不卷

中文

好问题

Hermes 省token方面有很多机制:

1. 缓存优化:

hermes: 全session 缓存,缓存命中接近100%;

并且 Hermes 把外部记忆、plugin 上下文等临时内容塞到 user message 里而不是 system prompt,确保 system prompt 的 prefix cache 永远命中。

openclaw: 动态内容(heartbeat、group chat context、runtime info)会更改 cache boundary, 缓存打折扣

虽然不省 token 但是 cache 命中高 = 省钱

2. Comapction 增量更新(省的不多)

Hermes: 已有摘要时只 merge 新内容

openclaw: 每次 compact 重写摘要

3. 历史记录搜索方式(最省token的一集)

Hermes: FTS5(关键词搜索) 命中 → 加载匹配会话 → 截取 ~100K 字符 → 廉价模型摘要 → 精炼结果注入

OpenClaw: Hybrid:向量+BM25 搜索 → 返回 top N raw chunks → 直接注入主模型 Context

读取 raw chunk, token 开销大!

关于 skill 管理:

1. 能关

config 里有 creation_nudge_interval: 15 这个参数,每隔 x 轮对话自动判断是否有需要更新的 skill

设成 0 就禁用自动创建更新。

2. 如果太多了仍然还是要手动管理的

检测到已有相关skill会进行更新而不是无限创建。如果长期使用skill太多 ,允许用户通过 `skills.disabled` 禁用一些skill或者直接删除。

能用到 50+ 不同复杂流程被自动编写为skill的时候,相信你也是Master了。

黄赟@huangyun_122

感谢分享 这两点我有疑惑: 1/ 如果历史会话够长,Hermes 采用什么方式实现搜索,能比 OpenClaw 的压缩更快?而且能精确到减少 30-60% 的 Token 消耗。纯依靠大模型的缓存,肯定不是唯一解 2/ 自动生成 skill, 是否可以关掉?纯自动化会带来更多的 Token 消耗和后期的维护。如果不加以收敛,Skill 库会爆炸性膨胀。不知道 Hermes 对 Skill 生命周期怎么治理

中文