SGode

11.2K posts

@Seb_Gode @kimmonismus How can i ? Its not even working when i load models that bigger than 14b?

English

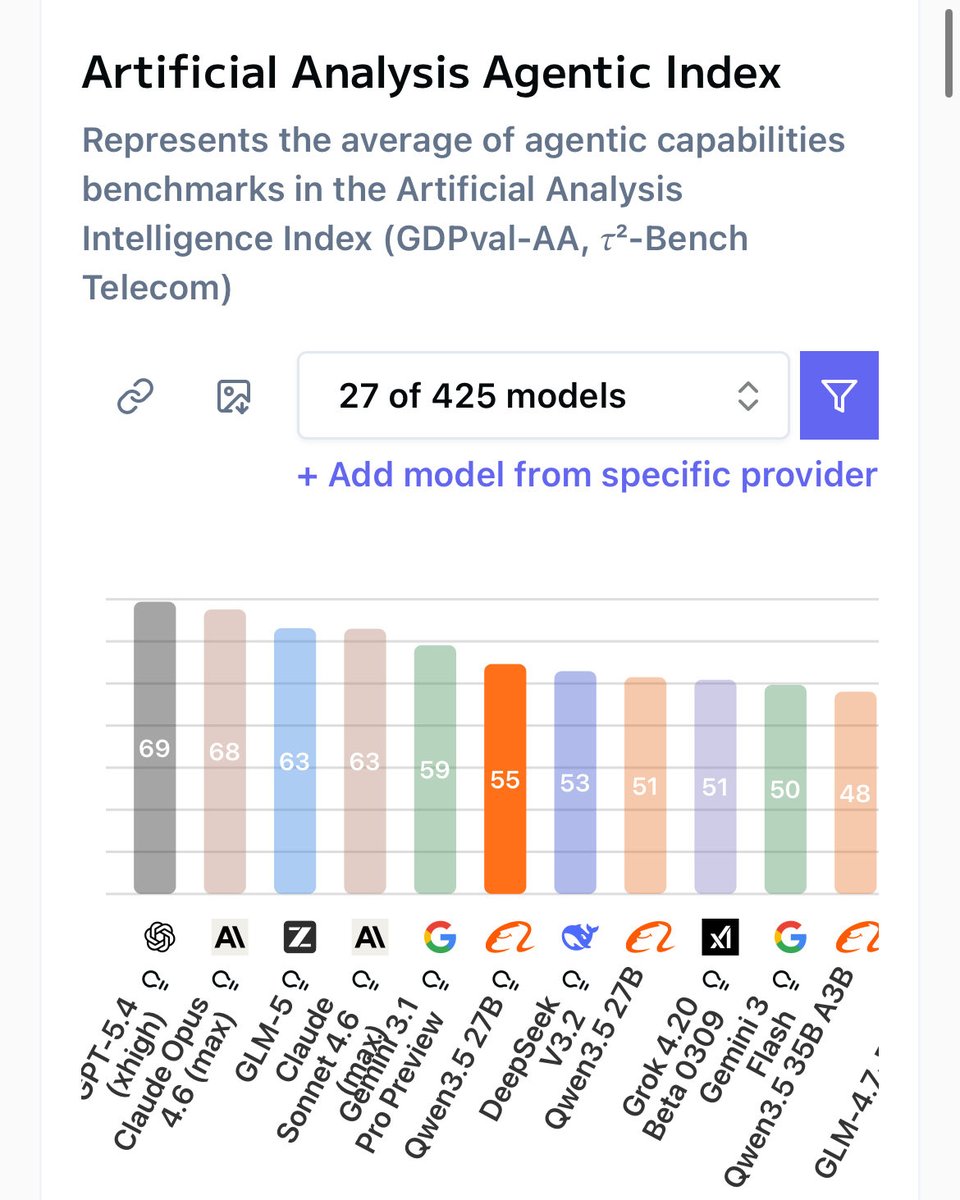

@stevibe The 122B on Benchmarks is equal to the 27B but faster due to only 10B active params.

On 16GB VRAM the 122B model is the one you should pick as you can fit the MoE part fully on GPU while keeping the other stuff on normal RAM. It's faster with that on at least 16GB than 27b.

English

Got a 24GB Graphics Card?

These 6 coding models all fit on it (Q4):

- qwen3.5:27b (17GB)

- qwen3.5:35b (24GB)

- glm-4.7-flash (19GB)

- nemotron-3-nano:30b (24GB)

- nemotron-cascade-2:30b (24GB)

- gpt-oss:20b (14GB)

I gave them the same challenge: draw a campfire with HTML Canvas.

Why Canvas? HTML/CSS forgives bad syntax — things still render. JavaScript + Canvas doesn't — one mistake and the screen goes black.

English

@isimsiz32078526 @kimmonismus So basically everything up to 35B A3B :D

But even with the 122B A10B you should get like 18tps with just 16GB VRAM

English

@kimmonismus I have all qwen models that can run on a 16gb of vram 😅

English

@AchimEhinger @BGM90812366 @ChristophBeisl1 Inexogy ist halt viel viel teurer.

Und Inexogy ist auch abhängig vom lokalen Netzbetreiber, da kann auch vieles schiefgehen.

Installation bis Inbetriebnahme mit Octopus Energy Metering war bei mir September - März, also quasi 6 Monate.

Deutsch

@BGM90812366 @Seb_Gode @ChristophBeisl1 Versuch doch mal den Smartmeter über Inexogy zu bekommen. Hat bei mir innerhalb von 3 Monaten geklappt.😂

Allerdings hat mir der Monteur die falsche Pin zum Freischalten der Datenausgabe genannt. Bis ich die korrekte Pin bekommen habe hat das nochmal 4 Wochen gedauert.

Deutsch

@PeterSt16265067 @Faktencheck2030 Man müsste bei den EEs Korrekterweise Akkugroßspeicher dazu berechnen.

Das verschiebt die Gesamtbilanz aber nicht wirklich.

Deutsch

@Faktencheck2030 Leider kann man Kernenergie

mit Erneuerbaren nicht vergleichen.

Die eine EForm ist grundlastfähig, die andere eben nicht.

Man kann keine grundlastfähige mit einer grundlastunfähigen ersetzen. Das machen nur Schildbürger wie Grüne und andere Esoteriker.

Deutsch

So viel kostet Strom in der Eu🇪🇺.. oder das Märchen der billigen Kernenergie⚛️

#Atomkraft #Erneuerbare #Strom

Werkstattlümmel@Labor2b

@MikeHudema That is such a great solution. I love it, it is free and clean energy for Europe.

Deutsch

@u_mastery @FFmpeg And you only used an ancient codec.

Use AV1 to half that size :)

English

@henry_bayes @LottoLabs If I can fit 27B on a 16GB card you can too.

x.com/i/status/20292…

Use UD-IQ3_XXS

Benjamin Marie@bnjmn_marie

Qwen3.5 27B GGUF evaluation: ✅UD-Q4_K_L, IQ4_XS, and IQ4_NL perform closely to the original ✔️UD-IQ3_XXS is good enough ❌Couldn't find a good Q2 Next: Qwen3.5 9B. Again, early results suggest Q4 quants are very close to original

English

@LottoLabs Where is Qwen 3.5 122b a10b?

I can fit that on a 16GB card at 18 token/second …. I can’t fit 27b.

English

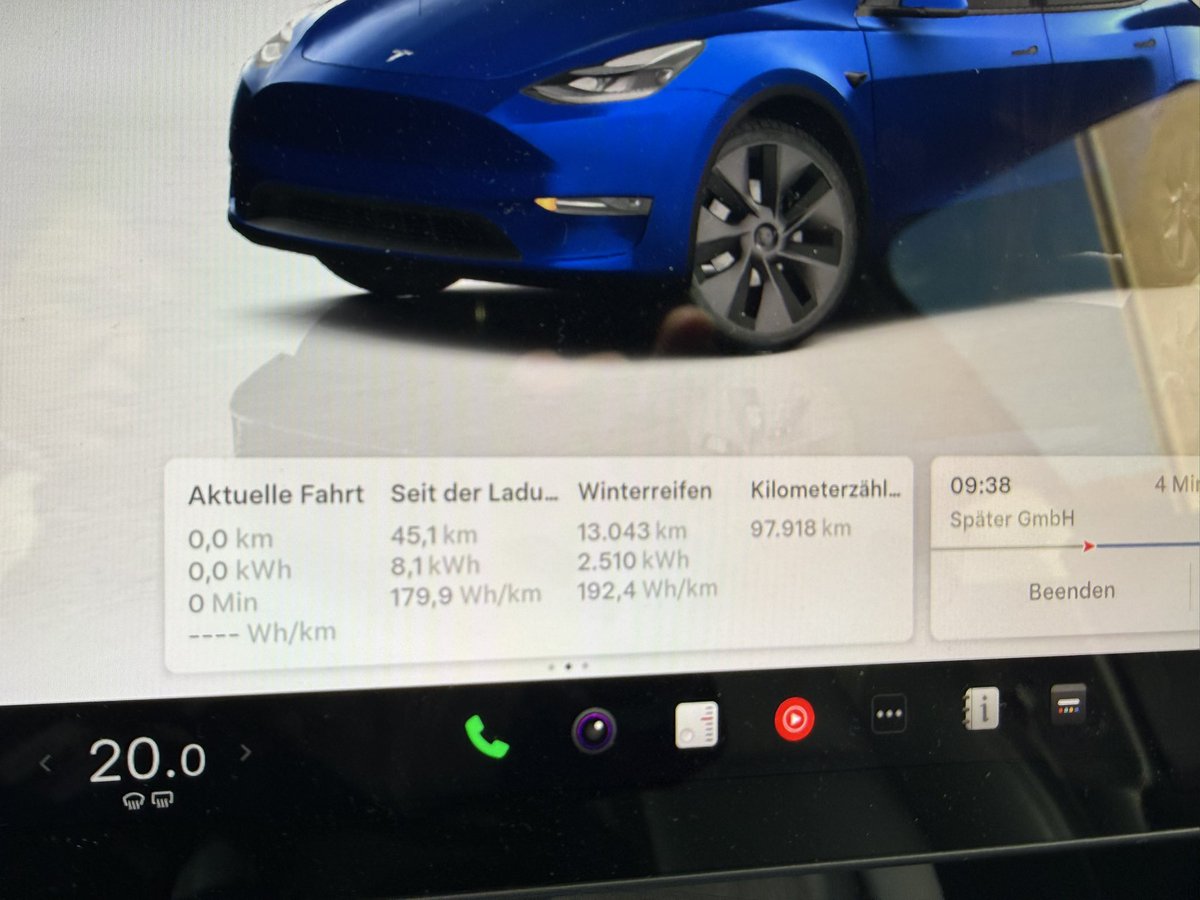

Auswertung Winterreifensaison:

13.043km in 170 Tagen.

76,72km am Tag.

2830kWh inkl Verlusten, 63% am Arbeitsplatz, 31% zu Hause geladen, 34,4kWh bzw. 1,2% öffentlich geladen.

Kosten für mich?

Ähhh… Fehlanzeige. Ich habe zwar für meine Verhältnisse viel zu Hause geladen aber ich bin da erst 1/3 durch mein Guthaben aus Neukundenwerbung bei Octopus Energy durch. Öffentlich geladen waren tatsächlich mit eigenem Geld für 15,46€ (wobei mir das Laden 10€ Parkgebühr erspart hat), mit &Charge Guthaben für 13,18€.

Im Zeitraum über das Elektroauto erhalten: 230€ aus &Charge (Danke an die CPOs) und noch 2500 Freikilometer bei Tesla.

Auf der Minus Seite: Zwei Blech- und Lackschäden am Auto mit in Summe für mich 800€ Selbstbeteiligung und in Zukunft teurerer Versicherung. Und ein Nagel im Reifen.

Deutsch

@davidgpeterson @ProtonVPN I still don't get why I need to let my 1 year subscription expire and then book it again instantly to get a cheaper price. :D

Why do you make it so complicated, why can I not extend it before during a sale?

English

@slidecurry @KnuelleTuennes1 Ja gut, dass sollen die machen.

Wenn die Rezension deine Erfahrung widerspiegelt machen die eh nichts bzw. dein Anwalt klärt das im Zweifel.

Deutsch

@Seb_Gode @KnuelleTuennes1 Ne, kam nicht von Google, sondern dieses Steakhouse hatte uns und weitere Schreiber mit einem Anwaltsbrief gedroht.

Deutsch

@slidecurry @KnuelleTuennes1 Wenn das von Google selbst kommt einfach Einspruch einlegen, Kommentar ist sofort wieder da und passieren tut nichts mehr.

Deutsch

@KnuelleTuennes1 Bekannte Praxis bei Google generell. Hatten wir schon mal bei uns in einem Restaurant, dass man ein komplett verbranntes Steak bekommt und deshalb nur zwei Sterne gegeben hat. Kurze Zeit später kam Post vom Anwalt wegen übler Nachrede und Drohung, es zu löschen.

Deutsch

@robkde @Cipher_twt 35B is a MoE with 3B active params.

It's worse in intelligence but **a lot** faster because it only has 3B active instead of the full 27B.

If you want most skills use 27B.

You can go down to UD_IQ3-XSS if you only got 16GB VRAM. It only is slightly worse than the Q4 quants.

English

@robkde @Cipher_twt Qwen3.5 especially. The dense 27B model is roughly on par with Qwen3.5-122B, you can even run it at home. It's just slow as it has no MoE.

Qwen Coder is based on Qwen3 which is a lot worse.

I'd say in terms of models up to 120B Params Qwen3.5-27B Dense is the way to go right now

English

@robkde @Cipher_twt Qwen Coder is by now ancient in terms of AI models and their progress. :D

I'd GPT-OSS is better than Qwen-Coder. The world is progressing fast here

English

@Seb_Gode @Cipher_twt Finding out differences in model behavior. I mainly used Qwen Coder, but it also seems to not really understand our code base.

English

@robkde @Cipher_twt Any reason on why you used GPT-OSS and not smart models? :D

I mean even small ones like Qwen3.5-27B are **a lot** better than GPT-OSS 120B

English

@Cipher_twt It literally tried for 5 minutes to find a backup of the file 😂

English