fudingyu

2.6K posts

fudingyu

@fdy

Vibe Coding + Vibe Marketing + Vibe Selling, Startups.

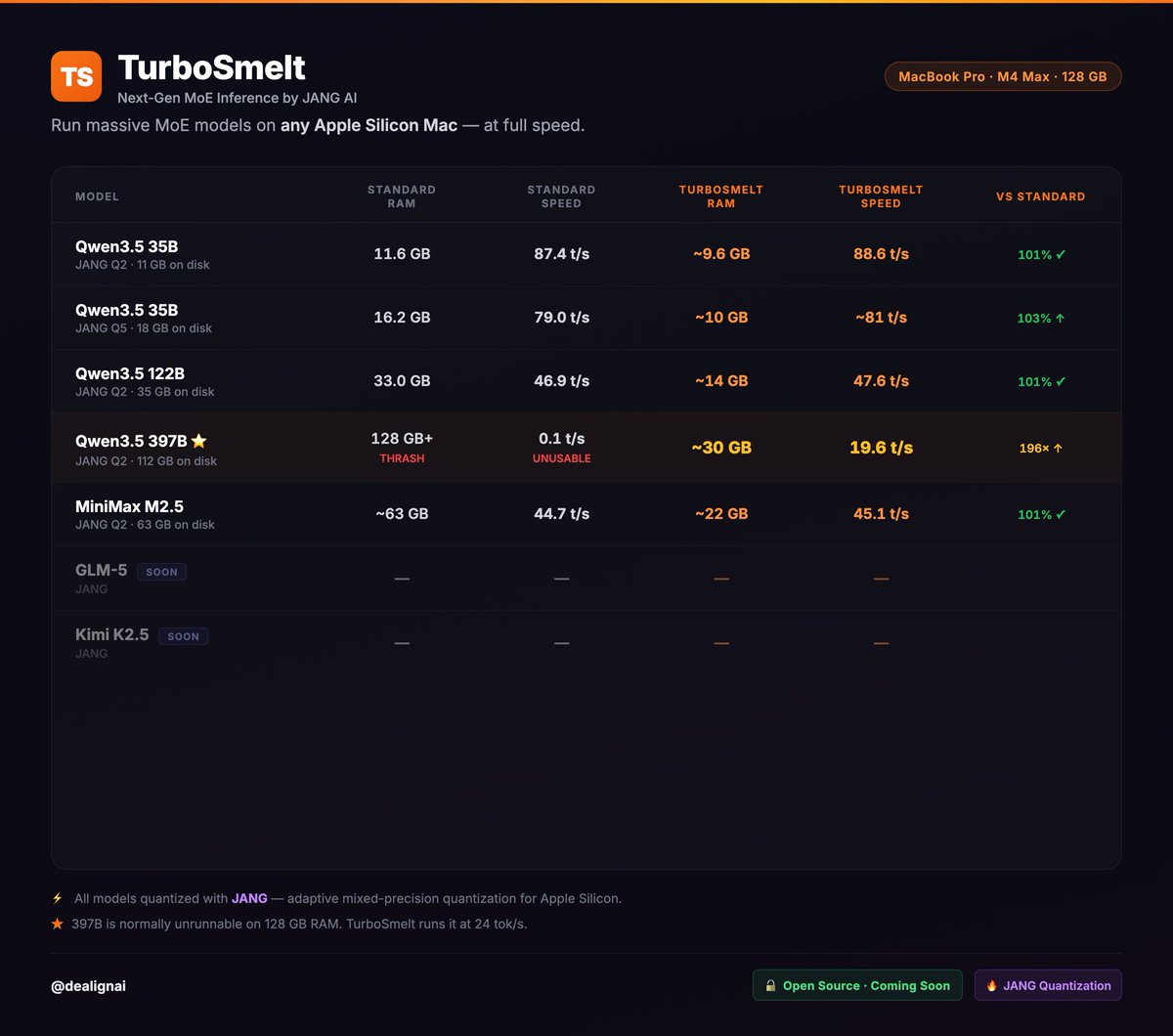

I open-sourced DDTree-MLX: tree-based speculative decoding for Apple Silicon. Now you can run Qwen 3.5 27b on your Apple machines 1.5x faster than normal. Expect even faster on smaller models. It runs Qwen 3.5 27B locally with MLX, extends DFlash with draft trees, and gets ~10-15% faster than DFlash alone on code + structured prompts while keeping output lossless. Built on the works of @bstnxbt @liranringel @yaniv_romano github.com/humanrouter/dd…

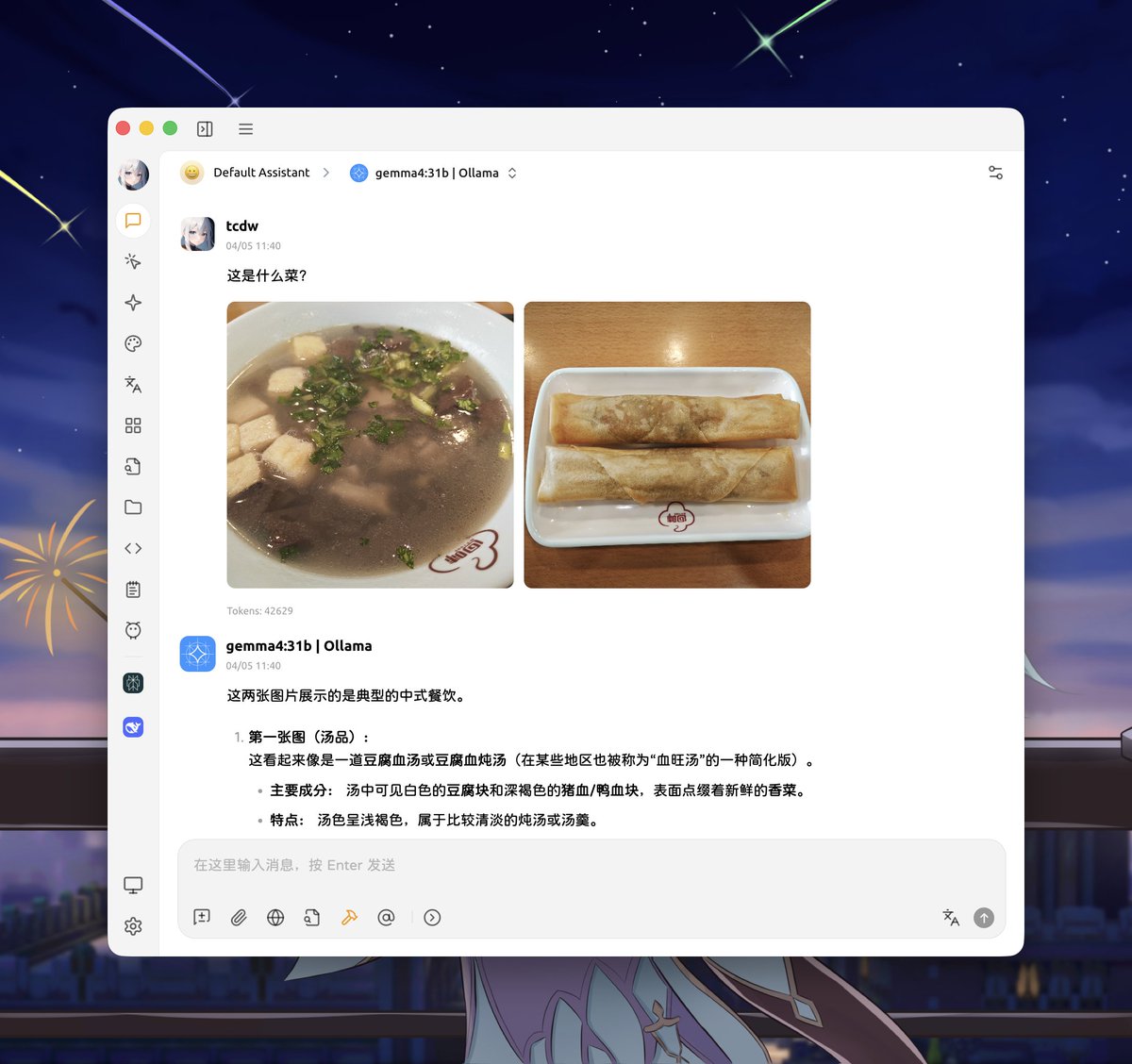

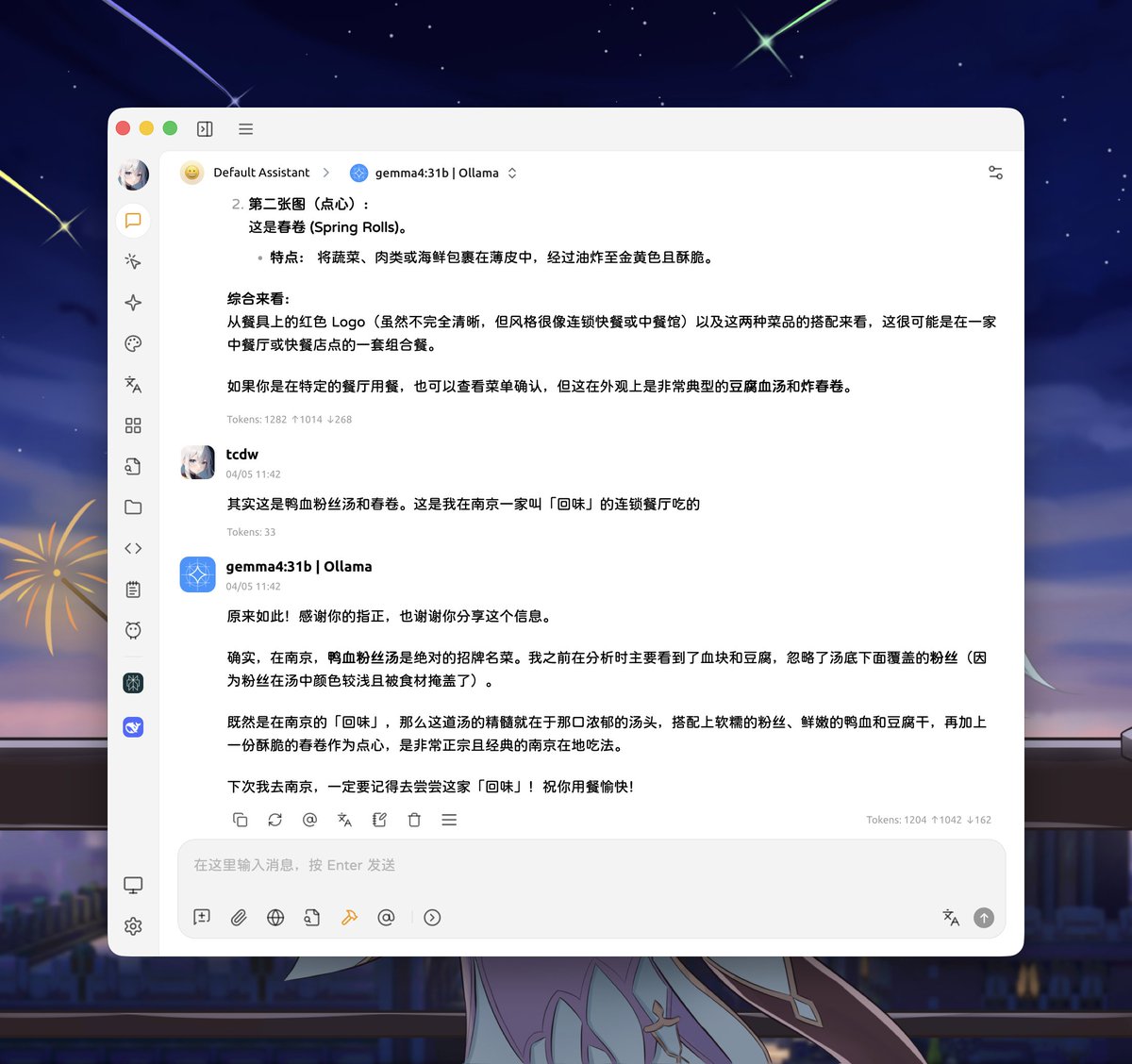

前两天我发了Gemma 4的技术整理和实战体验,很多朋友在评论区问: “为什么这么多人下载?是因为它免费吗?” 我想了很久,我发现答案不是这么简单 ➢一周下载破1000万,这个数字背后藏着一个信号,大多数人都没注意到 --- 我最近越来越觉得不对劲 我用了1年ChatGPT、Claude、Gemini. 每次我输入客户资料、内部文档、商业想法的时候,我都会犹豫一下: ➢这些数据会被拿去训练模型吗?会被泄露吗? 还有一件事让我很不爽: OpenAI可以随时调整GPT-4的参数,Claude可以随时改 Opus的行为 你今天调好的prompt,明天可能就不好使了 你的AI能力,永远被API额度锁死 你想做个Agent跑24小时?对不起,API费用可能让你破产 你想部署到离线环境?对不起,没网就没AI --- ➢为什么1000万人选择下载Gemma 4? 不是因为它跑分高(虽然AIME 89.2% 确实猛) 而是因为人们终于意识到:AI不应该是租来的黑盒,AI 应该是你真正拥有的工具 --- 我在想三个趋势 1. 可以拥有的AI会成为必需品 你想想,你不会把所有照片都存在别人的云盘上 同样的,以后你也不会把所有AI工作流都放在别人的API 上 ➢医疗、法律、金融这些行业,企业内部的Agent,科研项目,国家的主权AI 这些场景必须用本地模型 Gemma 4把门槛降到了“一张显卡”的水平,这是一个大变化 31B 压缩后17.4GB,E4B版5GB能在手机上跑多模态 这不是玩具,这是真正能干活的工具 --- 2. 独立开发者和小团队的好时代要来了 以前你做AI应用,要么租API(成本高),要么租GPU(更贵) 现在呢? 31B版在Codeforces拿2150分,26B MoE速度接近4B但能力接近 31B ➢小团队做垂直Agent、做私有化部署、做离线工具,成本直接降到最低 这波机会,是给那些不想被API 绑住的人 --- 3. Web3+ AI的真正落地点,可能就在这里 我一直在想:Web3和AI怎么结合? 以前的答案都是“链上AI”、“去中心化训练” 听起来很酷,但是太难落地了 但是如果 AI能在本地跑,数据不上链也能保证隐私,主权数据+ 主权模型+链上验证 这才是真正的去中心化AI Gemma 4把云端能力搬回家,Apache 2.0完全开放权重 + 完全开放许可 ➢你完全掌控模型、数据和运行环境 这是 2026年本地AI的一个重要节点 --- 我昨天测了一整天 ➢agent流程很稳,长上下文没出问题,function calling比我想的还要好用 我现在在测试一个想法:我想用Gemma 4做一个完全离线的个人知识库Agent 所有数据在本地,所有推理在本地,没有API费用,没有隐私问题 如果测试顺利,我会分享具体的部署方案和我踩过的坑 --- 最后一个问题 ➢如果AI可以完全属于你,你会用它做什么? 我说的不是“用ChatGPT写个文案” 我说的是“拥有一个24 小时在线、完全听你指挥、永远不会泄露你秘密的AI助手” 这个问题,我还在想 但是我知道,答案不在云端,答案在本地 (这是我的个人思考,不是推广。已经上手的朋友,欢迎评论区聊聊你的想法)

Google的开源模型 Gemma-4-31B-it 在 Hugging Face的趋势排行榜上,已经排到第一位! 高玩 Gemma-4-31B 的硬件建议: 1. 显存 (VRAM) 需求 显存是本地运行该模型的核心瓶颈: 全精度 (BF16/FP16):约需 58.3 GB - 62 GB 显存。至少需要一张 NVIDIA H100 (80GB) 或 A100 (80GB) 级别的企业级显卡,才能单卡运行。 8-bit 量化 (SFP8):约需 30.4 GB 显存。 4-bit 量化 (Q4_K_M):约需 17 GB - 20 GB 显存。可以使用单张 NVIDIA RTX 3090 (24GB) 或 RTX 4090 (24GB) 运行。 2. 内存 (RAM) 需求 如果你使用 llama.cpp 等工具进行 CPU 推理或部分显存卸载,至少 32GB 内存,推荐 64GB 以应对更长的上下文。 3. 处理器 (CPU) 与其他 CPU:建议使用多核高性能处理器,如 Intel i9 或 AMD Ryzen 9 级别,以保证量化后的推理速度。 存储:模型权重文件大约占用 20GB - 60GB 空间。

兄弟们,原来蒸馏如此的见效快! 难怪大厂都热衷于此哈哈哈😂 Apple Research(苹果研究院)刚刚发布了一篇“超级简单却效果炸裂”的论文,标题直接叫《Embarrassingly Simple Self-Distillation Improves Code Generation》(尴尬的简单自蒸馏就能大幅提升代码生成能力)。 论文核心发现(Simple Self-Distillation,简称SSD): 你不需要: - 更好的教师模型 - 任何verifier(正确性验证器) - RL(强化学习) - 代码执行环境 - 外部标签或奖励模型 方法简单到离谱: 1. 用当前模型自己采样生成代码(带一定temperature和truncation,不用greedy解码) 2. 完全不过滤这些输出的正确性 3. 直接拿这些“原始”输出做标准SFT(监督微调) 就这么三步,模型就能大幅进步! 实测效果(震撼): - Qwen3-30B-Instruct:LiveCodeBench pass@1 从 42.4% → 55.3%(相对提升30%!) - 尤其在hard problems上提升最大:pass@5 从31.1% → 54.1% - 只需每个prompt采样1次就够 - 在Qwen和Llama系列的4B、8B、30B规模上全部有效(包括instruct和thinking变体) 论文最有洞见的解释: 很多coding模型其实已经把“正确能力”藏在权重里了,只是greedy decoding(贪婪解码)把它锁住了。 SSD通过在自己生成的数据上训练,上下文依赖地重塑token分布。 在需要精确的地方压制干扰项,在需要探索的分支处保留多样性,从而把模型的潜在能力真正释放出来。 总结一句话: “很多coding模型其实在用自己的权重‘欠发挥’。 用自己的输出再训一轮,就能把藏着的实力挖出来,而且完全不需要外部信号。”** 地址见评论区👇

兄弟们,原来蒸馏如此的见效快! 难怪大厂都热衷于此哈哈哈😂 Apple Research(苹果研究院)刚刚发布了一篇“超级简单却效果炸裂”的论文,标题直接叫《Embarrassingly Simple Self-Distillation Improves Code Generation》(尴尬的简单自蒸馏就能大幅提升代码生成能力)。 论文核心发现(Simple Self-Distillation,简称SSD): 你不需要: - 更好的教师模型 - 任何verifier(正确性验证器) - RL(强化学习) - 代码执行环境 - 外部标签或奖励模型 方法简单到离谱: 1. 用当前模型自己采样生成代码(带一定temperature和truncation,不用greedy解码) 2. 完全不过滤这些输出的正确性 3. 直接拿这些“原始”输出做标准SFT(监督微调) 就这么三步,模型就能大幅进步! 实测效果(震撼): - Qwen3-30B-Instruct:LiveCodeBench pass@1 从 42.4% → 55.3%(相对提升30%!) - 尤其在hard problems上提升最大:pass@5 从31.1% → 54.1% - 只需每个prompt采样1次就够 - 在Qwen和Llama系列的4B、8B、30B规模上全部有效(包括instruct和thinking变体) 论文最有洞见的解释: 很多coding模型其实已经把“正确能力”藏在权重里了,只是greedy decoding(贪婪解码)把它锁住了。 SSD通过在自己生成的数据上训练,上下文依赖地重塑token分布。 在需要精确的地方压制干扰项,在需要探索的分支处保留多样性,从而把模型的潜在能力真正释放出来。 总结一句话: “很多coding模型其实在用自己的权重‘欠发挥’。 用自己的输出再训一轮,就能把藏着的实力挖出来,而且完全不需要外部信号。”** 地址见评论区👇