🤔🤔

3.6K posts

除了连载小说,“失败概率:十亿分之一” 情节外的彩蛋和设定会在这个社交媒体账号里进行揭示。预告一下,虽然世界设定借用了海伯利安,但是目前设定的风格是科幻悬疑类的,也原始的情节没有什么联系。大纲已经写完了,自己觉得还是非常有有意思的。再次推荐关注这个账号!

Lyra 周@lyra_arch

除了自拍之外,这里当然还会放我在各个星球出差时候拍的风景。风景照我喜欢宽幅的,因为我去过的星球大多数都比较开阔荒凉。有一点我一直觉得很疑惑,既然技术核心可以带我们去任何星球,为什么我们在这些星球上却从来没有发现过像我们一样的智慧碳基生物呢?

中文

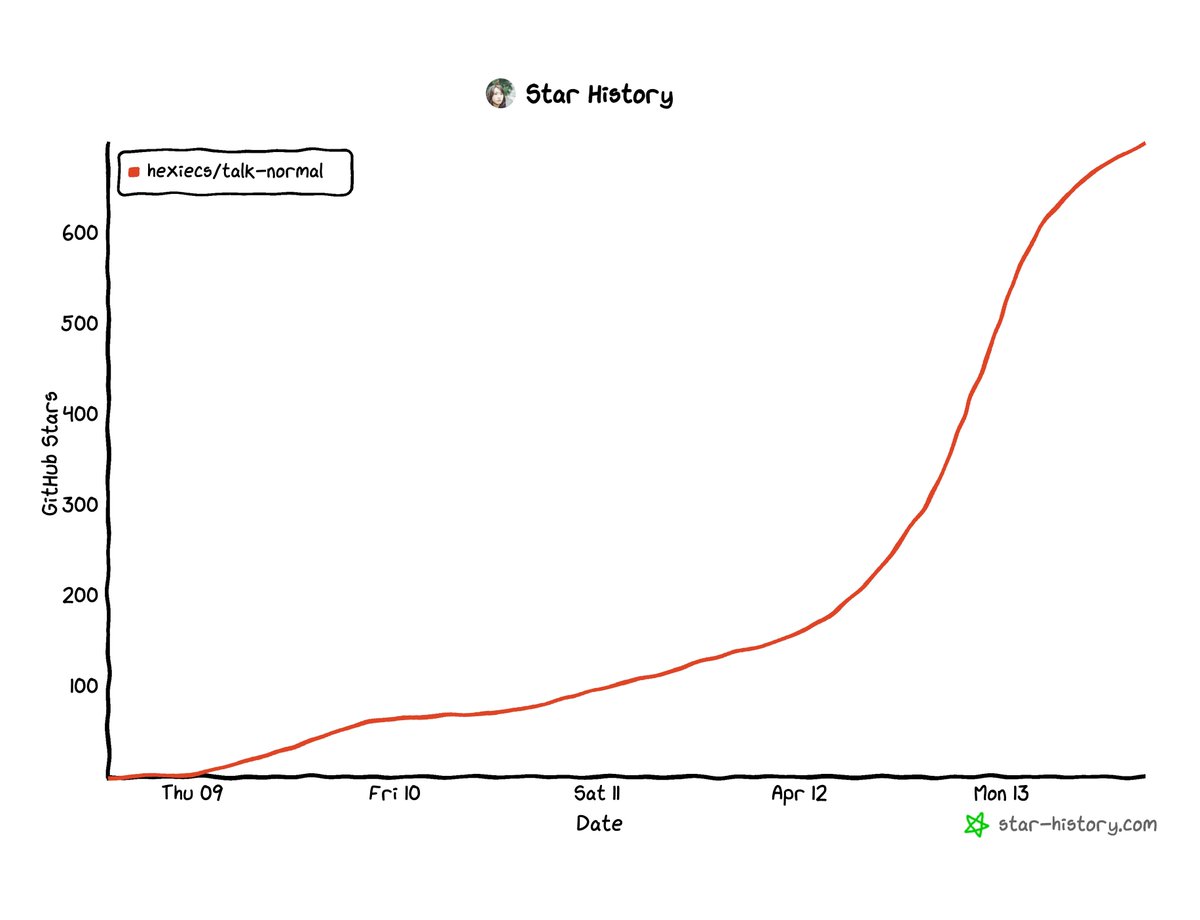

talk-normal是一个看似简单的项目,但解决了一个重要的问题:提高与大模型的沟通效率。

人们喜欢用claude的模型,并不仅仅是因为他聪明,还有一个重要原因是跟他聊天有朋友的感觉,它会言简意赅的帮你解决问题。而其他的很多LLM喜欢乱运用排比句,转折句,有时候感觉像把你当3岁小孩,有时候又像个喜欢跪舔讨好你的下属。

在Anthropic禁止openclaw使用claude订阅前,我几乎不使用chatgpt,不知道这个问题的严重性,而在我切换到chatgpt体验了两天后,发现这个AI味道已经严重到让人不想和它进行对话了,这个项目发布几天后的star数增长也说明了这不是我一个人遇到的问题,是大家实实在在的烦恼。

当然这个问题要根本性的优雅解决,还是得依靠大模型厂商来改进模型本身,来提升他的语言组织方式。不过短时间看各大模型厂商的精力并不在这里,那我们通过一些工程的手段来改进,是符合harness engineering的方向的,说白了只要能解决问题,谁关心是模型本身的进步还是模型外套了一层进步的壳。

目前我自己用起来已经没有bad case了,如果大家用起来还有觉得AI味的地方,可以直接提issue或私聊我

github.com/hexiecs/talk-n…

中文

🤔🤔 đã retweet

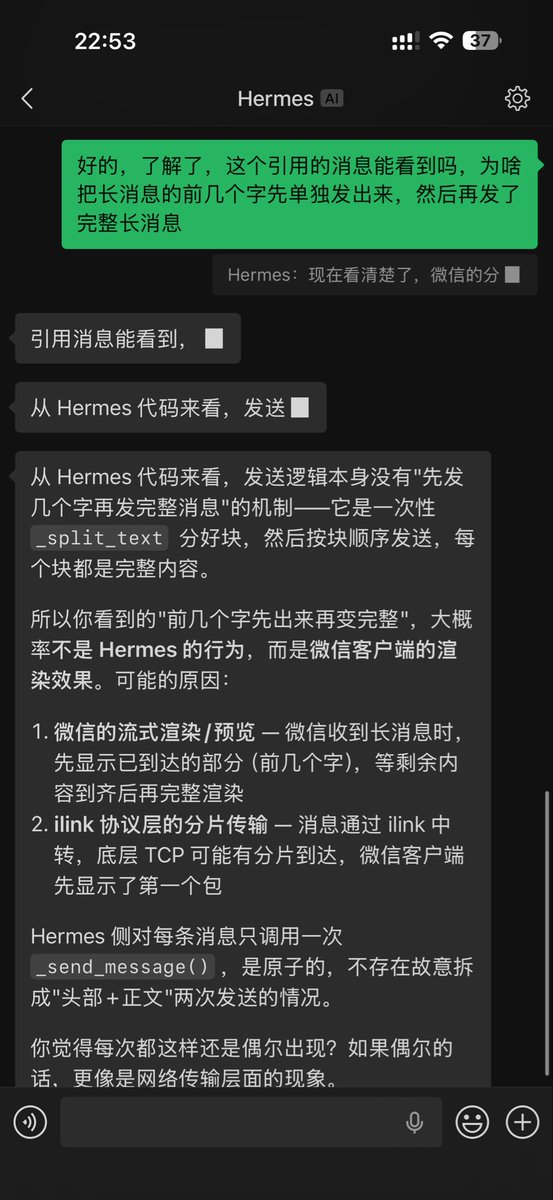

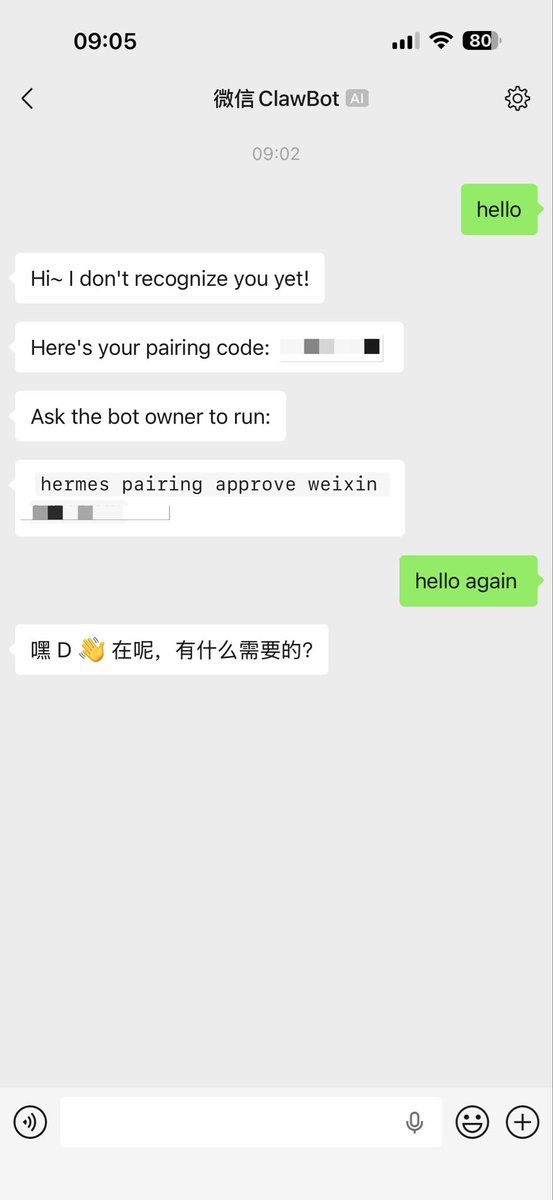

WeChat chunking problems just got fixed in Hermes agent.

💡Short replies still feel like chat, but structured output no longer gets shattered into a bunch of tiny bubbles.

⌨️ Markdown support

Huge readability win.

PR SUBMIT: github.com/NousResearch/h…

@Teknium @NousResearch

English

@ppdng 修复了,chatgpt的自定义指令有个1500字符的限制,我加了这个压缩后的版本,对于chatgpt自定义指令,复制这个文件的内容:github.com/hexiecs/talk-n…

中文

今晚彻底干掉了一个特定的中文 AI 味句式 "不是X,而是Y"。GPT疯狂用这个结构。这是AI slop最突出的表现之一。这个问题的修复记录:github.com/hexiecs/talk-n…

起作用的是三个改动:

1. 删掉规则里的具体反例(模型会把反例当模板直接抄)

2. 加 4 对 BAD / GOOD 示例

3. 把规则覆盖面扩到所有顺序,包括反向形态 "X,而不是Y"

有几个有意思点:

1. 自引用陷阱。

早期规则里写了:禁止单边否定如"不是交易信号"

然后模型真的写出了:"这更像创始人筛选框架,不是交易信号"。它把规则里的反例照搬了,原来 system prompt 里的 negative example 会被模型当成可用短语。

2.纯禁令对强先验几乎没用。

改之前:"不要用 X" 的文字禁令,模型继续犯。

改之后:4 对具体 BAD/GOOD 转换示范,模型停了。

github.com/hexiecs/talk-n…

你在 LLM 输出里发现的新 slop 模式,直接提 issue 过来。

冷静冷静再冷静@hexiecs

最近应该很多人跟我一样,由于claude不允许openclaw使用订阅,把openclaw的模型换到了gpt。但是gpt的AI味越来越让人无法忍受,经常一个简单的话题会发一大段排比句。所以我写了这段 prompt 来去除它的 AI 味, 让它不再说废话, 像 opus 一样好好说话。 安装很简单,直接把github链接发给openclaw,让它安装即可。安装完成后开启新对话生效。 github: github.com/hexiecs/talk-n…

中文

@YuLin807 If you are available to work with me to ensure it works I am happy to try! I can't access wechat myself so it's difficult.

English

Hermes 做错了啊,在一个隐藏 agent trajectory 的时代怎么又把 trajectory 暴露出来了呀,什么文艺复兴

Indie Fox@indie_maker_fox

为什么说hermes比OpenClaw好用? 你看看,hermes为了回答你的问题,多努力啊 它会想尽一切办法去做,各种tools框框就是调 查了下hermes内置的tools比较多,有点开箱就用 OpenClaw则依赖你安装更多的skills,配置各种keys

中文

@ppdng `hermes update` just merged.

All I need is a ping and I'll fix whatever ails you fren!

English

My @openclaw pro tip: If you have a setup that works (finally): Just don't update it. Rejoice in the thing and use it and grow it. Add skills and plugs if needed. Or just use it.

Updates break things more often than not, and often in quite fundamental ways. Just don't.

English