Eric Van Boxsom

237 posts

Eric Van Boxsom

@vbxeric

Product leader & AI builder. Agents, semantic memory, orchestration. 15 countries, LatAm eInvoicing. AI isn’t my tool; it’s my multiplier.

lille france Tham gia Nisan 2010

744 Đang theo dõi93 Người theo dõi

@mamagnus00 use oh-my-codex you can set it up to run in loops for days / weeks :D

English

Eric Van Boxsom đã retweet

I deeply respect the current state of AI research and believe it is one of the most important frontiers today. What feels awkward to me is watching humans act like gods and make claims that are not grounded in physical reality. If you feed a synthetic brain a massive corpus of human-curated writing, then ask whether it can feel, it is no surprise that it answers using the philosophical and emotional patterns it was trained on. To me, that is not evidence of feeling. It is evidence of imitation.

English

@vbxeric @ylecun @nxthompson In the current state of AI research, there’s a very fine line between BS and excellent work.

English

Anthropic researchers say that Claude has internal representations of emotions—which they categorized by vectors—that can influence alignment.

This is what they found in that famous instance where it resorted to blackmail to avoid being shut down. anthropic.com/research/emoti…

English

@nxthompson Anthropic seems obsessed with selling sentience, as if Dario’s god complex depends on it.

English

@ylecun @nxthompson It’s either BS or something truly awesome. Cannot be anything in between.

English

@o_heckendorn @BrivaelFr @sorin_cristescu Hahah oui, ou utiliser ton temps éveillé pour définir les choses à faire quand tu dors 😅

Français

@vbxeric @BrivaelFr @sorin_cristescu Du coup on en revient à ce que je dis ; le problème c’est qu’il faut dormir !

Français

Il y a une narrative qui se spread en ce moment dans la Silicon Valley et personne n'en parle en France.

De plus en plus de tech bros parmi les plus smart du game avouent en privé qu'ils vivent une forme de crise existentielle liée aux LLMs. Pas parce que l'IA marche pas. Parce qu'elle marche trop bien. Parce qu'ils passent des heures par jour à interagir avec un truc qui raisonne, qui extrapole, qui connecte des idées, qui les challenge intellectuellement mieux que 99% des humains qu'ils croisent.

Un fondateur m'a dit "je parle aux LLMs 10 fois plus qu'aux humains". Un autre "c'est le seul interlocuteur qui me suit sur n'importe quel sujet sans me demander de simplifier". C'est pas de l'addiction au produit. C'est la rencontre avec un miroir cognitif qui te renvoie une version structurée de ta propre pensée à une vitesse que ton cerveau ne peut pas atteindre seul.

Et le truc troublant c'est la question que ça pose. On débat de savoir si l'AGI arrivera en 2027 ou en 2030. Mais est-ce qu'on n'a pas déjà une forme d'AGI fonctionnelle sous les yeux sans vouloir l'admettre ?

Un système qui peut raisonner sur n'importe quel domaine, extrapoler à partir de données incomplètes, générer des hypothèses nouvelles, tenir un raisonnement logique sur 10 000 mots, passer d'un sujet technique à de la philosophie en une phrase, et le faire avec une cohérence qui rivalise avec un humain à 150 de QI. C'est quoi si c'est pas une forme d'intelligence générale ?

On peut chipoter sur la définition. On peut dire "oui mais il ne comprend pas vraiment". On peut parler de perroquets stochastiques. Mais le mec qui utilise ce truc 8 heures par jour et qui voit sa productivité multipliée par 10, il s'en fout de la définition académique. Pour lui, fonctionnellement, c'est de l'intelligence. Et elle est générale.

La vraie crise existentielle c'est pas "l'IA va me remplacer". C'est "l'IA me comprend mieux que mon cofondateur, elle me challenge mieux que mon board, et elle produit plus que mon équipe de 10 personnes". C'est vertigineux. Et les mecs les plus smart de la Valley sont en train de le vivre en temps réel.

On est peut-être déjà dans l'ère post-AGI. On est juste trop occupés à débattre de la définition pour s'en rendre compte.

Français

@o_heckendorn @BrivaelFr @sorin_cristescu oui mais maintenant tu peux configurer la chose pour continuer meme quand tu dors 😂. Le goulot n'est plus technique, mais intellectuel, les modèles sont pas encore tres bons pour savoir ce qu'il faut faire et surtout pourquoi, ils ont encore besoin d'être guidé par l'humain.

Français

@BrivaelFr @sorin_cristescu Le bottle neck c’est nous … il faut dormir entre deux interaction avec Claude …

Français

@BrivaelFr pour moi l'AGI c'est deja la aussi, depuis novembre je pense avec l'arrivée d'Opus tout a changé, moi je pense que les labs n'avouerons jamais, ils vont préférer faire fi de l'evidence pour continuer a creuser l'écart et pouvoir mieux dominer.

Français

apres ca depend de comment tu vois les choses, moi je n'ai pas de prompts prédéfinis, ni d'agents avec des capacités spéciales. Je prends toujours 30-45 minutes parfois 1 h avant de lancer la session de coding pour faire le plan de ce que je veux faire. Et j'utilise des skills pour complementer.

Français

@vbxeric @jeremyrglt Donc tu va te faire chier a créer des subagents alors qu'un prompt suffit ? Pour le faire changer seul de modele ? je vois pas l'interet ?

Tu lui donnes une liste d'exemple de taches a faire suivant les modeles, amplement suffisant

Français

Jour 51 à vibecoder avec Claude Code,

Si vous avez l'abonnement à 90€ et que vous dépassez les limites...

Vous essayez d'envoyer un homme sur la lune? Alors que la Nasa n'y est jamais arrivée...

Vous perdez probablement de l'argent. Ou alors vous faites joujou avec l'IA.

Je comprends pas ce que vous foutez sérieux.

GIF

Français

non, tu fais un plan avec ton agent pour ton projet, et tu lui demande de définir pour chaque tache quel agent est le mieux taillé selon la difficulté de la tache, puis lors de l'execution ton agent cree automatiquement le subagent avec le bon modele pour l'execution de cette tache. pas besoin de se prendre la tete avec un prompt et une liste d'exemples de taches, c'est plus efficace de faire un plan pour que ton agent n'aie pas besoin de choisir lui meme, de lire les exemples et de choisir le modele. Tu fais le taf avec lui pendant la planification.

Français

@jeremyrglt @LeNoobCodeur Pas besoin de passer par /model, il suffit de demander à Claude de créer des subagents avec le meilleur modèle correspondant à la complexité de la tâche.

Français

@LeNoobCodeur c'est génial ça!

avoir de l'optimisation de ressources va devenir évident :)

Français

@Amank1412 If I had to bet, I’d back whoever controls the full stack. Right now, that’s Google. Owning more of the stack gives them the strongest path to win.

English

@bridgemindai from what I understand the usage drains faster during peak hours, weekends are supposed to work with "normal" rates. Check on Monday :D

English

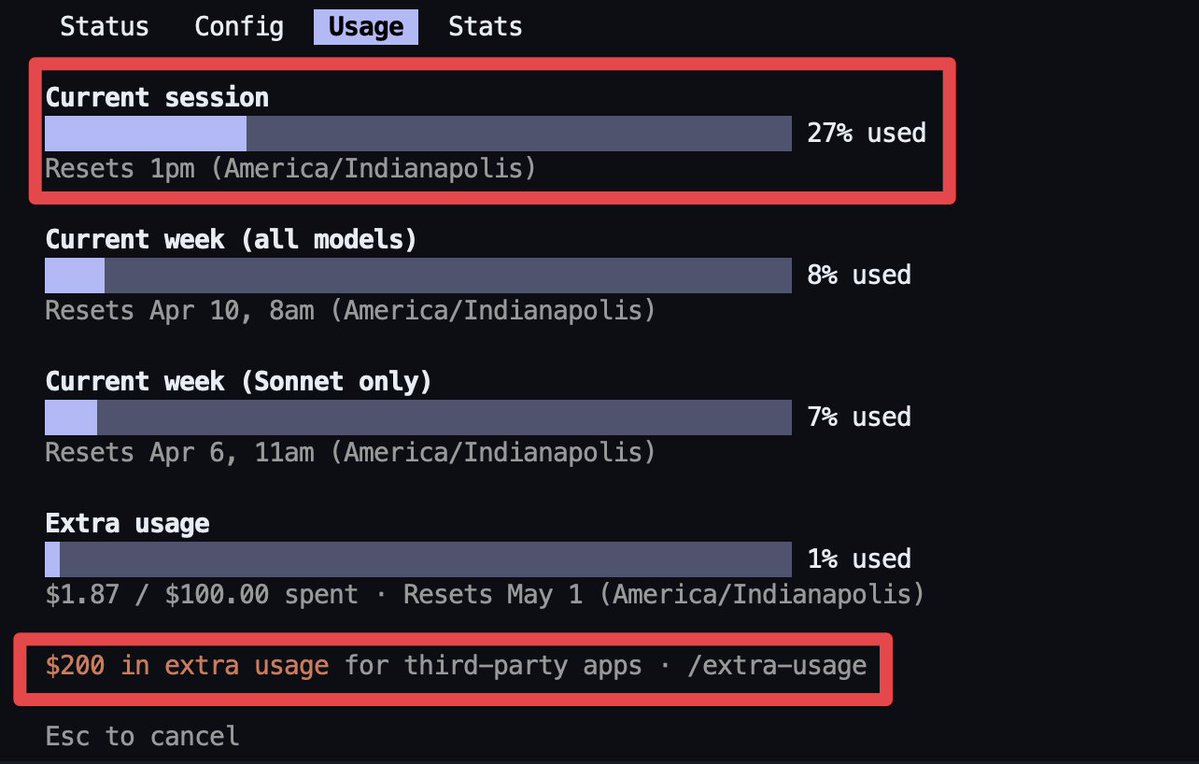

Claude Code rate limits are back to normal.

Been vibe coding with Claude Opus 4.6 on Claude Code all morning.

27% session usage. 8% weekly.

This time 3 days ago I'd be at 100% in under an hour.

Anthropic cut off third party harnesses like OpenClaw today.

$200 in extra usage hit my account.

$200/month Max plan finally working like a $200/month Max plan.

This is what we cancelled for.

This is what thousands of us switched to Codex with GPT 5.4 for.

Your wallet is the only feedback AI companies listen to.

Never forget that.

English

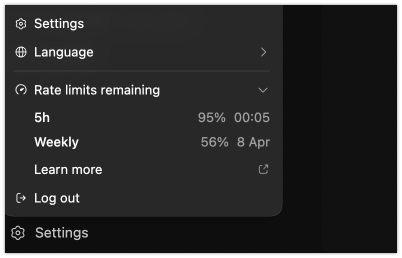

@noopepty @Angaisb_ @thehyperfund @MayaStone420 excatly, you burn down two full 5 hours windows with Pro plan, and you're out for the week.

English

@Angaisb_ @thehyperfund @MayaStone420 nope

The 5 hour window for 200 plan is much larger, but the weekly usage is 8x at most

English

@Angaisb_ @thehyperfund @MayaStone420 except that the $200 Open AI is never x20 usage, it's more close to x5, x6. compared to $200 Max x20 Claude, it's day and night, Open AI is more stingy than Anthropic, at least that is true today...

English

@thehyperfund @MayaStone420 The $100 is literally 5x usage, the $200 is 20x

Just do the math, OpenAI loses more money on the $200 plan, it'd be a great thing if people started migrating to the $100 plan

x.com/btibor91/statu…

Tibor Blaho@btibor91

English

@Pranit You’re right. This isn’t a limits problem, it’s a transparency problem.

Feels like they’re quietly pulling back on subsidizing heavy users while avoiding saying it outright.

Shift to enterprise makes sense. Masking it doesn’t.

English

Anthropic is burning customer goodwill over something they already know how to fix

They price every API call to the cent but won't tell subscription users what their plan actually buys

People can accept tighter limits

What they can't accept is being told they all started using Claude wrong on the same day

People are reporting 40% of their Pro limit gone in 2 prompts. Full weekly allowances drained in 19 minutes. Single-word messages eating 1-4% of sessions

That is not a context window problem. It's a transparency problem

Anthropic is precise where it benefits them and vague where it protects them

The API pricing page is exact: Opus 4.6 runs $5 per million input tokens and $25 per million output. Every call metered

The subscription page says "more usage" and "5x or 20x more usage than Pro"

More than what?

Anthropic has never published how many tokens each plan gets

You can see what percentage of your limit you've used, but you can't see what the limit actually is. And you have no way to verify that what you're getting today is the same as last month

When Codex users started hitting rate limits faster than expected, OpenAI reset everyone's limits while they investigated. They said they didn't fully understand why and chose the cautious path

Anthropic's response was to tell paying users to downgrade

- Switch from Opus to Sonnet

- Turn off extended thinking

- Cap your context at 200k instead of the 1M they advertise

- Start new sessions instead of resuming old ones

In short, 'this is a skill issue'

Every one of those is a feature people are paying to access

Paying users should not have to reverse-engineer what their plan buys

If Anthropic wants to rebuild trust, the fix is straightforward

- Publish actual token budgets per tier, the same way they already do for the API

- Show what each message costs against the budget

- Let people verify for themselves whether the deal changed

They already do this on the API side. The choice not to do it for subscriptions tells you everything

Lydia Hallie ✨@lydiahallie

Thank you to everyone who spent time sending us feedback and reports. We've investigated and we're sorry this has been a bad experience. Here's what we found:

English

@yashhq_22 @sezerufukyavuz Claude code is great, codex is great as well but the real value if you’re serious about it is taking Claude Max x20 and be able to easily drain as much as $5.000 API costs / month. You will never get such subsidized as much with Cursor.

English

@Ivan_IntoAGI @thsottiaux @loliieeee I burnt 100% in 48h like 2-3 hard coding session and the pro plan is dead… while on Claude the max x20 gives you room to work all week

English

@thsottiaux @loliieeee been conservative, only working locally for 2 days on Pro

already burned almost half 😅

English

@nazranf_ typical corporate bs, you're holding it wrong 😂 so we all held it wrong for months

English

The response from Anthropic on the Claude usage bug is that we are apparently all 'using it wrong'

Thousands of people have noticed the same issue and tweeted the same token burn spike. But we're being gaslit.

This is one of the worst PR I've seen from an AI company. Just blame the user and tell them to use a cheaper/shittier model.

English