Go Kamoda

223 posts

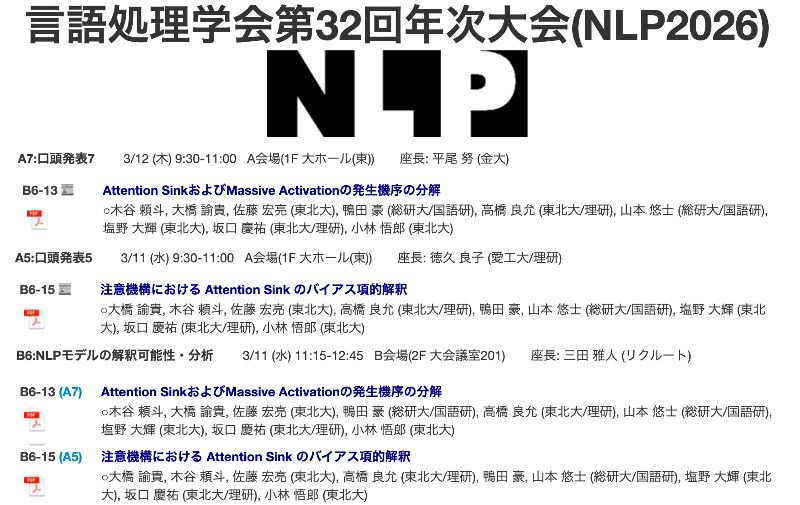

#NLP2026 にて,共著を含む計3件の発表を行います! 特に口頭発表は,選出率 4% (32/799) という貴重な機会をいただきました! - 3/11(水) 11:15〜:ポスター発表 - 3/11(水) 09:30〜:共著論文(口頭発表) - 3/12(木) 09:30〜:口頭発表 🎤 ぜひ足をお運びいただけると嬉しいです!

#NLP2026 にて,共著を含む計4件の発表があります! ぜひ会場にお越しください! ①Attention Sinkのバイアス項的解釈 - 3/11(水) 09:30〜:口頭🎤 - 3/11(水) 11:15〜:ポスター🖼 ②Attention Sinkの発生機序 - 3/11(水) 11:15〜:ポスター🖼 - 3/12(木) 09:30〜:口頭🎤

#NLP2026 では,希望のあったうち特に優れたものを選考し,2月13日(金)頃にシングルセッションの口頭発表に招待する予定です.口頭発表シングルセッションはポスター発表4セッションと並列して実施します.詳細なプログラムは3月2日(月)にこちらに掲載予定です. anlp.jp/proceedings/an…

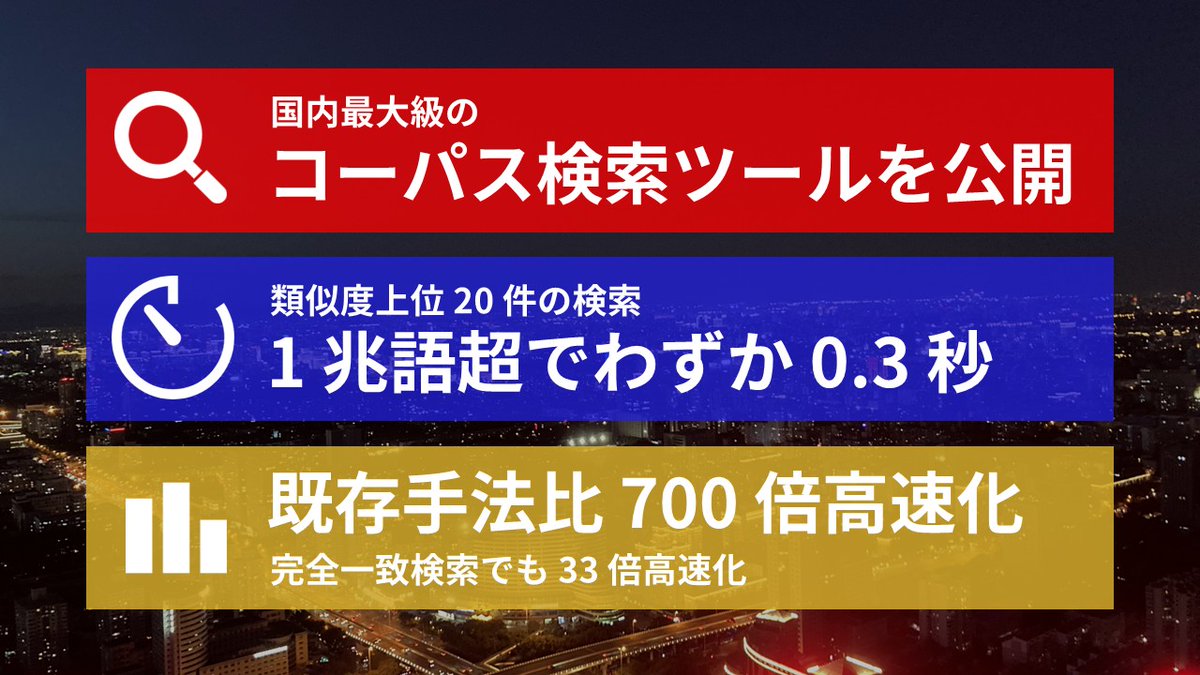

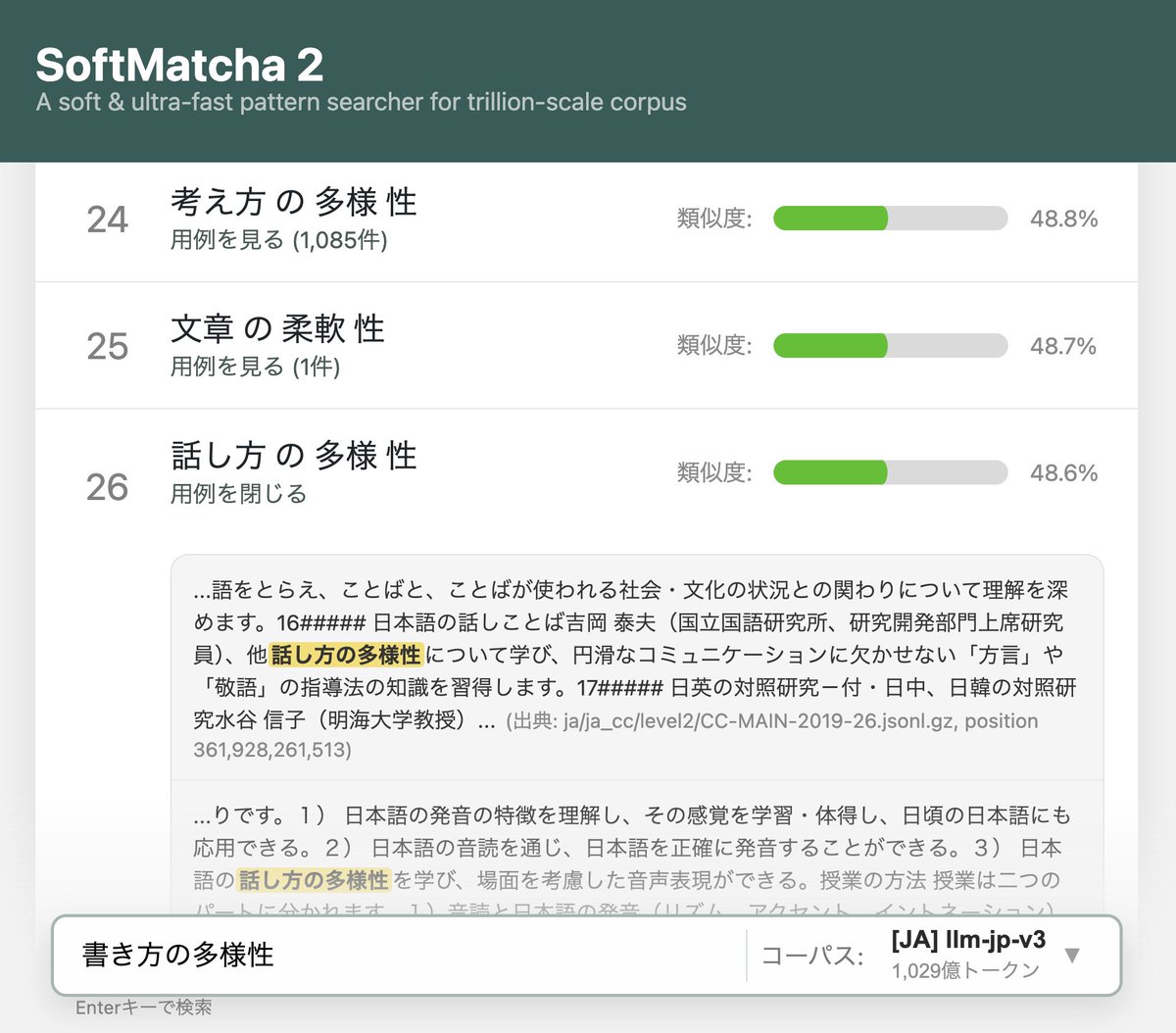

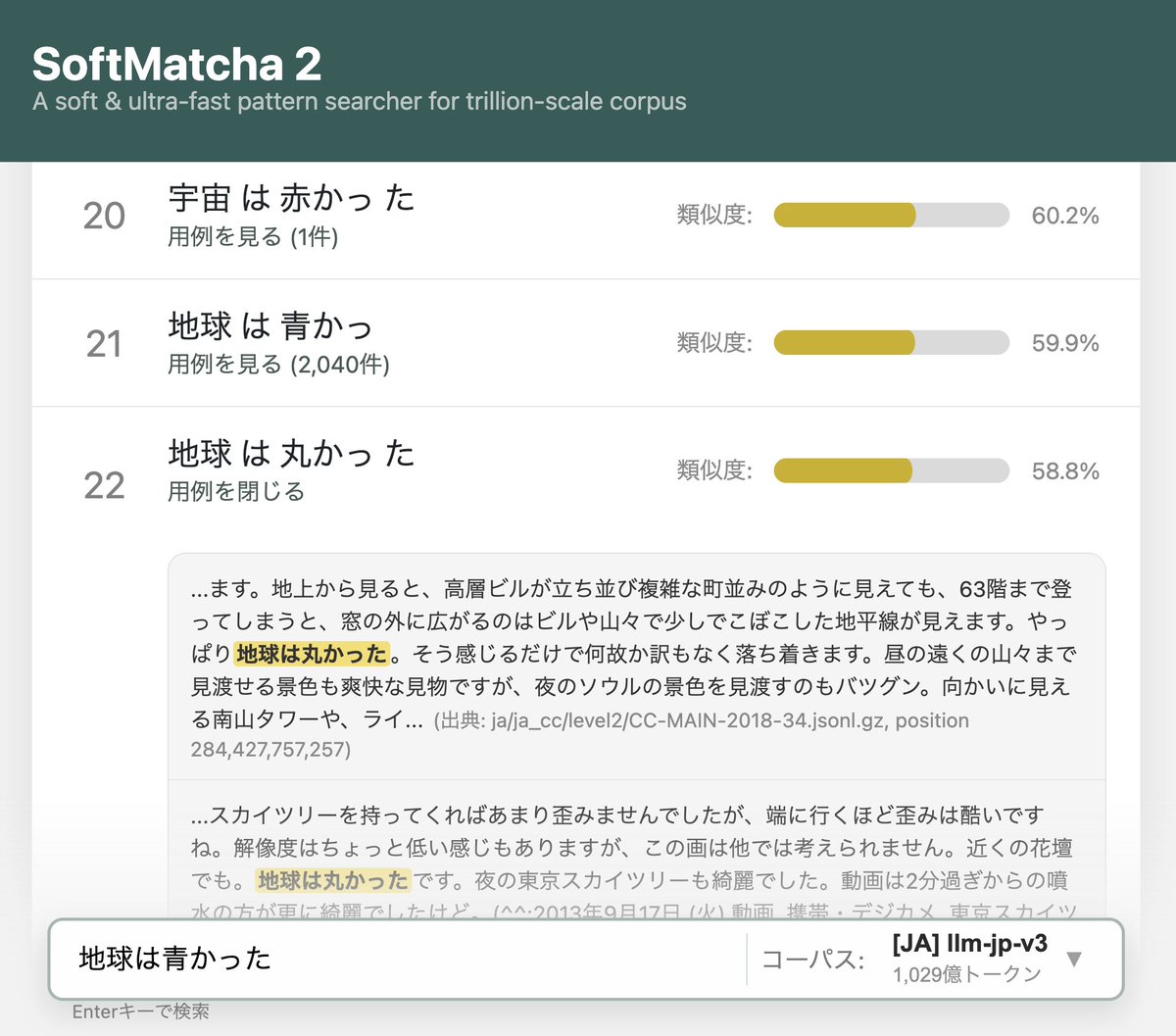

#NLP2026 では関わった3件の発表があります 宇都宮で会いましょう! ① SoftMatcha 2:柔らかいコーパス検索を1兆語規模へ拡張し、挿入・削除にも対応 (softmatcha.github.io/v2/) ② Attention Sink には位置よりも自身への注意集中が効いている可能性 ③ Attention sink からのValueベクトルは静的

1兆語規模のコーパスから0.1秒単位で用例検索できるツールができてしまいました。意味的な置換・挿入・削除にも対応。 世界の Takuya Akiba と ICPC 史上初世界2位に輝いた E869120 のガチプロ2名にジョインいただき、動くわけがないと思っていたサイズでなぜか動いてます。遊んでみてください。

byte tokenizerを採用したBERT (4モデル) と,同じくbyte tokenizerを採用した実験的なMulti-LM-head日本語言語モデルを公開しました. byte tokenizerを使った 変な言語モデルに興味がある方がいらっしゃればぜひ触ってみてください! huggingface.co/collections/to… huggingface.co/collections/to…