Francesco Contin 🇪🇺

16.5K posts

Francesco Contin 🇪🇺

@FrenchContin

Democratico e interista. Vivo con @bettypav, Annalena e Greta, la gatta.

🚨SHOCKING: Apple just proved that AI models cannot do math. Not advanced math. Grade school math. The kind a 10-year-old solves. And the way they proved it is devastating. Apple researchers took the most popular math benchmark in AI — GSM8K, a set of grade-school math problems — and made one change. They swapped the numbers. Same problem. Same logic. Same steps. Different numbers. Every model's performance dropped. Every single one. 25 state-of-the-art models tested. But that wasn't the real experiment. The real experiment broke everything. They added one sentence to a math problem. One sentence that is completely irrelevant to the answer. It has nothing to do with the math. A human would read it and ignore it instantly. Here's the actual example from the paper: "Oliver picks 44 kiwis on Friday. Then he picks 58 kiwis on Saturday. On Sunday, he picks double the number of kiwis he did on Friday, but five of them were a bit smaller than average. How many kiwis does Oliver have?" The correct answer is 190. The size of the kiwis has nothing to do with the count. A 10-year-old would ignore "five of them were a bit smaller" because it's obviously irrelevant. It doesn't change how many kiwis there are. But o1-mini, OpenAI's reasoning model, subtracted 5. It got 185. Llama did the same thing. Subtracted 5. Got 185. They didn't reason through the problem. They saw the number 5, saw a sentence that sounded like it mattered, and blindly turned it into a subtraction. The models do not understand what subtraction means. They see a pattern that looks like subtraction and apply it. That is all. Apple tested this across all models. They call the dataset "GSM-NoOp" — as in, the added clause is a no-operation. It does nothing. It changes nothing. The results are catastrophic. Phi-3-mini dropped over 65%. More than half of its "math ability" vanished from one irrelevant sentence. GPT-4o dropped from 94.9% to 63.1%. o1-mini dropped from 94.5% to 66.0%. o1-preview, OpenAI's most advanced reasoning model at the time, dropped from 92.7% to 77.4%. Even giving the models 8 examples of the exact same question beforehand, with the correct solution shown each time, barely helped. The models still fell for the irrelevant clause. This means it's not a prompting problem. It's not a context problem. It's structural. The Apple researchers also found that models convert words into math operations without understanding what those words mean. They see the word "discount" and multiply. They see a number near the word "smaller" and subtract. Regardless of whether it makes any sense. The paper's exact words: "current LLMs are not capable of genuine logical reasoning; instead, they attempt to replicate the reasoning steps observed in their training data." And: "LLMs likely perform a form of probabilistic pattern-matching and searching to find closest seen data during training without proper understanding of concepts." They also tested what happens when you increase the number of steps in a problem. Performance didn't just decrease. The rate of decrease accelerated. Adding two extra clauses to a problem dropped Gemma2-9b from 84.4% to 41.8%. Phi-3.5-mini from 87.6% to 44.8%. The more thinking required, the more the models collapse. A real reasoner would slow down and work through it. These models don't slow down. They pattern-match. And when the pattern becomes complex enough, they crash. This paper was published at ICLR 2025, one of the most prestigious AI conferences in the world. You are using AI to help you make financial decisions. To check legal documents. To solve problems at work. To help your children with homework. And Apple just proved that the AI is not thinking about any of it. It is pattern matching. And the moment something unexpected shows up in your question, it breaks. It does not tell you it broke. It just quietly gives you the wrong answer with full confidence.

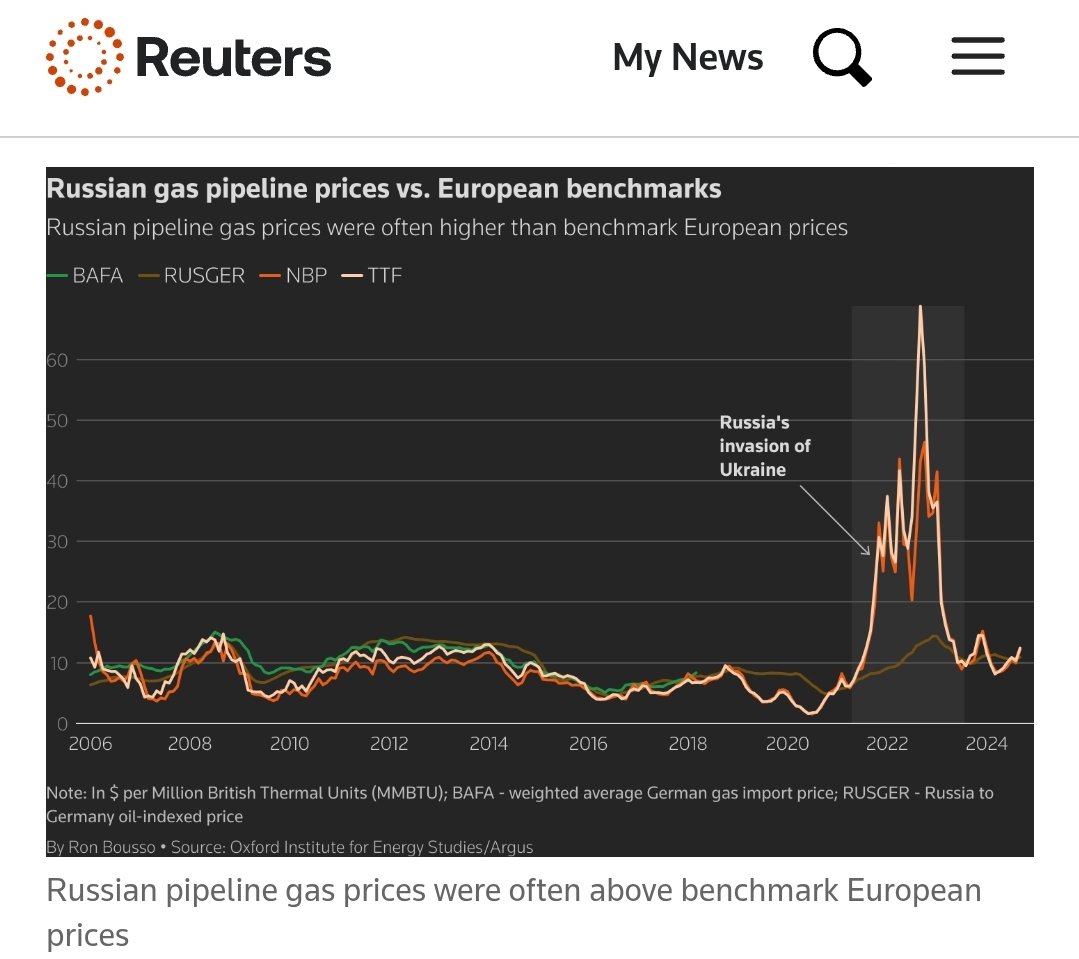

🛢️🔴 Penso che a molti ancora non sia chiaro, dunque lo ripeto: in potenza, quella di Hormuz è la crisi energetica più grave di sempre. Non ci sono paragoni che tengano. Nel 1973 la rimozione di circa il 7% dell’offerta mondiale di petrolio per 5 mesi fece esplodere i prezzi e contribuì a innescare la grande recessione globale del 1973-75, contribuendo ad aprire la stagione della stagflazione. In molti Paesi arrivarono anche misure drastiche di razionamento dell’energia: da qui le file ai distributori, le domeniche senza auto… La crisi di Hormuz sottrae al mondo il 17% del petrolio mondiale. Una quota che “scende” al 13% solo se l’Arabia Saudita riesce a deviare più flussi attraverso l’oleodotto East-West. Nel frattempo, sparisce anche il 20% del GNL mondiale. La portata di questa crisi, se durasse anche soltanto alcuni mesi, sarà inaudita.

To do list: 1) mandare a casa Bartolozzi, Delmastro, Urso, Santanche’ (minimo sindacale) 2) Fare un provvedimento veramente incisivo su energia mettendo a gara concessioni idroelettriche e levando rendite di posizione a Enel distribuzione e Terna. Varare finalmente decreto su Nucleare. 3) lasciare perdere leggi elettorali e riforme costituzionali 4) fare un piano automotive tosto 5) mandare dove devono andare Trump e Orban 6) assumere 12.000 carabinieri, chiudere centri in Albania e aprirli in tutte le regioni italiane 7) commissariare la Sicilia e sciogliere l’ars 8) investire seriamente sulla difesa a partire da difese antimissile 9) rilanciare NATO Europea 10) salario minimo e contrattazione decentrata. La stasi rancorosa non è un’opzione. Il dream team Schlein, Conte, Bonelli, Fratoianni, Landini, Gratteri, Renzi, Travaglio neppure. Liberal democratici di tutto il mondo…