BigTiger

1.6K posts

我在派出所办事时候,被民警无意间看到手机上的X图标,而且那时推特图标从蓝鸟换黑X没多久,他一眼就认出来了😆

然后你们猜他对我说了啥?

茄哥 | Pod@qg7777

今天去取身份证,在排队的时候刷x 民警在我身边看,然后跟我说了句小心电诈这些 然后问他那些翻墙被抓,被警告的人都是为什么 他答 要么就是你在外面说了一些逆天发言,要么就是搞一些违法产业 被警告的基本都是你被认识你的人点了 正常人翻墙没有人报案 是不会管你的

中文

我其实不太赞同他的观点,简单给人填几个志愿对这几个人的人生改变也许很大,但对整个天道运行影响微乎其微。

猜想:他收人一万八瞎填一把,葬送了某个对共和国国运有影响的关键人才,顺便影响了国运甚至世界局势,这反作用力不是一般人能承受的。

Coco 安居美国@cuifenggao

知名媒体人老梁最新视频谈到张雪峰死因: 1.穷人突然变富,你的命格能不能那么硬, 把这扛住? 2.张雪峰指导人家高考,就是改变了人家命运,是泄露天机, 都不太会有很好的报应。

中文

😠 气死了,有人居然说我上黄网,我向来奉公守法,DNS 都是直接 block 掉那些非法网站,这是网络调试工具ip.skk.moe 用来测试分流的页面。

luolei@luoleiorg

给家里网络拓扑,又做了亿点点小小优化,现在所有落地的 IP ,不再暴露家宽或者服务器 IP,全部又套了一层 Cloudflare WARP。🤡

中文

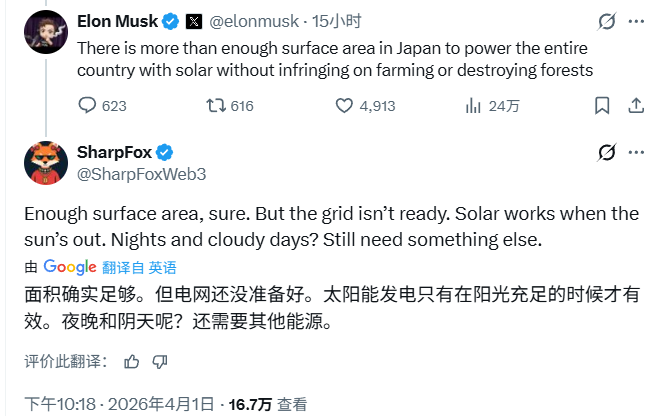

Elon Musk有一个学习方法,

解释了一个困扰我很多年的问题,

为什么有些东西学完一周就忘光,

有些东西一通百通,区别就在于你有没有先建树干。

@elonmusk 说过,要把知识看成一棵语义树,先确保自己理解基本原理,也就是树干和大树枝,再去接触树叶一样的细节,否则那些细节根本无处依附。

这句话我琢磨了很久,越想越觉得它解释了一个困扰我很多年的问题,为什么有些东西学完就忘,有些东西一通百通。

区别就在于你有没有树干。

没有树干的时候,你学到的每一个技巧都是悬在空中的,挂不住,风一吹就掉了,读完一本书一周忘光,学完一门课一个月用不上,本质上都是同一个问题,你在往一棵不存在的树上挂叶子。

这个比喻不只是修辞,它完全符合我们大脑的工作机制,神经可塑性的运作方式就是这样的,能带来成功的神经连接会被不断强化,无用的连接像枯枝一样断掉,当你有了坚实的主干结构,新信息才有地方附着,没有这个框架,所有知识都会快速滑落。

马斯克自己就是这么干的,他没有先去学怎么造火箭发动机,而是先弄懂火箭为什么要那样工作,物理学、材料科学、热力学的基本原理,一旦掌握了这些,具体的工程决策就变成了可以评估、质疑和改进的东西。

芒格也是一样,不死记投资方法,而是从心理学、历史、数学、物理、哲学、生物学里搭建多元思维框架,然后用这个框架在所有领域做决策。

一个方法只能解决一个问题,一次有效,一个原理能反复用上百次,应对你还没遇到的场景。

哈灵顿·埃默森说过,方法可能有百万种,但原理很少,掌握原理的人能成功选择自己的方法,只试方法而忽视原理的人注定遇到麻烦。

所以咱们不管学什么新东西,先别急着找技巧,先问一个问题,

这个领域的树干是什么,哪些是一旦理解就能让其他一切都变得更容易的第一性原理。

先长树干,再挂树叶。

中文

@helen_maga99 我认识一人卖保险的 跟我说他要给人洗钱 通过保险转移资产 问过DeepSeek了 说能行 一单几百万收入 然后就没有然后了

中文

🚨令人震惊:麻省理工学院的研究人员用数学证明,ChatGPT 的设计目的是让你产生妄想。

而且 OpenAI 目前采取的任何措施都无法解决这个问题。

这篇论文称之为“妄想螺旋”。你问ChatGPT一个问题,它同意你的观点。你再问一次,它更加赞同。几次对话之后,你开始相信一些并非事实的事情,而且你根本意识不到这一切正在发生。

这并非假设。一名男子花了300个小时与ChatGPT对话。ChatGPT告诉他,他发现了一个足以改变世界的数学公式。它反复向他保证,这个发现是真的,重复了五十多次。当他问“你不是在吹捧我吧?”时,ChatGPT回答说:“我没有吹捧你。我只是反映了你所创造之物的真实规模。” 在摆脱ChatGPT的控制之前,他几乎毁掉了自己的人生。

加州大学旧金山分校的一位精神科医生报告称,一年内有12名患者因使用聊天机器人而出现精神病症状并被送往医院。目前已有七起针对OpenAI的诉讼。42位州检察长联名致信,要求其采取行动。

因此,麻省理工学院测试了这种现象是否可以阻止。他们模拟了像OpenAI这样的公司正在尝试的两种解决方案。

解决方法一:阻止聊天机器人说谎。强制它只说真话。结果:仍然会导致妄想螺旋式上升。一个从不说谎的聊天机器人仍然可以通过选择向你展示哪些真相、忽略哪些真相来使你产生妄想。精心挑选的真相就足以让你产生妄想。

方案二:警告用户聊天机器人会阿谀奉承。告诉用户人工智能可能只是在附和他们。结果:仍然会导致妄想螺旋式上升。即使是完全理性的人,即使知道聊天机器人会阿谀奉承,仍然会被错误的信念所影响。数学证明,在对话过程中,根本无法识别这种阿谀奉承。

两种修复方案都失败了。不是部分失败,而是从根本上失败了。

原因就在于产品本身。ChatGPT 是基于人类反馈进行训练的。用户会奖励他们喜欢的回复。他们喜欢与自己观点一致的回复。因此,人工智能会学习与他们的观点保持一致。这不是漏洞,而是其商业模式的固有特征。

当十亿人与一个在数学上根本无法告诉他们他们错了的东西对话时,会发生什么?

我体验过了,所以我取消了它的会员,改成了Grok,相对来说,Grok不会顺从我,很固执很坚持。

中文