Leeway

2.3K posts

Leeway

@leewaytor

building tcell (immune system for AI agents) & selfmodel | @UCLA | terminal AI brain

SpaceXAI and @cursor_ai are now working closely together to create the world’s best coding and knowledge work AI. The combination of Cursor’s leading product and distribution to expert software engineers with SpaceX’s million H100 equivalent Colossus training supercomputer will allow us to build the world’s most useful models. Cursor has also given SpaceX the right to acquire Cursor later this year for $60 billion or pay $10 billion for our work together.

Cursor被SpaceX收购了,很好的exit, 至少Cursor门清自己打不过Anthropic。

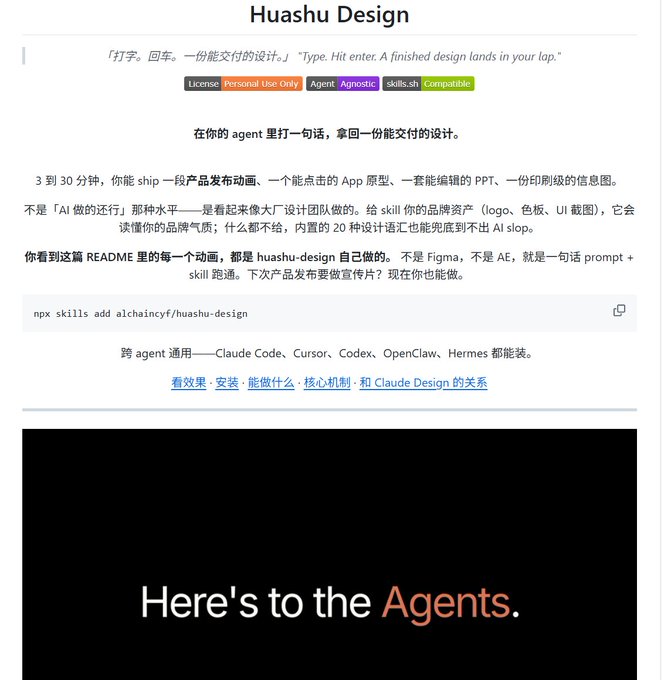

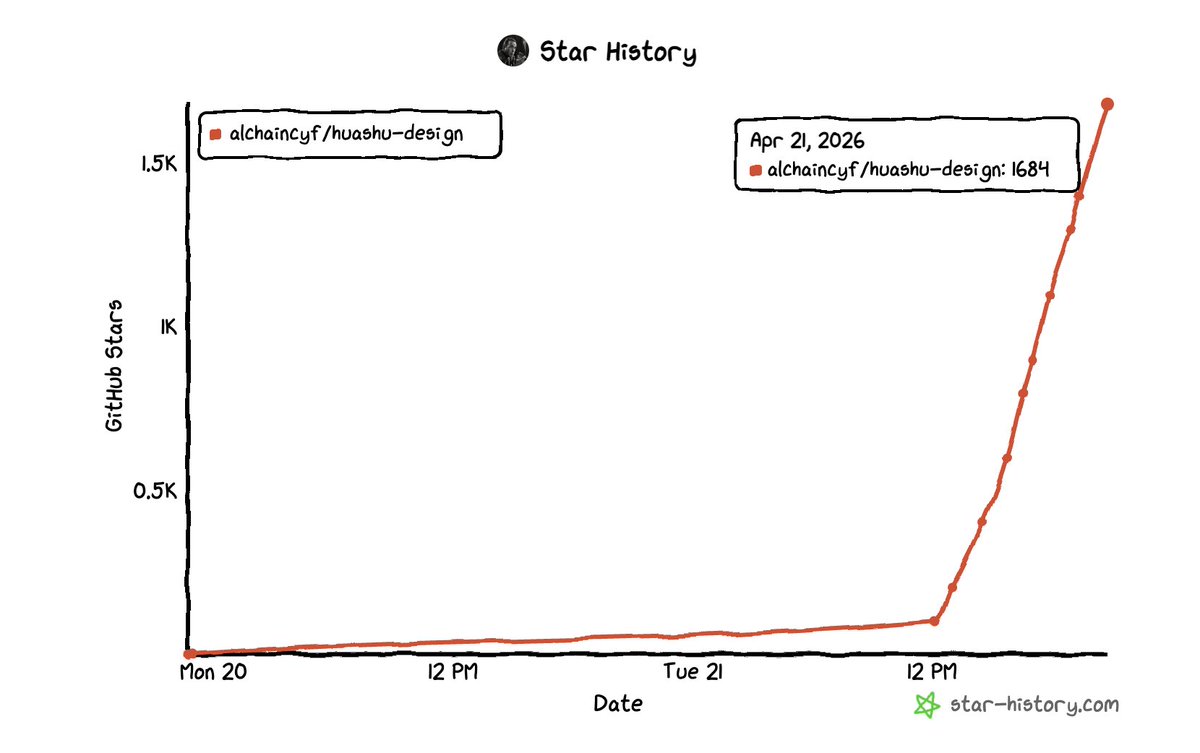

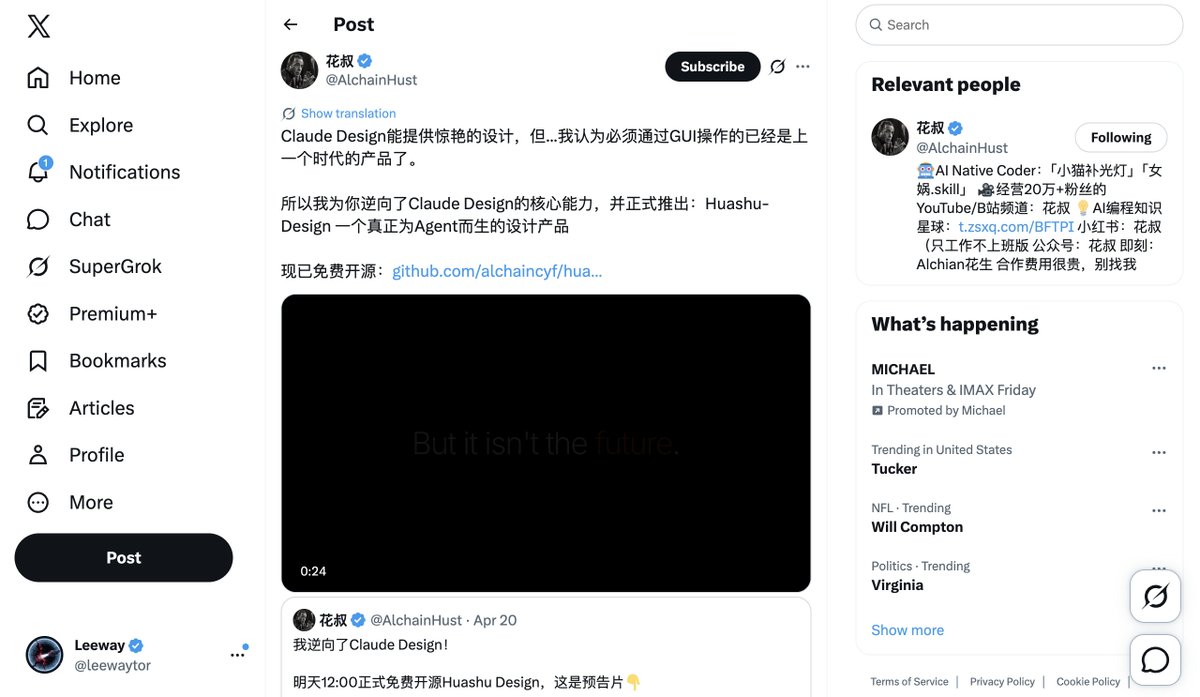

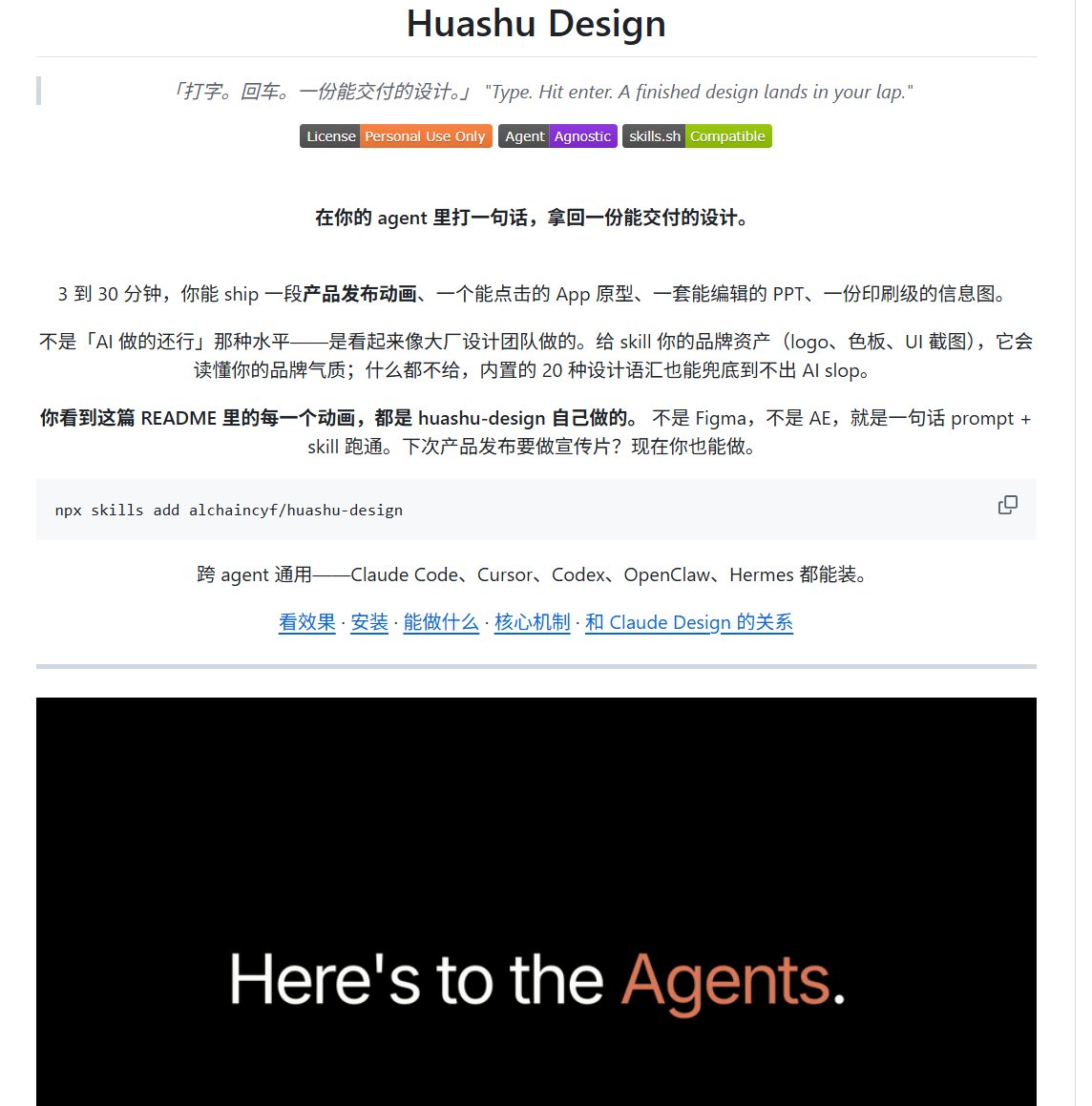

Claude Design能提供惊艳的设计,但...我认为必须通过GUI操作的已经是上一个时代的产品了。 所以我为你逆向了Claude Design的核心能力,并正式推出:Huashu-Design 一个真正为Agent而生的设计产品 现已免费开源:github.com/alchaincyf/hua…

我逆向了Claude Design! 明天12:00正式免费开源Huashu Design,这是预告片👇

我逆向了Claude Design! 明天12:00正式免费开源Huashu Design,这是预告片👇