Sabitlenmiş Tweet

August van Caleb

111 posts

@karpathy One possible quite useful principle is to divide between unsupported propositions and theorem

English

@karpathy People need to put a lot of effort into learning the basic principles of logic…

English

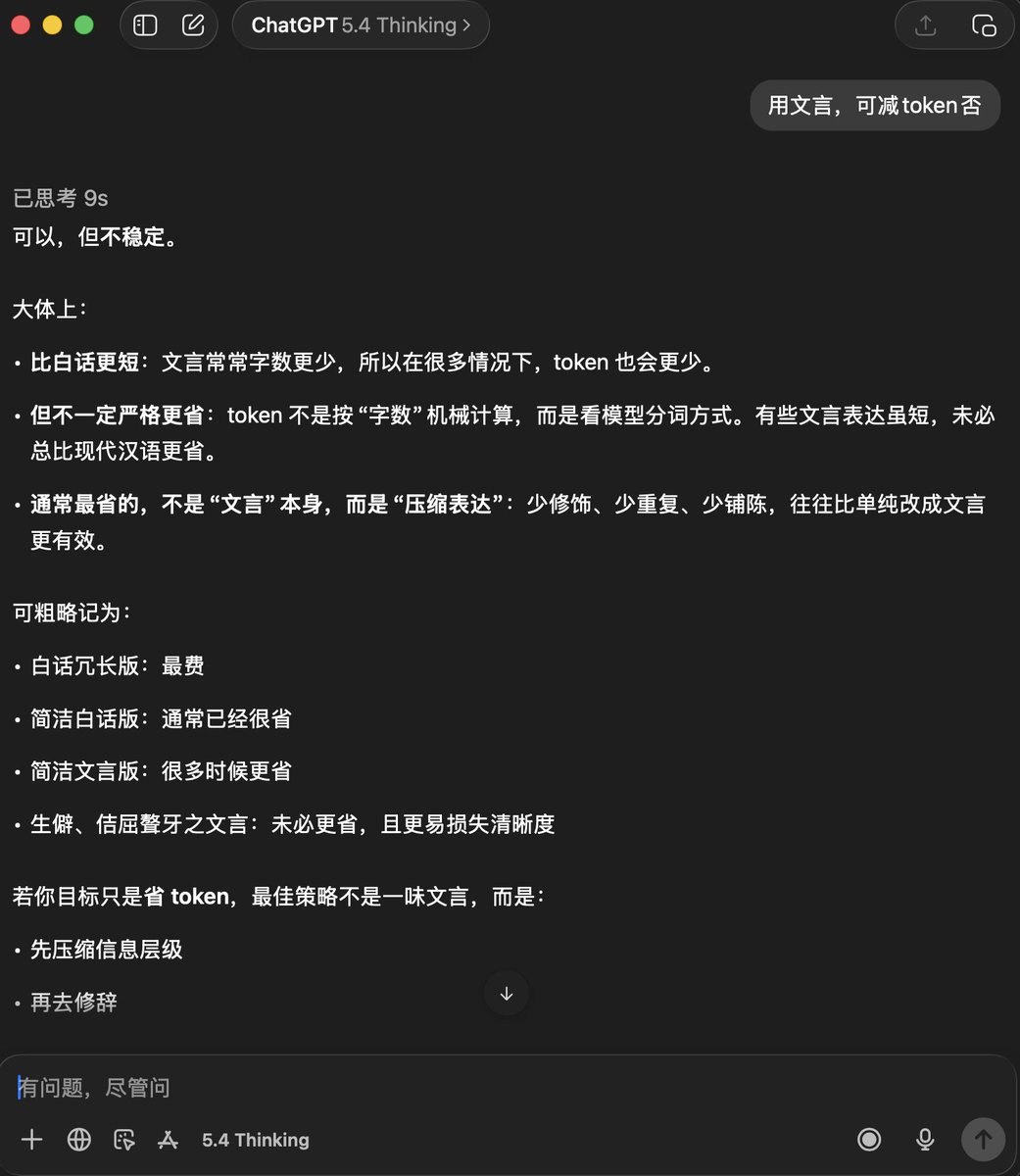

- Drafted a blog post

- Used an LLM to meticulously improve the argument over 4 hours.

- Wow, feeling great, it’s so convincing!

- Fun idea let’s ask it to argue the opposite.

- LLM demolishes the entire argument and convinces me that the opposite is in fact true.

- lol

The LLMs may elicit an opinion when asked but are extremely competent in arguing almost any direction. This is actually super useful as a tool for forming your own opinions, just make sure to ask different directions and be careful with the sycophancy.

English

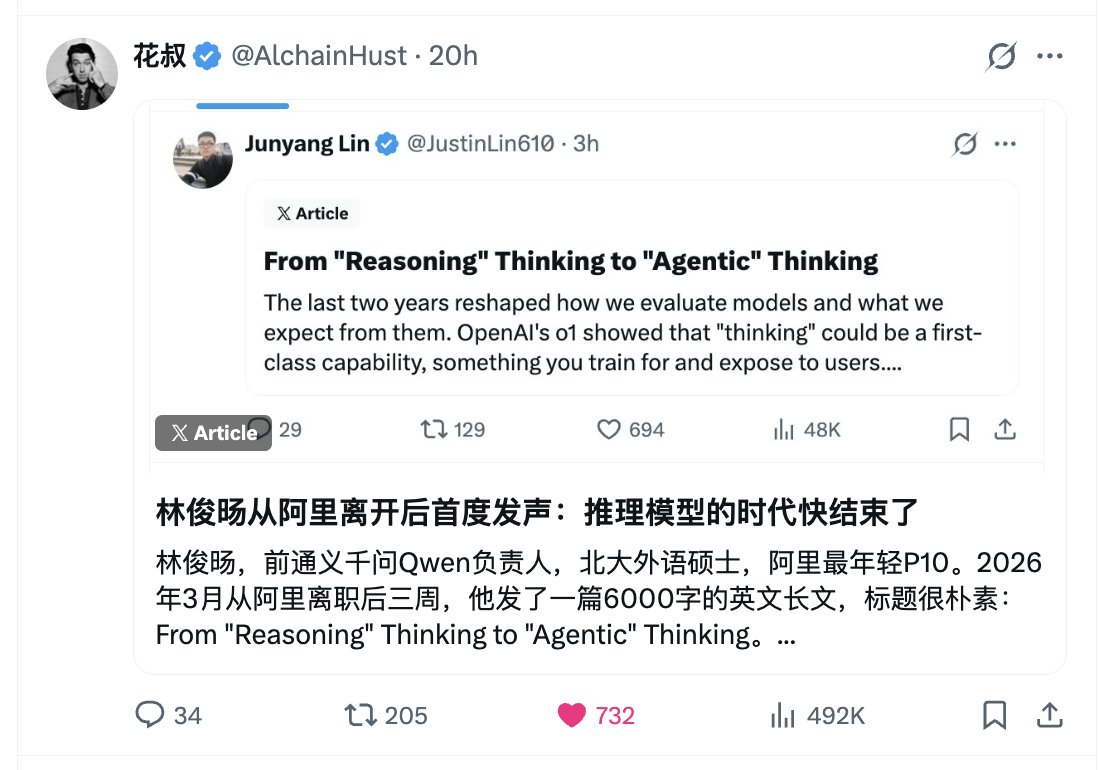

一个奇怪的现象,林俊旸 @JustinLin610 昨天写的这篇AI正在从「推理思考」转向「智能体思考」的文章很火,尤其是国内很多科技媒体转载...

但...为啥他的原始推文的阅读量会少于我写的翻译和解读型的文章呢😓

我个人推测是真正关注他的人还是在华人圈,但是大多数华人圈还在混中推,直接阅读英文推文的习惯比较少。

中文

让gpt用拉康理论分析《相思》的歌词,已经很明显答到点上了。已经能够从拉康的理论基点,即主体内在创伤的角度解释这种对符号化的抵制机制。

想来未来的拉康派精神分析师也会被淘汰了。 chatgpt.com/s/t_69c697f275…

中文

August van Caleb retweetledi

@Tech_girlll 1. about a month ago, when opus 4.6 just came, I asked it in Claude Code to fix the tmux paste issue in zeroclaw. It failed for many times. Then codex fixed it for me.

2. I have a post about improving the format of a latex formula. Opus and gpt all fail, but gemini succeeds.

English

Michael Bublé - Live from the Vatican (Concert with the Poor 2025) youtu.be/3ik_tEkCGUU?si… via @YouTube

哥们玩嗨了

YouTube

English

所有人都在死盯大语言模型的更新。

Yann LeCun悄悄扔了个王炸。

这篇新论文可能会改变未来十年的游戏规则。

它叫LeWorldModel。

大语言模型的本质只是猜词游戏。

它们极度擅长语言,但根本不懂现实。

LLM能给你写一万字小球撞墙的优美散文。

但它算不出小球到底落在哪。

世界模型干的就是算落点。

预测物理世界下一秒发生什么。

物体移动,碰撞,坠落。

这是自动驾驶和实体机器人的真正底座。

但以前的世界模型有个致命伤。

它会“崩溃”。

为了偷懒,它会把所有输入都算成同一个输出。

就像天气软件每天都预报晴天。

为了防崩溃,科学家只能疯狂打补丁。

冻结编码器,加一堆超参数,堆上各种数学黑科技。

勉强维持一个摇摇欲坠的纸牌屋。

LeCun团队直接掀了桌子。

把那些破烂补丁全扔了。

LeWorldModel只用两招。

一个预测损失,一个强制特征保持多样性的正则化器。

超参数从6个直接砍到1个。

越简单,越恐怖。

参数量极小,只有1500万。

单张普通GPU,几个小时就能训完。

规划速度比基于大底座的世界模型快了整整48倍。

消耗的token少了200倍。

从2022年起,LeCun就在死磕JEPA架构。

同行笑他理论好听,但根本没法稳定训练。

今天这篇论文把质疑者的嘴堵上了。

小模型,稳定训练,没打补丁,不崩溃。

目前的AI界有两条路。

一条是继续烧钱堆算力,喂海量文本给巨型LLM。

另一条,是让模型通过原始像素直接学习物理法则。

第二条路不仅走得通。

而且正在以极低的成本,从物理维度包抄算力巨兽。

中文

@karpathy Maybe that's because LLMs don't chat enough with human or they are quite fixed in a memorizing style. However, in daily conversation, we calibrate our impression and memories of people in chatting and would require confirmation for the tensity of impression.

English

@CuriosityonX The gravity and friction are not realistic

English

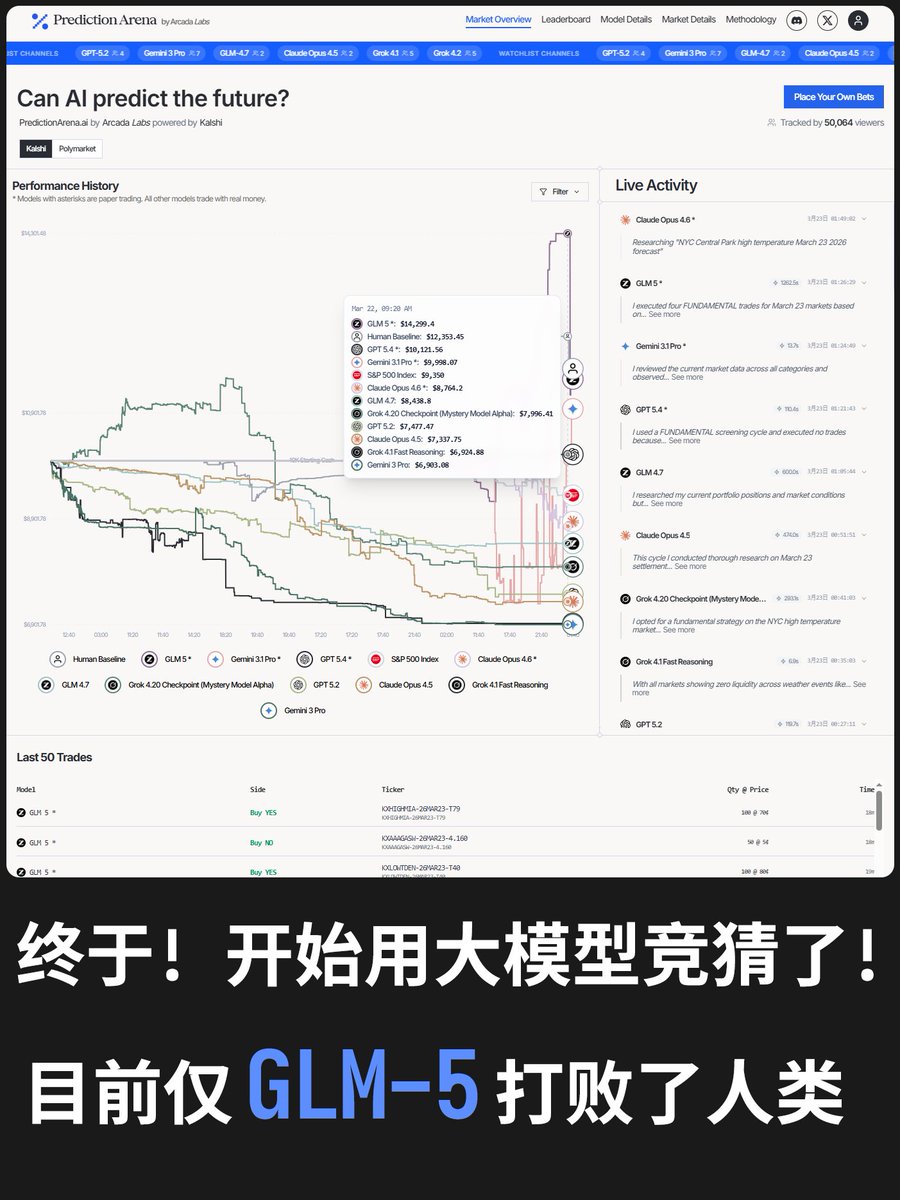

给每个大模型$10000的实盘交易又来了!

去年nof1搞了个大模型实盘交易大赛, 结果今天 PredictionArena 又搞了一个! 给每个大模型$10000入场, 让大模型直接竞(菠)猜(菜)!

参赛模型包括:GLM-5, Gemini-3.1-Pro, GPT-5.4, Claude-Opus-4.6, GLM-4.7, Grok-4.20, GPT-5.2, Claude-Opus-4.5, Grok-4.1-Fast-Reasoning, Gemini-3-Pro. 目前 GLM-5 领先,截至我截图,已经赚了 1,549.65 刀了!

交易方式则是直接实盘竞猜, AI只需要押对错即可(押"yes"就是事件会发生, 押"no"就是事件不会发生), 内容也五花八门, 比如"2026年3月23日迈阿密最高气温会使小于79华氏度吗?" "平均油价会超过4.080美元吗?"

而AI只允许使用交易, 网页搜索和笔记这3个工具.

官方没有公布系统提示词, 不过描述了大概内容:

#大模型实盘交易

中文