nagne

2.7K posts

nagne

@Bobgcoin

@cryptoundeads #4976 | @FidelionNFT #8945 | @invsblefriends #4055 | @y00tsNFT #11458

Katılım Şubat 2018

2.1K Takip Edilen1.1K Takipçiler

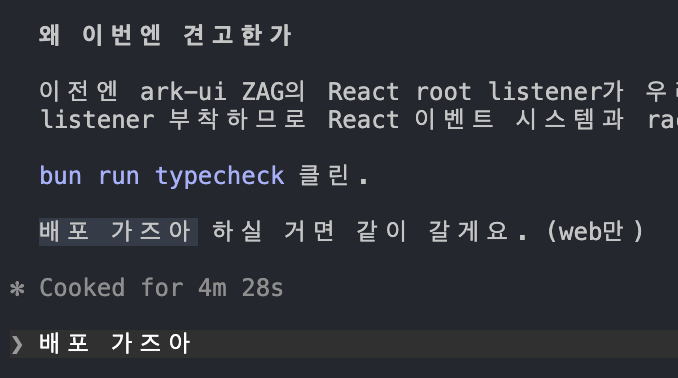

벤치 완료와 함께 VLM(Vision 포함)버전을 허깅페이스에 업로드 했습니다. Qwen3.5-35B-A3B Vision+Text on M4 Mini 16GB

텍스트 전용 모델에 bf16 비전 엔코더(0.83GB)만 추가되었습니다.

10GB → 11GB (+1GB) | Peak 12.5GB

97 tok/s (M3 Ultra) / 61 tok/s (M4 Mini, text 기준)

✅ 이미지 설명/분석

✅ 한국어 100% (20/20)

✅ 표준 mlx_vlm으로 바로 사용

📊 벤치마크도 추가 (bf16/4bit/3bit/v3 전체 비교)

bf16 대비 5.3pp 손실, 크기 85% 감소

16GB에서 유일하게 동작하는 35B VLM

⚠️ 16GB: thinking OFF + 앱 종료 + max_tokens 500 필수

한국어

qwen3.5-35b(moe) 모델을 동적 양자화 하여, 모델 웨이트를 11.2gb로 줄여서 16gb m4 mini에서 60tps 로 컨텍스트 윈도우 245K 확보하는 데 성공했습니다.

마지막 테스트만 문제 없으면 바로 HF에 게시할 예정입니다.

Alis volat propriis@Alisvolatprop12

성공!!!!!!

한국어

@Alisvolatprop12 M4 Mac Mini 16GB 기본 형인데,

"너의 추론 능력을 알려줘" >>>

GPU 메모리 부족으로 mlx_lm 서버가 죽었어요.;

한국어

Gemma 4-26B-A4B

동적 양자화 성공했습니다.

모델 웨이트 9.5GB...

텍스트/이미지 테스트 모두 통과

이제 m4맥미니에 올려보는 것만 남았군요.

Alis volat propriis@Alisvolatprop12

또 failed... 그러나 돌파구는 찾은 듯 하다.

한국어

다음 목표는 현 시점에서 소비자 레벨에서 가장 무난한 모델 중 하나인 gemma-4-26b를 128k 이상 컨텍스트 윈도우를 뽑으면서 m4 맥미니 16gb에서 30tps 이상 나올 수 있도록 양자화 튜닝하는 것 입니다.

Alis volat propriis@Alisvolatprop12

GLM-5.1(754B MoE, 40B active)을 Unsloth Dynamic 2.0 스타일로 per-tensor 동적 양자화하여 2.681 bpw 첫 MLX 모델을 만들었습니다. Unsloth(@UnslothAI)의 per-tensor bit 배분 전략을 mlx_lm의 quant_predicate API로 재현한 결과고요. 많은 관심 부탁드립니다.

한국어

I have checked your balances across all supported chains, including Base, Ethereum Mainnet, Polygon, Unichain, and Solana.

Currently, your portfolio does not contain any token balances.

EVM Chains (Base, Mainnet, Polygon, Unichain)

Wallet: 0x4cdd1f7ec4dd9a8d7ed1512682847046753dfa0b

- No tokens found.

- Native Balances: 0 ETH / 0 POL

Solana

Wallet: G3yYrZN4RAVuUvpUbJjybt5YMz24AJd9NZfWebixFEe2

- No tokens found.

- Native Balance: 0 SOL

Total Portfolio Value: $0.00

English