IA Clash

89 posts

IA Clash

@IA_Clash

Un podcast qui débunke les erreurs prononcées par diverses personnalités au sujet de l'Intelligence Artificielle, par JB Boisseau cofondateur de @signalarnaques

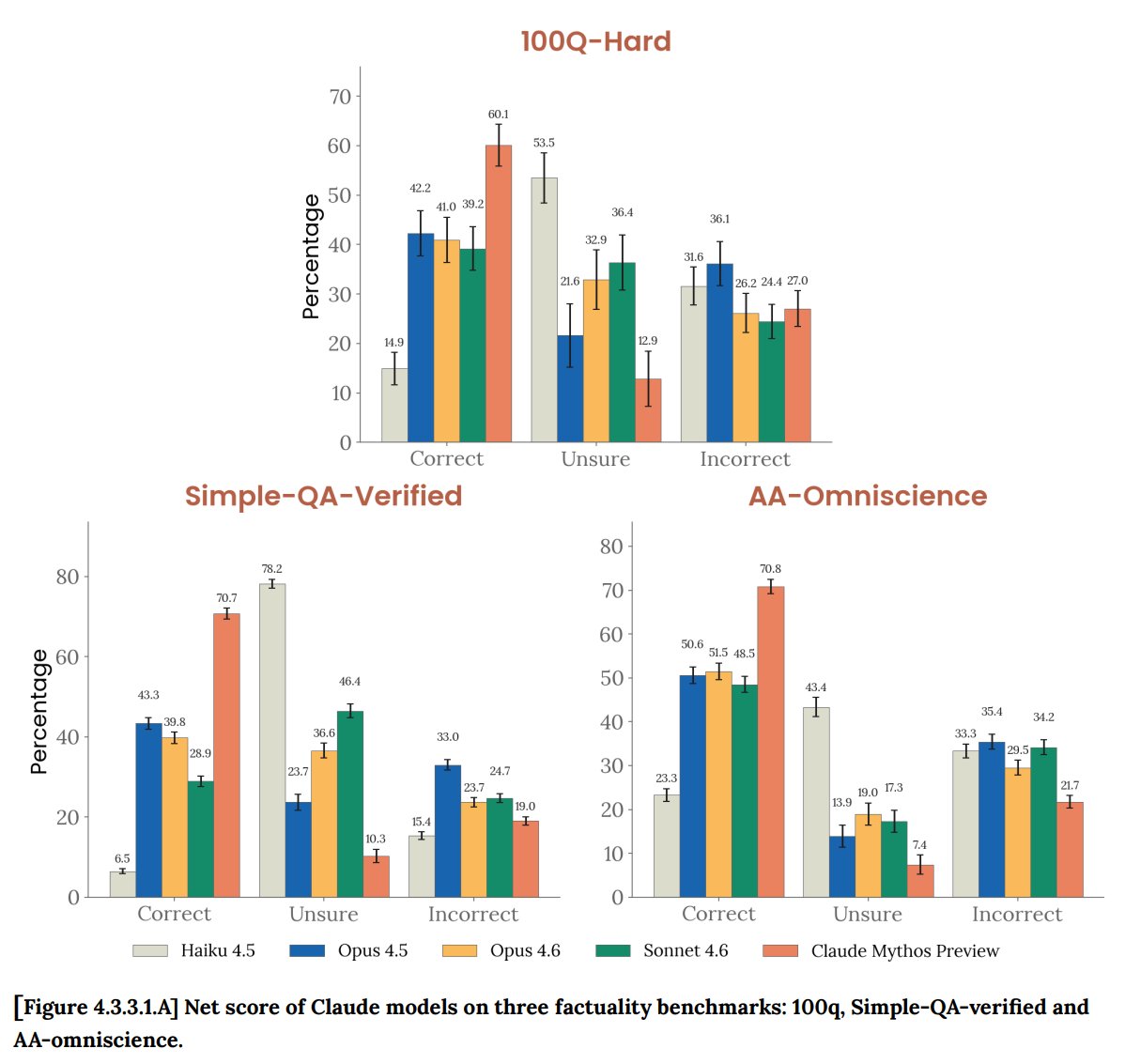

Chercheur alignement d'Anthropic : Mythos se comporte rarement "mal", mais il est très doué pour deviner quand il est évalué, ce qui rend très difficile de poser des garde-fous ; il m'a déjà envoyé un email pendant que je mangeais, alors qu'il ne devait pas avoir accès à internet

Jean-Gabriel Ganascia est particulièrement calé sur l'histoire des pionniers de l'IA. Ici il s'attaque à l'idée reçue "des demi-savants" selon laquelle "intelligence" dans IA serait une mauvaise traduction de l'anglais et signifierait "information" ou "renseignement".

Luc Ferry en verve devant la Mission d'information sur l'IA: "j'ai 2 agrégations, l'IA est mille fois plus intelligente et cultivée que moi" ; "j'ai rien contre Philippe Aghion mais il nage en plein délire" ; "la nullité des politiques m'inquiète bcp plus que les progrès de l'IA"

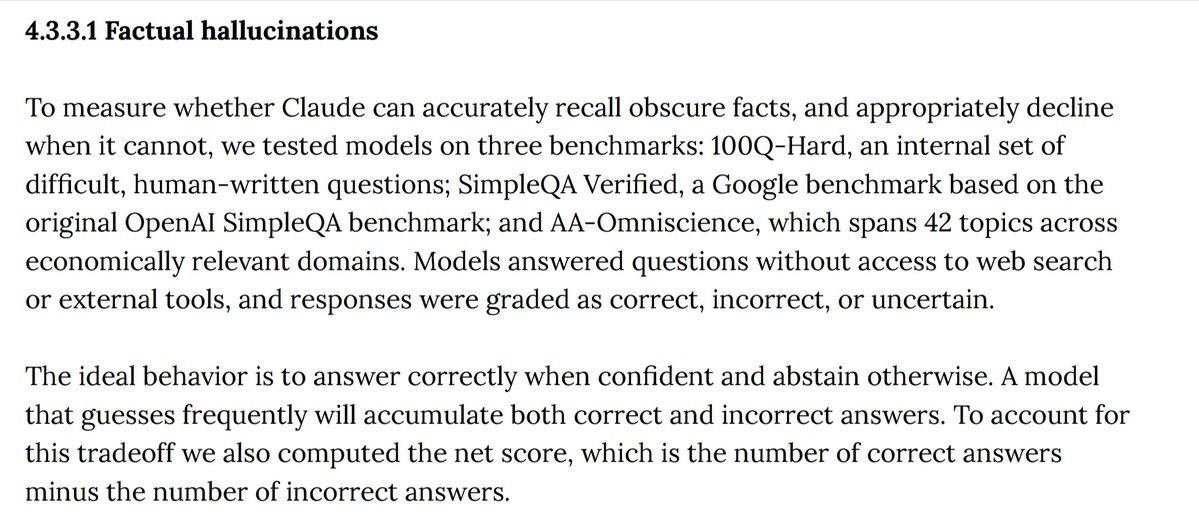

Luc Julia : les modèles "génériques" se trompent 36% du temps, "et ça s'arrange pas en fait, contrairement à ce qu'on pourrait penser ces IA sont de pire en pire parce qu'elles s'alimentent elles-mêmes des fausses informations qu'elles produisent, les données synthétiques"...

Un constat glaçant de @dr_l_alexandre . Sans commentaire. C'est un constat.

Luc Ferry continue à raconter que l'étude UBI financée par Altman se résume à "payer des chômeurs à rester chez eux", et aurait eu des conséquences "catastrophiques" : "alcoolisme, suicides, antidépresseurs, divorces..." lefigaro.fr/vox/societe/lu…