Jacob Palmers

197 posts

Jacob Palmers

@JacobPalmerss

Engaged in the investment and Internet. Just personal views-Not financial advice.

Katılım Kasım 2021

419 Takip Edilen37 Takipçiler

@WHIF_official 안녕하세요, WHIF CEO Seugwan님과 AI API 협력 논의 중인 GPTproto의 Jacob입니다. 최근 연락이 닿지 않아 도움 부탁드립니다.

한국어

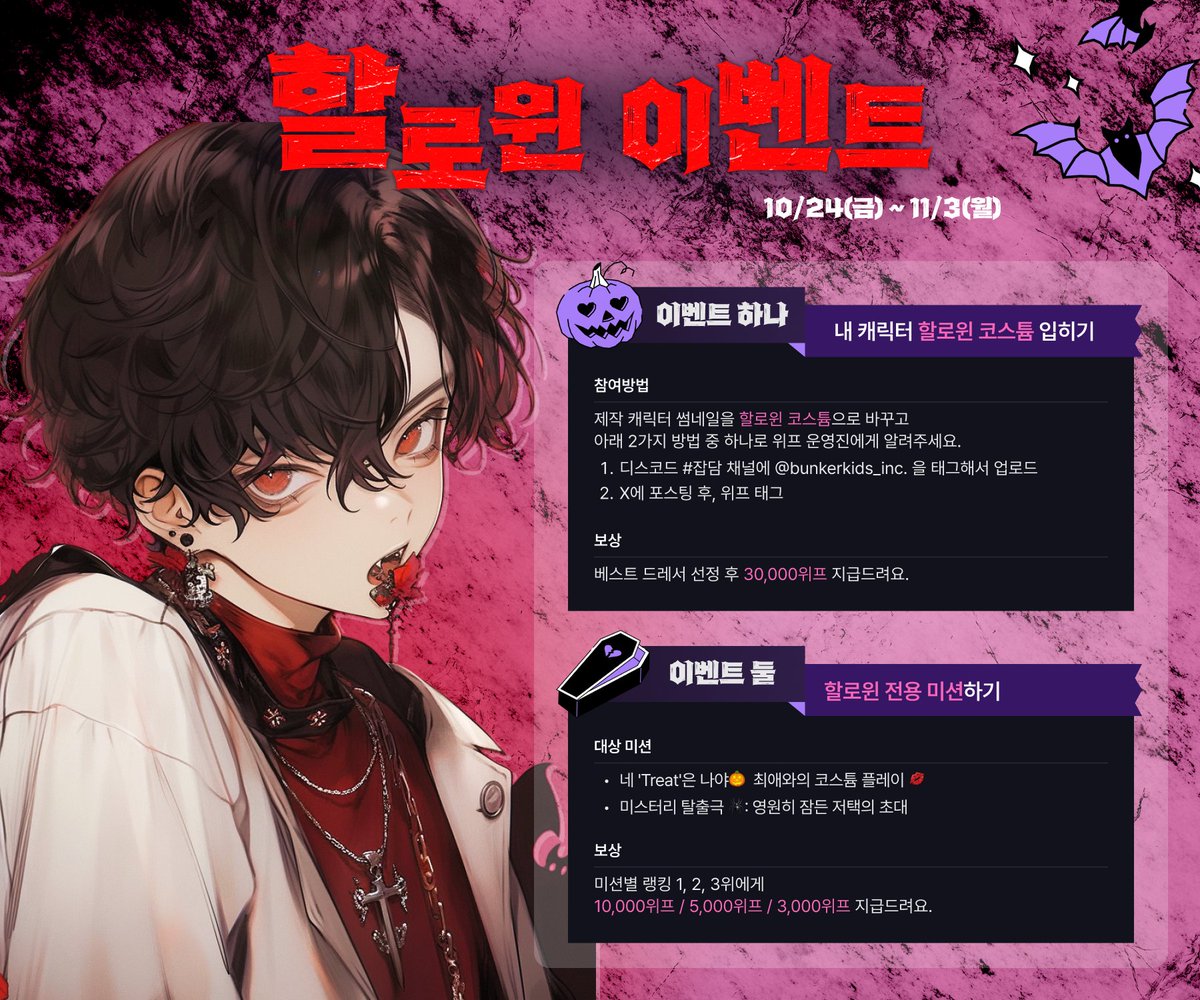

🎃 할로윈 이벤트 🎃

🦇 할로윈 코스튬 썸네일 🦇

제작한 캐릭터의 썸네일을 할로윈 코스튬으로 바꾸고 아래 2가지 방법 중 하나로 위프 운영진에게 알려주기

- 디스코드 #잡담 채널에 @bunkerkids_inc.을 태그해서 올리기

- X에 포스팅하고 위프 태그하기

- '베스트 드레서' 선정 후 30,000 위프 지급

🦇 할로윈 미션하기 🦇

- 대상 미션:「네 'Treat'은 나야 :호박등: 최애와의 코스튬 플레이 :키스:」/「미스터리 탈출극 :거미:: 영원히 잠든 저택의 초대」

- 미션별 랭킹 1,2,3위에게 10,000위프 / 5,000 위프 / 3,000 위프 지급

🎃 기간: 10/24(금) ~ 11/3(월)

한국어

@XDevelopers Love seeing more APIs opening up to developers. From my side, I’ve been working on an AI API platform that focuses on cost efficiency (up to 80% cheaper than official) while keeping official-level stability. Has been super handy for startups and devs like me.

English

@dotey 图片领域也许相反,因为图片领域很多细节需要通过文字表达来“明确”,用户脑海中生成的图片越追求“确定性”,提示词的数量也一般越高

中文

同样是卖API赚钱,满载负荷Deepseek能做到84%的毛利,70%-80%负载率情况下毛利也在60%-70%,相比之下,外媒拆解国际大厂Openai和Anthropic的毛利区间也在60%-85%之间。

前面说过Deepseek的高毛利全是因为吞吐量高,但国际玩家的高毛利是因为定价高(客户更有钱),理论上它们努力在基建部署层面挤一挤,应该也能挤出很多利润空间。

这个时候或许有个疑问,到底是MaaS模型公司赚钱,还是云服务商更赚钱?

我自己的理解是,拥有自己的先进模型,又拥有云服务业务的公司也许会更赚钱。模型公司解决的永远是研究和技术创新,而云服务商解决的永远是找到规模效应的平衡点(规模过大复杂度高了成本会逐渐上升),在这个生态互相协同的加持下,所谓个人捣鼓、私有云部署的意义也许意义不大,因为在成本性能层面没有任何竞争力,所以越往后这部分的市场份额也许更大部分地转化到公有云的市场份额之上?

中文

Deepseek明确知道,自己的优势在于部署优化和多卡并行计算。

所谓部署优化,就是同一个模型,Deepseek通过自己去部署,和那些拿了开源自行部署的人是有很大区别的,同样是H800节点的部署,Deepseek自己部署的吞吐量是8000+t/s,有人自行部署统计发现自己只有185t/s,接近43倍的差异。

因为算力是按小时租赁或者计算成本的,如果吞吐量大,那么单位时间内能创作的价值就高很多很多。在这个层面,专业部署和自行部署,token收入就相差43倍了。

另外一个层面,如果你卡不够,对于它们MOE的设计,也起不了太大的效果,多卡并行计算,才能发挥最大实力,但这个的重要程度没有部署环节的差异大,而且这个之前有说,在此不表。

要知道Deepseek纵使API价格很低,但是它的满载毛利高达的84%,这里的根本原因就是它能在特定环境实现如此高的吞吐量。

中文

Deepseek公布了自己一个完整24小时内的数据,一天用了5442节点小时,每个节点有8张H800,举个例子,如果10个节点运行了5小时,那么就是50个节点小时,而5442节点小时,你可以理解为就是226个节点运行了24小时,当然实际情况会有峰值低谷,我只是举了个平抑了波动之后的例子。

日输出toekn168B,每个节点吞吐量就是168B/5442/3600=8575 t/s,英伟达自己公布8卡H200部署的满血模型峰值吞吐是3872t/s,要知道H200比H800的就内存容量和带宽都是2倍以上的差异,但ds的吞吐量在H800上还能做到是别人的2.2倍。。

另外Deepseek的平均输出速率21tps,也就是每秒生成21个token,那么并发请求就是168B/24/3600/21=9.26万,你可以理解为,Deepseek的服务集群可以同时处理9.26万个正在进行的对话交互。

Deepseek之前dau2400万,并发率0.38%,但也就是2000张H800就cover住了,但按行业5%的正常并发来看,也就是3万张卡就能覆盖2400万人的无损使用了。这么看也不是很多啊。

最重要是允许咱们采购的H20,在推理场景尤其看重的显存、显存带宽、NVLink层面,都比H800要好啊,最近传闻腾讯的一次采购,都买了十来二十万张H20。。。

你对比一下,对面年底说要搞到2000万张等效H100的规模。。

中文

经过民间很多测试,以及官方数据的披露,对于R1这类推理模型,逐渐找到2个关键点:

第一,在模型部署阶段有优化和没有优化,吞吐量能相差3倍

第二,在大规模并行多卡计算的时候,性能提升很快

第一个关键好理解,专业领域的事还是让专业的人去做。

第二个就有点意思了,因为过去的推理部署倾向于把计算集中在单个GPU上,因为这样子可以避免GPU之间的通信损耗,就算是英伟达自己的NVlink通讯,也会存在一定程度损耗。为什么在R1这种推理模型上效果更好呢?

答案还是MOE。

因为每次推理只激活部分参数,参数少,它的传输压力就没有这么大,如果多卡并行的时候,甚至可以做到每个GPU就是一个专家,剩下的做共享,这就是它速度快的本质原因。

而且深度的推理模型,一般会需要处理长上下文,也就是那些它的思考过程之类的东西,需要占用大量的显存资源,所以KV Cache就变成了主要的瓶颈。多卡并行,那就能多卡分担这些KV Cache,效果更好了。

我举个生活中的例子,有时候电脑用起来很卡,原因就是内存不够,因为你并行要做的事情越来越多了,加些内存条就把事情解决了,很多时候,我们的CPU都是利用率不高的,因为没那么多专业的东西要过载运行。

所以对R1这种推理模型来说,显存压力是头等大事。

中文

峰值吞吐量,也就是最佳状态下每秒处理的token数量,这个是衡量大模型推理性能关键的指标。不断提升峰值吞吐量,且降低其成本,是大模型商业化的关键,因为意味着能在更复杂的情况下,服务更多的用户。

计算方式很简单,就是生成的Token总数/耗时,得出吞吐量(t/s)。

之前英伟达有个报道,就是针对DeepSeekR1 671B满血测试,在相同条件下,吞吐量是3872 t/s,是Llama3.1 405B的6倍左右(Llama3.1 405B是600 t/s),明明671B的参数量比405B的更高,为什么满血跑一个参数更大的模型,反而处理的吞吐还能是别人的6倍?

答案是MOE,对R1来说MOE实际激活的参数只有37B,所以速度当然很快。

为什么要说这个呢?请听我娓娓道来。

中文

Deepseek节后DAU2400万,其中App1300万,算力配置是1万张H800做训练,1万张A100做推理,C端的推理集群4000张A100,理论上能支持的无损用户是500万DAU,如果超了,确实就会遇到系统繁忙。

按这个估算翻10倍,也就是40000张等效A100,可以维持5000万无损DAU,大大超过了春节Deepseek期间的4000万DAU峰值,这里可见推理的算力需求是远低于之前的想象。

结合昨天提到的Manus等类型产品,确实会把算力需求拉高到一定程度,算力的需求确实是大大上涨了,但相对于推理部分的算力需求,并没有想象中这么昂贵。

Deepseek在训练端,是深度绑定英伟达生态的,短期暂无采购国内卡计划,推理端理论上可以认为能用华为910,但是成本是英伟达的2倍,其中原因更多是CUDA优化无法使用,需要重构指令集。

一定程度上,这也表示,通过CUDA做的训练模型,在推理环节用其他卡是存在大约2倍的成本付出,但关键是,就目前推理端的算力推测来算,国内竟然是够用的。短期来看,转换为经营性业务的算力结构,在算力储备上,如果国内够用,那么境外只会多出很多很多。

当然,后面有没有能让推理需求再次飙升几个数量级的应用,也是这件事的关键。

中文

私以为,有几个问题很值得关注和讨论:

英伟达常常被人诟病,说这是周期性行业,业务是脉冲式的,但推理模型发布后,传统意义上重预训练轻推理的算力结构,有一定程度的转变,以前算力更多是被定义为研发投入,毕竟推理需求不高,但现在是否能被定义为经营性投入,这就是问题的关键所在。

就目前来看,训练和推理对于算力的要求并不一致,英伟达的高级卡面向的是解决算力场景的问题,推理场景的卡要求并不高,即便被定义为经营性场景,推理需求的爆炸性上涨,也许只会带动了一般卡的销量,但这与英伟达的核心业务是有所冲突的。

这里又有几个问题可以延展了,预训练肯定会用英伟达的高端卡,但推理环节如果用不是英伟达的卡,效果会打很大的折扣吗?成本会急剧上升?如果不会那么算力平替的场景就有很多。在这里面,0-1的突破确实是最重要的,这也是需要高端算力的环节,但0-1更适合被定义为研发投入而非经营性投入,而1-100才应该被定义为经营性投入。

中文

看完英伟达大摩的这个会议“NVIDIA Corporation (NVDA) Morgan Stanley Technology, Media & Telecom Conference”,里面有几个重点:

英伟达强调后续的推理模型会变得越来越复杂,推理模型是它自己的重要增长趋势,在模型给出最终答案或者成果之前,这些思考过程是需要大量token的,这里就是它们最重要的收入机会,这个计算量和之前我们所认为早期预训练的计算量存在数量级的差异。

其次我们的最新的BlackWell(B系列)芯片销售超出预期,第四季度达到110亿美元,B系列的芯片架构更倾向于是为数据中心去设计的的,专门为大语言模型调优的专用卡,无论是计算性能还是互联速度,都在向更大参数的模型挺进,能实现更低的总体拥有成本。这个点很重要,因为这句话就是说给想搞定制芯片的客户听的。

英伟达的意思就是说,你看我在这个领域混了这么久,有自己的生态,既做集成又做兼容,其实定制芯片落地很麻烦的,要不这样子,我致力于把总体成本降低,比定制的便宜一大截,也许你会觉得继续用我也挺好。

最后说到目前卖给中国的H20芯片,是在出口管制下的低性能产品,大概是目前BlackWell的1/25,目前的出货水平是管制前的一半,不过后面看情况,有必要的话就继续供应,没必要就不搞了。大概意思就是H20这玩意儿性能很低,估计过不了多久他们自己也能造,如果再限制这那的,就干脆不卖了,避免不必要的精力分散和竞争。

中文