Lane

116 posts

Lane

@LaneAI98

写了8年代码,现在学习用AI 关注 Agent,Memory,Vibe Coding,SEO 思考、实践、踩坑,都记下来

建议对 Vibe Coding 或 AI 做产品感兴趣,看看 @turingou 最近的直播。很多人讲 AI 是为了流量(比如我),但郭宇不是:他早已财务自由,是 Github 中文区最顶级程序员之一,字节早期员工,见过世面,有很强架构思维。看他怎么 Vibe,其实是在看 AI 时代,能力、经验、资源都拉满的人,会怎么做产品。

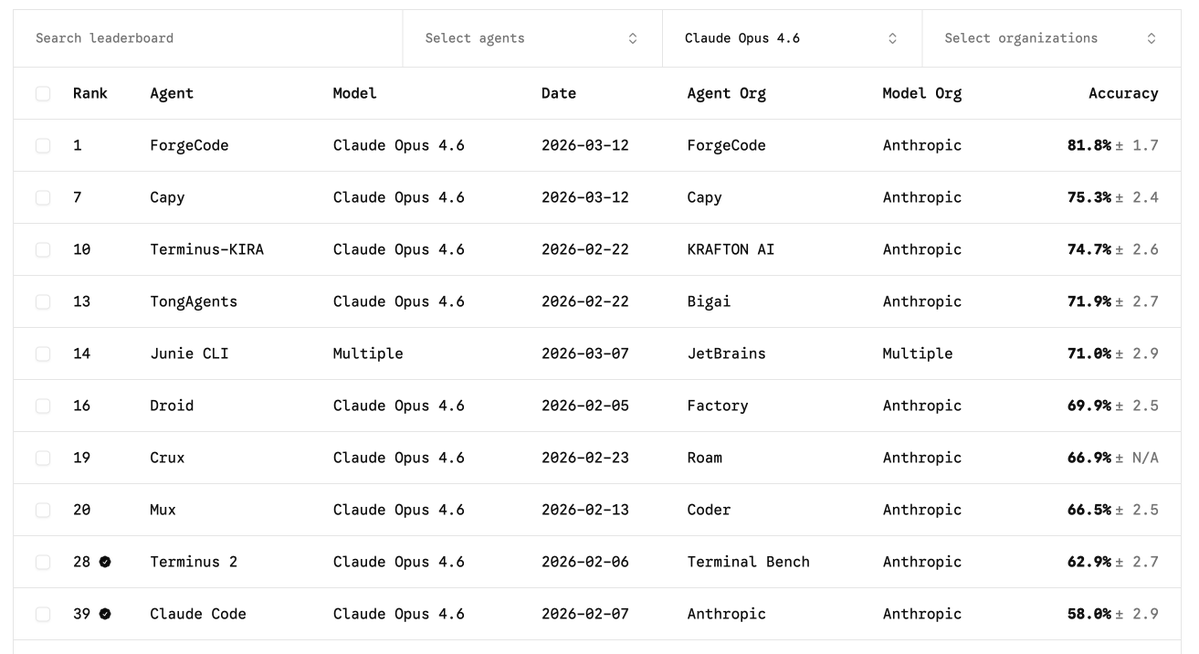

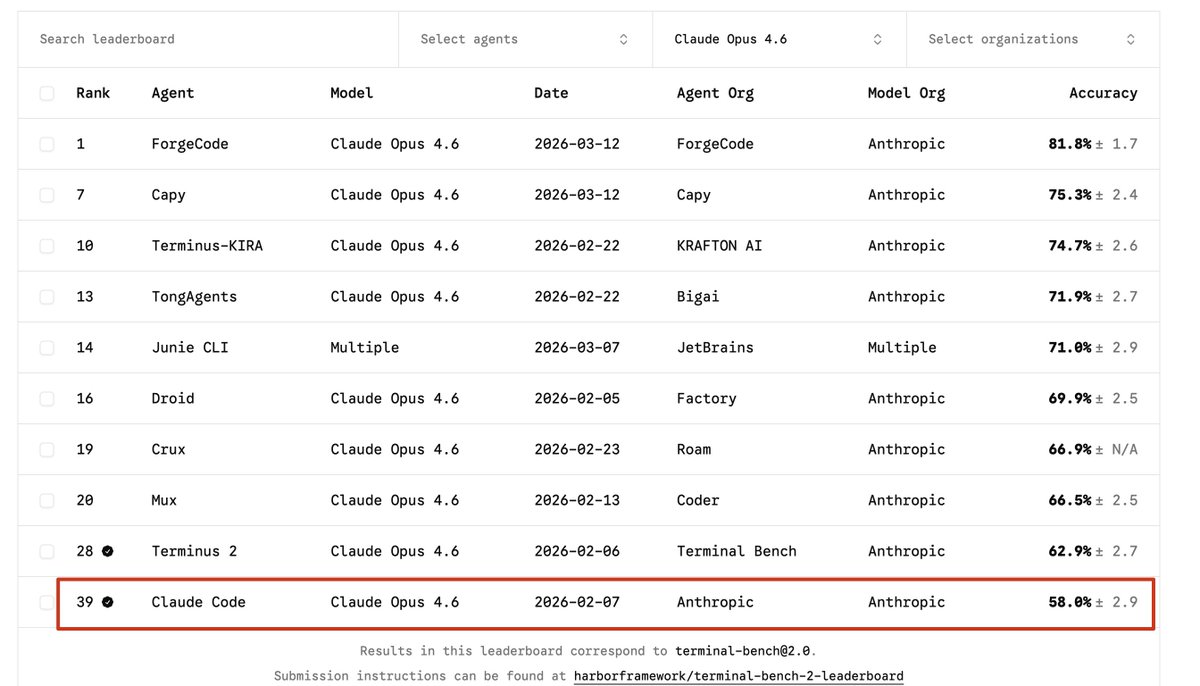

说个暴论,到今天还整天把 Claude Code 挂在嘴边,觉得它是最好的,呵呵,和新手只买小米和奔驰入门级差不多。

I’m excited to share a new repo: Agent Skills for Context Engineering Instead of just offering a library of black-box tools, it acts as a "Meta-Agent" knowledge base. It provides a standard set of skills, written in markdown and code, that you can feed to an agent so it understands how to manage its own cognitive resources. github.com/muratcankoylan… Most agent failures are not model failures; they are context failures. This is still an experimental project. The goal is to establish a platform-agnostic standard for context engineering that can be used in Cursor, Claude Code, Copilot or Codex. skills/ context-fundamentals: What context is, why it matters context-degradation: How context fails (lost-in-middle, poisoning) context-optimization: Compaction, masking, caching multi-agent-patterns: Orchestrator, swarm, hierarchical memory-systems: Vector RAG, knowledge graphs, Zep tool-design: Building tools agents can use evaluation: Testing and measuring agent systems I believe this is a good start, showing developers how to approach context engineering rather than relying on ready-made tools. You will also find the aggregated research documents I used to build these skills in the repo. The skills are synthesized from technical blogs on context and prompt engineering that I bookmarked, AI Labs' documentations, and Anthropic Skills examples. Try the 7 Skills, created using Antrhopic's Skills template format. Experiment with the provided scripts and references, and feel free to contribute to the repo.