.

693 posts

Sabitlenmiş Tweet

@himself65 缺少现象级 C 端产品,openclaw 算一个,但不够。如果 token 用量一直增加,目前的硬件就能继续炒作下去。因为消耗越快,需求就来了。

中文

我艹,这个牛逼啊,把qwen直接烧录进芯片,本地每秒处理10000个token.

“中型”LLM燃烧器即将推出!

🔥 这可能使本地 HyperToken 生成成为现实。

📷 NVIDIA 最担心的事发生了。

📷应用专用硬件 Taala 的新型 PCIe ASIC 板会将整个中型 Qwen 3.5-27B LLM 直接烧录到硅片中

📷 Taalos表示,到2026年春季,他们的实验室将提供基于ASIC的中型模型。 不再增加配重

📷本地每秒处理约 10,000 个令牌(Llama 3.1 8B 已经达到每秒 17,000 个令牌)

📷标准PC插槽,超低功耗(10x更少)

📷 100%离线,无云,无GPU集群

📷 Reddit 传闻单价 300 至 400 美元

📷思维速度堪比光速的人工智能体。

📷你准备好了吗?

David Hendrickson@TeksEdge

🎗️ "Medium-Sized" LLM Burners Coming Soon! 🔥 This Could Make Local HyperToken Generation a Reality. ⚡️ NVIDIA’s worst nightmare? 😱 ⚙️ Application-Specific Hardware Taalas new PCIe ASIC board would burn the entire medium-sized Qwen 3.5-27B LLM straight into silicon 🤯 (already doing it with small models) Taalos said medium models on ASIC would be available in their lab by Spring '26. 💭Imagine: 🚫 No more loading weights 🚀 ~10,000 Tokens Per Second locally (Llama 3.1 8B already @ 17,000 tps) 💻 Standard PC slot, ultra-low power (10x less) 🔋 🌍 100% offline with no cloud, no GPU farm 💰 Reddit unit cost rumor $300 to $400 🖥️ Imagine HyperToken generation on your desktop. 🤖 AI agents that think at light speed. ⚡️ Are you ready? 👀

中文

@Salmonbro 所谓危机从上游传导下游,周期长达很多年。并不是几天就释放完的。高潮是大范围的产业链的崩溃,原料,工厂,公司倒闭,到处都是坏债。现在算啥危机,都在下棋,热战也是局部热战。

中文

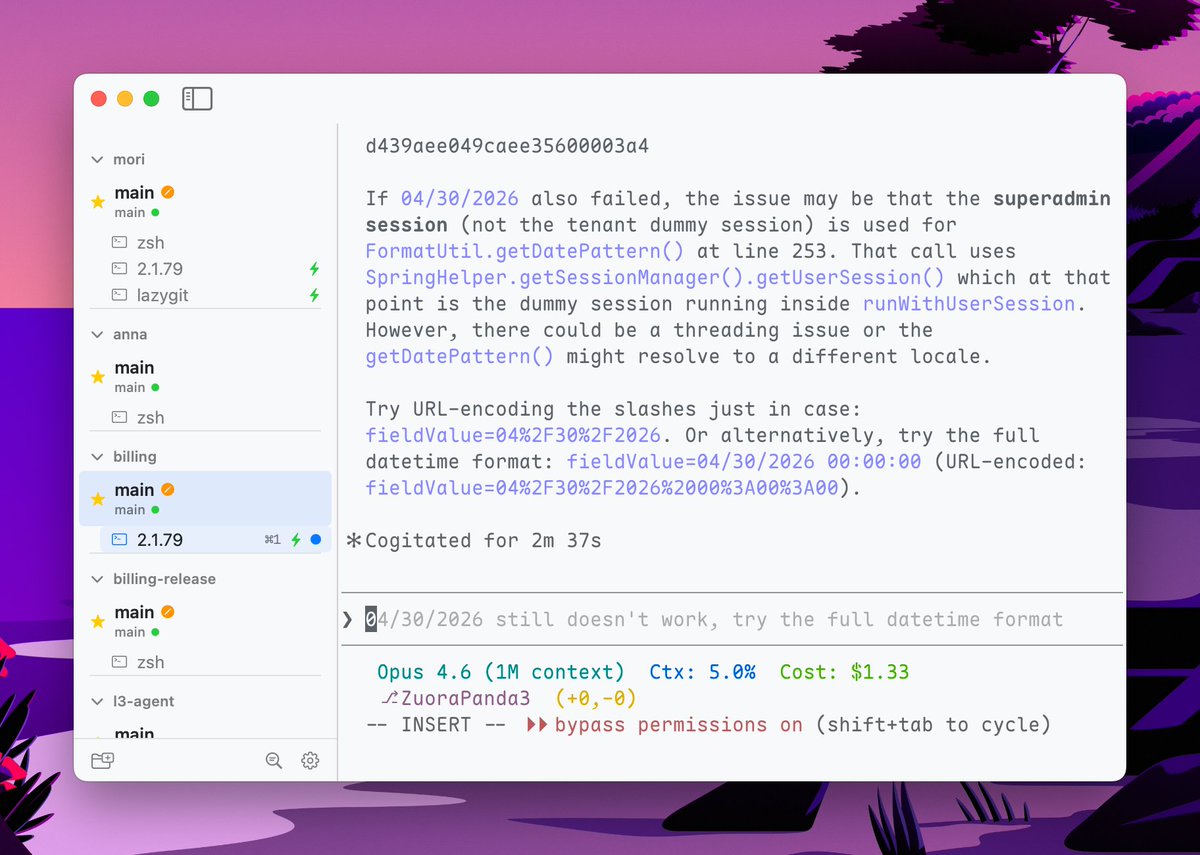

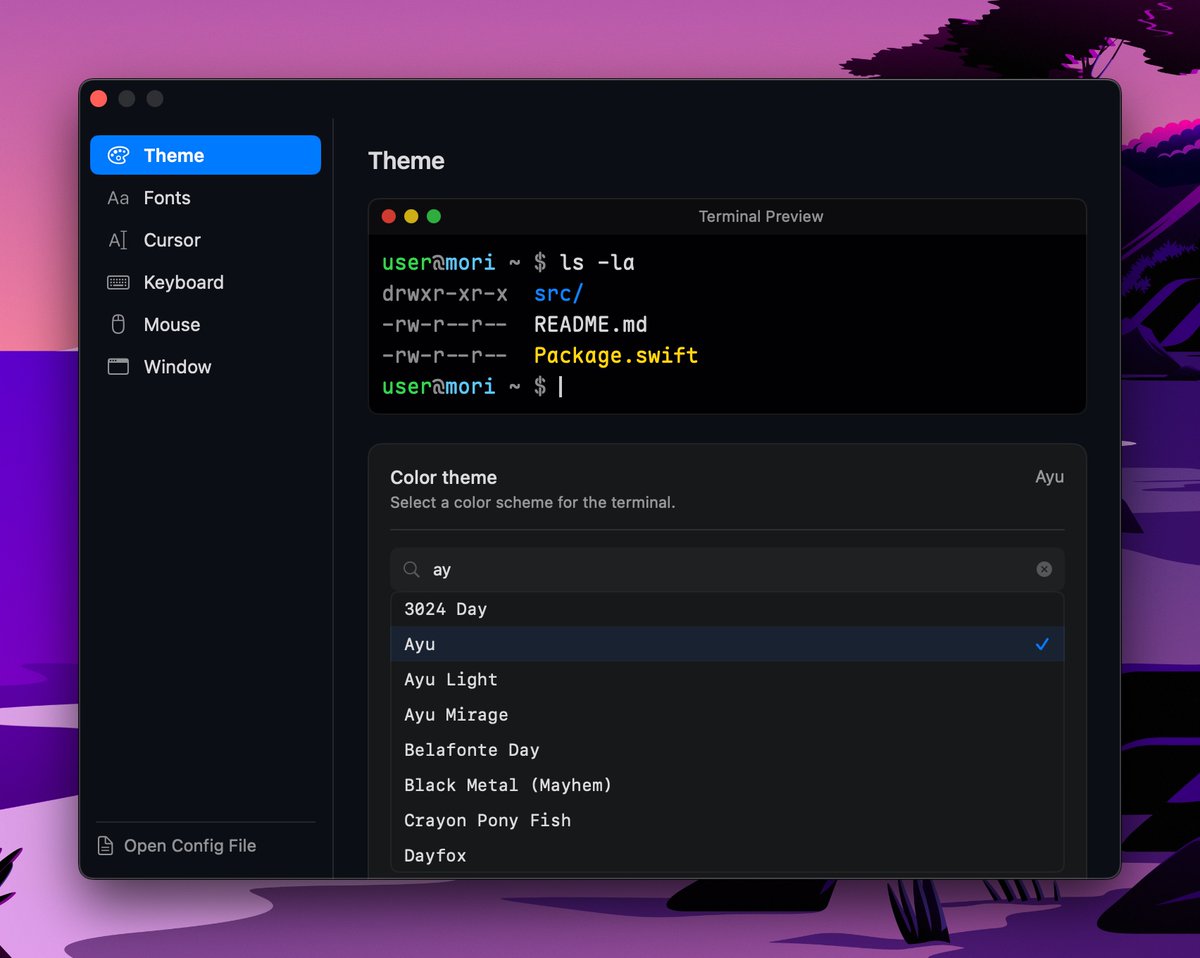

来来来,我也完成了我的第一个 Mac 原生 App。它基于 Tmux 和 libghostty 开发,类似 cmux,方便同时管理多个仓库与多个 worktree。

Superset 太慢,Conductor 不是原生,Coding Agent 的能力也差不少。Cmux 太丑,和 tmux 整合不佳,用不顺手。

之所以选 tmux,是因为我得随时用手机 ssh 继续干活。

欢迎围观 github.com/vaayne/mori

中文

@siantgirl vibe 没有稳定的模式(比如 TDD ),业务稍微复杂一些就是乱七八糟。你说了那么多,我能总结出来的就是一句话,“人家要你能 vibe 提效,但是要能遏制代码和架构的漂移。” ,不能遏制,多人协作的 vibe,就是地狱,随随便便就一堆坑,上线扑街的概率极高。

中文