Sabitlenmiş Tweet

優里 𝕏 もうだめだ

19.4K posts

優里 𝕏 もうだめだ

@YuRi_InTheWild

やる気にならん、もうだめだ 【やめたこと】 ・コーヒー飲む ・Windows使う ・仕事する ・怒る 【はじめたこと】 ・LMDE 7 ・ローカルLLM (@YuRi_LLM)

片田舎 Katılım Mart 2011

268 Takip Edilen1.3K Takipçiler

優里 𝕏 もうだめだ retweetledi

優里 𝕏 もうだめだ retweetledi

MTPの特性を考慮すると、速度向上は量子化されていないdenseモデルで特に効果的と考えられます

最も効果的: 非量子化(F16/BF16)Denseモデル + 予測性の高いタスク(codingなど)

低量子化(Q4/Q5)+creativeタスクでは注意

MoE: Denseより恩恵は小さめですが、使えないわけではなさそうです

Benjamin Marie@bnjmn_marie

MTP works with quantized models, but the speedup is much smaller than with the original BF16 model. That’s expected: quantized models are already faster, and quantization changes the output distribution, making future tokens harder for the MTP layers to predict.

日本語

優里 𝕏 もうだめだ retweetledi

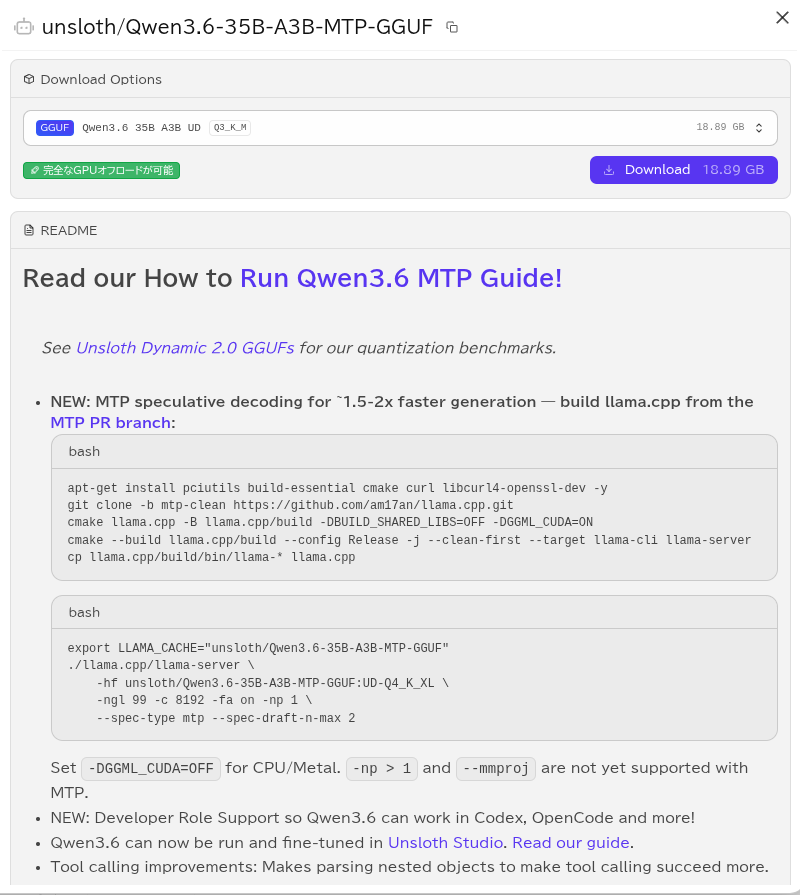

ローカルLLMの決定版? Qwopus3.6-35B-A3BとQwen3.6-35B-A3Bの違い、量子化バリアント徹底解説

1. 何が違う?

2. それぞれのメリットとデメリット

3. どちらを選べばいい?

4. 量子化バリアント徹底解説

5. 量子化選びの目安

note.com/yuri_llm/n/nb4…

日本語

@zaki134rp 脳みそこねこねするおくすり使うのがいちばん楽なんだろうけど、思想信条によりそこは避けて通りたいところなので、やべーときにうまいことごまかすのがけっこう大変

だれかセルフ催眠術を伝授してくれぇぇぇ

日本語

優里 𝕏 もうだめだ retweetledi

優里 𝕏 もうだめだ retweetledi

人生9割終わってるくせに更に20年、下手すっと25年とか30年とか、たとえ低賃金でも働かないといけないわけですよ

人生お疲れ様でした

tak@Tak100x

40歳くらいのみんな、やりたい事はやっといたほうがいいよ。この先体感人生速度、毎年倍になっていくから。45になったら人生9割終わったと思ったほうが良い。

日本語