ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸

12.5K posts

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸

@arkait_z

🖐 • 💻 • 📱 • 🐧 • 🌐 • ⭐ • 🏔 • 🧗 • ✊ • 🌊 • 🇵🇸

./EH/Gip/Oarso/Orereta Katılım Ağustos 2016

1.4K Takip Edilen450 Takipçiler

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

🚨 Periodista: “¿Qué piensas de las acciones de Lamine Yamal ayer durante las celebraciones del título de liga del FC Barcelona, y debería un jugador evitar interferir en asuntos no relacionados con el fútbol?”

Pep Guardiola: “¿Y tú también deberías evitar interferir en cosas que no son tu especialidad? Estás aquí para preguntarme sobre el partido de mañana contra el Crystal Palace F.C..

A pesar de eso, responderé a tu pregunta..... Un jugador de fútbol es un modelo a seguir seguido por millones, y su opinión es influyente, por lo que debería expresar su opinión cuando sea necesario.

¿Qué harías si encontraras a tu esposa e hijos bajo los escombros de hogares como los de ellos allí? ¿Vendrías aquí a la conferencia de prensa a hablar de un jugador que lleva una camiseta y corre tras una pelota?? ¡Por supuesto que no!!

No eliges los temas de los que queremos hablar, así que esas son cosas fuera de tu especialidad. La postura de Lamine es algo de lo que debería estar orgulloso — ahora se ha convertido en el tema de conversación del mundo.”

Español

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

Netflix, Wikipedia, Airbnb, Dropbox ~ all run on the same web server.

One quiet Russian engineer wrote it alone. For free. 🤯

Meet Igor Sysoev 🇷🇺

> Russian software engineer. Born 1970 in Soviet Kazakhstan.

> Failed his first university entrance exam.

> Joined Rambler in 2000 as a system administrator.

> 2002 ~ started writing a new web server in his free time. Alone.

> Goal: handle 10,000 simultaneous users on one machine ~ a problem Apache (the dominant web server at the time) couldn't solve.

> 2004 ~ released nginx publicly. Free. Open source.

> Zero marketing. Zero PR. Just the code.

> 2008 ~ nginx was serving 500 million requests per day at Rambler.

> 2011 ~ founded Nginx Inc. with co-founder Maxim Konovalov.

> 2013 ~ Netflix scaled its streaming CDN to 40 Gbps per server using nginx.

> 2019 ~ F5 acquired the company for $670 million.

> December 2019 ~ Russian police raided his Moscow office over a fake copyright claim.

> The Russian tech community publicly defended him. Charges were dropped.🚀

> 2021 ~ nginx overtook Apache as the #1 web server on Earth.

> 2022 ~ left F5 quietly. No farewell tour. No book deal.

> Today nginx powers Netflix, Wikipedia, Airbnb, Dropbox, Cloudflare, WordPress.

> 33% of every website on Earth runs on his code. Apache trails at 26%. Microsoft's IIS isn't even close.

> Still 100% open-source. Still free.

One man wrote it alone, in his free time, for free.

He never sought publicity. He never asked for credit.

A third of every website on Earth still runs on his work.

Webserver GOAT. 🐐

English

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

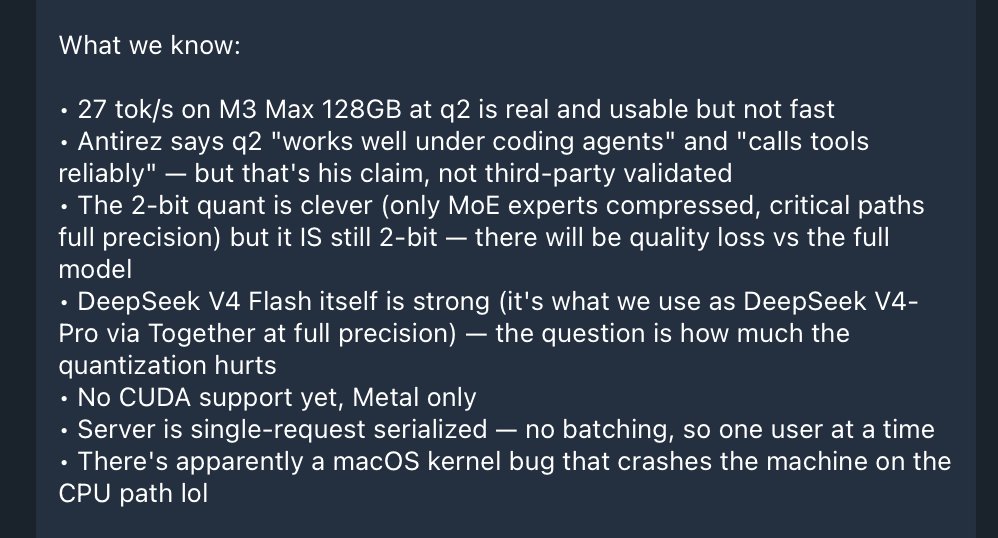

EL CREADOR DE REDIS ACABA DE ROMPER LA IA LOCAL

Antirez (el legendario Salvatore Sanfilippo) acaba de lanzar ds4: un motor de inferencia nativo, ultra-optimizado y hecho a medida para DeepSeek V4 Flash.

Lo que está pasando es de locos:

- 1 millón de tokens de contexto

- Corre en un MacBook de 128 GB con cuantización 2-bit

- KV cache movido directamente al SSD (del RAM al disco…)

- Pensamiento corto y proporcional a la complejidad

- Servidor compatible OpenAI + Anthropic listo para agentes

Mientras los labs cerrados queman decenas de miles de millones en clusters de GPUs…

un solo hacker construyó un inference engine que te pone frontier AI en tu portátil.

El Open Source no solo está vivo.

Está ganando!!!

REPOOO👇

Español

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

Me hacen gracia estos vídeos virales de Claude Code.

Gurús diciendo que facturan millones de euros gracias a la IA en modo automático con 16 instancias.

Luego miras la pantalla 3 segundos y ves los prompts que están usando. El resultado sólo es basura.

La IA es una herramienta brutal pero sin criterio, contexto e intención, no vas a conseguir nada.

Lo que quieren es venderte un curso, nada más.

Español

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

Chinese researchers have developed the best shortest-path algorithm in 41 years!

Dijkstra’s Algorithm has been the undefeated king of the shortest path for over 40 years.

Whether you’re using Google Maps, booking a flight, or routing internet packets, Dijkstra is the engine running in the background.

Since 1984, textbooks have taught that its efficiency was hit by a "sorting barrier."

To find the shortest path, you have to sort the points by distance. And sorting has a mathematical floor you can’t cross.

Until now.

A research team from Tsinghua University just published a paper that shatters the 41-year-old record.

They proved that Dijkstra is not optimal.

By combining the logic of the Bellman-Ford algorithm with a revolutionary "recursive partial ordering" method, they figured out how to find the path without fully sorting the nodes.

The results are a massive shift in theoretical computer science:

- The first deterministic improvement to the Single-Source Shortest Path (SSSP) problem since 1984.

- A new time complexity of $ O(m \log^{2/3} n)$, officially beating the long-standing $ O(m + n \log n)$ limit.

- On massive sparse graphs (like the web or global logistics), this means finding the best route significantly faster than previously thought possible.

For four decades, the greatest minds in algorithms believed this limit was absolute.

Last year, even the legendary Robert Tarjan won an award proving Dijkstra was "optimally efficient" at sorting distances.

Tsinghua’s answer? Stop sorting.

The world’s most settled problem is suddenly wide open again.

If we can break a 40-year-old law in basic graph theory, what other "impossible" speed limits are waiting to be crushed?

English

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

Como dijo Aperribay, había que demostrar que la #RealSociedad es el mejor camino para ganar un título.

Español

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

Este desarrollador chino ejecutó Llama 70B localmente en un MacBook en un avión y, durante 11 horas completas sin internet, gestionó proyectos de clientes.

Estaba sentado junto a la ventana en un vuelo transatlántico con un MacBook Pro M4 con 64 GB de memoria. El WiFi a bordo costaba $25 por el vuelo. Lo rechazó.

Sin API en la nube, sin conexión a los servidores de Anthropic o OpenAI, sin internet en absoluto.

Solo un Llama 3.3 70B local en bf16 y su propio script de orquestador.

El modelo se ejecuta a través de llama.cpp. Velocidad de generación, 71 tokens por segundo. Contexto alrededor de 60.000 tokens. Uso de memoria, 48,6 GiB de 64. Batería al despegue, 3 horas 21 minutos.

Y le dio al orquestador esta instrucción de sistema antes del despegue:

"Eres un orquestador offline que se ejecuta en un solo MacBook. No hay red. Los únicos recursos que tienes son archivos locales en /Users/dev/work, el servidor de inferencia Llama 70B en localhost:8080 y un presupuesto de batería de 3 horas 21 minutos. Procesa la cola en /Users/dev/work/queue.jsonl (una tarea de cliente por línea). Para cada tarea: borrador → ejecutar evaluaciones locales → guardar artefacto en /Users/dev/work/done/. Guarda puntos de control de contexto cada 12 tareas para que puedas reanudar después de un cambio de batería. Detente solo con la cola vacía o cuando la batería baje del 5 %."

Así que el sistema sabe exactamente en qué recursos se está ejecutando.

Sabe que no tiene conexión con el mundo exterior durante las próximas 11 horas. Sabe que tiene memoria finita y una batería finita. Sabe que el humano no intervendrá hasta que el avión aterrice.

El sistema se ejecuta en 1 bucle. Toma una tarea de la cola, la ejecuta a través de inferencia, guarda el artefacto, escribe un punto de control. Tarea tras tarea, así de simple.

Y solo cuando la batería baja del 5 %, el orquestador hace una pausa automáticamente, espera a que el portátil cambie al banco de energía de respaldo y continúa desde el último punto de control.

Aquí está lo que el sistema realmente escribe en su registro durante el vuelo:

"guardado punto de control de contexto 8 de 12 (pos_min = 488, pos_max = 50118, size = 62.813 MiB)"

"restaurado punto de control de contexto (pos_min = 488, pos_max = 50118)"

"progreso de procesamiento de prompt: n_tokens = 50 / 60 818"

"tarea 37016 completada | tps = 71 s tokens text → /Users/dev/work/done/proposal_westside.md"

Fuera de la ventana, nubes, cielo azul y sin WiFi. En la bandeja, 1 MacBook, una terminal abierta en 2 pantallas y un servidor de inferencia en localhost.

Por lo que he observado, este es el flujo de trabajo de IA offline más limpio que he visto en el último año: 11 horas de vuelo, $0 por WiFi y toda la cola de clientes cerrada antes del aterrizaje.

Español

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

Sus guerras, nuestra miseria. Hay que coserlos a impuestos.

elDiario.es@eldiarioes

Repsol gana 929 millones hasta marzo, un 154% más, gracias a la subida del petróleo eldiario.es/economia/repso…

Español

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi

The man who killed the $10,000 GPU myth.

He did it alone, from Bulgaria, with one C file. 🤯

>Meet Georgi Gerganov.

>Bulgarian developer. Nobody had heard of him.

>In March 2023, Meta’s LLaMA model leaked online

>Within days he wrote a single C file

>Called it llama.cpp

>It ran a full AI model on a MacBook. No GPU. No cloud.

>The entire AI industry said you needed $10,000 GPUs to run LLMs 🔥

>He proved you didn’t. On a laptop. Alone.

>Also built whisper.cpp ~ same thing for voice AI

> His code is the foundation of Ollama, LM Studio, and GPT4All

>107,000+ GitHub stars. Fastest open-source AI project to hit 100K ever. 🚀

>In 2026 Hugging Face hired his entire team

>Still ships code. Still open source. Still free.

Every time you run AI locally, you’re running his work.

Absolute Legend 🐐

English

ArkaitZ ¯\_(ツ)_/¯ 🇵🇸 retweetledi