Mathieu Lecarme

6.1K posts

Mathieu Lecarme

@athoune

Who watch the technologies of the web?

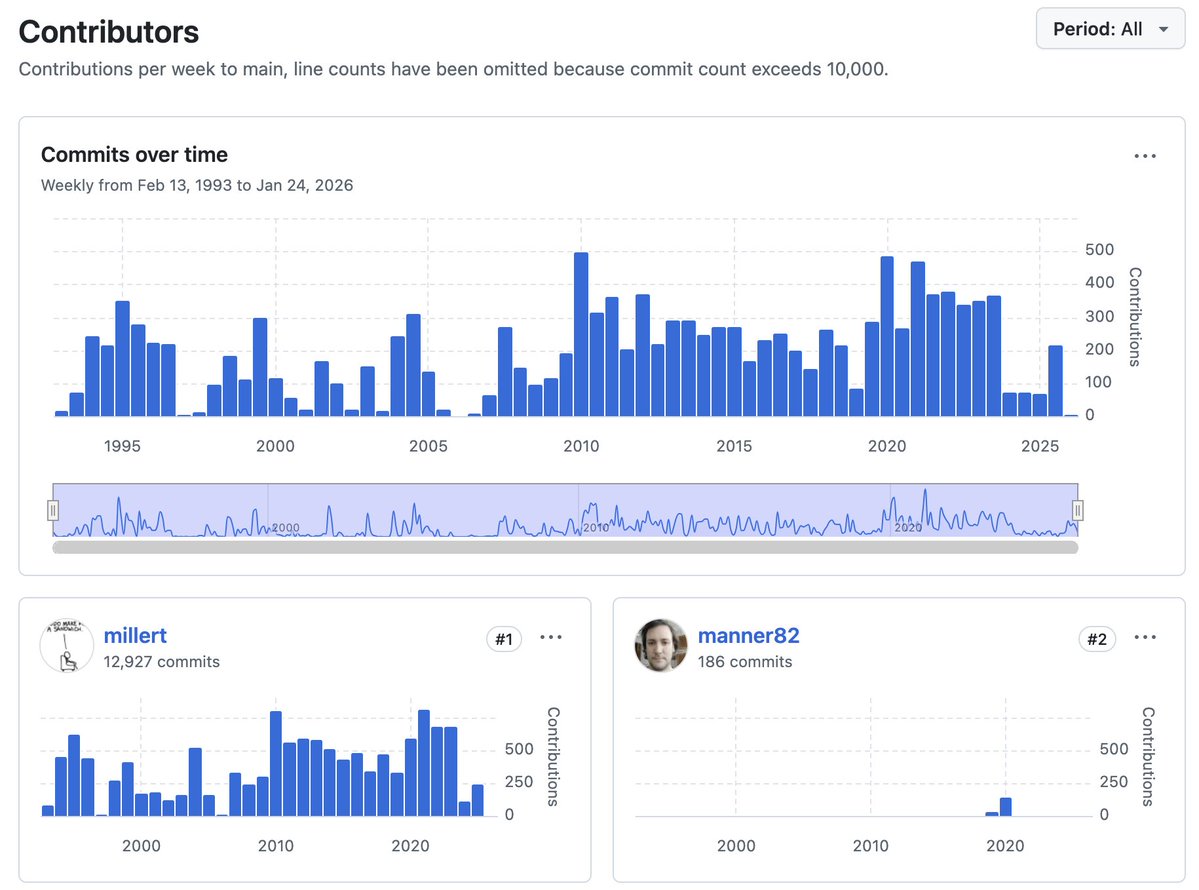

We just released version 4.3.0 of simdjson, the fast JSON library (C++). New: - Thanks to @CamelCdr, we now have an optimized kernel for processors RISC-V Vector Extension (RVV). The simdjson library might the first ever to process JSON with RVV. - Thanks to @GeimanThiesen, we have much faster serialization (production of JSON) performance in some cases. He added new SIMD-based functions that just blew our prior results. We also got contributions by Arthur Chan from Adalogics, and Eve Silfanus from the Microsoft Visual C++ team. github.com/simdjson/simdj…

Prouver sa majorité sans révéler son identité ? C'est le pari de France Identité avec le "double anonymat". L'État ne sait pas ce que vous visitez, le site ne sait pas qui vous êtes