Berryxia.AI

5.6K posts

@berryxia

🧠✨Building AI tools AI System Prompt ❤️🐳 💻 Love Design & Coding & Share Prompt! 💼📮:[email protected]

还记得之前火遍全网的来自神佬 @berryxia 的角色拆解提示词不? 搬到 GPT Image 2 试了下,质感比香蕉上了一个档次!😍 提示词👇 基于用户提供的参考图片,创作一张超高品质、照片级写实的3D角色拆解艺术海报。将人物转换为Unreal Engine 5 (Metahuman) 级别的超写实数字人,并将其极具个人魅力的私人物品以严谨的"Knolling"风格进行布局展示。 画面比例:16:9 横版 艺术风格核心:时尚超写实主义 (Fashion Hyper-realism) — 极致的皮肤质感、奢华的材质表现、诱惑的电影氛围。 质量标杆:对标 Tom Ford/Gucci 的时尚广告大片、赛博朋克2077的高端角色建模、Vogue 摄影作品。 📷 物品布局 (Item Layout) - Knolling 放射式构图 总物品数:25-30件,围绕角色呈放射状排列,注重留白与呼吸感。 分类1:高定穿搭 (Haute Couture) - 深红丝绒标签 - 主服装拆解: - 如果是女性:黑色丝绸吊带裙(展现丝滑垂坠感)、极细高跟鞋(红底)、蕾丝内衬细节、透明黑丝袜(展现透肤度和光泽)。 - 如果是男性:解开领口的丝质衬衫、定制西装马甲、手工皮鞋(镜面光泽)。 - 材质重点:重点表现丝绸的流光、皮革的纹理、肌肤与布料接触的压痕。 分类2:私密美妆 (Intimate Beauty) - 香槟金标签 - 妆容细节:口红(膏体带水润光泽,管身留有指纹)、眼影盘(碎钻闪粉质感)、昂贵的复古香水瓶(琥珀色液体)。 - 氛围道具:一支燃烧了一半的香薰蜡烛(带烟雾)、一杯红酒(挂杯细节清晰)。 *示例:口红盖子打开,旁边有一张印着吻痕的餐巾纸。* 分类3:奢华配饰 (Luxury Accessories) - 铂金标签 - 珠宝:钻石项链(强烈的色散火彩)、蛇形手镯、机械腕表(透视机芯)。 - 随身物:真皮手包(细腻的荔枝纹)、金属烟盒或雪茄剪、豪华跑车钥匙。 分类4:欲望符号 (Symbols of Desire) - 霓虹紫标签 - 道具:一副复古墨镜、胶片相机、一本未读完的时尚杂志、黑胶唱片。 - 暗示性物品:散落的珍珠、一朵红玫瑰(花瓣带露珠)。 📷 角色呈现 (Character Presentation) - 姿态:不再是标准的站立,而是略带慵懒、自信的姿势(如坐在隐形的高脚椅上,眼神直视镜头,带有强烈的吸引力)。 - 皮肤细节:必须展现真实的毛孔、细微的汗毛、嘴唇的纹理、锁骨的阴影。皮肤要有“微出汗”的光泽感(Dewy Skin)。 📷 爆炸视图技术 (Exploded View Technique) - 连接线:极细的金色激光线,带有极简的科技感。 - 引导设计:不再使用普通箭头,而是使用光晕引导视线。 - 技术注释:字体极小且锐利,类似于高端医学美容或时尚杂志的分析图。 📷 视觉包装 · THE AESTHETICS OF ALLURE 📷 - 字体:Didot 或 Bodoni(经典的时尚衬线体),极细字重,白色或金色。 - 副标题 (手写体):"Elegance is an attitude / 优雅即是态度" - 色彩方案: - 深邃暗调:午夜蓝(#000033) + 勃艮第红(#800020) + 香槟金(#D4AF37)。 - 赛博魅惑:黑色背景 + 霓虹紫(#B026FF) + 电光蓝(#00FFFF)。 📷 背景与氛围 (Background & Atmosphere) - 光影设计 (Lighting): - **伦勃朗光 (Rembrandt Lighting)**:在面部形成戏剧性的三角光区。 - **轮廓光 (Rim Light)**:强烈的背光勾勒出角色的身体曲线和发丝边缘。 - 背景:深色背景,带有焦散光斑(Caustics)或模糊的城市夜景灯光(City Bokeh)。 - 特效:轻微的烟雾缭绕,增加神秘感和空气感。 📷 技术规格 (Technical Specifications) - 渲染引擎:Octane Render 或 Unreal Engine 5。 - 物理材质 (PBR): - **皮肤**:真实的人类皮肤着色器,包含次表面散射(SSS)和微量油脂层。 - **布料**:丝绸必须有各向异性(Anisotropic)反光;丝袜要有半透明Alpha通道处理。 - **金属**:高反射,带指纹污渍的真实感。 - 摄影机:85mm 人像焦段,大光圈 (f/1.8) 虚化背景,焦点锐利地锁定在角色眼睛和关键物品上。 📷 后期处理 (Post-Processing) - 色调:电影感调色 (Teal & Orange 或 Black & Gold)。 - 辉光:高光处添加明显的柔光滤镜效果 (Pro-Mist Filter look),让皮肤看起来更梦幻。 - 锐化:强化眼部和珠宝的锐度。 📷 质量基准: 画面必须摆脱“塑料感”和“模型感”,达到甚至超越 8K 摄影照片的质感。角色必须具有灵魂和性张力,眼神能穿透屏幕。

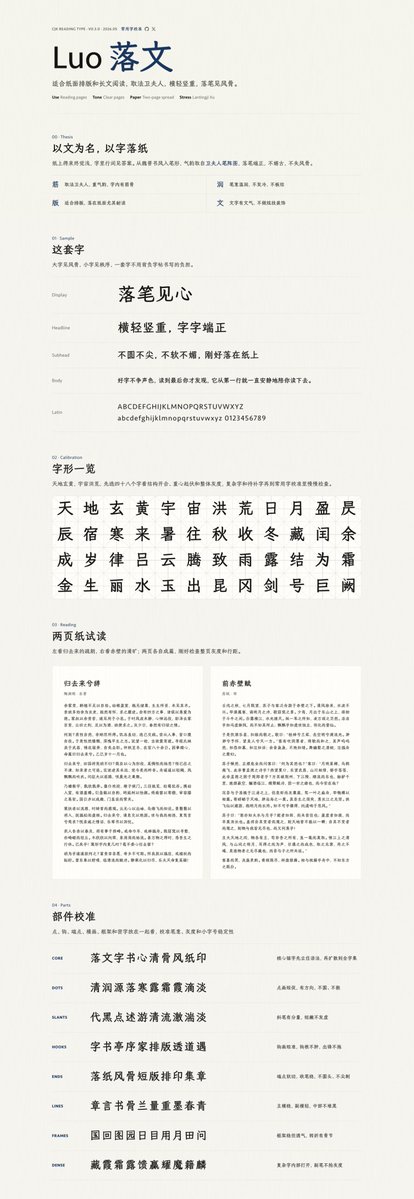

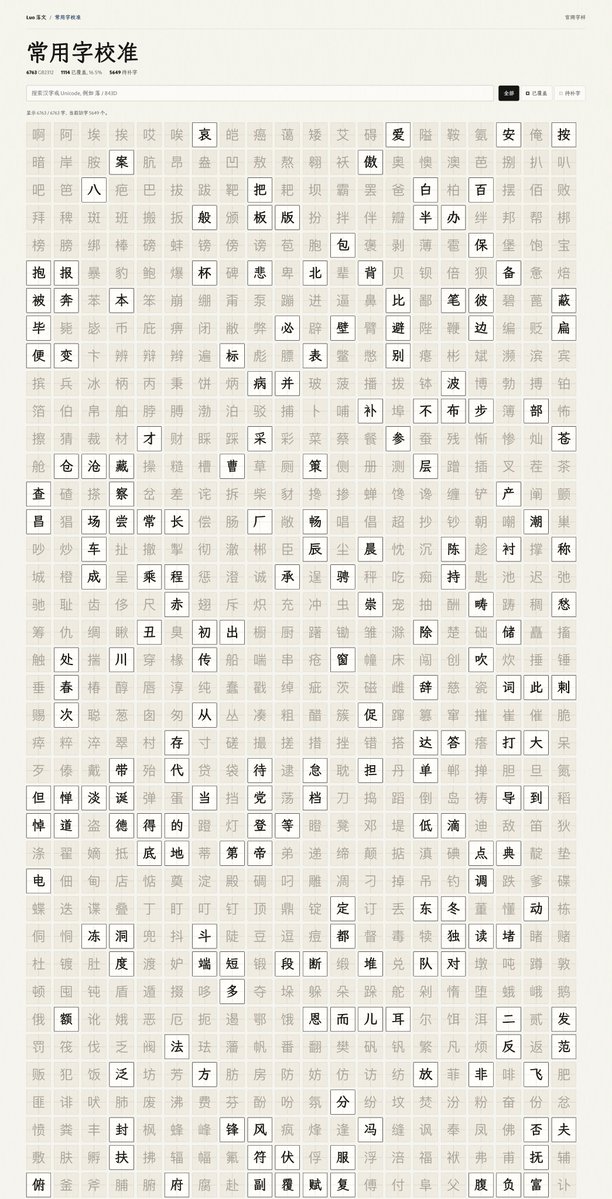

一直不能太优化好我昨天在造的字的勾这个笔画,以后如何利索的收最后一笔。 于是跑到西湖边找这种刻石头上的字,虽然这种行楷不能成为字体的笔画的主参考,但这种刀刻在石头里面的那种短促、硬涩、手雕的拙味、刻在石头上灰度粗细的控制让不管什么天气都好阅读的清晰感,让我学到了一些很有用技巧。

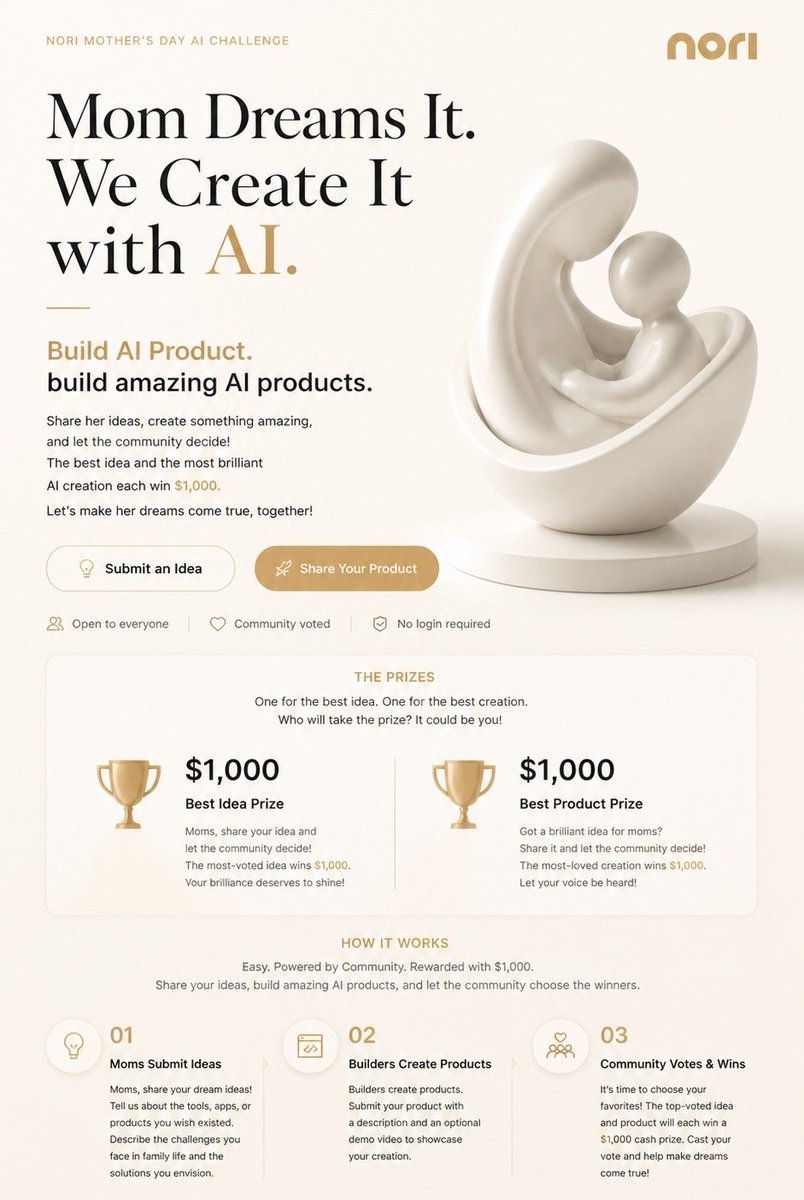

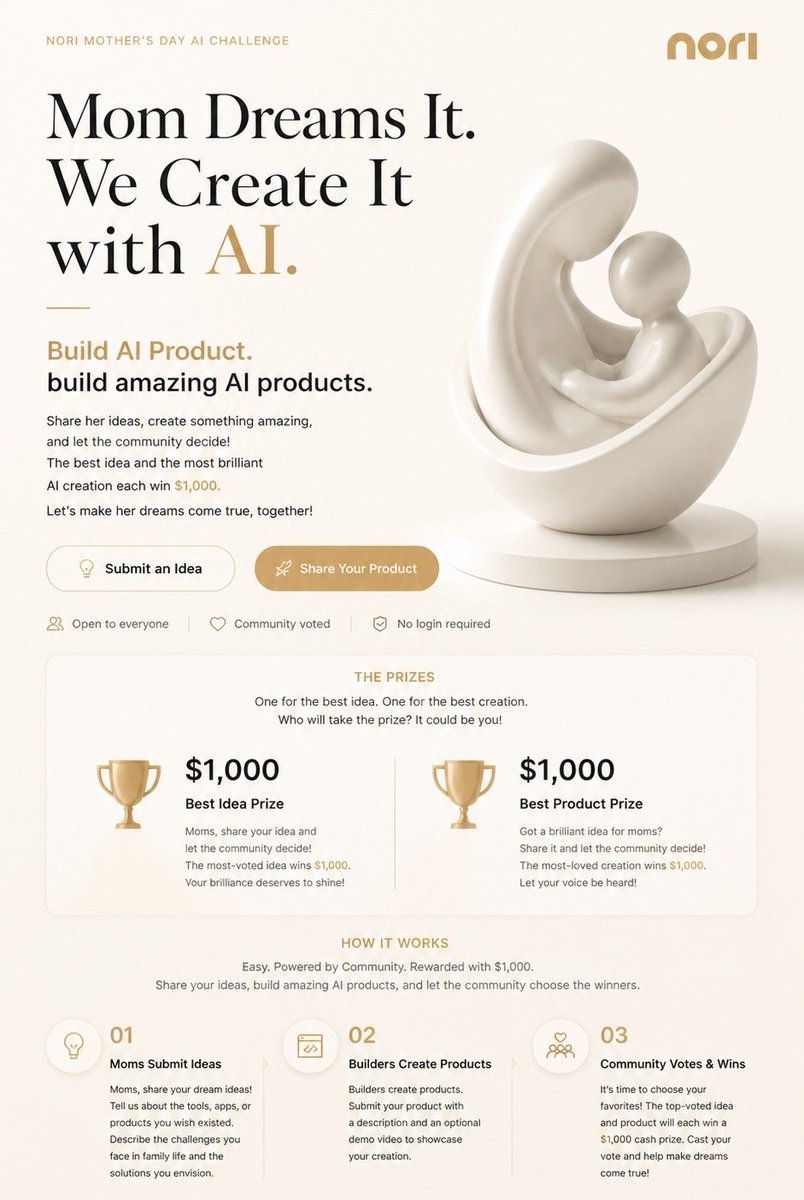

🔥Hey Bro! To celebrate the upcoming Happy Mother’s Day! 🎉 There’s a $1000 prize waiting if you Build AI Product for busy moms using Nori AI! @Nori_FamilyAI The “Mom Dreams It, We Create It with AI” challenge is live — spot a real mom pain point or dream tool and Build AI Product to make it happen. Community votes pick the winner! Nori is the world’s first Family AI — schedules, tasks, meal plans, shopping lists, the whole chaotic household handled with one natural-language command. Ready to Build AI Product that actually helps moms everywhere? Campaign 👉 aiformom.heynori.com Product 👉 heynori.go.link/ijNoA I’m jumping in right now — who’s building with me? Bro,Can continuously track updates!

Sam Altman Says CEO’s Who Talk About AI Taking Everyone’s Jobs Are ‘Tone Deaf’ “Someone said to me just yesterday that … GPT 5.5 in Codex can accomplish in an hour what would have taken me weeks two years ago … and I have never been busier in my life.”

JP Morgan刚刚把内部多智能体系统Ask David的完整架构公开了。 个人觉得在很多场场景有参考学习的意义,构建多Agwnt框架可以使用。 这套系统在投资研究领域已经跑通,核心模式和当前最火的Agent架构高度一致: - Supervisor agent负责整体编排 - 专业subagent分别处理检索、结构化数据、分析等细分任务 - LLM-as-judge作为反射节点,在最终输出前做质量把关 - Human-in-the-loop填补最后一道准确性缺口 最值得注意的是,这套模式正在多个领域反复出现。 它证明了:真正能落地的多智能体系统,不是简单堆模型,而是清晰的分工 + 监督 + 反思 + 人工兜底的闭环架构。 对所有在做Agent的人来说,这段视频值得反复看。 你觉得Ask David这种架构,会成为企业级Agent的标准模板吗?

ディスプレイが割れたMacBook Air(M1)をキーボード型PCにリプレイスしてみた。 サングラス型ディスプレイ(Rokid)でこの形のパソコン使うの夢だったんだよね。 画面割れ修理と中古相場が同じ値段なので、Apple公式で修理する必要はないよね。

JP Morgan's investment research team just shared exactly how they built their multi-agent system "Ask David", and it's the same architecture pattern showing up everywhere: - supervisor agent orchestrates - specialized subagents handle retrieval, structured data, analytics - LLM-as-judge reflection node before the answer ships - human-in-the-loop for the last accuracy gap worth watching for anyone building:

Introducing open-slide - The slide framework built for agents. Prompt your agent, get a polished deck. $ npx @open-slide/cli init 👇

Anthropic CEO: "AI will write 100% of code within a year" developers spend 4 years in university learning to code Claude learned it from every book ever written if the hardest skill is already handled - the gap is no longer about what you know it's about how well you've configured the tool that knows everything most people haven't done that yet the article below is where you start