CUP

3K posts

CUP

@cups_table

用尽一切力量的活着。 tg: https://t.co/J64CdYUQrw 有空的时候欢迎来吹两句,探讨如何努力活着 想找一些厂商,做一些实体产品销售,如果有可能,请随时私聊我!

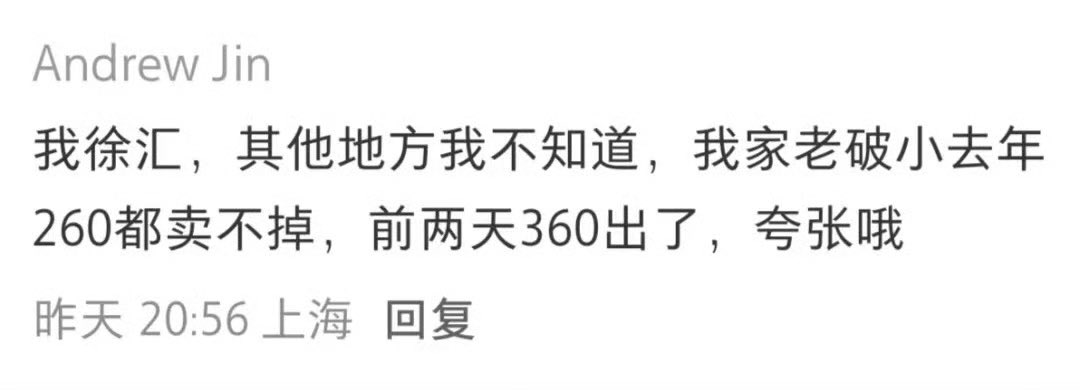

上海二手房单日成交1585套,创近5年新高。 深圳二手房单月成交过万,创五年新高! 1-2月的金融数据就连续三个月转负为正的3000多亿长期贷款抄底大军进来,这应该是第一批的余威了,问了深圳的中介, 周末签约中心都是排队的,价格回暖了5-10%,全是刚需和布局上学的,心态都比较统一,感觉跌到位了。

今天的 AI Coding 心得 尽量少做抽象设计。我们古法手搓的时候为了避免一些重复性的动作,往往做一些抽象设计,这种抽象可一定程度减少代码量和体现人类智商。但在 Coding Agent 看来,输出代码啥的是最简单不过的事,关键是获取简单清晰明确的指令,所以在半托管的 AI Coding 过程中,我觉得可以少做抽象设计了,徒增 Agent 的理解成本。

正在做的类似这个。 朋友整个项目纯AI生成,目前的方案是用大模型API实现的,也是我和他的观点差距点。 我认为以设备为核心,做小模型集成,终端可以处理简单的语音对话,同时保存一定程度的对话信息库靠算法维护,用终端设备分担一部分服务器压力,提高速度和效率,同时降低大模型API的费用。 朋友的观点是没有必要。 第一是终端的小模型对设备要求高,增加设备性能意味着提高售价,用户不买单。 第二是算法要求高,需要长时间研发,一个人搞不现实,所以不考虑技术性的方案。 第三是大模型API的精准度高,我自己这边用小模型在设备上测试,对语音识别的内容准确度只有80%,而且要比较大声和清晰的口齿才能识别,但是在豆包的API上音频上传得到的结果几乎可以做到100%,而且不限口音和声音大小。 然后他在终端设备的要求只有2个,一个是音频的采集播放,第二个是联网能力。 然后我的意见是这样实现,只要不联网,就是一块砖。 他没有直面回答这个问题。 后面细想想,好像也没什么,砖就砖呗,我硬件使用条件就这个,用户认可这个条件才会去购买使用,硬件的语音处理能力本身就是伪需求。 而且国内的API价格便宜到几乎没有成本,这样一看,貌似类似的聊天语音机器人,其实根本没有必要去研发什么东西,几乎是0门槛的东西。

试完了; 鉴定为拉完了 🤡 语音识别还是跟着系统的语音; 只能要么纯中文要么纯英文 然后只能局域网连接... 没办法在家外面用 来 🐰 + 🦞 来给大家表演一个节目