Sabitlenmiş Tweet

Bonus: wersje audio

Guy Swann

bitcoinaudible.com

@DoctorLex @krzysztof_piech @Bentyn @kowalskr @bitcoinpartypl @Buszkers #stacksats

HT

fargou

1.3K posts

@fargou

#Bitcoin Stay Humble Stack Sats: https://t.co/xUp3PsSyjH

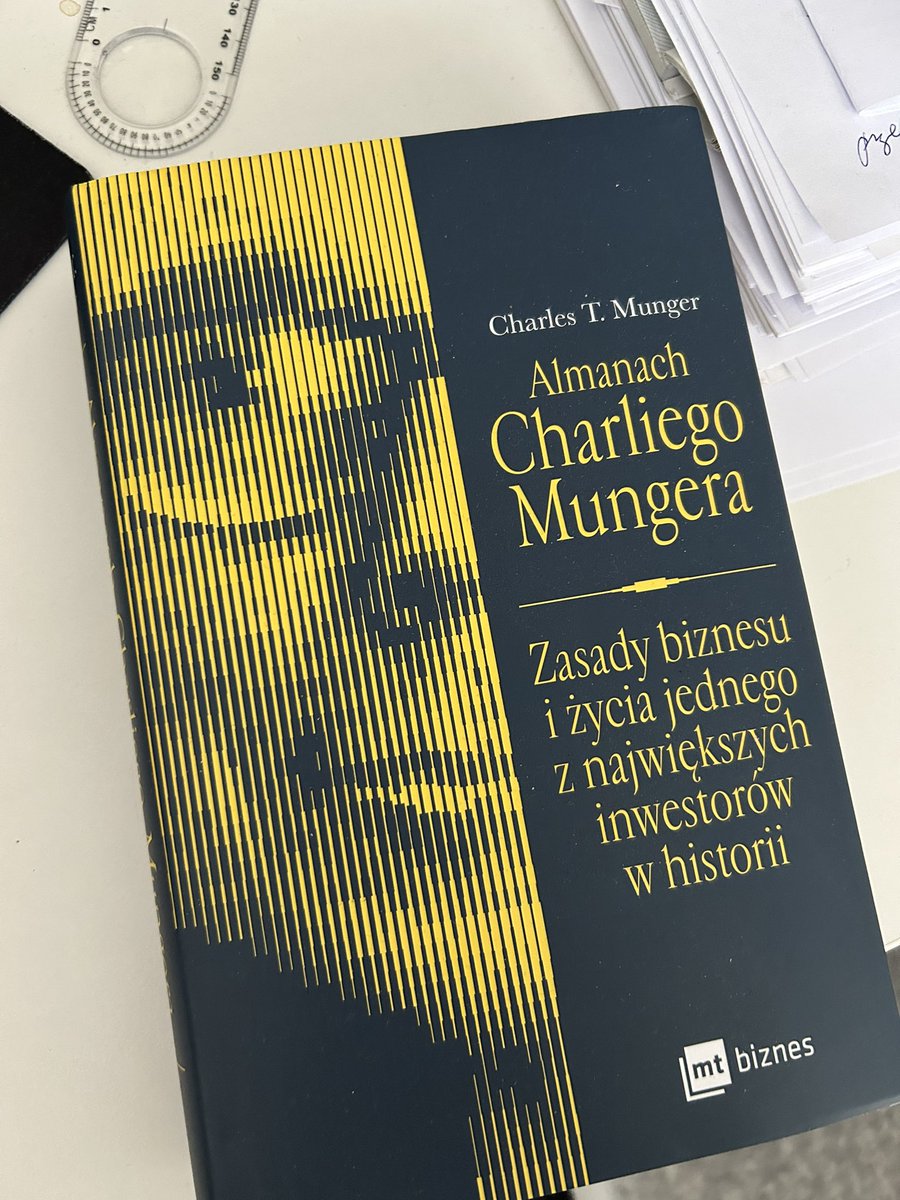

Charlie Munger ⤵️

Introducing Project Glasswing: an urgent initiative to help secure the world’s most critical software. It’s powered by our newest frontier model, Claude Mythos Preview, which can find software vulnerabilities better than all but the most skilled humans. anthropic.com/glasswing

🚨 BREAKING: Claude can now write legal contracts like NDAs, freelance agreements, and LLC paperwork better than $800/hour corporate lawyers. Here are 12 prompts that replace $15,000 in legal bills: (Save this before it disappears)

There is no substitute for the person who Knows What To Do.