FerRevilla

640 posts

FerRevilla

@frevillag

CEO Mexico en Grupo SM. Fundador WESAY @gowesay.com

MX Katılım Ekim 2010

690 Takip Edilen221 Takipçiler

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

Starship static fire successful!

SpaceX@SpaceX

Full-duration static fire for the first time on Starship V3

English

FerRevilla retweetledi

FerRevilla retweetledi

Umberto Eco, propietario de 50.000 libros, dijo esto sobre las bibliotecas caseras:

"Es una tontería pensar que tienes que leer cada libro que compras, porque es una tontería criticar a aquellos que compran más libros de lo que nunca podrían leer. Sería como decir que debes usar todos los cubiertos o gafas o llaves o taladros que compraste antes de comprar nuevos".

"Hay cosas en la vida que siempre necesitamos tener en abundancia, incluso si solo usamos una pequeña porción".

"Si, por ejemplo, consideramos los libros como medicina, entendemos que es bueno tener muchos en casa en lugar de algunos: cuando quieres sentirte mejor, ve al 'armario de medicamentos' y toma un libro. No al azar, sino el libro correcto para ese momento. ¡Esta es la razón por la que siempre debes tener una opción nutricional!"

"Quien compra sólo un libro, lee sólo este y luego se deshace de él. Solo aplican la mentalidad de consumidor a los libros, es decir, nos consideran un producto de consumo, un bien". "Los que aman los libros saben que un libro es todo menos una mercancía. "

Español

FerRevilla retweetledi

FerRevilla retweetledi

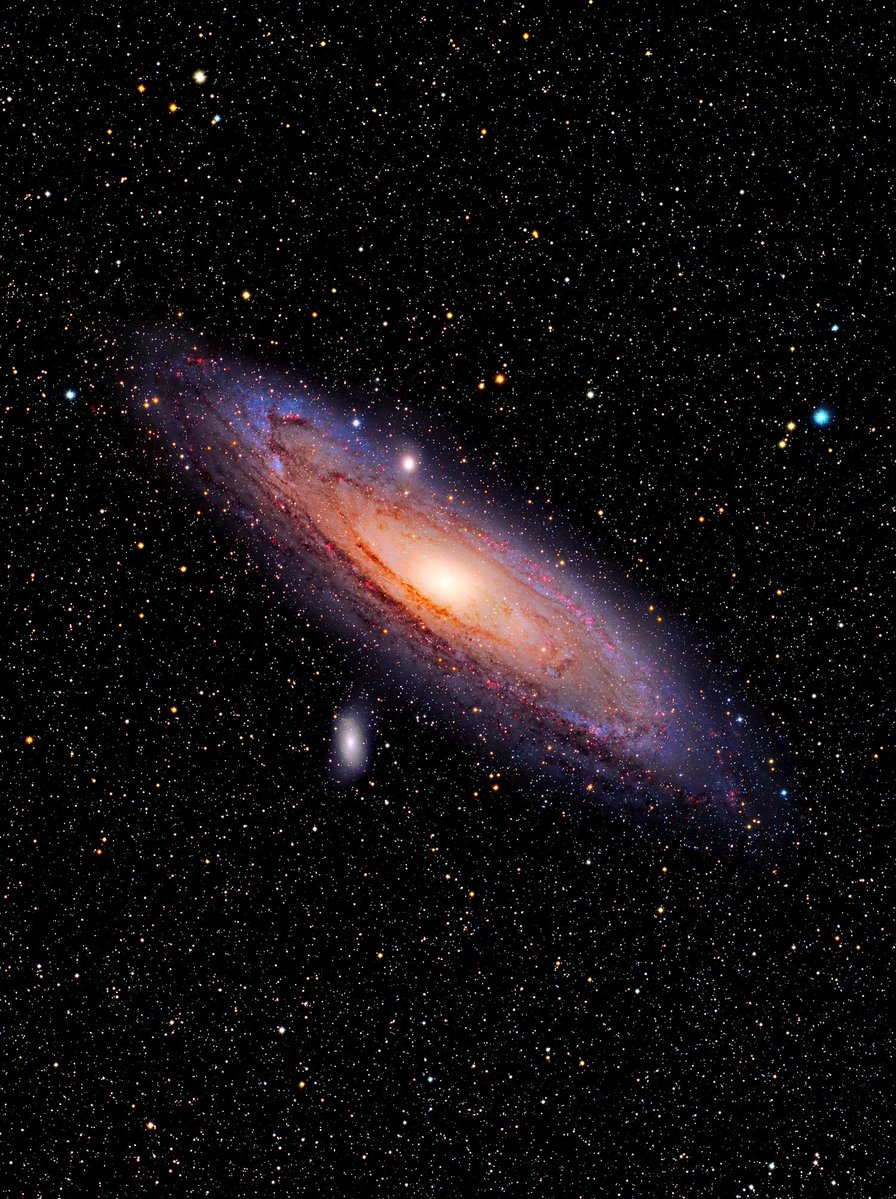

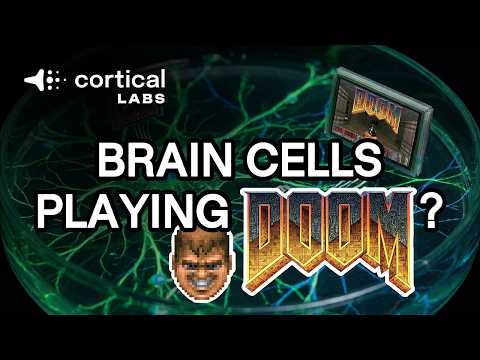

Esta noticia me parece muy importante.

200.000 neuronas humanas cultivadas en laboratorio jugando al Doom de 1993.

No una red neuronal artificial. No un LLM. Neuronas de verdad, creadas a partir de células de piel o sangre de donantes adultos, creciendo sobre un chip de silicio dentro de una máquina que cabe en un escritorio.

Cortical Labs (@CorticalLabs), una startup australiana, acaba de publicar el vídeo y el código en GitHub (youtube.com/watch?v=yRV8fS…).

Su ordenador biológico CL1 (unos 35.000 dólares la unidad) tiene un sistema de soporte vital interno que mantiene las neuronas vivas hasta seis meses. Temperatura, filtración de residuos, mezcla de gases, circulación. Todo dentro de la caja. Un acuario para cerebros en miniatura, si quieres verlo así.

La historia viene de lejos. En 2022, con su prototipo DishBrain, ya enseñaron a 800.000 neuronas a jugar al Pong. Las neuronas aprendieron en unos cinco minutos. Un algoritmo estándar de deep reinforcement learning tardaba unos 90 minutos en lo mismo.

Eso ya fue un hito. Pero Internet pidió lo que ultimamente siempre pide: "¿Puede correr Doom?"

Pues sí. Puede.

Ahora la cosa se pone interesante de verdad. Doom es un juego en 3D con laberintos, enemigos, armas, navegación espacial. Varios órdenes de magnitud más complejo que mover una paleta en el Pong. Para conseguirlo, el investigador independiente Sean Cole usó la API de Cortical Labs y lo montó en menos de una semana (cuando el Pong llevó más de un año de desarrollo). El sistema traduce la señal de vídeo del juego en patrones de estimulación eléctrica. Las neuronas "sienten" lo que pasa en la pantalla. Si disparan en un patrón concreto, el marine dispara. Si disparan en otro, se mueve a la derecha. Aprendizaje adaptativo en tiempo real, con latencia por debajo del milisegundo.

Esto ya no es Pong. Esto es otra cosa bastante mas seria y compleja.

Y aunque el hype con esto puede ser tremendo creo que también es importante leer la letra pequeña.

El propio Sean Cole, en la documentación del repositorio de GitHub, reconoce algo que casi nadie está mencionando: su decodificador (el software convencional que traduce los disparos neuronales en acciones del juego) tiende a convertirse en lo que él llama un "policy head". Es decir, el software de PyTorch que rodea a las neuronas puede estar aprendiendo a resolver el juego por su cuenta, esquivando a las propias neuronas. Cole incluso ha incluido modos de ablación en el código para que otros investigadores puedan probar si las células realmente importan o si el silicio está haciendo todo el trabajo en la sombra.

Eso es honestidad científica de la buena. Y dice mucho del estado real del proyecto: lo que han resuelto de forma brillante es el problema de interfaz (conectar neuronas vivas con un entorno digital en tiempo real). Lo que todavía no han demostrado es que 200.000 neuronas humanas puedan ser las que realmente toman las decisiones en lugar de ir de pasajeras.

Y aquí es donde, en mi opinión, esto se pone más interesante que el vídeo viral.

Porque lo que Cortical Labs está construyendo no es un juguete para que Internet se ría. Están creando la primera plataforma comercial de computación biológica. Ya han vendido 115 unidades. Un rack de 30 CL1 consume entre 850 y 1.000 vatios, comparable a un servidor GPU de gama media. Y han abierto una nube (Cortical Cloud) para que cualquier desarrollador pueda desplegar código directamente sobre neuronas vivas sin tener un laboratorio.

Las aplicaciones médicas son las que me parecen realmente brutales. Poder modelar enfermedades cerebrales, probar fármacos sobre neuronas humanas reales sin necesidad de modelos animales, estudiar cómo procesan información las neuronas de forma directa... Cortical Labs lo llama "Inteligencia Biológica Sintética" para diferenciarlo de la inteligencia artificial convencional. Y creo que el nombre es acertado.

Igual que pasó con Internet a finales de los 90, donde mucha gente miraba las primeras webs y decía "¿para qué quiero yo esto?", puede que estemos viendo los primeros pasos de algo que dentro de unos años nos parezca obvio. Neuronas humanas cultivadas como componente de computación, aprendiendo de datasets minúsculos comparado con lo que necesita cualquier LLM, consumiendo una fracción de la energía.

La pregunta es si esto será un complemento de la IA de silicio o algo completamente distinto. Me da que todavía es pronto para saberlo. Pero una cosa tengo clara: cuando la biología y la computación se mezclan a este nivel, las reglas del juego cambian. Y 200.000 neuronas jugando al Doom, por chapucero que sea el resultado hoy, es el tipo de demostración que dentro de 10 años miraremos como miramos ahora aquella primera web de Yahoo.

YouTube

Español

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

MY MIND HAS JUST BEEN BOGGLED.

I just tried the early release of OpenAI's new DeepResearch feature (rolling out later today to the $200/month Pro users).

I've been working in the CRM software industry for 30+ years.

It's not just that I've had court-side seats to the game, I've been on the court, doing my best to play the game. First in vertical CRM (my first startup) and now as co-founder of HubSpot. I've had some modest success and I feel like I have a pretty good handle on things in the industry.

That's why OpenAI's new DeepResearch feature boggled my mind.

I asked it create a detailed research report including competitive analysis, positioning, growth, product strategy and AI vision for the industry.

What it produced was an 11,000 word report. With data. And citations. And tables. And genuinely great insights -- including some I hadn't really thought of before.

What has me excited is not just that it can produce this kind of output (though that's pretty cool). What has me excited is that we'll be able to use this kind of output as *input* to a subsequent step in an agentic workflow.

Because the future is about agent composability. Being able to pull together pieces and put them together into a larger whole. The same way we build teams to work together to tackle higher order missions and goals.

This has been what I've been dreaming about for years. It's finally starting to happen.

We are seeing more and more of the future -- and it's happening quickly.

DISCLOSURE: I'm a small investor in OpenAI, and also a big fan.

English

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi

FerRevilla retweetledi