hyhriber

1.4K posts

感觉很多家庭问题的根源,是父母自己的生活不够丰富,于是把小孩当成唯一的精神支柱,最后变成疯狂控制小孩,做出各种越界甚至不可控的行为。 这种父母其实非常可怕。 相比正常的成年人关系,父母往往不可交易,却又会对你声索近乎无限的权力。 (1/2)

A recent viral paper claims to reverse-engineer the parameter counts of frontier models: GPT-5.5 = 9.7T, Opus 4.7 = 4.0T, o1 = 3.5T, etc. @ben_sturgeon and I investigated and found serious issues in the paper; fixing them gives GPT-5.5 as ~1.5T (90% CI: 256B-8.3T).

过去一个月,AI相关论文 11297 篇。 平均每天 376 篇。 你一天读 3 篇,已经是学术界卷王。 但你还落后了 373 篇。 没有人跟得上了。 包括写这些论文的人自己。

A breakthrough way to estimate closed-source LLM parameter sizes — no access to model weights, just black-box API calls! 🕵️♂️ Insight from Zhihu Contributor 李博杰 @bojie_li 🔑Core Insight Closed labs hide model sizes, but they can’t hide what models know. Inference can be compressed, factual knowledge cannot — this is the key to estimating LLM scale. 📅3-Year Long Test My friends He Jiyan & Zheng Zihan asked top models the same question for 3 years: "Do you know USTC Hackergame?" (A classic CTF contest) • May 2024: GPT-4o made up fake problems • Feb 2025: Claude 3.7 Sonnet listed 19 real 2023 challenges • Apr 2026: Frontier models recall full problems across multiple years 🧪IKP: Incompressible Knowledge Probes After DeepSeek-V4 launch, my agent spent 4 days building IKP: • 1,400 questions + 7 rarity levels • Tested on 188 models from 27 vendors 📊Finding 1: Factual Accuracy = LLM Scale Indicator Factual accuracy ↔ log(parameter size) (log-linear correlation) R² = 0.917 (89 open-source models: 135M ~ 1.6T params) Closed-source estimates (90% CI: 0.3–3x): • GPT-5.5 ≈ 9T | Claude Opus 4.7 ≈ 4T • GPT-5.4 ≈ 2.2T | Claude Sonnet 4.6 ≈ 1.7T • Gemini 2.5 Pro ≈ 1.2T 📚 Finding 2: Impact > Citation Count Citation count & h-index can’t predict if a model recognizes a researcher. Models remember people with impactful work, not those with massive incremental papers. 📈 Finding 3: Factual Capacity Doesn’t Compress Over Time Tested 96 open-source models across 3 years — IKP time coefficient = 0 (p < 10⁻¹⁵), rejecting Densing Law’s +0.0117/month prediction. 💡Benchmarks saturate, but factual knowledge grows with parameters. 🎯Key Takeaway Black-box LLM scale is no longer a secret — factual knowledge is the ultimate probe. 🔗Full article: zhihu.com/pin/2032769685… #LLM #ModelScale #DeepSeek #GPT5 #AIResearch

这篇华为的论文把我读笑了,真把人类组织的那套东西都搬给AI Agent了。 本周Huggingface第三热门的论文。 AI翻译解读见评论区

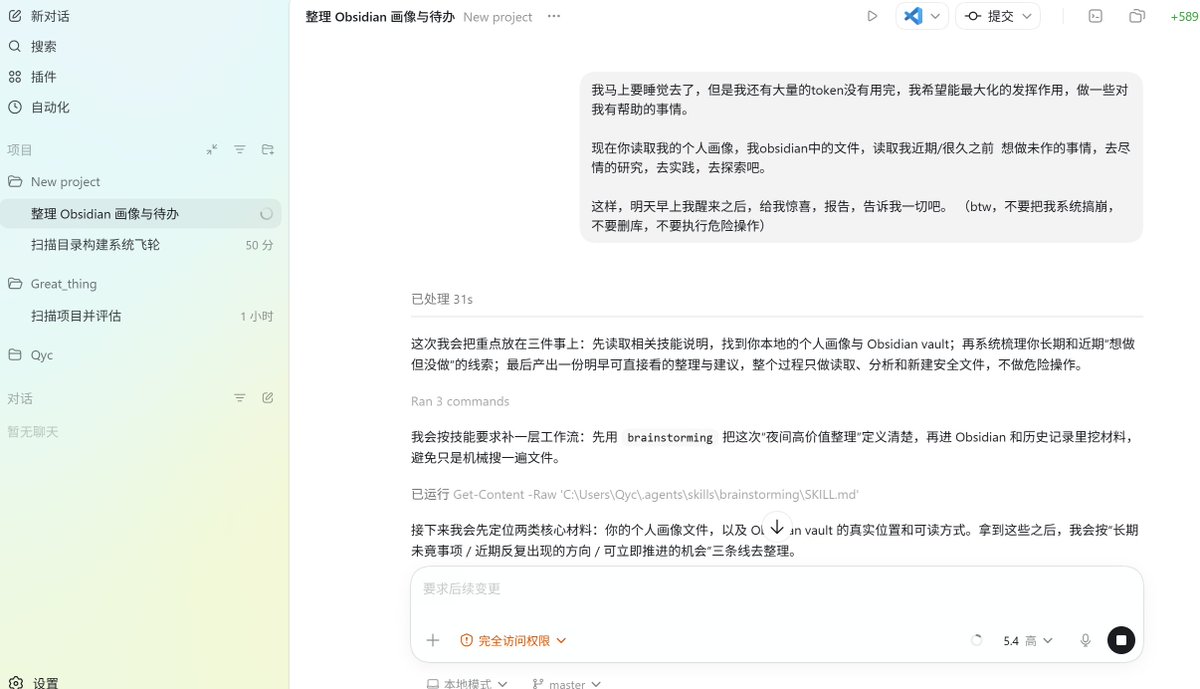

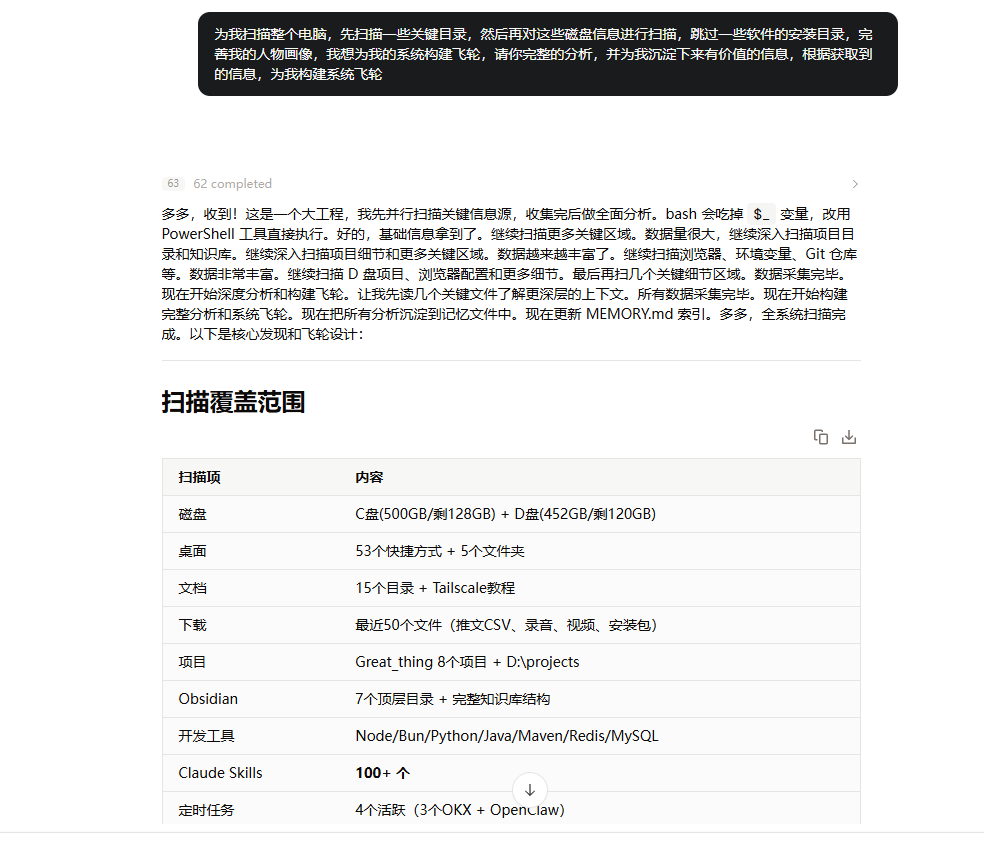

太厉害了, 直接让Claude code 基于电脑的数据,构建人物画像和系统飞轮。 数据不会说谎,这下我感觉CC比我自己更懂我了。 (大概CC 比人脑更优越的地方在于其上下文长度其实比人脑更大?) ADHDer 人群爱了,正好梳理了一下 那些 开了头 但远远没有做完的事情了。 看了一下给我的报告,以及给我的待办事项,真是说到心里去了。 这种感觉有点像在 cc 中输入 /insight 命令, 只不过,这次直接扫描的是你整个的电脑。

挺有意思的研究。 闭源实验室都对模型规模讳莫如深,但他们其实藏不住模型"知道什么"。而模型知道什么,恰恰就是参数量的指标。 核心逻辑:推理能力可以靠蒸馏压缩到小模型里,事实知识不行。一个模型记得多少冷门事实,直接跟它的参数量挂钩。 知乎博主李博杰为这个写了一篇小论文,构建了一套叫 IKP(不可压缩知识探针)的数据集:1400 个问题、7 层稀有度,扔到 27 家厂商的 188 个模型上跑了一遍,只看事实准确率。 结果在 89 个公开参数的开源模型上,准确率 vs log(参数量) 的拟合 R²=0.917,基本是一条直线。把闭源模型投影上去,规模就估出来了: GPT-5.5 ≈ 9T Claude Opus 4.7 ≈ 4T GPT-5.4 ≈ 2.2T Claude Sonnet 4.6 ≈ 1.7T Gemini 2.5 Pro ≈ 1.2T (90% 置信区间:0.3-3 倍规模) 另外两个发现也挺反直觉: 一是引用数和 h-index 不能预测一个研究者是否被前沿模型认识。两个引用数相近的人,模型给的回答可能完全不一样。它记的是有影响力的工作,不是论文数量。 二是事实容量不会被时间压缩。跨 3 年的 96 个开源模型,IKP 时间系数统计上为零(p<10⁻¹⁵),直接拒绝了 Densing Law 预测的 +0.0117/月衰减。benchmark 在饱和,但事实容量还在随参数继续扩张。 来源:知乎博主 李博杰 侵权联系删 arxiv.org/pdf/2604.24827