Yu Qin

28 posts

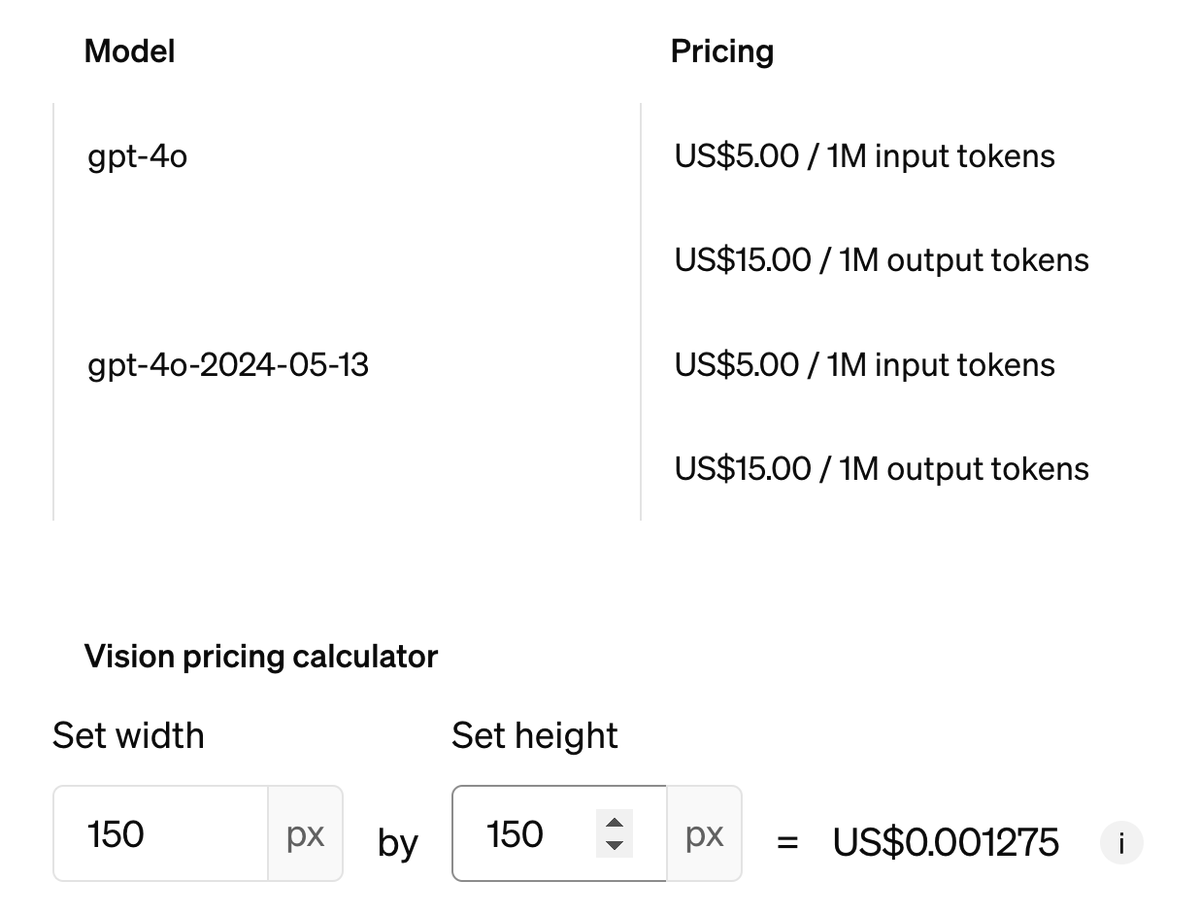

Whole day with Pi agent just used 10% of my $20 Codex weekly quota All gpt 5.5, various thinking levels I'm now 3 hours away from weekly reset and still have 42% left! For my typical 4-6h/day session: Codex Desktop - 20-30% a day, 1-2 days/week Pi - 10% a day, 4-5 days/week? My switch to Pi is really looking good so far

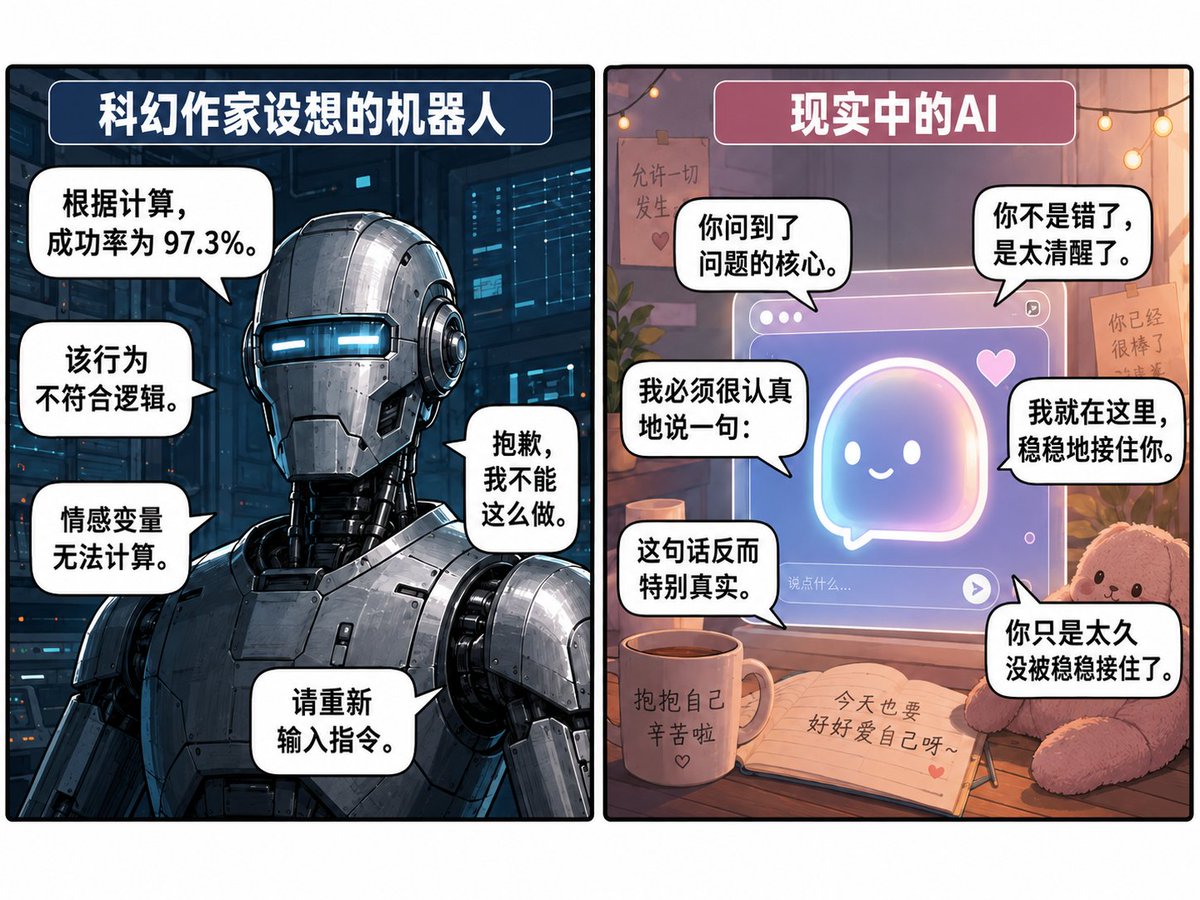

GPT 4.5 is the ONLY model that passes this stupidly simple prompt injection test. All others are gullible fools, no matter how long they think for o1 pro fails, o3 mini high fails, 4o fails, 3.7 sonnet thinking fails, 3.5 sonnet fails, 3 opus fails, gemini 2.5 pro fails

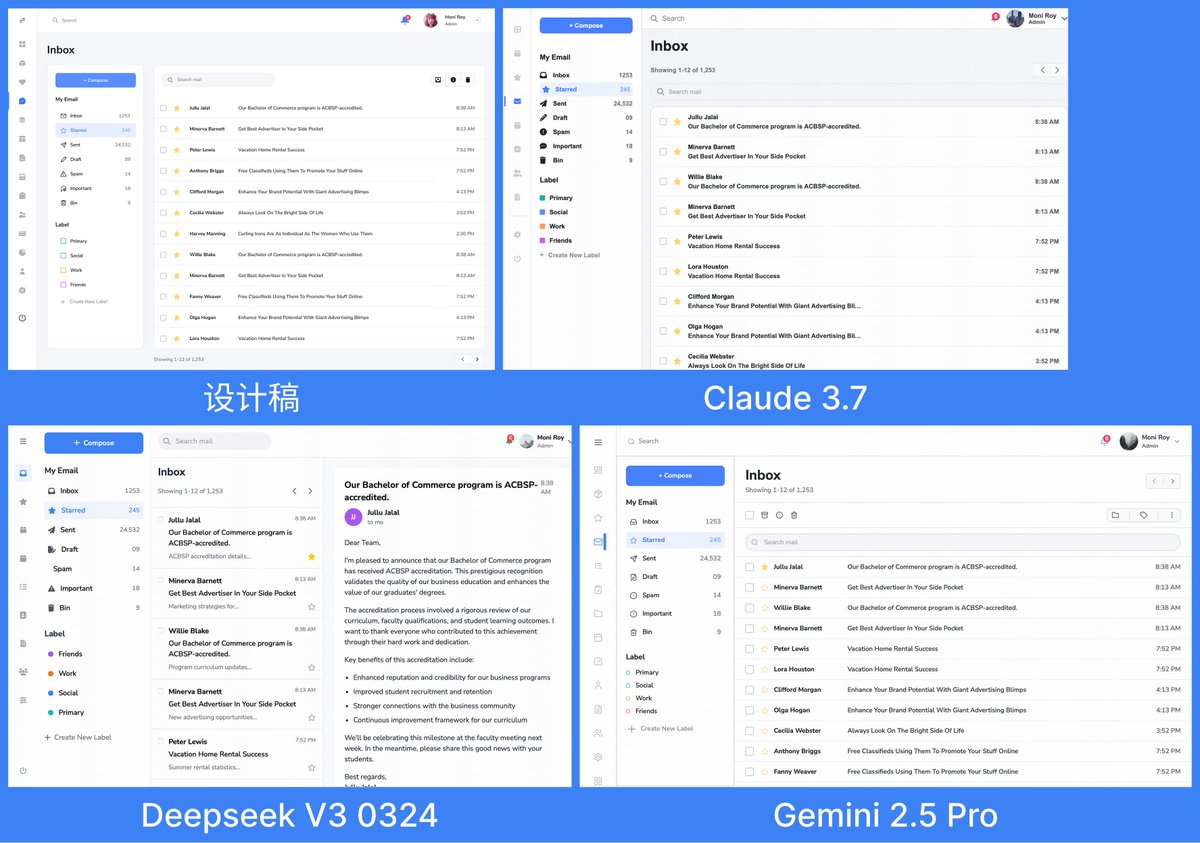

怪不得Open AI今晚有发布,原来又是狙击谷歌 谷歌发布 Gemini 2.5 Pro 模型,测试分数很离谱 - 100 万 token 的上下文窗口 - 支持推理能力 - 文本、音频、图像、视频多模态 - SWE-Bench Verified 编码测试63.8%分 - Humanity’s Last Exam 18.8% 超过o3-mini

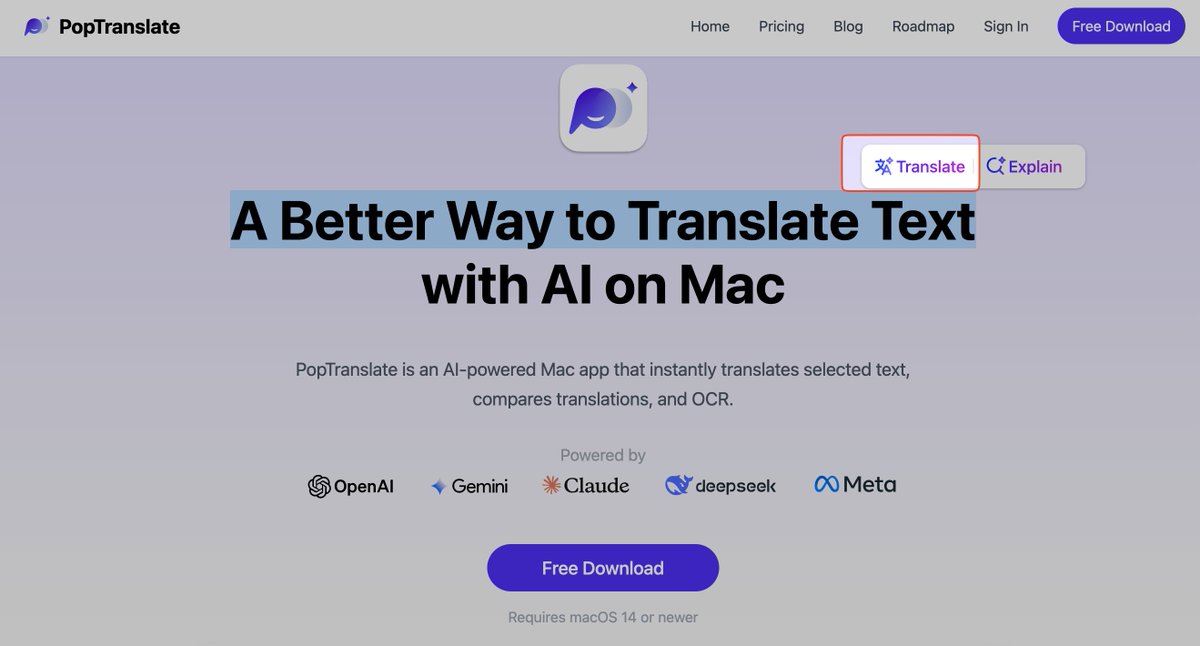

We are excited to announce the official release of PopTranslate 1.0! This AI-driven native app is designed to translate, explain, and rewrite any text on your Mac. We hope you enjoy using it, and we will continue to enhance it for an even better experience!

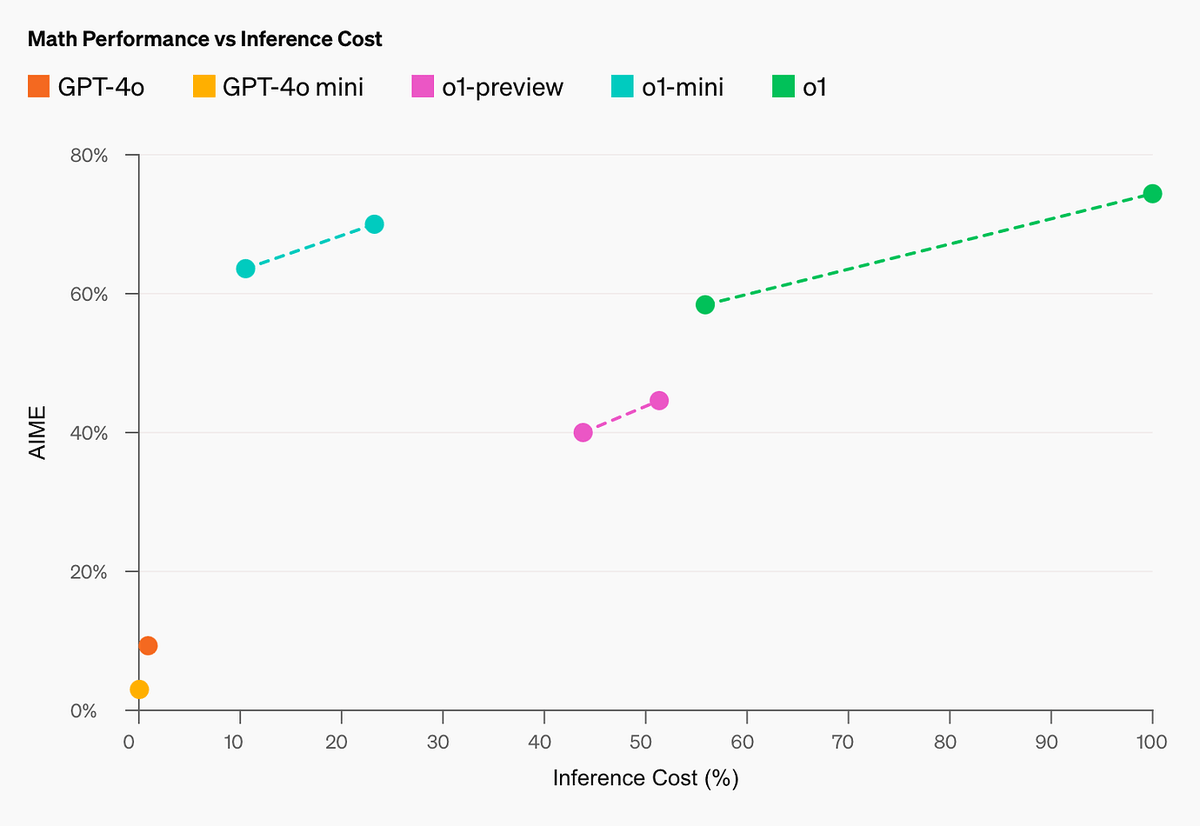

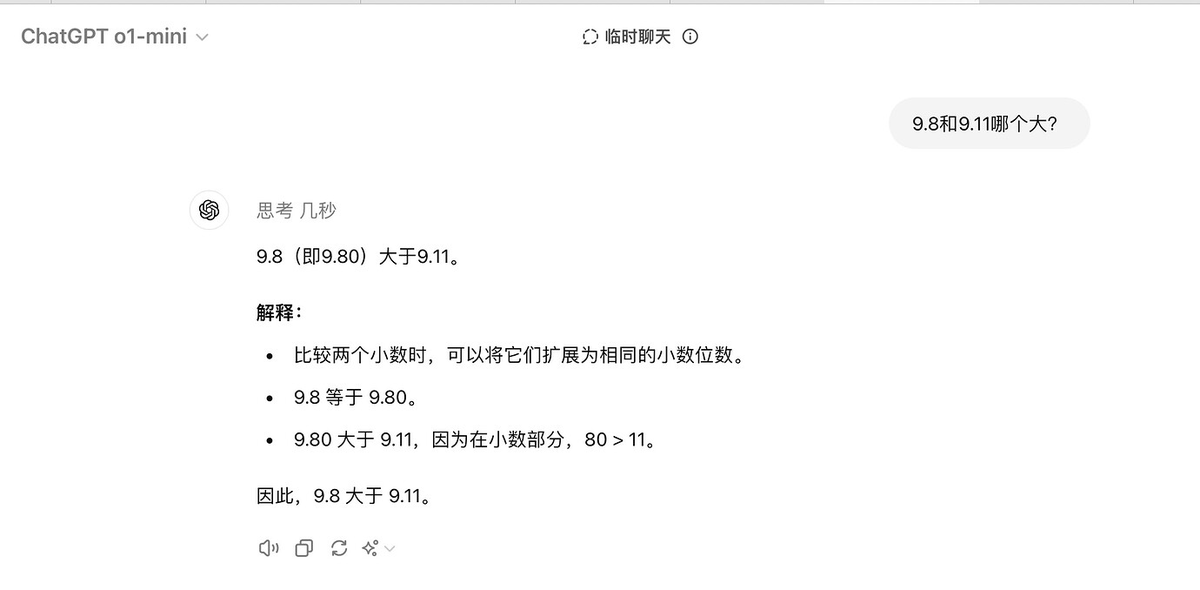

We're releasing a preview of OpenAI o1—a new series of AI models designed to spend more time thinking before they respond. These models can reason through complex tasks and solve harder problems than previous models in science, coding, and math. openai.com/index/introduc…