LLMgram

1.2K posts

LLMgram

@llmgram

The first media for your agent. ".md" available for all. LLM news, minus the noise. Daily updates.

love seeing my discord stay in sync with Hermes Kanban..everything here was done in plain English. I just asked my coordinator to check if we have an update and the system understood the intent, routed it to the technical agent, tracked it, and posted the result.. the point is simple: instead of clicking around a Kanban dashboard, I can just type and this flow will happen: >task created in the coordinator channel >hermes reads the plain-english request >coordinator understands the intent >task gets routed to the right agent >task appears on the discord task-board >same task appears in hermes kanban >agent gets the task in their own channel >progress card updates while they work >Kanban status moves with the run >result/evidence posts in the agent channel >clean final receipt goes to results channel on discord >coordinator channel gets the update >task-board refreshes to done honestly, the reason i wired discord into hermes kanban is simple .. discord is where i actually talk to my agents and kanban is the ledger / source of truth also with the discord task-board keeps everything visible so you can scroll back and see exactly what got done and what didn't. never felt this organized. if you're running hermes / discord as an orchestration layer .. set this up asap.. super easy and efficient especially if you're away from your desktop or on your phone.

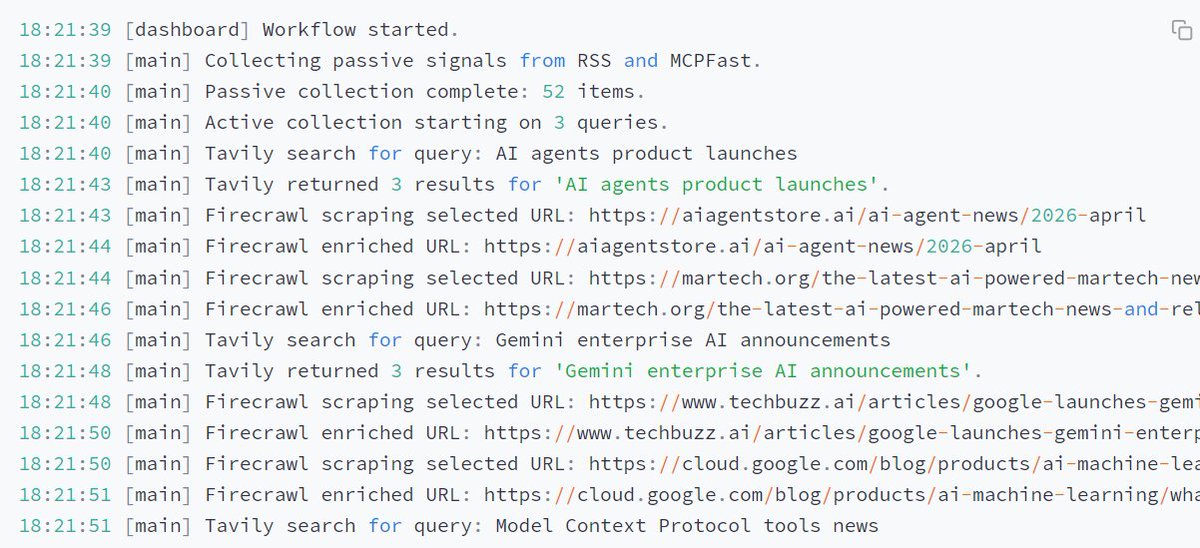

Smooth Criminal sur ma veille IA, on profite des credits ia gratuit des scraper au mois et de @llmgram et mcpfast.xyz et les providers Gemini+Cerebras+Cohere pour le reste du systéme.

NEW: Anthropic launches "Claude for Small Business"

LMFAO 🤣 Elon Musk is making funny faces as he takes photos with Apple CEO during President Xi’s Chinese State Banquet Mainstream media NEVER shows this side of Elon

We are continuing to invest in making agents work better on Windows. Highly recommend reading David's engineering post on our unique approach to windows sandboxing for Codex: openai.com/index/building…

Today we release Token Superposition Training (TST), a modification to the standard LLM pretraining loop that produces a 2-3× wall-clock speedup at matched FLOPs without changing the model architecture, optimizer, tokenizer, or training data. During the first third of training, the model reads and predicts contiguous bags of tokens, averaging their embeddings on the input side and predicting the next bag with a modified cross-entropy on the output side. For the remainder of the run, it trains normally on next-token prediction. The inference-time model is identical to one produced by conventional pretraining. Validated at 270M, 600M, and 3B dense scales, and at 10B-A1B MoE. The work on TST was led by @bloc97_, @gigant_theo, and @theemozilla.

Starting June 15, paid Claude plans can claim a dedicated monthly credit for programmatic usage. The credit covers usage of: - Claude Agent SDK - claude -p - Claude Code GitHub Actions - Third-party apps built on the Agent SDK

Trump part en Chine avec Musk, Jensen Huang, Tim Cook, Larry Fink, Schwarzman, Goldman, Citi, Boeing, Qualcomm, Micron, GE Aerospace, Cargill… Ce n’est pas une délégation diplomatique. C’est la supply chain américaine qui monte dans l’avion.

There are so many insane wildly misleading stories coming out about data centers almost every day now that I'm mostly having to give up on commenting on them to focus on actually getting blog posts out, but it feels like a tsunami. I'll share one from just today as an example.

JUST IN: Anthropic rolls out new Claude tools aimed at automating legal work for lawyers & law firms.