Marek Kubis

54 posts

Marek Kubis

@marekkubis

Assistant Professor at @poznanAI. Leader of Conversational Systems Team at the Center for Artificial Intelligence @UAM_Poznan. #AI #NLProc

Katılım Ocak 2011

339 Takip Edilen90 Takipçiler

⭐ For our #PickOfTheWeek, this paper explores an important question for modern speech AI:

🎙️ Which Evaluation for Which Speech Model?

👥 Authors: @Maureendss , @EeshanDhekane

Speech foundation models are evolving rapidly, but evaluation practices are still fragmented.

English

@piotrsankowski W Niemczech od lat działa DFKI, więc w żadnym sensie szybszy Pan nie był. Dziwne, ze Pan tego nie wie. en.wikipedia.org/wiki/German_Re…

Polski

SPRIND - to odpowiednik DARPY w Niemczech - właśnie ogłosił plan stworzenia europejskich laboratoriów AI. W jakimś sensie w Polsce byliśmy szybsi, bo już kilka lat temu powstało IDEAS NCBR. Teraz tą misję kontynuujemy jako Instytut Badawczy IDEAS.

Na razie strona programu zawiera dość niewiele informacji next-frontier.ai, ale głównym przesłaniem jest zapewnienie europejskiej suwerenności w AI. Europa posiada ogromny talent w dziedzinie sztucznej inteligencji, ale brakuje jej wiodących laboratoriów ("Frontier Labs"), które obecnie koncentrują się w San Francisco, Seattle czy Shenzhen. Poleganie wyłącznie na modelach z zewnątrz zagraża europejskiej suwerenności technologicznej i politycznej. To także nasz cel w IDEAS.

Polski

@trajektoriePL @AlexObuchowski @mar_kar_ @rzeczpospolita Cóż. Wychodzi na to, że badania z zakresu lingwistyki komputerowej ze względu na popularność LLMów trafiły już do kategorii "amerykańscy naukowcy odkryli...".

Polski

@marekkubis @AlexObuchowski @mar_kar_ @rzeczpospolita Podały to wszystkie polskie portale (bez żadnej konsultacji z kimś kto się na tym znał) + Euronews euronews.com/next/2025/11/0…

Polski

(6/7) Ale są też inne wyjaśnienia:

Wszystkie zadania testowane w artykule, z wyjątkiem jednego, były bardzo syntetycznymi zadaniami typu 'igła w stogu siana': Przekazywano modelowi fragmenty książek napisanych w danym języku, z instrukcjami w stylu 'Specjalna magiczna liczba dla „lasu” to: 2978103' wstawionymi w losowych miejscach, po czym proszono o wypisanie magicznych liczb według słów kluczowych.

Dlatego różne języki mogą uzyskiwać różne wyniki w zależności od tego, jak sformułowanie instrukcji wyróżnia się dla LLM na tle książek użytych dla tego języka.

Wyniki były również bardzo różne, poza oczywistą częścią (że modele generalnie radziły sobie lepiej z językami wysokiego zasobu). Polski dobrze pasował do o3-mini i LLaMa 3.1, ale zauważalnie gorzej niż większość innych języków wysokiego zasobu z LLaMa 3.3.

Język sesotho działał niesamowicie dobrze z Gemini 1.5 Flash, ale naprawdę słabo z jakimikolwiek innymi LLM.

Inny zespół mierzący to samo z innym wyborem promptów, zbiorów danych z książek i modeli do testów, mógłby dostać zupełnie inne wyniki. Poza oczywistym faktem że języki wysokiego zasobu nadal będą ogólnie działać lepiej.

Polski

My talk on LLM Evaluation presented at Data on Campus 2 (in Polish) youtu.be/i2wFqIsy-UE?si…

YouTube

English

Our joint study on augmenting spoken language corpora was presented at @FedCSIS

Department of Artificial Intelligence AMU Poznan@poznanAI

A joint study by @poznanAI researchers and Samsung Electronics Polska engineers was presented at @FedCSIS 2024. The paper investigates the impact of augmenting spoken language corpora with domain-specific synthetic samples. arxiv.org/abs/2406.07090

English

Marek Kubis retweetledi

Today was tle last day of workshops at @aclmeeting conference. Yesterday at @wassa_ws, @PSkorzewski and @piotrjablo represented our department with paper „POLygraph: Polish Fake News Dataset” check full paper at aclanthology.org/2024.wassa-1.2…

English

We have created POLygraph, a dataset of Polish fake news. Details below:

Department of Artificial Intelligence AMU Poznan@poznanAI

POLygraph - our team @PSkorzewski @marekkubis @FilipGralinski @piotrjablo and others, prepared a unique resource for fake news detection in Polish which will be presented at @wassa_ws workshop during @aclmeeting 2024 🚀🚀 Paper available at arxiv.org/abs/2407.01393 📄

English

Marek Kubis retweetledi

POLygraph - our team @PSkorzewski @marekkubis @FilipGralinski @piotrjablo and others, prepared a unique resource for fake news detection in Polish which will be presented at @wassa_ws workshop during @aclmeeting 2024 🚀🚀

Paper available at arxiv.org/abs/2407.01393 📄

English

Our work (@a_karlinska, @cezaryrosinski_, @marekkubis @patt_hub, @JanWieczorekPWr ) on using bibliodata LODification to create metadata-enriched literary corpora in line with FAIR principles is now available at aclanthology.org/2024.lrec-main…

English

The preprint of our paper "Two Approaches to Diachronic Normalization of Polish Texts" accepted to LaTeCH-CLfL 2024 is now available at arxiv.org/abs/2402.01300 #NLProc #DH

English

Marek Kubis retweetledi

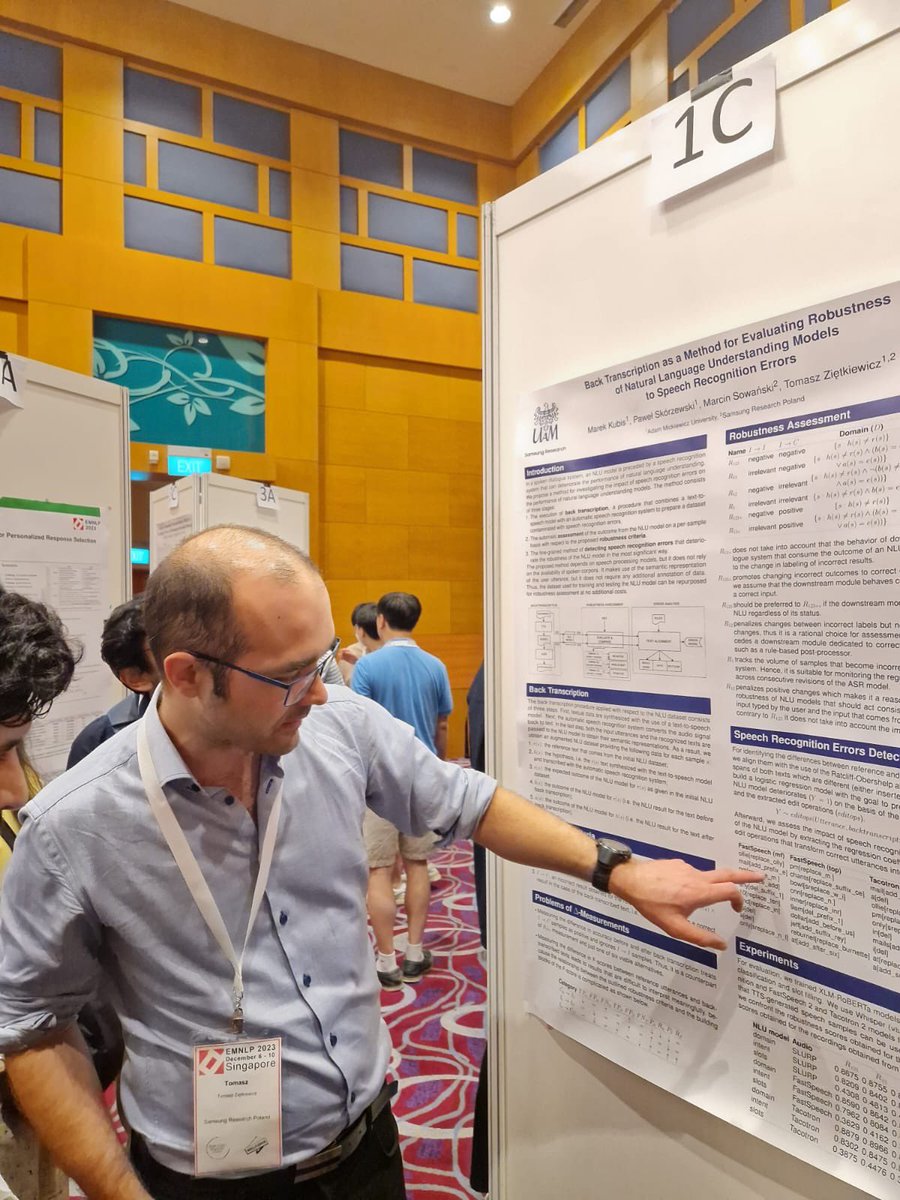

In exactly 20 minutes @marekkubis @PSkorzewski @tzietkiewicz and Marcin Sowański will speak about Back Transcription as a Method for Evaluating Robustness of NLU Models to Speech Recognition Errors. Join us online or in person. We start at 11.00 am CET

wmi.amu.edu.pl/zycie-naukowe/…

Poznan, Poland 🇵🇱 English

Marek Kubis retweetledi

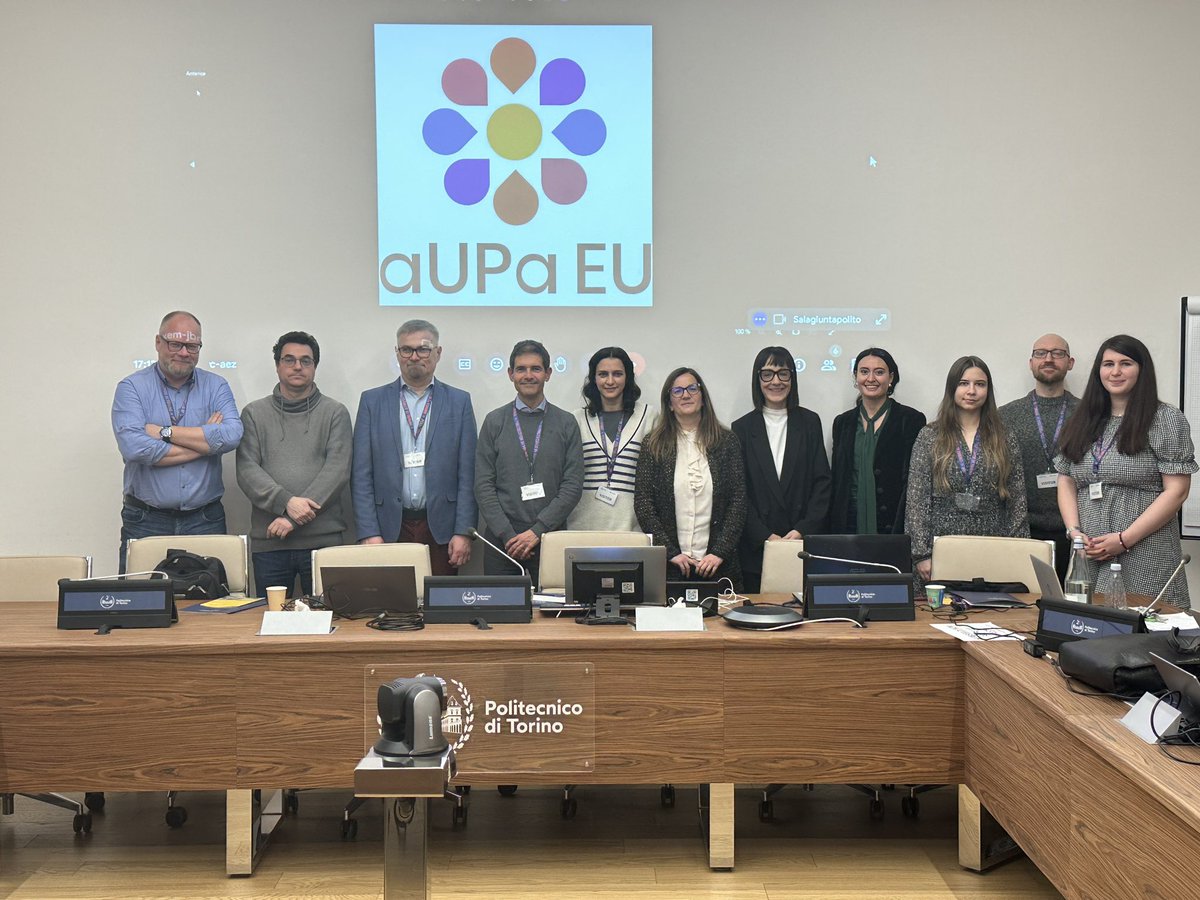

We are participating in the aUPaEU workshop in Turin, Italy, on the presentation of the concept of the Agora. We are a part of a team developing tools for collecting and searching of information for effective cooperation for scientists and HEIs in Europe. @WideningEU @poznanAI

English

Our work (co-authors: @PSkorzewski, Marcin Sowański, @tzietkiewicz) on using back transcription for evaluating robustness of #NLU models to speech recognition errors was featured on Samsung Research Blog research.samsung.com/blog/Back-Tran… #AI #NLProc @poznanAI @samsungresearch

English

Marek Kubis retweetledi

A joint study of @UAM_Poznan researchers and Samsung Electronics Poland engineers on evaluating robustness of #NLU models to speech recognition errors was presented at #EMNLP2023 by @marekkubis and @tzietkiewicz arxiv.org/abs/2310.16609

English

The preprint of our paper "Back Transcription as a Method for Evaluating Robustness of Natural Language Understanding Models to Speech Recognition Errors" accepted to #EMNLP2023 is now available at arxiv.org/abs/2310.16609 #NLProc #VoiceAI #AI

English