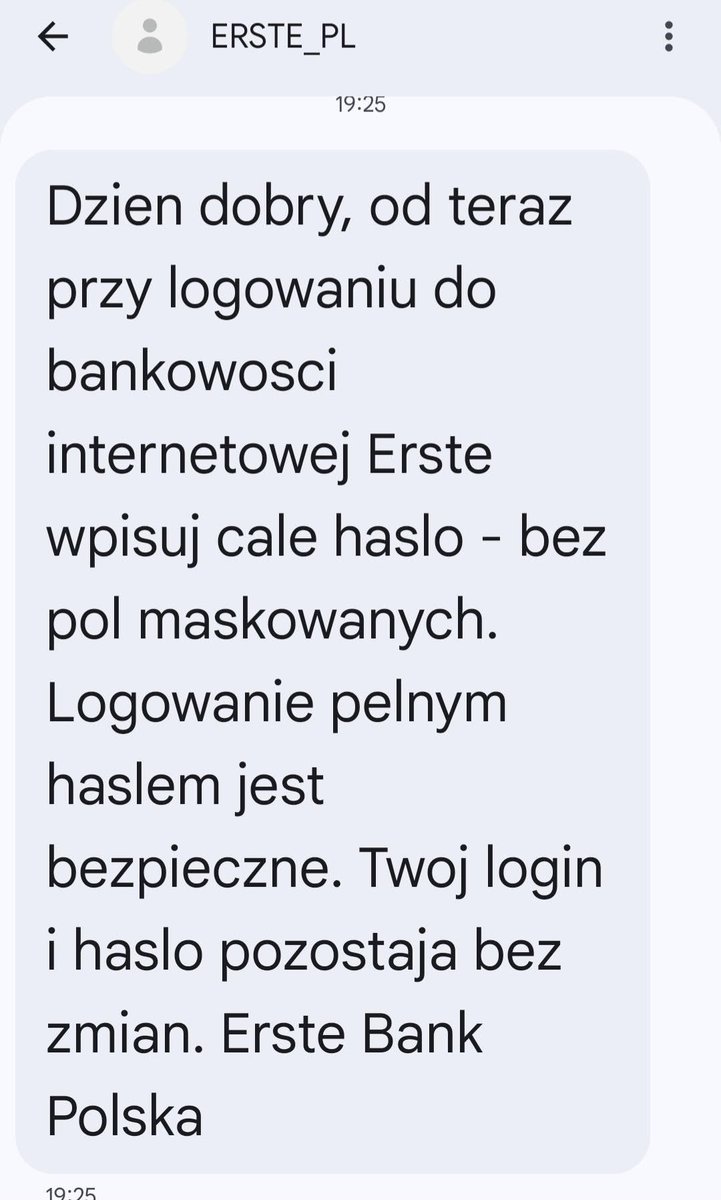

MichałM93

673 posts

Programistów juniorów już nie ma, bo nikt ich nie potrzebuje. Teraz nie będzie pentesterów juniorów 🤷♂️ Cieszcie się, że Wy w branży zaczęliście wcześniej. Was nie zastąpi. Ale wycena niektórych spółek z sektora cyber pewnie poleci w dół.

Błędy w rozumowaniu profesora @andrzejdragan wynikają z przyjęcia skrajnie fizykalnej i redukcjonistycznej perspektywy, która prowadzi do fałszywych analogii i nadmiernych uproszczeń. Pierwszym jaskrawym przykładem jest argument 'samolotu i pióra'. Dragan przekonuje, że skoro samolot nie potrzebuje piór, by latać, to inteligencja nie potrzebuje biologii, by myśleć. Ta analogia mija się z celem, ponieważ pomija fundamentalną różnicę w teleologii systemów: cel 'latania' jest techniczny i prostacki (przemieszczenie masy), podczas gdy cel inteligencji biologicznej jest nierozerwalnie związany z homeostazą i przetrwaniem. Biologia nie wytworzyła inteligencji do rozwiązywania abstrakcyjnych zagadek, ale do utrzymania organizmu przy życiu w zmiennym środowisku. Dragan odrywa więc inteligencję od jej ewolucyjnego kontekstu, traktując ją jako czysty proces obliczeniowy. Jeszcze bardziej nietrafione jest twierdzenie profesora, jakoby nikt nie rozumiał, jak działa telefon komórkowy, co ma usprawiedliwiać naszą niewiedzę na temat działania sieci neuronowych. Jest to teza fałszywa. Oczywiście, że rozumiemy działanie telefonu – jest to system deterministyczny, zaprojektowany przez inżynierów, posiadający pełną dokumentację techniczną i oparty na znanych prawach elektroniki oraz logiki cyfrowej. Porównywanie tego do 'czarnej skrzynki' AI, opartej na wysokowymiarowej statystyce i emergentnych wagach, których nikt ręcznie nie ustalał, jest błędem kategoryzacji. Używanie tego argumentu do budowania aury tajemniczości wokół AI jest intelektualnie nieuczciwe. Kolejnym punktem spornym jest bagatelizowanie neuroplastyczności. Dragan traktuje ją jedynie jako efekt ograniczeń fizjologicznych (rozmiar czaszki), sugerując, że w przypadku AI problem ten rozwiązuje się poprzez proste dołożenie sprzętu. To podejście ignoruje przepaść w wydajności energetycznej i algorytmicznej. Mózg pracuje na mocy około 20W, ucząc się na pojedynczych przykładach (one-shot learning), podczas gdy AI wymaga farm serwerowych zużywających megawaty i milionów danych, by zrozumieć najprostszą koncepcję. Neuroplastyczność to nie tylko 'upychanie funkcji', ale mechanizm dynamicznego adaptowania się do nieprzewidywalności. Twierdzenie, że 'dołożenie sprzętu' jest lepszym rozwiązaniem, to typowe brute-force'owe podejście fizyka, które jest ślepe na elegancję biologicznych algorytmów, których AI wciąż nie potrafi skutecznie naśladować. Wątpliwy jest również optymizm dotyczący wpływu AI na ludzki intelekt, poparty przykładem szachistów. Jest to klasyczny błąd przeżywalności. Szachiści to wąska grupa profesjonalistów, dla których AI jest narzędziem treningowym. W skali masowej społeczeństwo nie używa AI jako sparingpartnera, lecz jako protezy myślowej. Analogia do atrofii mięśni jest tu znacznie trafniejsza, niż Dragan chce przyznać. Jeśli maszyna wykonuje za nas syntezę tekstów, krytyczne myślenie i pisanie, to te konkretne 'ścieżki neuronowe' u przeciętnego użytkownika słabną. Zrównywanie arcymistrzów szachowych z przeciętnym uczniem korzystającym z ChatGPT w celu uniknięcia wysiłku jest manipulacją. Równie problematyczny jest mit 'Czarnej Skrzynki' jako argumentu za transcendencją AI. Brak interpretowalności modeli nie jest dowodem na ich wyższą formę inteligencji czy 'obcość', lecz wynika ze specyfiki statystyki w wielowymiarowych przestrzeniach. To, że nie potrafimy prześledzić miliardów operacji mnożenia macierzy w czasie rzeczywistym, nie oznacza, że model 'rozumie' świat w ludzkim sensie. Dragan, zamiast demistyfikować to zjawisko jako naukowiec, używa go do budowania narracji o 'magicznej' inteligencji, co balansuje na granicy argumentu ad ignorantiam. Ostatecznie, definicja inteligencji jako wyłącznie 'dostrzegania analogii' jest skrojona pod to, co aktualnie potrafią robić sieci neuronowe, co czyni argumentację Dragana tautologią: 'AI jest inteligentna, bo zdefiniowałem inteligencję jako to, co robi AI'. Pomija to aspekty takie jak wyznaczanie celów, empatia, intuicja czy subiektywne doświadczenie (qualia). Należy pamiętać, że współczesne AI to w dużej mierze zaawansowana statystyka połączona z programistycznymi sztuczkami. To, co obserwujemy jako 'rozumowanie', to często efekt zewnętrznych struktur programowych, rozwiązań agentowych, pętli i dostępu do narzędzi, bez których sam model językowy pozostaje pasywnym generatorem tekstu. Dziesiątki frameworków powstało tylko po to, żeby móc budować użyteczne narzędzia, które i tak potrzebują w swoich iteracyjnych pętlach działania człowieka. Dragan prezentuje fascynującą, ale skrajnie technokratyczną wizję, w której biologia jest traktowana jako wadliwy prototyp, ignorując fakt, że bez ciągłej, ludzkiej weryfikacji i potężnego zaplecza inżynieryjnego, 'magiczna' sieć neuronowa jest bezradna. Należy też krytycznie spojrzeć na rzekomą nieomylność nowych modeli 'reasoningowych' w świetle danych z Vectara Hallucination Leaderboard. Co kluczowe, benchmark ten bada skuteczność w zadaniach typu RAG (Retrieval-Augmented Generation), czyli w sytuacjach, gdzie model otrzymuje konkretne źródło wiedzy systematycznej i ma jedynie na nim operować. Nawet w tak kontrolowanym środowisku, mając 'podane na tacy' fakty, modele te wciąż konfabulują – wskaźniki halucynacji sięgają kilkunastu procent (np. Grok 4.1 ok. 17%, Claude Opus 4.6 ok. 12,2%). Skoro AI potrafi zmyślać nawet przy prostym przetwarzaniu dostarczonych danych, to narracja o jej wyższych zdolnościach poznawczych i samodzielnym rozumowaniu stoi pod dużym znakiem zapytania. Profesor Dragan mija się również z prawdą, sugerując, że poradziliśmy sobie z ograniczeniami starszych modeli i wyeliminowaliśmy problem wiarygodności. Kolejnym przykładem manipulacji jest odpowiedź Dragana na pytania o kreatywność modeli językowych (LLM). Ucieka on wtedy w argumentację opartą na sukcesach systemów typu AlphaZero, twierdząc, że AI 'nie potrzebuje danych ludzkich'. Jest to fundamentalny błąd kategoryzacji. Dragan miesza systemy oparte na uczeniu ze wzmocnieniem (Reinforcement Learning), które działają w zamkniętych środowiskach o sztywnych regułach (szachy, matematyka) i jasnej funkcji celu, z modelami generatywnymi, które muszą być karmione kulturą, by cokolwiek stworzyć. Używanie sukcesów algorytmów logicznych do udowadniania 'niezależnej kreatywności' modeli językowych, które bez ludzkiego wsadu są bezradne, jest merytorycznym nadużyciem. I tak dalej :) youtu.be/s_nSoJDNonk?si…

🦔 Goldman Sachs has been working with Anthropic for six months to build AI agents that automate accounting and compliance roles. Embedded Anthropic engineers are co-developing autonomous systems for trade accounting, transaction reconciliation, and client onboarding. Goldman's CIO said they were "surprised" at how capable Claude was at tasks beyond coding, especially in areas that combine parsing large amounts of data while applying rules and judgment. The bank expects to launch the agents "soon" and is exploring expansion into employee surveillance and investment banking pitchbooks. Goldman's CEO said in October the bank would "constrain headcount growth" as part of a multiyear plan to reorganize around generative AI. The CIO called it "premature" to expect job losses but acknowledged they could cut third-party providers as the technology matures. My Take "Premature to expect job losses" and "constrain headcount growth" in the same announcement is corporate speak for we're not firing anyone today but we're not hiring their replacements tomorrow. Goldman employs thousands in compliance and accounting. If AI agents can collapse the time these functions take, the math is straightforward even if the timeline isn't. What caught my attention is the surprise that Claude works beyond coding. They tested it for software engineering and found it handled rules-based work like accounting and compliance just as well. That's the SaaS disruption story playing out inside a bank. The same capabilities hitting legal software stocks this week are now being deployed against back-office functions at one of the largest financial institutions in the world. An IT veteran with 20 years experience said he's never seen anything like the disruption already underway. The question isn't whether these roles change. It's how fast, and whether anyone has a plan for the people currently doing the work. Hedgie🤗