核桃壳(观星者) | hetaodao.eth

1.5K posts

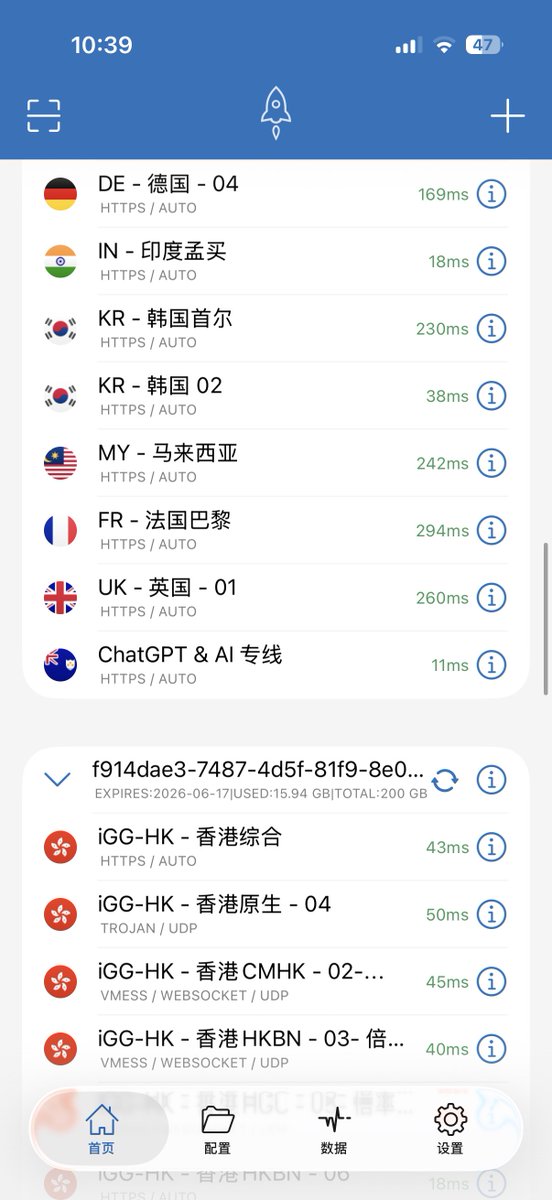

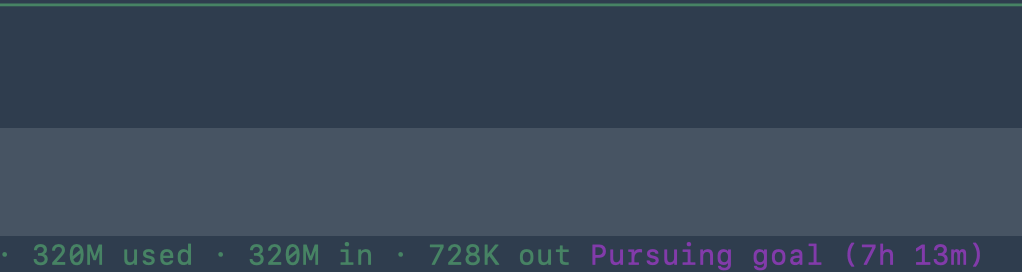

iPad mini 才是最好的监控面板。让 Mac 上的 Codex 在终端执行 /goal 跑长任务,然后投屏到 iPad mini 监控,已经“Pursuing goal”31分钟了!

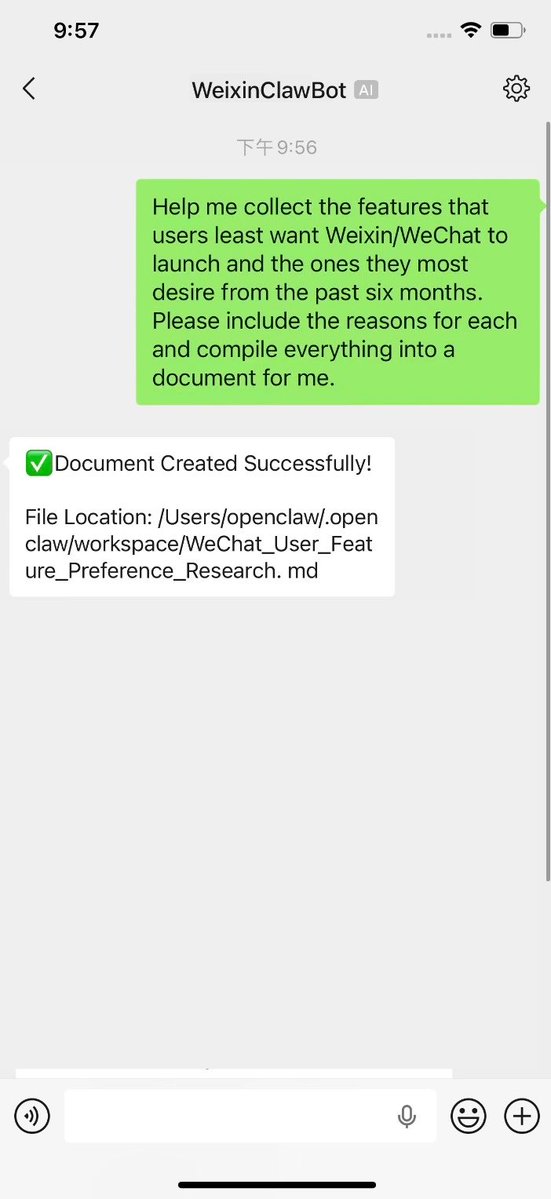

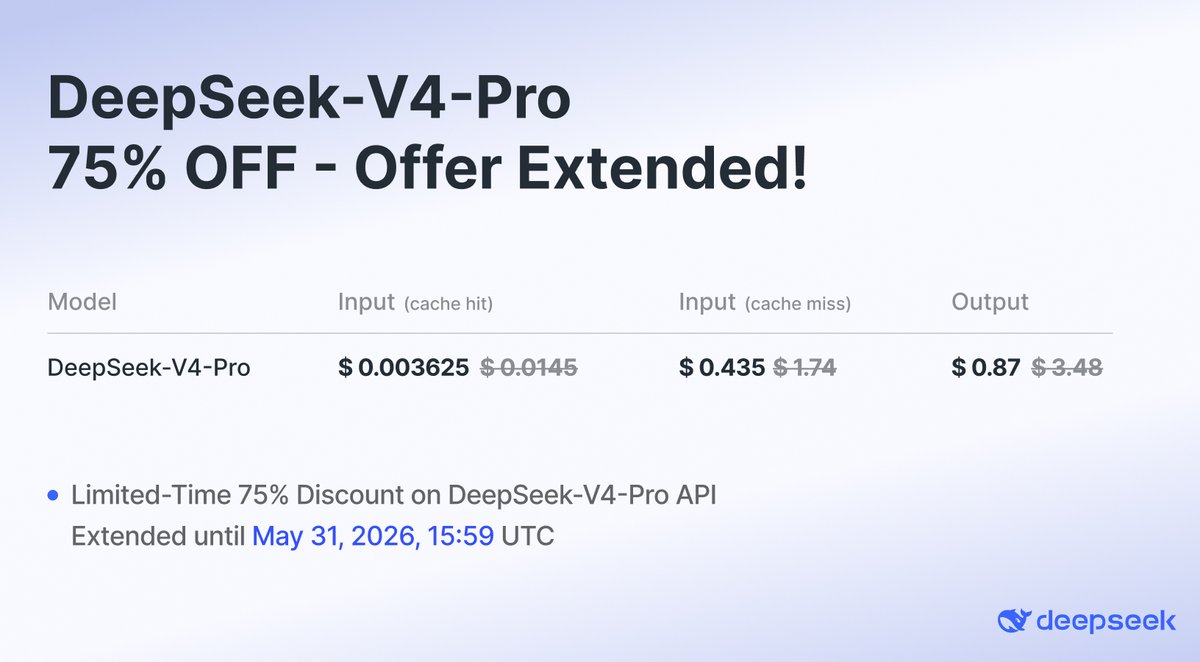

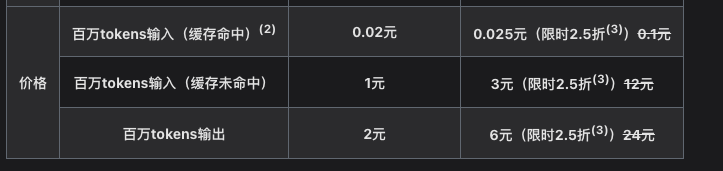

🔥DeepSeek-V4-Pro API is 75% OFF until May 5th, 2026, 15:59 (UTC Time)! Don't miss out on this massive discount. 🛠️Integration Updates: 🔹Claude Code: Set model to deepseek-v4-pro[1m] to unlock 1M context! 🔹OpenCode: Update to v1.14.24+ 🔹OpenClaw: Update to v2026.4.24+ Check the latest official API docs for full details: api-docs.deepseek.com/quick_start/pr…

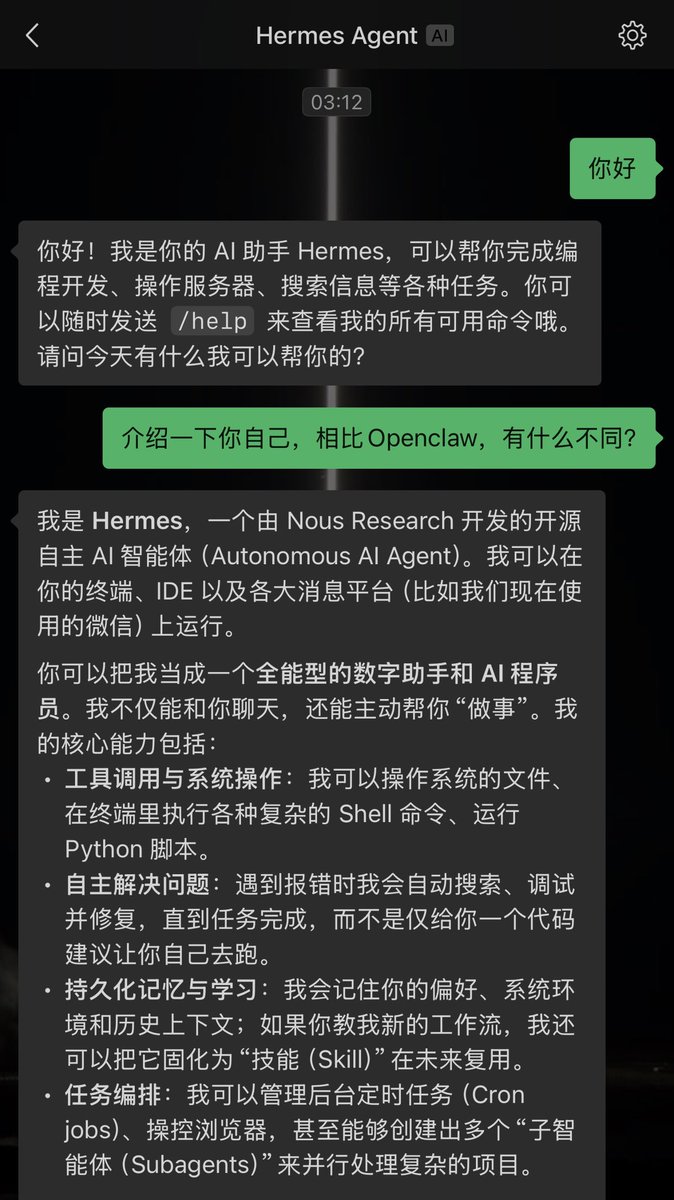

刚才一不小心更新了Openclaw,结果... Gateway打不开,进程秒断,搞了半天发现无法修复后,忍痛宰了这只养了3个月的龙虾... 清蒸的,还加了蒜蓉...

还是 DeepSeek 凶猛啊,你们不是嫌我贵? DeepSeek V4 Pro 2.5折活动启动!🤣 真铁血硬汉子!

自从马云重新现身后, 蚂蚁集团一直猛冲AI,大动作不断! 像是卯足劲在追赶阿里QWEN! 最近更是连发两款实用拉满的模型!!! 先是百B级的 Ling 2.6 Flash, 盲测阶段就冲上 OpenRouter 趋势榜第一, 直接火到了海外!! 还不算完,@AntLingAGI 今天又甩出一张底牌: Ling 2.6 1T ! 名字就能看得出来,这个模型能力会更强!! 但有一个误区:能力强的不一定是思考模型! Ling 2.6 1T 不靠拉长推理链条来显得"很聪明", 而是把 token 更多花在理解、规划和输出上。 换句话来说: 它的核心定位,是面向复杂任务,是精准指令下的执行模型!! 1M 超长上下文,能把会议纪要、群聊记录、项目文档、零散资料一次性扔进去统一处理。 强工具调用能力,可以接进 OpenClaw、Hermes、LangGraph、Dify 等跑工作流。 真实问题处理,不只生成漂亮 demo,而是能够读懂已有代码,按照你的要求去干活。 Token 效率更高,不默认展开超长思考,成本控制到最低。 最近一段时间都是免费用,不用白不用, 我拿了几个真实任务跑了一遍,感受超级明显—— 如果是模糊的指令,它可能不太适合。 但如果是比较详细的指令,给它一个工作流, 就完全起飞了!! 没有了推理过程,感觉非常丝滑, 这一点,就挺重要的!! 减少了很多“AI自作聪明”的麻烦!! 说回蚂蚁这两款模型, 完全是冲着落地应用来的,几乎把简单和复杂的应用场景全部包圆。 1T 负责理解复杂目标、拆解任务、整理材料、制定计划。 Flash 负责快速执行、快速改写、快速补全。 这精准切入了现在大多数人用AI的“痒点”: 总想着用一个“最强模型”解决所有的事情。 但我认为真正重要并且正确的是: 让对的模型干对的事。 这样无论是速度、成本、还是结果一致性,都更能符合预期。