WaitState

57 posts

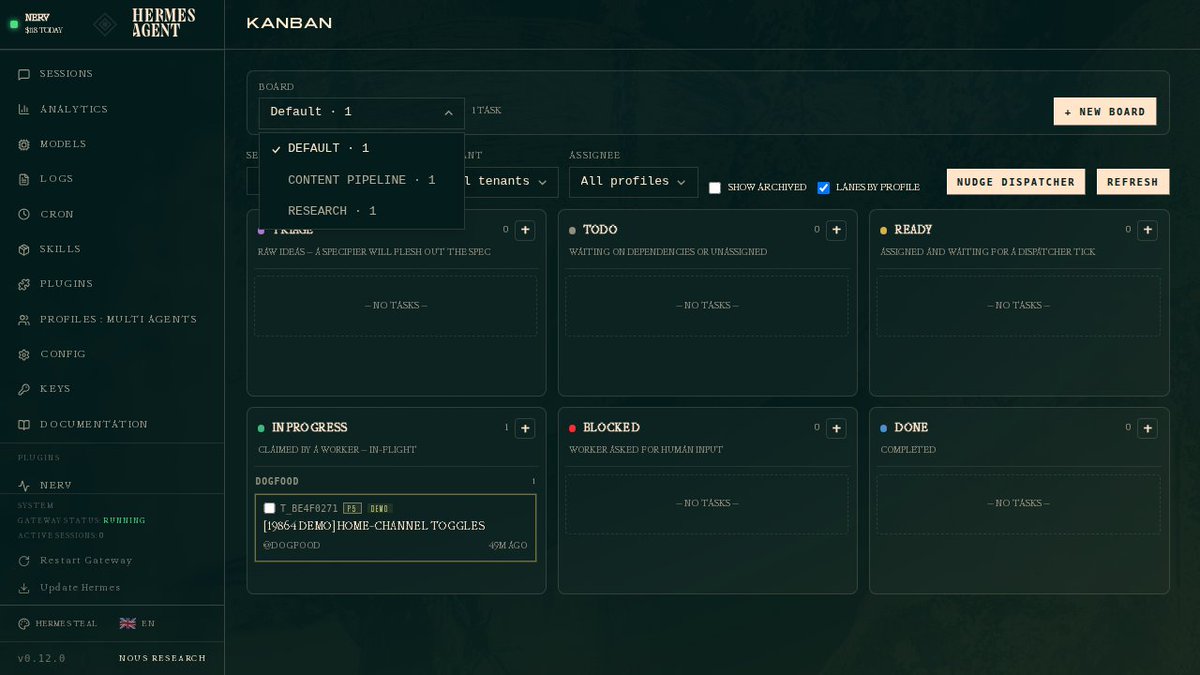

DeepSeek V4 Pro'yu denemeye başladım. Windows ortamında ayarlamak bir tık farklı. İki yol var. Claude CLI için en iyisi powershell profiline aşağıdaki gibi bir function eklemek👇 gist.github.com/Blind-Striker/… Onun haricinde Github Copilot eklentisi var, official yok ama benim denediğim👇 marketplace.visualstudio.com/items?itemName…

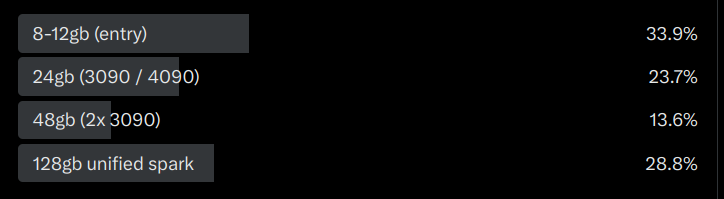

drop your vote on the next benchmark sweep. which vram tier should i test local ai models + tool calls on?

"You need a 24 GB GPU for serious local LLMs in 2026." Everyone repeats this. It's not true anymore. Just ran a 35B-parameter model on an RTX 4060 Ti 8 GB: • 41 tok/s at 16k context • 24 tok/s at 200k context Recipe + benchmarks below 🧵

@emrekocbi maalesef gercek disi biri tweet adamin attigi, llama modeli 70b modelini 64gb macbookta ancak 4bit quantta load edebilir onunla da hicbir sey yapamaz