z retweetledi

z

3.3K posts

z retweetledi

z retweetledi

OpenAI 后训练核心成员翁家翌(Jiayi Weng)以个人名义提出了一种名为「启发式学习」的强化学习新范式,并开源了全部实验代码。他用 Codex(GPT-5.4)反复玩 Atari 打砖块游戏,但 GPT-5.4 自始至终没有被重新训练过。真正在进步的,是 GPT-5.4 写出来的那套游戏策略代码。

流程是这样的:GPT-5.4 先写一版打砖块的 Python 策略,跑一局,看录像,找出哪里打丢了球,然后自己改代码再跑。经过几轮迭代,策略代码从 387 分涨到了 864 满分。全程没有任何神经网络被训练,纯靠 AI 反复修改 if-else 规则、调落点预测、加死循环检测。最终那套代码包含球路预测器、卡球检测器、回归测试和实验日志,已经长成了一个完整的软件系统。

这和传统强化学习的核心区别在于「学到的东西存在哪」。传统做法把知识压进神经网络参数里,人看不懂,学新任务还容易把旧的覆盖掉(即灾难性遗忘)。翁家翌的做法反过来:知识就是代码,人能读、能改、能加测试锁住,不会因为学新东西就丢了旧本领。

除了打砖块满分,他还在 MuJoCo Ant(模拟机器蚂蚁走路)上跑出超 6000 分的深度强化学习级成绩,在 Atari57 全套 57 个游戏上逼近了 PPO 基准。但翁家翌也明确画了边界:纯代码搞不定复杂感知任务,比如用 Python 写 if-else 去认图片。

他设想的终局是混合架构:底层用轻量神经网络负责视觉等感知,中层用启发式学习处理实时逻辑和安全规则,顶层由大模型审查日志、改代码,再周期性地用底层积累的高质量数据更新自身。过去手写规则之所以被淘汰,不是因为规则没用,而是人类维护不起。现在 AI 写代码够快够好,这条老路重新走得通了。

Jiayi Weng@Trinkle23897

Codex grew programmatic policies with no neural nets: max score on Breakout, and SOTA-level scores on MuJoCo. Maybe heuristics were not too weak. Maybe they were just too expensive to maintain. Maybe it's the next paradigm. trinkle23897.github.io/learning-beyon…

中文

z retweetledi

z retweetledi

@OpenAI Here is the link btw

chromewebstore.google.com/detail/codex/h…

English

z retweetledi

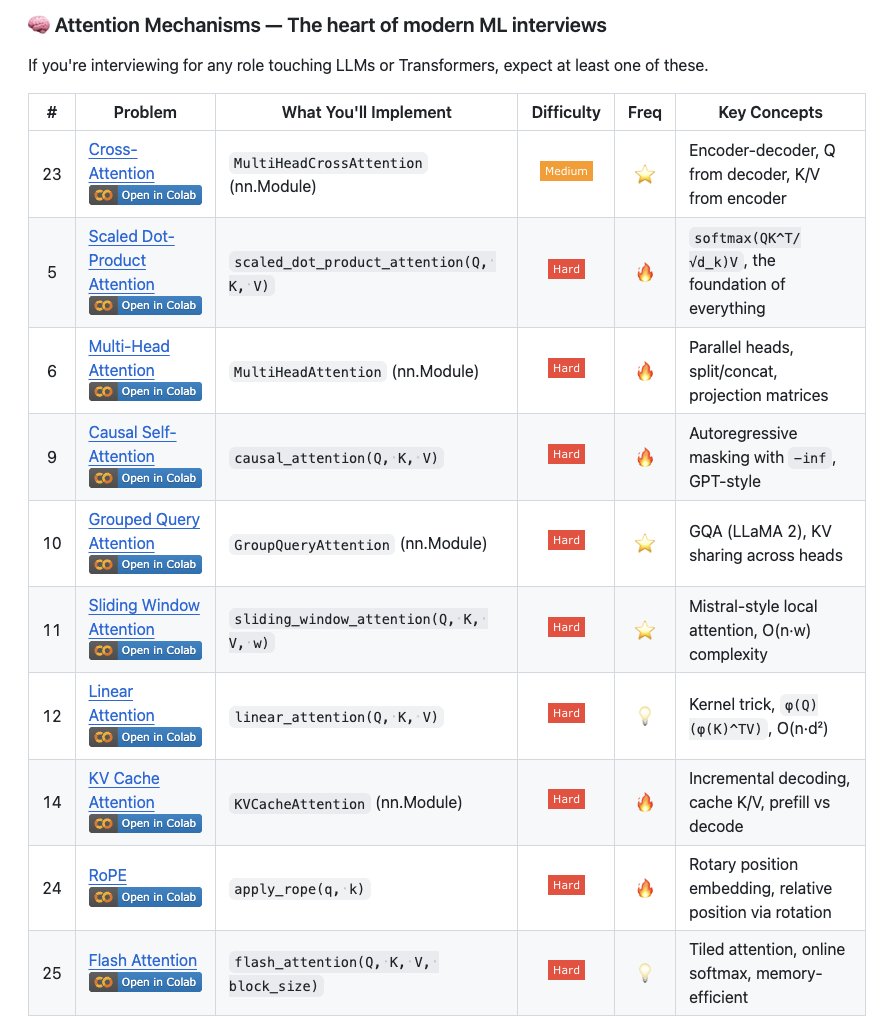

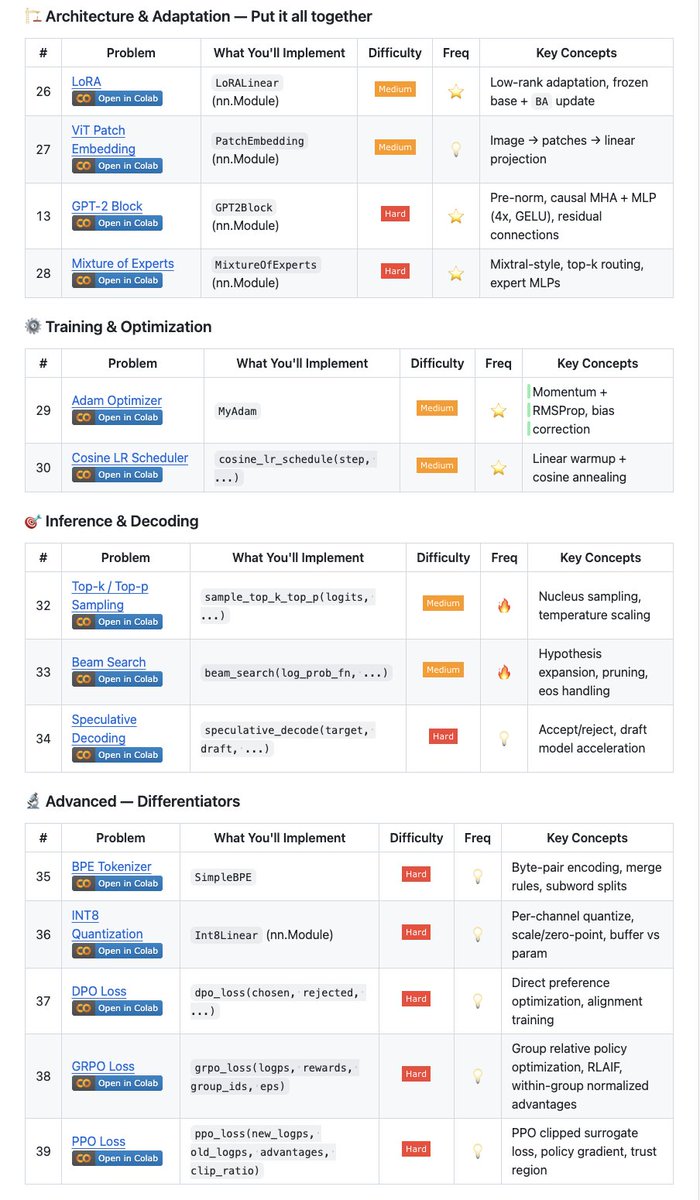

大模型算法岗面试最窒息的瞬间:面试官递来一支笔,让你在白板上徒手写 Attention / Transformer。

平时习惯了 PyTorch 的封装 API,一旦脱离框架从底层手搓算子,很容易当场断片:公式记得,细节全丢;能写思路,写不出对的实现。

TorchCode 是我在 GitHub 上挖到的一个开源刷题平台,专为 PyTorch 面试场景打造:把“手写深度学习算子”做成像 LeetCode 一样的训练。

基于 Jupyter 环境,精选 40 道题,覆盖基础算子、注意力机制、完整架构、训练优化等高频核心点。

GitHub:github.com/duoan/TorchCode

每题自带自动评测:实时核对输出正确性、梯度流是否正常、数值稳定性是否过关,彩色通过/失败反馈,写完立刻知道哪里炸了。

卡住可看提示;做完能对照参考实现学更优写法;还有进度追踪,清楚记录你刷到哪、弱点在哪。

部署也省心:Docker 一键起;也可直接用 Hugging Face Spaces 在线跑;每题支持一键在 Google Colab 打开,不用折腾本地环境。

如果你想把大模型底层真正吃透,或正在冲刺 AI 岗面试,这套题库很值得完整刷一遍。

中文

z retweetledi

z retweetledi

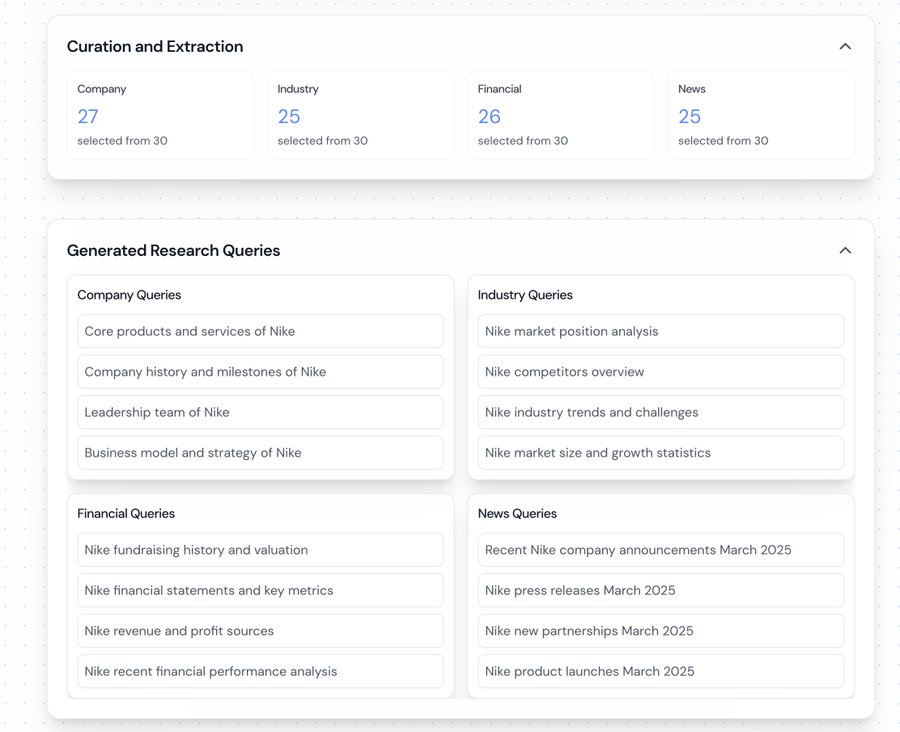

面试前大家都会先摸清公司底细。国内用天眼查是方便,但想看完整信息往往要付不小的费用;自己手动搜又耗时耗力。

推荐一个更省事的开源项目:Agentic Company Researcher。输入公司信息,一键生成结构完整、信息密度高的公司研究报告。

它把多个 AI 智能体分工协作,从公司官网、新闻、财报等渠道自动抓取资料,再结合 Gemini 与 ChatGPT 做筛选、归纳和整合,最终输出一份可直接拿去面试准备的高质量报告。

GitHub:github.com/pogjester/comp…

主要亮点:

- 多源自动采集:官网、新闻、财报统一汇总

- Tavily 内容筛选:过滤噪音,保留高相关信息

- 流式进度展示:边跑边看,随时掌握进展

- 双模型协同:Gemini 负责吞吐与整理,GPT-4.1 负责精排与成稿

- React 现代前端:实时更新,支持下载

- 模块化智能体:易扩展、易定制,方便按需加能力

使用也很简单:克隆到本地,配置好 API Key,即可开跑。

中文

z retweetledi

找机器学习资料时,总会遇到同一个问题:教程讲得最多的是怎么训练模型,却很少告诉你怎么把模型真正送上生产环境、稳定跑起来。

这时就很值得看一眼哈佛大学开源教材《Machine Learning Systems》:不止教你做模型,更教你把 AI 系统从 0 到 1 落地。

它覆盖从边缘设备到云端部署的完整技术栈,配套大量实践项目与动手实验,帮你把“会训练”升级为“能上线、可维护、可扩展”。

GitHub:github.com/harvard-edge/c…

你会学到:

- 系统设计:可扩展、可维护的 ML 架构方法论

- 数据工程:数据采集、标注、处理的全流程

- 模型部署:从原型走向生产的部署最佳实践

- MLOps 监控:让系统长期可靠运行的监控与治理

- 边缘 AI:移动端、嵌入式、物联网的高效部署

- 实践项目:TinyTorch 框架 + 配套实验,边学边做

支持在线阅读和 PDF 下载,适合想系统掌握 AI 系统工程全栈能力的人直接收藏。

中文

z retweetledi

z retweetledi

Engineers at OpenAI experience the same problem as everyone else — we can supervise about 3–5 coding agents. After that productivity drops. Codex is smart, but our attention is limited.

So we built (and open sourced!) Symphony to remove that ceiling. Here’s how it works:

OpenAI Developers@OpenAIDevs

📣 What if every open issue had a Codex agent? That’s the idea behind Symphony, an open-source agent orchestrator for Codex that turns task trackers into always-on systems for agentic work, letting humans focus on review and direction.

English