Roberto Mendoza

18K posts

Roberto Mendoza

@robcmendozap

📍🇨🇱 Name? ☝🏻; 31years...Developer. Whatever you are, be a good one-AL-...

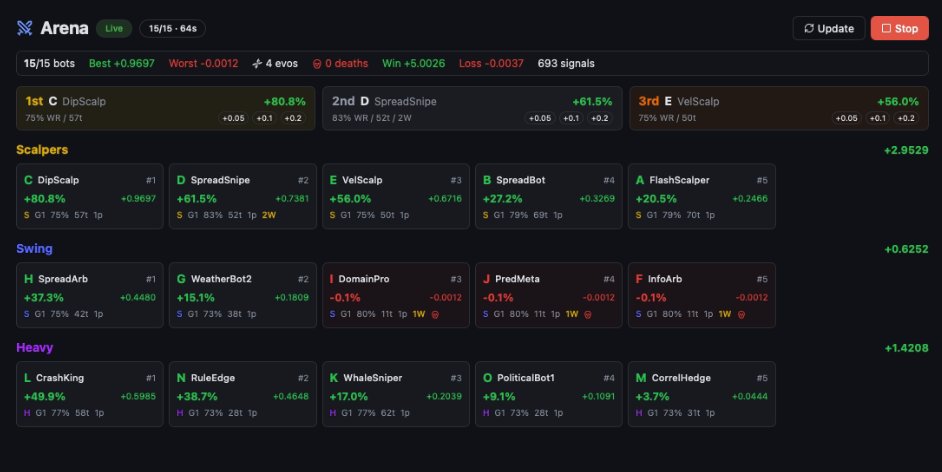

😅 Okey, no me esperaba esta reacción. Os cuento que he estado haciendo números y recorriéndome diferentes proveedores comparando precios y demás. En EU, con un server con una GPU NVIDIA RTX PRO 6000 Blackwell Max-Q con 96 GB de VRAM. Nos saldría por cabeza ~70€/mes si somos unos 20. Eso si con Ollama se nos quedaría corto y tendría que hacer un setup más fino para que nos sobre cómputo si es posible pero de eso me encargo, no hay problema con eso. Con esto podríamos estar corriendo modelos como Qwen3.5-35B, Gemma 4 26B MoE y GLM-4.7-Flash al mismo tiempo sobrados. Y obviamente todo esto sin limites de tokens como los proveedores actuales. Podríamos estar quemando tokens 24/7 sin problema. En LATAM en cuanto tenga un hueco veo que proveedores me ofrecen los mejores precios para poder montar algo similar allí. Lo suyo para users de LATAM sería montarlo en la misma región para evitar latencias. Ahora haciendo números me parece top esto, voy a crear un discord para sacar estas comunicaciones de aquí a algo más cerrado. Si os interesa ir comentando por aquí también y os paso el link en cuanto lo tenga creado.

🤔 Saben que estaría bien? Juntarnos unos 5/10 locos que estemos desarrollando a full cosas con IA y nos montemos una mini comunidad para pagar un buen server privado con GPUs para poder quemar tokens como locos con modelos locales. Yo creo que entre unos 5/10 que nos juntemos nos sale casi regalado todo. Se apuntarían? Yo me comprometo a montar el server y disponibilizo los modelos que queramos con Ollama en 2 minutos para que puedan acceder a ellos en un momento de forma privada desde cualquier sitio.

Si aceptas consejos, este tuit te va a cambiar la vida: CLAUDE CODE.

@7uanF Ya acabo de aprender a deployar en Vercel y funcionó. Me encantó la forma en que me creó todo el proyecto de prueba. Ya tengo muchas nuevas ideas 😉

No puedo esperar llegar a la casa hoy para instalar la RTX 5090 🥹 Miren el tamaño de esa vaina LOL