zhenyi.eth

105 posts

zhenyi.eth

@soczhenyi

Co-Founder of @TurtlecaseGang | Author of ERC721G | Crypto | AI | 🏀 | 🏎 | 📷 | 📚 | 🎮 | ☀️ | Olympiad in Informatics/ICPC | BUIDLer | $TCGOG holder

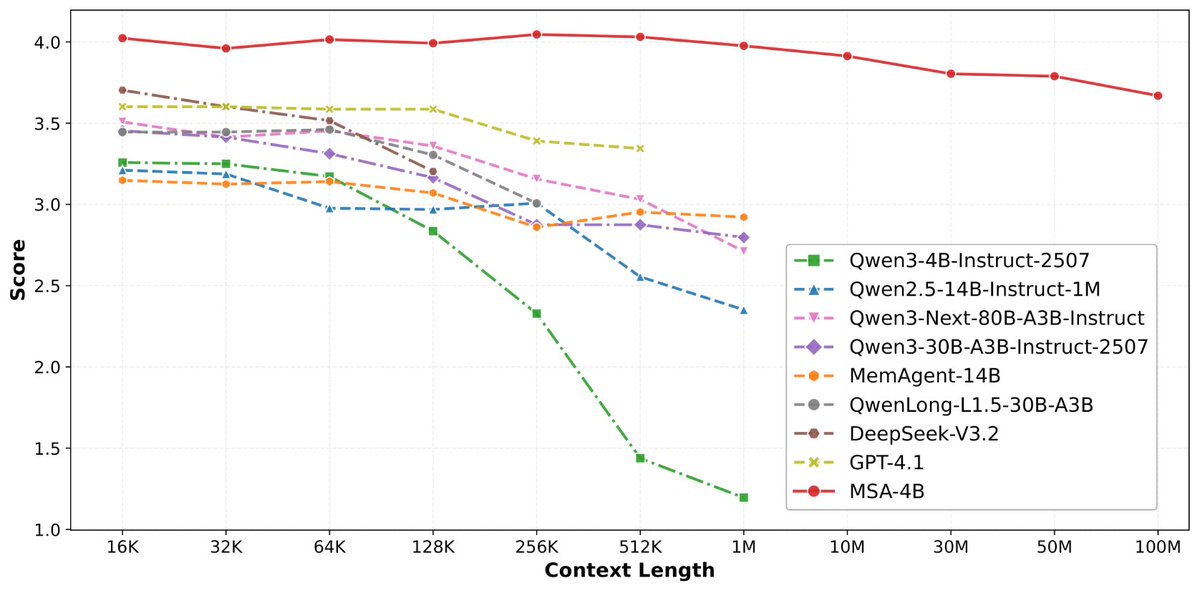

论文来了。名字叫 MSA,Memory Sparse Attention。 一句话说清楚它是什么: 让大模型原生拥有超长记忆。不是外挂检索,不是暴力扩窗口,而是把「记忆」直接长进了注意力机制里,端到端训练。 过去的方案为什么不行? RAG 的本质是「开卷考试」。模型自己不记东西,全靠现场翻笔记。翻得准不准要看检索质量,翻得快不快要看数据量。一旦信息分散在几十份文档里、需要跨文档推理,就抓瞎了。 线性注意力和 KV 缓存的本质是「压缩记忆」。记是记了,但越压越糊,长了就丢。 MSA 的思路完全不同: → 不压缩,不外挂,而是让模型学会「挑重点看」 核心是一种可扩展的稀疏注意力架构,复杂度是线性的。记忆量翻 10 倍,计算成本不会指数爆炸。 → 模型知道「这段记忆来自哪、什么时候的」 用了一种叫 document-wise RoPE 的位置编码,让模型天然理解文档边界和时间顺序。 → 碎片化的信息也能串起来推理 Memory Interleaving 机制,让模型能在散落各处的记忆片段之间做多跳推理。不是只找到一条相关记录,而是把线索串成链。 结果呢? · 从 16K 扩到 1 亿 token,精度衰减不到 9% · 4B 参数的 MSA 模型,在长上下文 benchmark 上打赢 235B 级别的顶级 RAG 系统 · 2 张 A800 就能跑 1 亿 token 推理。这不是实验室专属,这是创业公司买得起的成本。 说白了,以前的大模型是一个极度聪明但只有金鱼记忆的天才。MSA 想做的事情是,让它真正「记住」。 我们放 github 上了,算法的同学不容易,可以点颗星星支持一下。🌟👀🙏 github.com/EverMind-AI/MSA

稍微剧透一下,@EverMind 这周还会发一篇高质量论文

🚀 Day 0: Warming up for #OpenSourceWeek! We're a tiny team @deepseek_ai exploring AGI. Starting next week, we'll be open-sourcing 5 repos, sharing our small but sincere progress with full transparency. These humble building blocks in our online service have been documented, deployed and battle-tested in production. As part of the open-source community, we believe that every line shared becomes collective momentum that accelerates the journey. Daily unlocks are coming soon. No ivory towers - just pure garage-energy and community-driven innovation.

One application of AI that I am excited about is AI-assisted formal verification of code and bug finding. Right now ethereum's biggest technical risk probably is bugs in code, and anything that could significantly change the game on that would be amazing.

🚀 Exciting news for developers! We're proud to announce the open sourcing of 'Smart Intermediate Representation' - a cutting-edge compiler framework that redefines contract development with security, efficiency, rollup friendly, and AI friendly. Dive into the future of compiler technology with us! 🌐 Read more: link.medium.com/1PHDXTFe3Fb #Web3 #developer #tools #smartcontract #Blockchain

1. Assembly (8080, later 68000, x86, ...) 2. Basic 3. Pascal 4. Modula-2 5. C 6. Lisp/Scheme 7. Ada 8. Perl 9. Miranda 10. C++ 11. Self 12. Cecil 13. Modula-3 14. Java 15. Javascript 16. Python 17. Go Fun! (Written/worked on compilers or interpreters for 6, 10, 11, 12, 13, 14)