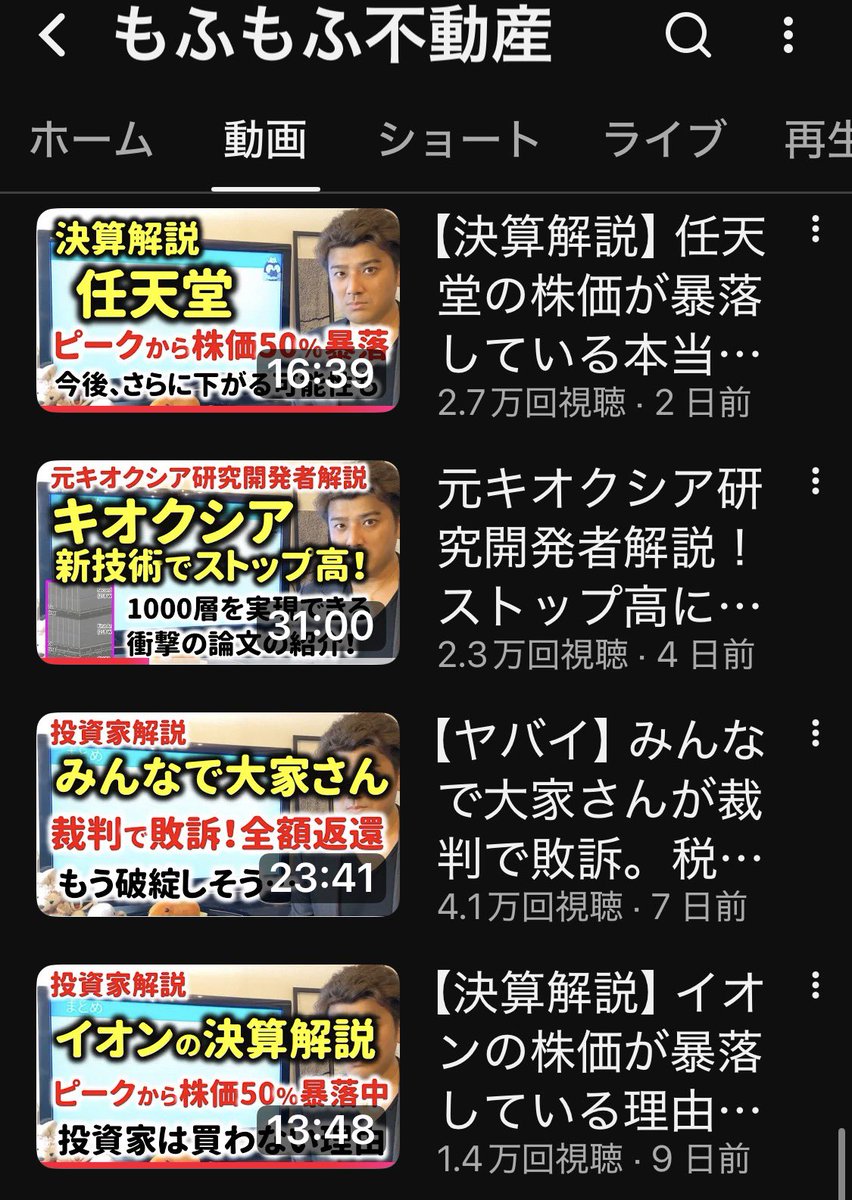

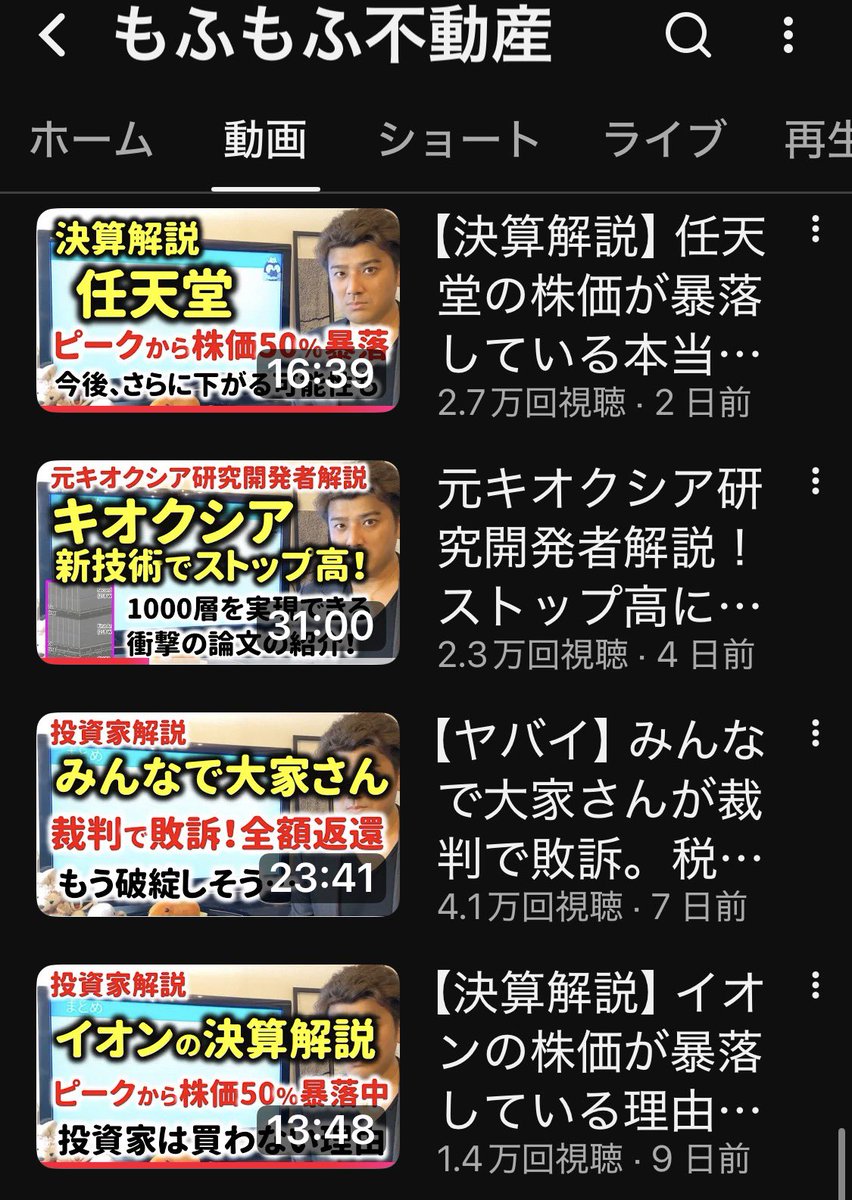

これ、YouTubeコンサルだった私の推測ですが、過去11年のYouTubeのやり方を見てると、ある日「AIサムネの動画を一斉にインプさげる」みたいなことをやる気がする。過去に「本編にないシーン」のサムネを釣り動画認定したこともあったんでね。コツコツ手作りしてるほうが、あとあと効いてくる… かも。

がっちゃ

365.6K posts

@take_gattcha

なんちゃって Device Driver Engineer, Windows, Linux, Embedded, Firmware, Low-layer... RT 専門。稀にポスト。RT は私が好きなこと。気になること。どうでもいいけどなんとなく。議論は参加しません。

これ、YouTubeコンサルだった私の推測ですが、過去11年のYouTubeのやり方を見てると、ある日「AIサムネの動画を一斉にインプさげる」みたいなことをやる気がする。過去に「本編にないシーン」のサムネを釣り動画認定したこともあったんでね。コツコツ手作りしてるほうが、あとあと効いてくる… かも。

僕のレシピが嫌いなのは全然良い、でも 「鯛一匹でご飯とおかずと汁物を検索せずに作れたらギリ料理の入り口」 は違う 昔の人が料理のハードルを上げすぎたから作る人が苦労する世の中になった 料理を一部の人のもんにしちゃダメ 簡単でも自分が旨いと思うもん作れたらそれは立派な料理です

Today we’re launching the OpenAI Deployment Company to help businesses build and deploy AI. It's majority-owned and controlled by OpenAI. It brings together 19 leading investment firms, consultancies, and system integrators to help organizations deploy frontier AI to production for business impact. openai.com/index/openai-l…

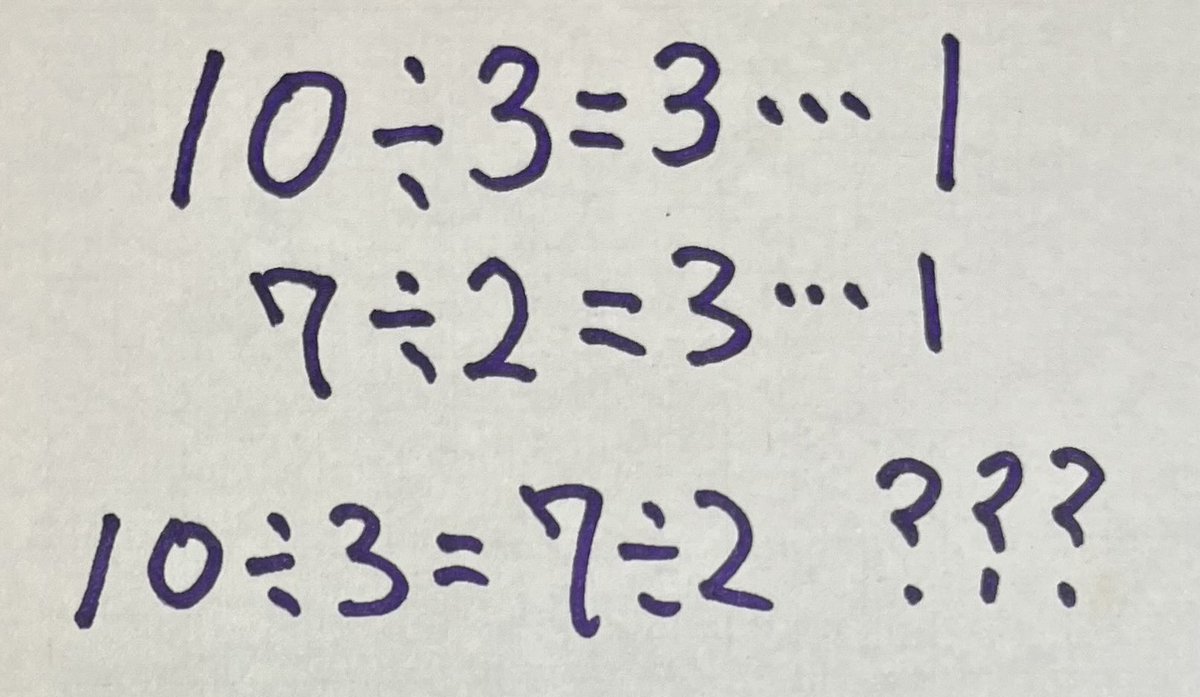

数学をやっていると、コンセンサスの取れていない記法がたくさんある。だから、記法の意味は逐一説明すべきだし、説明されていない記法についてはいくらでも質問していいはずだ。にもかかわらず、高校までの数学では、あたかも数学にはコンセンサスの取れた記法しか存在しないかのような印象を受ける。