tzwm

15.8K posts

我在阿里云 k8s 上日常使用的能力原来并不是公有云们都有的基础能力吗 🤔

Ayaan 🐧@twtayaan

🚨 S3 is no longer just Object Storage. Yesterday (April 7, 2026), AWS officially launched Amazon S3 Files. This is the biggest update to S3 in 20 years. It can: → Mount S3 buckets as native file systems → Provide sub-millisecond file access → Handle POSIX permissions (UID/GID) natively → Connect to Lambda, EC2, and EKS directly → Eliminate the need for s3fs or data staging Your AI agents can read/write to S3 like a local disk, while your data team access the same objects via API. DevOps just got a massive upgrade. Source: share.google/ts8JORn6SURzwM…

中文

tzwm retweetledi

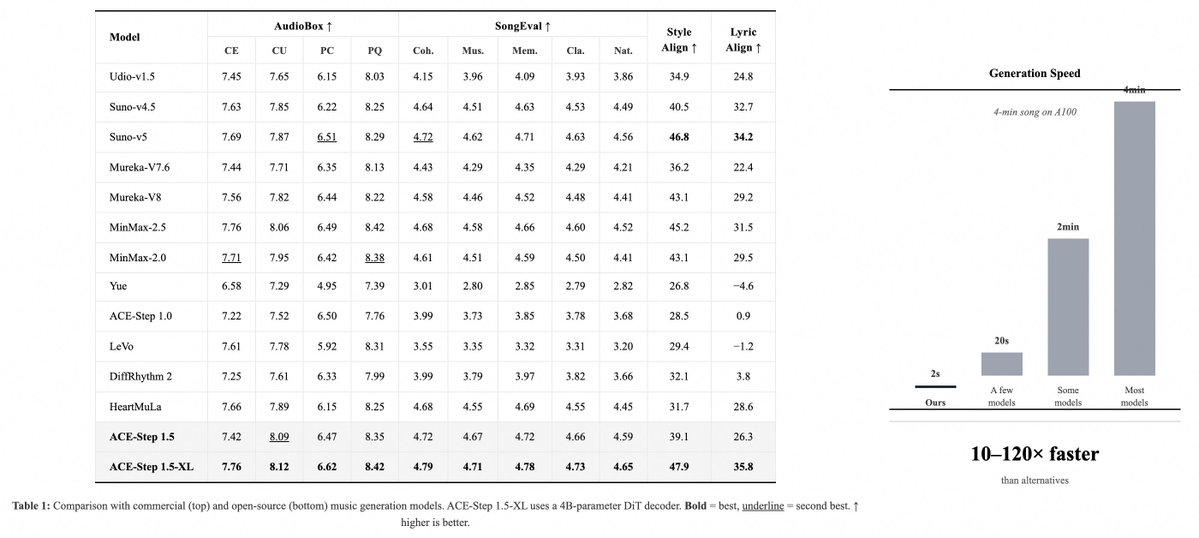

ACE-Step 1.5 XL is open-source! 4B DiT decoder, three variants. 🚀

Beats Suno v5 on SongEval (4.79 vs 4.72), Style Align 47.9 — #1 across all models tested.

From 12GB VRAM (INT8 offload) to 24GB full quality. MIT license. Commercial-safe training data.

Three variants, three use cases:

✅ XL Base — all tasks (extract, Lego, completion), high diversity, best for fine-tuning

✅ XL SFT — highest audio quality, CFG guidance scale control

✅ XL Turbo — 8-step distilled, fastest, no CFG (early release)

All compatible with LM 0.6B / 1.7B / 4B.

🤖 Base: modelscope.ai/models/ACE-Ste…

🤖 SFT: modelscope.ai/models/ACE-Ste…

🤖 Turbo: modelscope.ai/models/ACE-Ste…

English