Seiji Maekawa

310 posts

Seiji Maekawa

@SAYg_7

Research Scientist @ Megagon Labs, US. My research interests include RAG and function calling in LLMs. 七帝柔道を応援しています。

เข้าร่วม Haziran 2014

174 กำลังติดตาม254 ผู้ติดตาม

ทวีตที่ปักหมุด

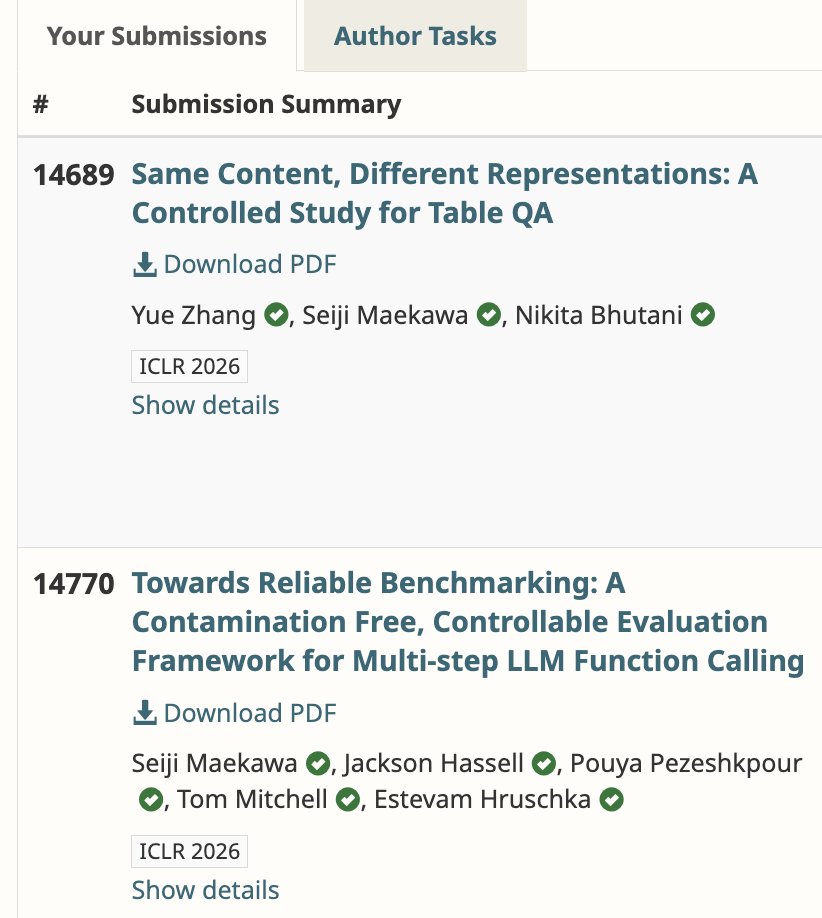

Two papers have been accepted to #ICLR2026 🥳 (1 x first-author, 1 x primary mentor)

Huge kudos to all the co-authors!

English

Seiji Maekawa รีทวีตแล้ว

📕 “Efficient Context Selection for Long-Context QA: No Tuning, No Iteration, Just Adaptive‑k”

Oral presentation @ Question Answering

11/5 Wed. 15:15

📄arxiv: arxiv.org/abs/2506.08479

⚙️code: github.com/megagonlabs/ad…

English

Megagon Labs ではインターンを募集しています!

シリコンバレーでNLP/LLMsや複合AI Systemsの研究をしてみたい学生の方、ぜひ検討してみてください。期間や時期等、相談したいことがあればぜひ連絡ください!

Megagon Labs@MegagonLabs

📢 Internship applications are now open for the Summer 2026 term. Join Megagon Labs to research: 💠LLMs & NLP 💠Human-centered AI 💠Data AI 💠Compound AI Systems Interns at Megagon Labs work alongside our research teams, advancing projects that bridge academic research and real-world impact. Read about their experiences: megagon.ai/2025-internshi… 👉 Apply here: megagon.ai/careers/ #AI #NLP #Internships #LLMs

日本語

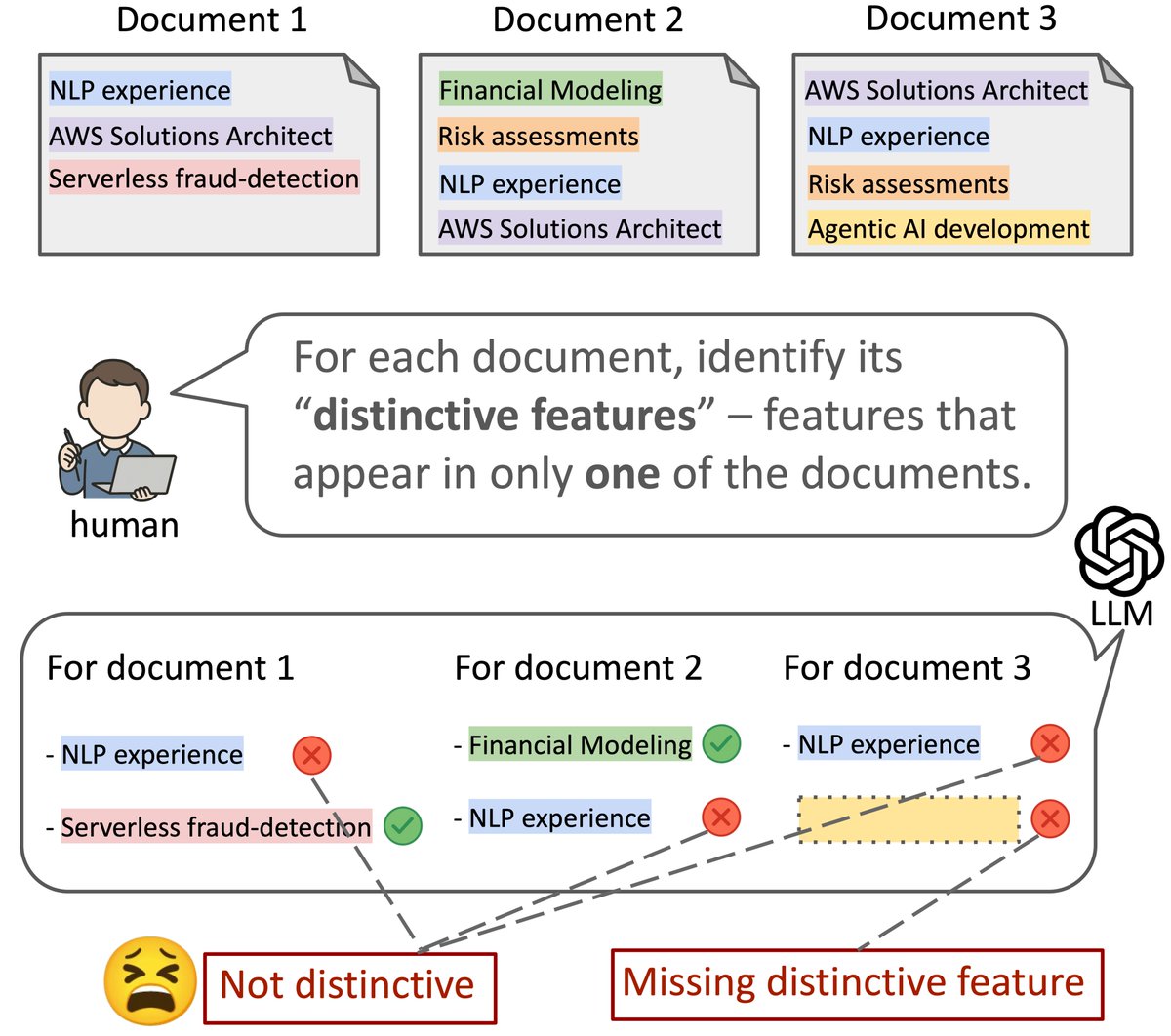

📢 New Preprint: The Rarity Blind Spot

How well do LLMs find globally distinctive features?🤔

Even top reasoning models drop from high F1 on 10 docs to much lower on 40 docs, and 75.9% of mistakes are false “distinctive” picks. Verification helps—+65% F1.

arxiv.org/abs/2509.00245

English

We have released the code: github.com/megagonlabs/Di…

Huge kudos to my co-authors, Hayate(@iso_map) and Nikita 🥳

English

📢 New Preprint:

Can LLMs reliably plan long chains of tool calls?🧐 We introduce FuncBenchGen, which generates contamination-free tasks with controllable depth/size/distractors. Even GPT-5 falters on long chains; restating known variables helps a lot😎

arxiv.org/abs/2509.26553

English

Seiji Maekawa รีทวีตแล้ว

Seiji Maekawa รีทวีตแล้ว

Our paper “Efficient Context Selection for Long-Context QA: No Tuning, No Iteration, Just Adaptive-k” was accepted to #EMNLP2025!

The idea is simple: in retrieval-augmented QA, instead of always using a fixed number of passages, let’s adaptively select the optimal amount of context per query.

✨ Adaptive-k does precisely that — one pass, no tuning, no iterative prompting.

It cuts token usage by up to 10×, keeps ~70% of relevant passages, and even boosts accuracy on both factoid and aggregation QA.

Sometimes the most effective solutions are also the simplest.

📄 megagon.ai/publications/l…

Written by Chihiro Taguchi, @SAYg_7, and @nikita_bhutani

#LLMs #NLProc #EMNLP25 #RAG #AIResearch #AI #phd

English

Our paper is accepted to the main conference of EMNLP 2025🎉

This is my first paper as the primary mentor of an intern! I’d like to send huge kudos to @taguchi_c for the amazing work and dedication👏

arxiv.org/abs/2506.08479

English

Seiji Maekawa รีทวีตแล้ว

A Healing Break for My Brave Girl

Our 12-year-old daughter has been bravely battling osteosarcoma (bone cancer) since January 2025, and we have a small favor to ask.

caringbridge.org/site/b0895f78-…

English

Seiji Maekawa รีทวีตแล้ว

Seiji Maekawa รีทวีตแล้ว

前川さんのNLPコロキウムでのトークを公開しています→ 📺youtu.be/UAAcrgIADSQ

当日参加できなかったかたもぜひご覧ください!

※ なおQA・ディスカッションは公開しておりません。

またスライドも公開いただきました。あわせてご覧ください → github.com/seijimaekawa/s…

YouTube

日本語

私が講師を務めたDEIM2023でのチュートリアル「グラフ深層学習のすゝめ」が(チャンネルの紹介動画を除いて)最も再生されています。試聴していただいた方ありがとうございます!

名だたる先生たちの動画が並ぶ中なので、正直に驚いています。博士研究の集大成が数千人の方に見られていて感動です。

Seiji Maekawa@SAYg_7

さっそくDEIMのチュートリアル「グラフ深層学習のすゝめ。」の動画を公開してもらいました!グラフに興味がある方もない方もぜひ見てみてください! 僭越ながら講師を務めさせていただいています。

日本語

NLPコロキウムありがとうございました!たくさんの面白い質問や指摘をいただき楽しかったです!

運営と参加者の皆様に感謝です🙏

NLPコロキウム@nlp_colloquium

前川さんに、時間内に触れられなかった Dory の質問にもご回答いただきました 📝ありがとうございます! ※ メーリングリストでお送りした URL からご覧ください。

日本語

Seiji Maekawa รีทวีตแล้ว

If you're interested in how LLMs handle the' messy, ambiguous nature of multi-document inputs and where they fall short, this is for you.

#NAACL2025 #ICLR2025 #LLMs #MultiDocument #Summarization #Reasoning #NLPResearch #MegagonLabs #AI #MachineLearning #NLP @PPezeshkpour @SAYg_7 @estevamhruschka

megagon.ai/multi-document…

English

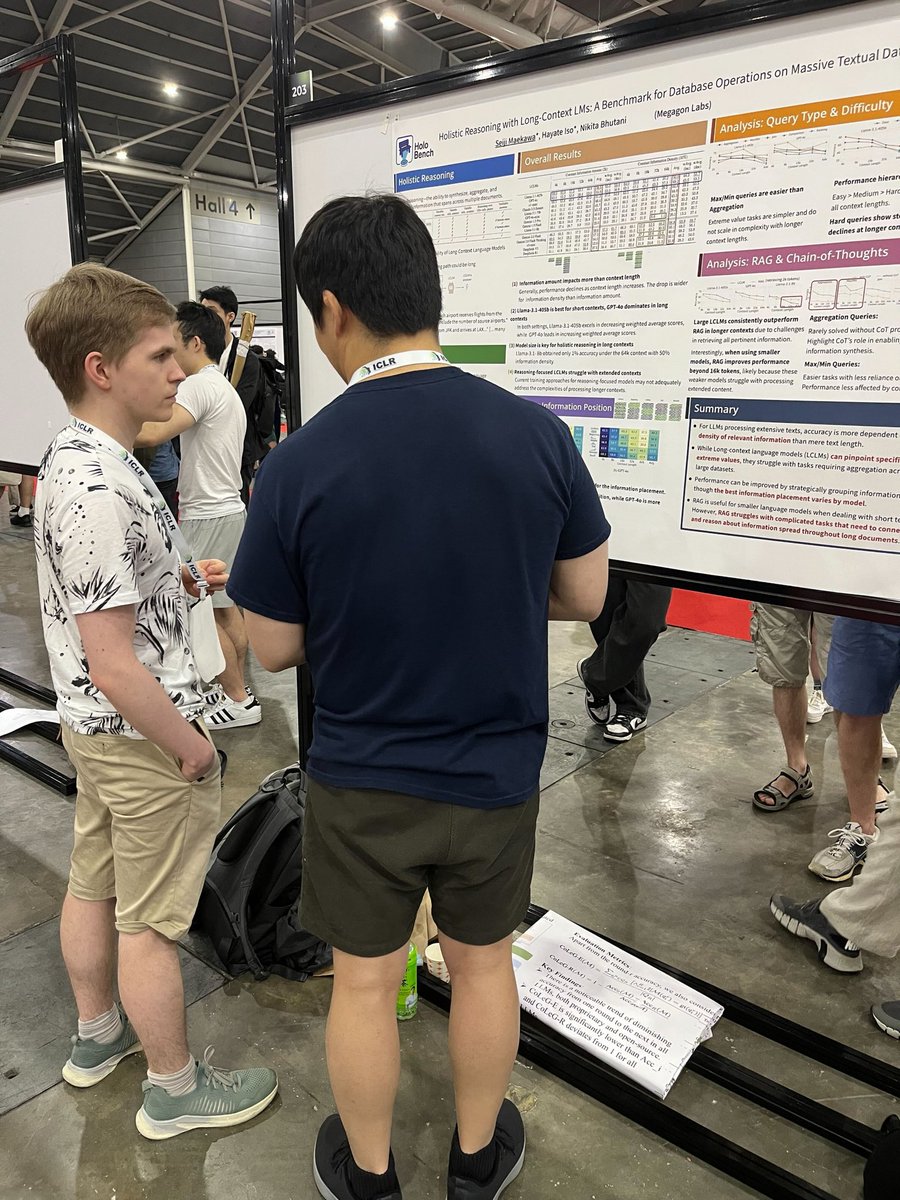

Thank you for coming to my poster in #ICLR It was great having discussions with you all!

来週、NLPコロキウムでも話すので、興味ある方はぜひ!

日本語