River Leaf

26.9K posts

River Leaf

@riverleaf88

会下厨的产品创作者 1. 路图忆 https://t.co/C5fFYUfGJJ 2. 投影仪计算器 https://t.co/Vsp2BSNDAh

听小珺 @zhang_benita 访谈谢赛宁 @sainingxie 的播客,太过瘾了。太多感触,说几个印象最深的点: 1. 世界模型远大于语言模型。我们每个人脑子里都有一个世界模型,比如知道把手放到火上烤会很痛,由此就不会把手放在火上烤。让你不会无缘由把手放在火上烤的模型,就是世界模型。 2. 世界模型是:Next state = M(state, action)。这个 M 就是世界模型。M 不是预测 next token,而是预测 next state. 比如:手很痛 = M(手不在火上, 把手放在火上)。世界模型的预测能力,可以让拥有世界模型能力的生命知道不做什么或做什么。 3. 从世界模型的视角再看大语言模型,就会发现语言的核心是沟通。沟通就意味着存在监督:说出来的,往往是加工过的。LLM 是毒药,Vision 才是无污染的。 4. Scaling law 是吞数据的能力。数据越多,效果越好。LLM 需要 Scaling law,可世界模型不一定需要。这是最有意思的部分,也是最难的部分。谢赛宁头大中,期待某种玄学的力量,突然某天能点连成线,灵光开悟。那样,就可以开始造生灵。 5. 用非机器人的方式,或许能真正解决机器人的困境。机器人领域,可能正在经历 LLM 领域曾经的 Bitter Lesson. 比如春晚的机器人炫技,或许只是曾经 CV 领域的识别猫猫狗狗。 6. 硅谷陷在 LLM 的述事里。硅谷之外的地方,对世界模型非常感兴趣。真正的智能,还在黑暗的探索期。语言很重要,然而整个宇宙的历史里,如果压缩到一天,有语言的时间,才几秒。 7. 人依旧很重要。比如 research taste、比如做研究实验时的 choices 等等。《金刚经》能提升人的独立思考性和研究品味。 8. Impact 不重要。奔着 impact 去做事,是一种自私。分享出来,让读者有启发,激发读者去做些事,这才是发 paper 的价值。 谢赛宁太可爱了。听完后,特别期待小珺下一期采访恺明。

一个字节trea 团队出来创业的,专门做b端的agent。他说 toC的不赚钱的,用户越多越烧钱,于是他做中国的to B agent,整体工作会比较无聊,赚钱就行了,你有稳定的现金流就去。咱就是谁钱多去哪里,管你哪出来的。🙂现在要多少钱直接30k,以前我还藏着掖着的25K-35k。

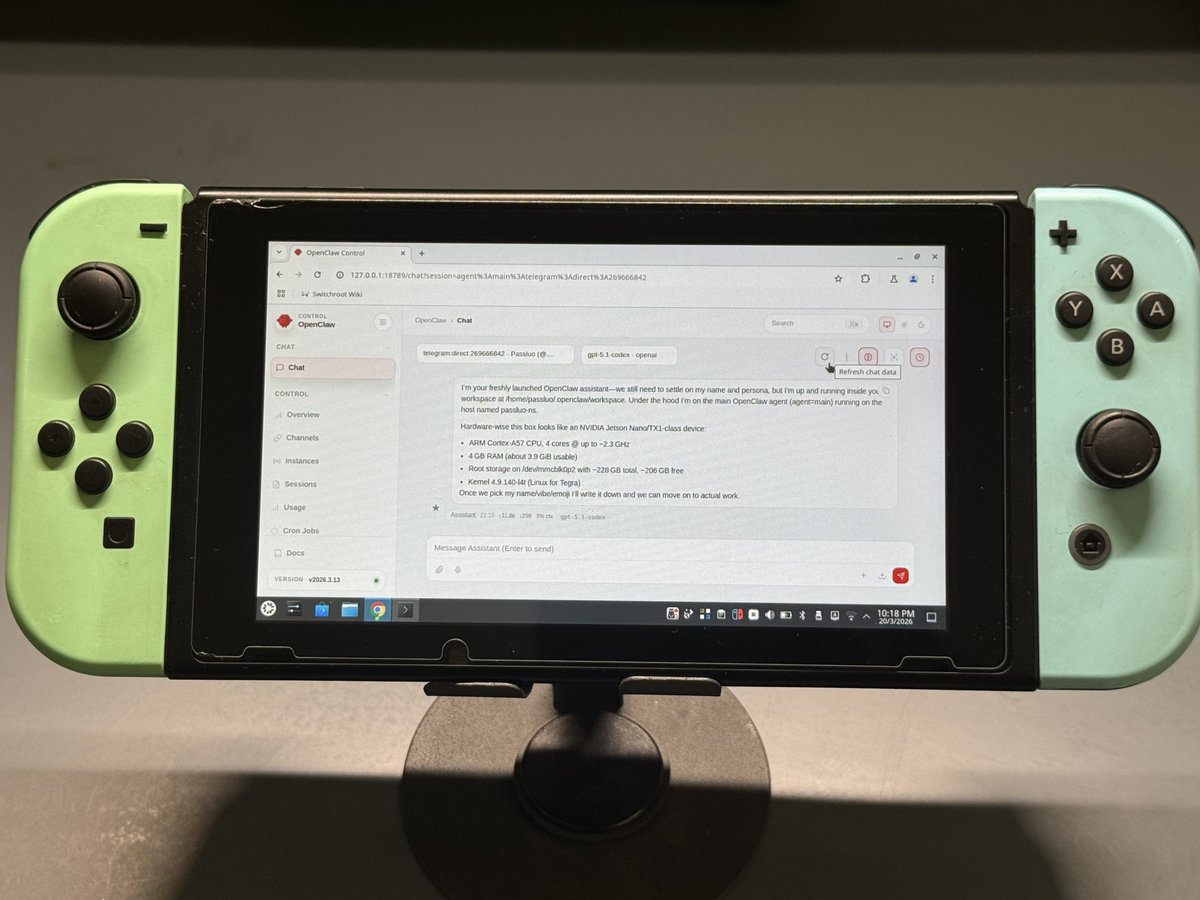

一句话出成套原型,产品经理死了

腾讯出了 qclaw,身边几个拿到内测码的朋友试了一圈后的产品反馈是: “要不我们去做空腾讯吧。😅” 也再次印证了我之前的一个判断—— 如今互联网大厂的人才密度根本无法支撑Agent产品的落地。 一边是独立开发者, 靠兴趣驱动,快速迭代,做出像 openclaw 这样开始影响一批人的项目。 另一边是大厂里二三十人的团队, 层层分工、反复对齐、加班加点, 最后却连一个“能用”的版本都难产。 再多的人堆进去, 产出的也只会是“更慢的失败”。 有点讽刺,但大厂的管理层们还需要起码一年的时间才能建立这个认知。还会有一批又一批的大厂Agent 团队,消耗着人力和预算,陪老板过家家,最终让老板学会这个不复杂的道理。