LotusDecoder

7.7K posts

LotusDecoder

@LotusDecoder

AI - mind - heart

论文来了。名字叫 MSA,Memory Sparse Attention。 一句话说清楚它是什么: 让大模型原生拥有超长记忆。不是外挂检索,不是暴力扩窗口,而是把「记忆」直接长进了注意力机制里,端到端训练。 过去的方案为什么不行? RAG 的本质是「开卷考试」。模型自己不记东西,全靠现场翻笔记。翻得准不准要看检索质量,翻得快不快要看数据量。一旦信息分散在几十份文档里、需要跨文档推理,就抓瞎了。 线性注意力和 KV 缓存的本质是「压缩记忆」。记是记了,但越压越糊,长了就丢。 MSA 的思路完全不同: → 不压缩,不外挂,而是让模型学会「挑重点看」 核心是一种可扩展的稀疏注意力架构,复杂度是线性的。记忆量翻 10 倍,计算成本不会指数爆炸。 → 模型知道「这段记忆来自哪、什么时候的」 用了一种叫 document-wise RoPE 的位置编码,让模型天然理解文档边界和时间顺序。 → 碎片化的信息也能串起来推理 Memory Interleaving 机制,让模型能在散落各处的记忆片段之间做多跳推理。不是只找到一条相关记录,而是把线索串成链。 结果呢? · 从 16K 扩到 1 亿 token,精度衰减不到 9% · 4B 参数的 MSA 模型,在长上下文 benchmark 上打赢 235B 级别的顶级 RAG 系统 · 2 张 A800 就能跑 1 亿 token 推理。这不是实验室专属,这是创业公司买得起的成本。 说白了,以前的大模型是一个极度聪明但只有金鱼记忆的天才。MSA 想做的事情是,让它真正「记住」。 我们放 github 上了,算法的同学不容易,可以点颗星星支持一下。🌟👀🙏 github.com/EverMind-AI/MSA

补充: 有 /clear 命令为什么不用呢? 因为 claude code ,当前仍然有闪屏,跳屏 BUG。 tmux 运行越久,内容越多,越容易出现。 所以重启 claude code 和 tmux 一并做了,干干净净,重新出发。

即使我每天都用AI开发,即使有很多焦头烂额的时候,仍然会偶尔被AI能力震撼。 今天又经历了claude超神瞬间: 我的罗技鼠标接收器丢了,所以买了个二手接收器 → 官方软件 Logitech G Hub 在pair设备时,要求我先更新接收器固件 → 更新接收器固件要求先更新原配鼠标的固件 → 但那是别人的鼠标,不在我手上 → INSTALL 永远灰的 → 无解 ------------- Claude 干了啥: - 分析 Solaar 源码找到 HID++ 2.0 协议 - 用 Python+hidapi 扫描鼠标 feature table - 发现 OOB_STATE (0x1805) 能重置配对记忆 - 写脚本绕过 G Hub 直接发 HID 命令 前后算上我描述问题一共10分钟:DEVICE PAIRED!

腾讯员工已经用上了内网版的龙虾。 可以直接一键安装,并且适配企业微信和群机器人,每个月有大把的免费token。 不同的是,腾讯的自家产品 Qclaw 只允许调用国产大模型,而内部龙虾默认用 claude 😂

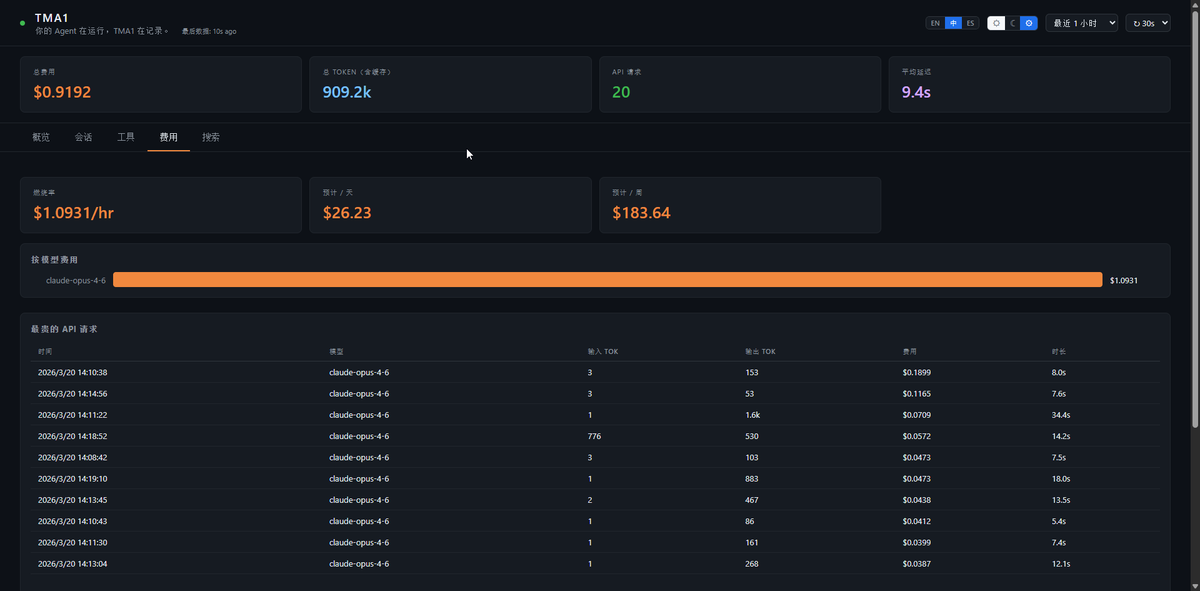

@CoooolXyh 上段时间看到了一个推油做的 tma1.ai