CFX Explorer

179 posts

CFX Explorer

@CFXExplorer

Exploring #Conflux | High-performance Layer 1 blockchain Powered by Tree-Graph consensus for speed, security & decentralization. DYOR!

🌐 MEXC will support $USDT on the @Conflux_Network! ‣ Deposits available: Apr 2, 2026, 10:00 (UTC) Details: mexc.com/announcements/…

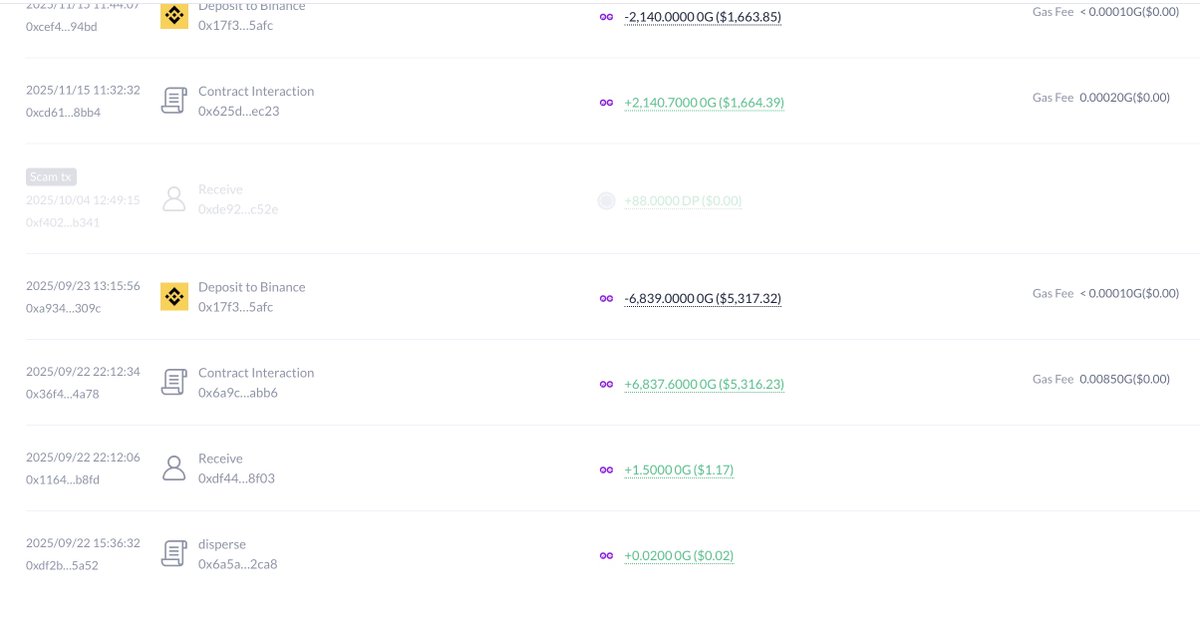

DeepFamily — ZK-powered family tree protocol. Private/public trees, proofs, NFTs. Strong cryptography and meaningful identity use case. - $1,500

Preserve Your Family Legacy On-Chain #DeepFamily is an open-source protocol for decentralized digital family trees: 1. Zero-knowledge proofs for privacy protection 2. Blockchain immutability for permanent records 3. Community governance for data integrity Our redesigned UI is now live on the #ConfluxTestnet We'd love for you to try it out and share your feedback. Website: deepfamily.org eSpace Faucet: efaucet.confluxnetwork.org @Conflux_Network @ConfluxDevs #Conflux #Web3 #ZKP #ZeroKnowledge #Blockchain #NFT #OpenSource #DApp #Decentralized #Privacy #FamilyTree #DigitalHeritage #BuildInPublic #ConfluxNetwork #ZK #Genealogy

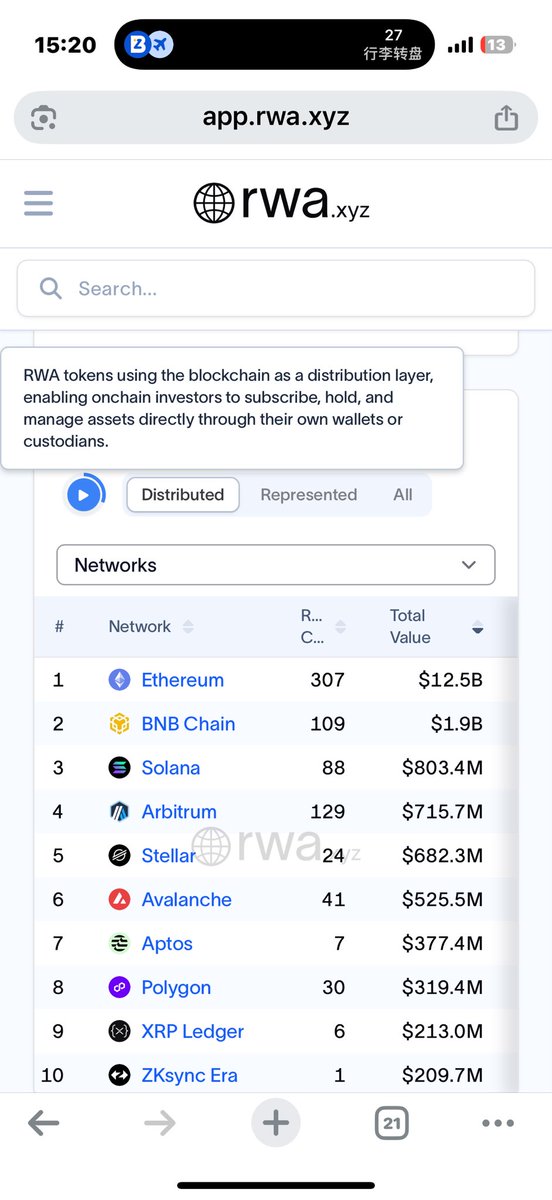

昨日受邀在香港由星路科技(复星孵化的Web3公司)和复星财富举办的Web5(Web2与Web3融合)生态大会上参加了圆桌论坛,并在复星财富中环办公室与蔡华先生签署了了星路科技与Conflux公链的战略合作协议,未来会将泰康资产和纽约BNY Mellon的代币化金融产品在Conflux公有链上发行,并会通过复星财富导入其Web2的高净值客户通过链上渠道完成RWA产品认购,携手助力香港Web3的发展! 时值熊市初期,主任没有停下做事的脚步,但同时深感压力,国内环境突然收紧,香港这边加密资本主义的糖衣炮弹无孔不入:一位前辈在Panel结束后与主任交流,提醒到Solona正重金投入在香港Lobby,预计很快会成为继Ethereum, Hashkey Chain之后第三个被香港政府认可的公链,而与主任同台分享的Solona代表,也正是以星路科技投资人的尊贵身份出现. 除了这位前辈,还有很多朋友会后与主任交流,纷纷表示陈凤霞太不容易了,投来同情的目光. 脆弱的民族区块链基础建设事业,没有钱,没有人,没有生态,同时面临着中美的夹击,还在奋斗的陈风霞们咬紧牙关,不到最后一刻不轻言放弃! 主任在台上眉关紧锁, 这是国产公链最后的倔强!

大陆重大政策或重要会议通常安排在周五 2025 年 11 月 28 日,中国人民银行召开打击虚拟货币交易炒作工作协调机制会议,是周五 今天,中国互联网金融协会等七部门发布关于防范涉虚拟货币等非法活动的风险提示,也是在周五 难怪今天A股尾盘突然拉升——是不是有人提前知道风声? 未来大陆无法开展任何加密货币相关业务,不少资金自然会往 A 股流 而 RWA、交易所等业务只能放在香港,大陆无法落地 这样看,某种程度上反而是利好香港 别再调侃香港是“金融遗址”了

针对下面的两个热推(来自@tmel0211和@chenxingdotli)展开一点我的看法,也回溯一点历史。 x.com/tmel0211/statu… x.com/chenxingdotli/… 在讨论项目时,常有一种危险的泛化倾向:Monero 被攻击就意味着 PoW 不好,进而推导出 PoS 更好。尽管这两条推文没有直接这么说,但可能被误读。因此,有必要先指出这种推论的荒谬之处,后文也将不时回溯这一泛化问题。 先说我想强调的结论:Monero 暂时被 Qubic 控制了,是 Monero 自身设计的问题,不是中本聪共识的问题,更不是 PoW 的问题,因为别的共识(以 PoS 为例)也有性质相似且伤害更致命的问题。 一鱼多吃 Qubic 的“一鱼多吃”策略,让我想起了曾经颇为流行的“合并挖矿”(Merged Mining,简称 MM)——通过解决一个 PoW 难题,同时为多个区块链挖矿并生成区块的设计 。尽管当年的讨论并未就 MM 的利弊达成一致,但我个人认为它存在三大无法解决的问题: 1. 降低了攻击成本。最重要的技术难题是,当矿工只要一个链的利益时,对另一个链挖空块破坏其运行,攻击成本很低。为方便叙述,我们管长期看来算力大,收益高的那个链叫父链;算力小,收益低的那个链叫子链。那么如果父子链收益差别较大,父链矿工干掉子链,风险很低。2012 年比特币的 Eligius mining pool 就是这样干掉了 CoiledCoin。有趣的是,如果子链算力或收益短期内超过父链,“弑父”也是可以达成的。这与 Qubic 和 Monero 之间发生的情况颇为相似。 2. 假装参与共识。MM 的矿工因为方便,可能不愿意部署子链的全节点,付出相应的带宽/存储/验证交易成本,而是外包给别人。这样客观上子链的共识安全并没有被加强。和以太坊类似,RPC 成为安全瓶颈之一。事实上矿工有非常强的动机放弃子链的交易验证过程。 3. 中心化。通常一个链的矿工是另一个链的真子集。父链大矿工加入子链,很容易瞬间获得巨大权力。在 MM 链 的历史上,这是普遍现象。 (对这个讨论感兴趣的同学,可以看这篇 2017 年 的论文:Merged Mining: Curse or Cure? eprint.iacr.org/2017/791) 因为这三个痼疾,我个人对 MM 的态度是偏负面的——所以 CKB 也没有考虑走这条路。顺便说一句,Drivechains 和 Spacechain 和我们这里说的 MM 没什么关系。它们的设计有更大的问题,与本文无关,就不展开了。 或许有人要问,Qubic 只是拿“挖 Monero”当作 uPoW 的一个 use case,它和 Monero 之间也不是 Merged Mining 的关系啊?为什么 Monero 人在家中坐,MM 的病从天上来呢?这就涉及到我要说的下一个问题了。 ASIC是PoW的重要护城河 先说一个学术界没什么争议的判断:PoS 不安全的根源之一,或者 PoS 最大的雷之一,是资金的流动太自由了,拦不住。Merged Mining 的“大欺小”,还需要二者使用相同的挖矿 puzzle;但 PoS 的世界里如果想大欺小完全没有这个限制,因为不同 token 的自由转换简直是区块链世界里最轻松的事情了。 PoW 为什么没有这个问题呢?因为中间有挖矿硬件拦着啊!在 PoW 中,购买或租用特定矿机来攻击目标代币,远比在 PoS 中直接购买代币进行攻击要复杂得多。 但是——凡事都有个但是——什么情况下买/租矿机会变得相对容易呢? 其一是,有大量的闲置的或潜在的待攻击矿机可以被购买或租用。其二是,买/租矿机的价格远高于市场价,即 Haotian 说的利益面前没忠诚。 我们先说第一个条件。这个条件比第二个更致命,因为在没有闲置矿机且矿工忠于生态的情况下,潜在攻击者很难获得控制权。而选择 CPU 或 GPU 挖矿,就会导致巨大的可被敌手利用的矿机池子!这就是 Haotian 所说的“对于 CPU/GPU 挖矿的币来说,算力就是雇佣兵”。所以 CKB 从一开始就决定拥抱 ASIC 矿机,而且刻意选择了一个和别的链都不同的挖矿 puzzle,避免了很多潜在攻击。 或许有人要问,比特币当初不也是号称 one CPU one vote 么?这是因为,在中本聪当时的视野里完全没有想到会有那么多不同的非许可区块链,对各种花式攻击也了解不多。 引申一步关于“算力液态化”的讨论。即使使用 ASIC 挖矿,并且矿工都很诚实,也很难保证算力完全不“流动”。这是因为,算力会天然往挖矿成本更低的地理位置集中。 但请不要认为“液态化”是 PoW 独有的问题。不可否认,钱,是这个世界流动最快的东西了。PoS 里的权益(Stake)要是“液态化”起来,不论从换手速度还是造成的后果来讲,都比 PoW 惨烈得多。 在第一个条件做好的前提下——使用 ASIC 挖矿,且不和别的项目共用 puzzle——那么第二个条件,就是要避免因为币价持续低迷而导致矿工大量停机。币价这个东西是玄学,不深入。毕竟 PoW 安全,也不是全无条件的。比如—— PoW中的选择时间攻击 PoW 中敌手可以一直搞自私挖矿,然后选择对其有利的时间发起攻击,这个早在 Yonatan 2016 年 的论文中就分析得很清楚了。参见 Bitcoin's Security Model Revisited 这篇论文:arxiv.org/pdf/1605.09193 有两点补充非常必要。 首先,选择攻击时间就意味着敌手持续地消耗电力自私挖矿,也即意味着持续的成本。这时敌手面临着一个两难选择:如果把偷偷挖的区块公开,自私挖矿的行为就会引起社区的警惕,通常导致延长的交易确认的时间;如果不公开,就需要持续地扔掉已经挖出的区块,从而这些成本就石沉大海了。当然,很遗憾的是,正如 Chenxing Li 指出的那样,对于很多 PoW 链来说,比起其上的资产价值,这些区块奖励的损失不算大。所以,整个 PoW 社区的确应该更重视——很多区块链都应该用更大的确认深度,并且时刻对自私挖矿保持警惕。 其次,again,我们不应该认为这是 PoW 独有的问题。PoW 中的选择时间攻击,和 PoS 中的 long-range attack 是高度相似的,都是伺机而动。二者的不同在于,至少对于前者而言,攻击成本还随着时间的拉长逐步增加(上一段),后者则完全没有这个限制,甚至推翻更久远历史的成本可能更低。不要提 checkpoint,checkpoint 就是对 permissionless 理念的背叛。如果 checkpoint 这个作弊器可以增强 PoS 的安全性,那么用来增强 PoW,威力不是一样大么? 中本聪共识落后吗? 我不同意“PoW 自身的安全风险是一个火药桶”的说法 。Monero 的问题源于其自身不明智的选择,不应归咎于 PoW 本身 。 我觉得下面这句话应该没有争议:中本聪共识在自己的安全假设下是最强的。众多的论文在反复地论证这一点,而这些论文还在持续地发表,更新我们的认知。实践中,比特币之后的区块链项目经常需要做出更多的假设,实现新的性质。这些项目定位各有不同,但相同的是,它们和当年中本聪玩的都已经不是一个游戏了。其中一些新假设比别的更靠谱一些,但新的假设也意味着新的风险,也就是新的崩盘的方式。 总结 1. 选择 CPU/GPU 挖矿,或者和别的项目用相同的挖矿 puzzle,或者 puzzle 本身太过“有用”,就不可避免地会导致巨大的、潜在的用于攻击的算力池子。这是 Monero 的问题,不是 PoW 的问题。 2. PoW 有的几乎所有问题,PoS 都有更大的问题。 3. 没有一劳永逸的方案。混合共识虽增加了攻击的复杂性,但未能从根本上解决 PoW 和 PoS 各自的问题。然而,无论是何种共识机制,只要积极维护,都能在实践中表现良好,因为安全是一个持续的修补和应对过程。 大家都顶着风险努力前行吧。

Monero门罗币 $XMR 一家市值6B的隐私币老大哥项目,竟然被一个市值仅有3亿的小项目 @_Qubic_ 给51%算力攻击了?WTF,真不是因为技术多牛逼,而是这事儿太荒诞了。来,我来说说: ——Qubic 何方神圣? 在讲这个魔幻故事之前,得先说说Qubic是什么来头。 Qubic的创始人是Sergey Ivancheglo,圈内人叫他Come-from-Beyond,这人是个技术狂人——创造了第一个PoS区块链NXT,还搞出了第一个DAG架构IOTA。2022年Qubic主网上线,号称要做三件事:建个每秒1550万笔交易的超快链(比Visa快2万倍)、把挖矿算力变成AI训练算力、最终在2027年实现AGI通用人工智能(连OpenAI都不敢这么喊)。听起来,是不是很魔幻,很离谱。为啥野心如此之大? 都知道传统POW挖矿存在被诟病浪费电的问题,因为大部分挖矿机制都是矿工用耗电的算力做数学题抢占Reward区块,等于把算力浪费掉了去换奖励。 Qubic的新共识是有用工作量证明(UPow),可以让矿工一边给POW链挖矿,在其作为包工头的调度下,矿工们还能训练他们的AI系统AIGarth,相当于一份算力可以赚到两份钱。 这就是为何他们能轻易收买门罗的矿工了,因为给矿工的收益一度达到了直接挖XMR的3倍。想想看,矿工能一鱼多吃,在“利益”面前哪还有什么“忠诚”可言。 好了,读到这门罗币被吸血鬼攻击的底层逻辑就这么一点都没有技术含量的被解释完了。 ——科普一下,为啥是门罗币,而非比特币 答案其实在于挖矿方式的差异。 比特币用的ASIC矿机,就是定制的专门挖BTC的机器,除了算SHA-256的数学题啥也不会了,或者只能挖跟BTC算法差不多的币。但问题是,挖BTC的算力要求有多卷,矿工分身乏术(24小时运转),何况想让ASIC训练AI,根本没有可能。 门罗就不一样了,采用的是RandomX算法,可以用通用CPU挖矿,这意味着它的矿工今天能挖矿,明天就能训练AI,后天还能渲染视频,完全可以身兼数职。 Qubic的聪明之处就在这:它瞄准了CPU矿工,让他们“一机两用”,所以才导致了这次51%算力攻击或控制事件。反倒比特币的护城河很稳啊,矿工们被有局限的ASIC矿机焊死在挖矿这一件事上,只能死守比特币; ——算力成了雇佣兵 那这事的影响有多可怕呢?它撕毁了一些POW链最后的一块遮羞布,因为我们总说“算力”是一条链的护城河,算力越大越安全,但Qubic用一次大跌眼镜的实验告诉我们:对于CPU/GPU挖矿的币来说,算力就是雇佣兵,谁给钱多就跟谁走。 更骚的是,Qubic证明自己能干翻Monero之后,又主动撤了。为啥?怕把门罗币彻底搞崩盘影响自己收益。因为3倍收益的其中一大部分还是挖XMR, $QUBIC 只是作为额外的代币奖励,如果门罗崩盘了,Qubic也吃不了兜着走。还不如潇洒撤出,搞一次轰烈的营销事件,羞辱下曾经POW的坚定拥趸,这种“我能杀你但不杀”的感觉,是不是和他们喊出的AGI口号一样透露着放荡不羁? ——AI才是POW真正的掘墓人? 不过,撇开门罗事件的影响,这事对大部分通用硬件POW链来说其实是一次较大的利空,因为这类POW链要完蛋了的话,杀死它的不是POS,而可能是AI。 为什么这么说,以前的算力是“固态”的,大家各自专注于自己的营生,到了AI时代算力被彻底“液态化”了,CPU和GPU算力像水一样,只会流到收益更高的地方,而原先他们赖以生存的“矿工”,搞不好就哪天聚义搞事闹革命了。 虽然Qubic没做哪个恶人,但实验成功了就难免会有一些竞争对手用此方式来搞恶意攻击,比如先做空某个币,然后租用算力51%进行攻击,等币价暴跌后获利了结。摆在这类链面前就两条路,要么像BTC一样把矿工焊死,要么继续用CPU/GPU挖矿,祈祷不要被盯上。 老实说这类币还挺多的,Grin、Beam、Haven Protocol、ETC、RVN、Conflux......所以你看,这不是一两个币的问题,而是整个CPU/GPU挖矿生态都悬在悬崖边上。 要命的是,AI的算力需求是指数级增长的,又出现了那么多AI算力聚合平台,如果都来搅局出天价和平台激励来购买算力,那估计不少POW链的安全防线都会崩溃。 —— 一个讽刺的悖论 这事之所以我说是荒诞,原因还在于Qubic自己就是一条AI链,它所谓攻击门罗的实验即使撤出了也还是免不了要自损八百。道理很简单,任何需要算力的AI链,都不应该用PoW做共识。因为算力用来维护安全,AI就训练不了;算力用来训练AI,链就不安全。 所以,大部分AI项目,Bittensor用PoS,Render用信誉系统,几乎没人敢碰POW,大家都心知肚明这一点,没想到Qubic直接傻傻地把自己的软肋给表演了一遍。 Qubic这次的骚操作,表面是技术事件,本质是给整个Crypto行业上了一课:在算力自由流动的时代,忠诚是个奢侈品,而大部分PoW链付不起这个价格。 Qubic用这次攻击证明了传统PoW可以被经济激励轻易击溃。虽然它自己号称是“有用PoW”,但本质上也依赖这些随时可能被更高出价者买走的“雇佣兵”算力。 革命者或许也会被下一个革命者革命。 Note:荒诞之外,以及一些POW链瑟瑟发抖的未知恐慌之外,大家倒是可以确定两个事实:1、BTC真牛逼;2、 @VitalikButerin 真有先见之明。 我只是浅浅科普下,更多技术细节坐等 @evilcos 大佬进一步分享。

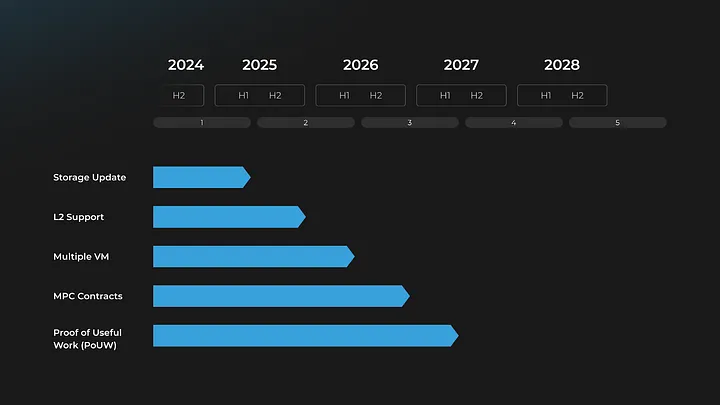

接着上次的内容。Conflux 路线图里的 Storage Update 是什么?它和 0g 的存储有什么区别? 首先说 0g 的存储系统,它是一个独立的存储系统,类似 IPFS、Arweave 这样的项目。这个系统可以接入任何 EVM 兼容的链,包括 Conflux eSpace,没有需要额外开发的地方。 而路线图里说的 Storage 是指区块链节点存储账户、余额的模块,就是以太坊中的 MPT。Vitalik 最近经常提到的 Verkle 树,就是以太坊对这个模块的升级计划。Conflux 也在进行类似的升级。 如果你运行过 Conflux 节点,特别是在铭文事件之后,一定遇到过同步卡在某个区块高度的情况,那就是卡在存储模块上了。目前 Conflux 的存储模块每 2000 个 epoch 就要把上百 GB 的账本在硬盘上完整拷贝一次。整个 Conflux 网络加起来,每天要在本地拷贝超过 2 PB 的数据。 为什么会有这样的设计呢?当初我们想利用一些新型文件系统的 Copy-on-Write 特性,这样就不需要反复拷贝了。但主网上线后才发现,这些文件系统稳定性太差,只能算"玩具"。换回 ext4 这种经典文件系统后,就变成了现在这样。 随着主网运行时间增长,账本越来越大,这个问题就越来越严重,最后到了不得不解决的地步。 这个存储模块的算法复杂度仅次于共识算法。因为它要实现两个关键功能: 第一是"多版本管理"。比如要能查询一个账户在一年前某个区块的余额,还要支持将整个账本回滚几个区块。 第二是"可验证结构"。区块链节点需要通过它计算的"根哈希"来确保所有节点的账本一致。此外,它还能为 get_balance 这类 RPC 查询结果生成密码学证明。(现在大家都信任中心化的 RPC 提供商,用不到这个证明。) 在实现这两个功能的基础上,还要保证高性能。 目前我们已经完成了功能的开发,进行了一轮性能测试和优化,期间还修复了一个 rocksdb 的 bug。不过要完全接入现有系统和适配可能还需要一些时间。

The #Conflux block visualization clearly illustrates its tree-graph structure. Unlike Ethereum’s linear chain, it highlights parallel block production and branch merging, showcasing the foundation of its high throughput and fast finality.

技术路线图是大的方向和计划,但也要根据生态发展的需求来调整。近期的一个主要工作是 EVM 对齐。 三年前,L2s 在讨论 EVM 兼容(compatible)和EVM等价(equivalence)的概念。当时,L2s 为了争夺以太坊正统性,互相指责对方只是"EVM兼容"而非"EVM等价"。 这里,我们不严谨地借用一下这两个概念,和当时的定义并非完全一致。不一致的原因之一是:当时对EVM等价的定义是要求与以太坊黄皮书完全一致,但以太坊的黄皮书已经停留在两年前的状态,虽然时间戳是新的,但 Dencun 和 Pectra 升级都没有被更新进去。 长期以来,Conflux 的 eSpace 只是 EVM 兼容:虽然与EVM 存在差异(比如 gas 计算规则),但 EVM 的合约、SDK 和钱包可以直接使用,这就是所谓的"兼容"。不过,我们近期的生态发展遇到了一些需求,需要实现 EVM 等价,即行为与以太坊客户端的行为完全一致。 为此,Conflux 提出了包含大量修改的CIP-645(github.com/Conflux-Chain/…)。 功能实现仅用了3天,但测试工作已经持续了2个月。目前已经通过了以太坊社区的22000个测试用例。 不过,由于 Conflux 的共识机制与以太坊不同,出于安全考虑,未来主网将保留一些 VM 层面的不一致。从实用主义的角度来看,将这些不一致限制在一个明确的小范围内就足够了。我们也不追求什么以太坊正统性。 其实这些工作都是公开进行的,conflux-rust上的代码提交和 CIP 文档一直都可以公开访问。 Roadmap 的其他几个方面也在推进中,等有时间可以再详细介绍。