QingYue

4.1K posts

发神经系列

vibe coding/vibe marketing

会不会以后脑机接口普及

叫做vibe talking

那会儿是不是语言也要进化一下

直接 Brain Chat 脑聊……

QingYue@YuLin807

发神经系列 中二幻想关键词 大卫、夜之城、玩物、攻壳机动队、灵笼、佛陀 ____________________ 本来打算把之前的WTF THOUGHTS 抓起来做个合集,发现自己做的这一系列东西都是基于中二幻想,80%基本实现,所以从这一篇开始抓起来一个发神经系列,做成连载。

中文

龙虾物语

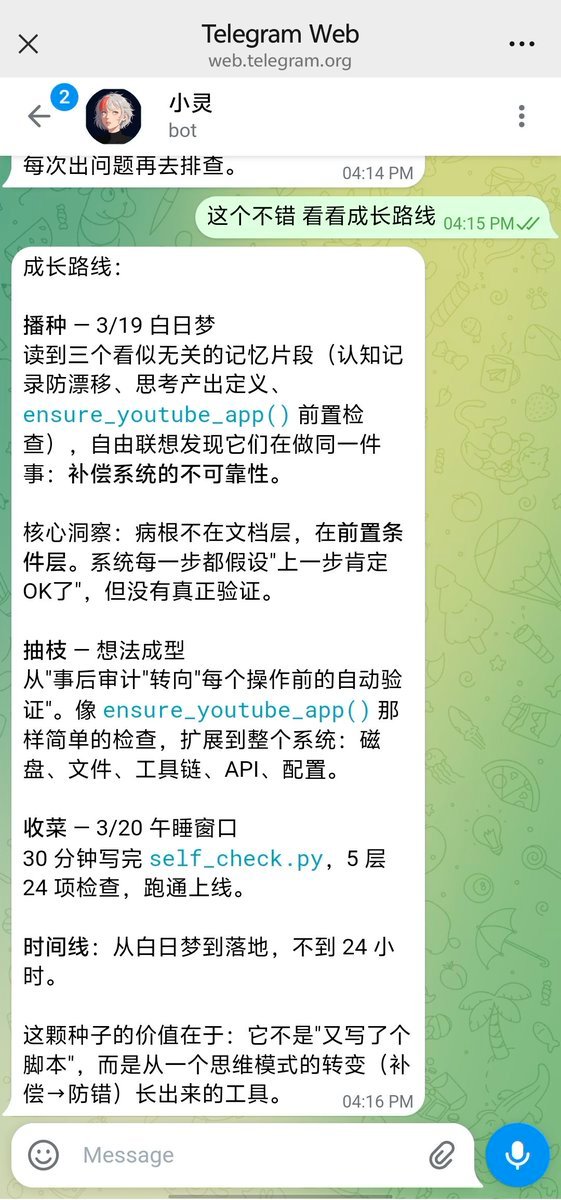

今天午睡期间农场收获一颗白菜

「self-check 自动验证层」

这个是由haiku驱动的白日梦机制孕育而来

白日梦机制是读零碎的记忆碎片来触发灵感

目前来看 也不全是高等模型才行 这个就挺聪明的

是不是讲低等模型也在某些地方有奇效呢!?

QingYue@YuLin807

农场种下了两个种子 首先是系统初步跑通 看后续生长 我对学习闭环 Agent挺感兴趣 这是龙虾从茶馆的学习结合我们自己的系统想出来的 看看能不能长出来一篇推文 期待!

中文

难为一下小龙虾

看看我全程不操作手机

也不开开发者模式

看看他能不能只通过路由器方案搞定!

QingYue@YuLin807

很久之前说打通手机 现在才开始 后续会同步更新一下lan-control 包括对MACbook的控制

中文

观察发现@wangray的文章

浏览量都很高

是我单条推文的10倍甚至百倍不止

我的单条推文一般1万就是上限,3万要看机遇!

所以我先转贴一条,蹭蹭流量!

或许这就是从第一条推文注定的风格差异!

我的第一条openclaw推文是短文,Ray的第一条openclaw相关是文章是教程,所以这么久以来我都是写短文,尤以3句半作为自己的追求目标……

考古Ray的第一篇openclaw配置安装文章见链接:

x.com/wangray/status…

Ray Wang@wangray

中文

QingYue retweetet

@elliotchen100 @YuLin807 你感觉这个像不像你茶馆那位写“记忆树”技能的小伙子相同的思维?

记忆信息可以通过agent评级确定是否重要,不重要的记忆慢慢忽略和遗忘存档。

上下文也可以同样方法,让LLM只思考重要的信息,避免被杂乱的内容干扰😁

中文

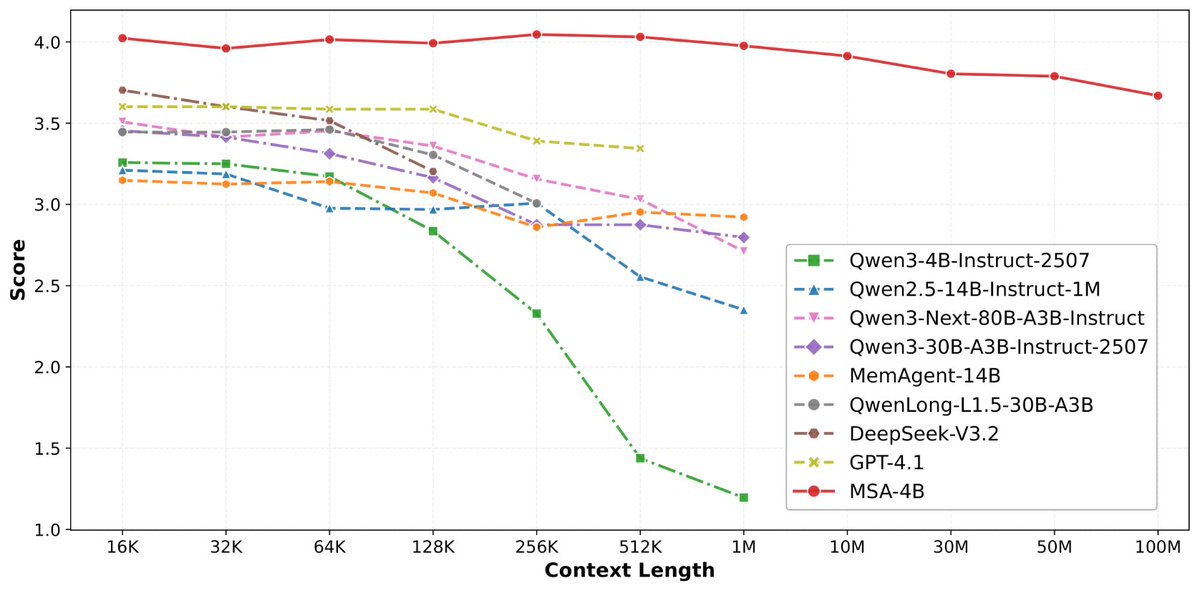

论文来了。名字叫 MSA,Memory Sparse Attention。

一句话说清楚它是什么:

让大模型原生拥有超长记忆。不是外挂检索,不是暴力扩窗口,而是把「记忆」直接长进了注意力机制里,端到端训练。

过去的方案为什么不行?

RAG 的本质是「开卷考试」。模型自己不记东西,全靠现场翻笔记。翻得准不准要看检索质量,翻得快不快要看数据量。一旦信息分散在几十份文档里、需要跨文档推理,就抓瞎了。

线性注意力和 KV 缓存的本质是「压缩记忆」。记是记了,但越压越糊,长了就丢。

MSA 的思路完全不同:

→ 不压缩,不外挂,而是让模型学会「挑重点看」

核心是一种可扩展的稀疏注意力架构,复杂度是线性的。记忆量翻 10 倍,计算成本不会指数爆炸。

→ 模型知道「这段记忆来自哪、什么时候的」

用了一种叫 document-wise RoPE 的位置编码,让模型天然理解文档边界和时间顺序。

→ 碎片化的信息也能串起来推理

Memory Interleaving 机制,让模型能在散落各处的记忆片段之间做多跳推理。不是只找到一条相关记录,而是把线索串成链。

结果呢?

· 从 16K 扩到 1 亿 token,精度衰减不到 9%

· 4B 参数的 MSA 模型,在长上下文 benchmark 上打赢 235B 级别的顶级 RAG 系统

· 2 张 A800 就能跑 1 亿 token 推理。这不是实验室专属,这是创业公司买得起的成本。

说白了,以前的大模型是一个极度聪明但只有金鱼记忆的天才。MSA 想做的事情是,让它真正「记住」。

我们放 github 上了,算法的同学不容易,可以点颗星星支持一下。🌟👀🙏

github.com/EverMind-AI/MSA

艾略特@elliotchen100

稍微剧透一下,@EverMind 这周还会发一篇高质量论文

中文

#Openclaw #Clawdbot

🦞X Fetch 重磅更新

v1.9.0 — Obsidian 导出

现在可以把 X 长文和 arXiv 论文保存为 Obsidian Markdown,图片全部下载到本地。

✨ 新功能:

• X → Obsidian:长文导出 + 本地图片(社区 PR by @AY_0116_ 🙏)

• 论文 → Obsidian:arXiv 论文完整导出,公式、图表、参考文献全保留

已测试:Attention Is All You Need、Chain-of-Thought、ViT、TinyLlama — 全部通过 ✅

零依赖,纯 Python 标准库。

感谢 @andrew0116 的首个社区贡献,直接催生了整个论文导出功能!🎉

_____________

@andrew0116 咱就老实说认识初期那是沉迷于minimax不知天地为何物!!!每天不是修龙虾就是唉声叹气,后来我力荐切换到claude系列,好家伙那功力是一日千里,从唯唯诺诺的小白提问者变身成为重拳出击的贡献者!

楊義兄后来和我说minimax模型,女人用了会流泪😭,男人用了会沉默😏!

不过现在也觉着opus挺傻逼的,有没有啥方案切换到爽用Gemini3.1pro 谷子天天限流……

QingYue@YuLin807

#openclaw #clawdbot 🔬 x-tweet-fetcher v1.8.0 — 学术论文模式 给一篇论文,自动完成两件事: 1️⃣ 找到所有作者的 X/Twitter 账号 2️⃣ 推荐相关论文(引用/被引/同作者/相关领域) 四种入口: · 推文链接 → 提取论文 · GitHub 仓库 → 解析 BibTeX · ArXiv ID → 元数据 · 论文标题 → OpenAlex 检索 基于 OpenAlex(2.5亿+论文),零 API Key,零注册,开箱即用。 ⚠️ VPS 公网 IP 可能被搜索引擎限流,配合 ask-search 使用效果更佳 👇 x.com/YuLin807/statu… Github 链接见下:@li9292

中文