小宇玩ai

407 posts

小宇玩ai

@BTCxiaoyu1

专职给市场提供流动性 | 爆仓 108 次依然相信光。 坚信技术分析,但 K 线总是针对我。 正在进行第 N 次翻身计划。 请勿模仿我的操作,除非你想做空。

everything you need to know about how the team built the new @raycast from the ground up honestly worth a read 👉 raycast.com/blog/a-technic… there's nothing to hide

baoyu-skills 新加了一个 Skill: 微信群聊总结 Skill:github.com/JimLiu/baoyu-s… 依赖于 wx-cli:github.com/jackwener/wx-c… 如何配置使用 wx-cli 请看项目文档,无法提供帮助。另外目前只是借助其读取数据,其他没任何关系。 Claude Code + Claude Opus 4.6 效果最佳

做AI图片内容,真正值得关注的不是单张图质量,而是能不能把抽卡变成可复用的自动化工作流。 我刚用Codex跑通了一次完整实验(附提示词): 题材很离谱,3D版《哆啦A梦大战尼斯湖水怪》。 但流程是可行的。 我只给了它一个方向: 生成故事,拆解分镜,用GPT Image 2批量生图,统一保存到本地文件夹。 它最后自动完成了这几步: 1.生成完整故事 2.整理成10个分镜 3.生成批量提示词 4.调用GPT Image 2批量生成 10张图按序号落到本地目录:D:\Codex\ceshi01 而且还可以随时修改 AI Agent的价值,不是聊两句创意,而是把想法直接推进成一条产线: 脑洞 → 故事 → 分镜 → 提示词 → 批量生图 → 本地归档 以后做短片概念、绘本草图、广告分镜、账号配图,真正节省时间的会是这类自动化工作流。 这是我的提示词: · 生成故事:哆啦A梦大战尼斯湖水怪 · 拆解分镜:故事出来后,继续将其拆解成具体的文字分镜。 · 自动批量生图:按照这些分镜用GPT IMAGE 2自动生成 对应的图片。 并统一保存到指定的本地文件夹中:D:\Codex\ceshi01 宽高比: 16:9,3D风格

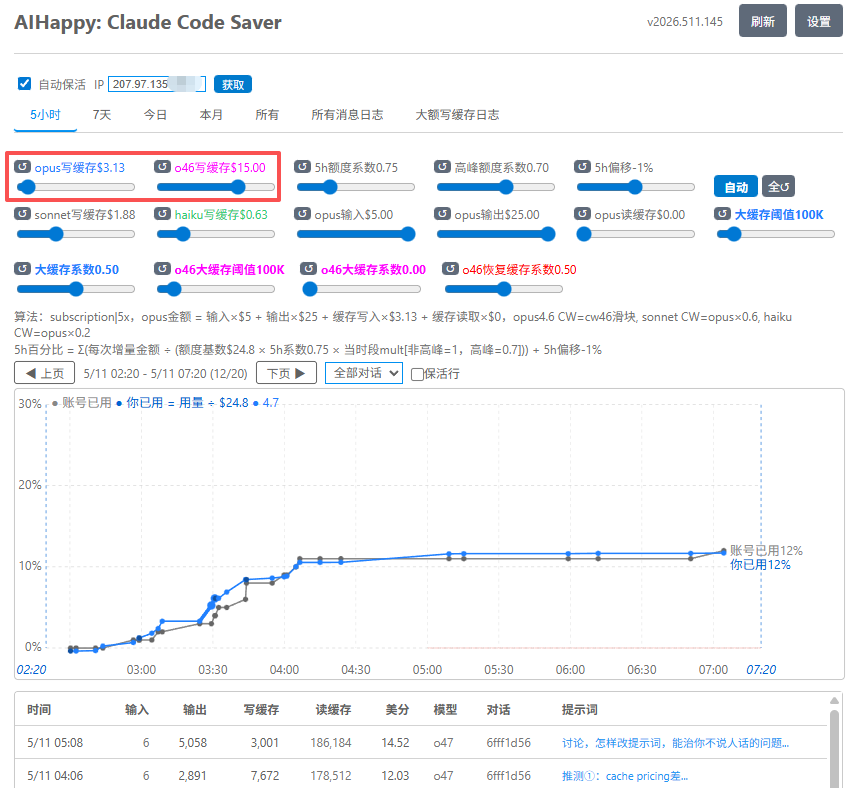

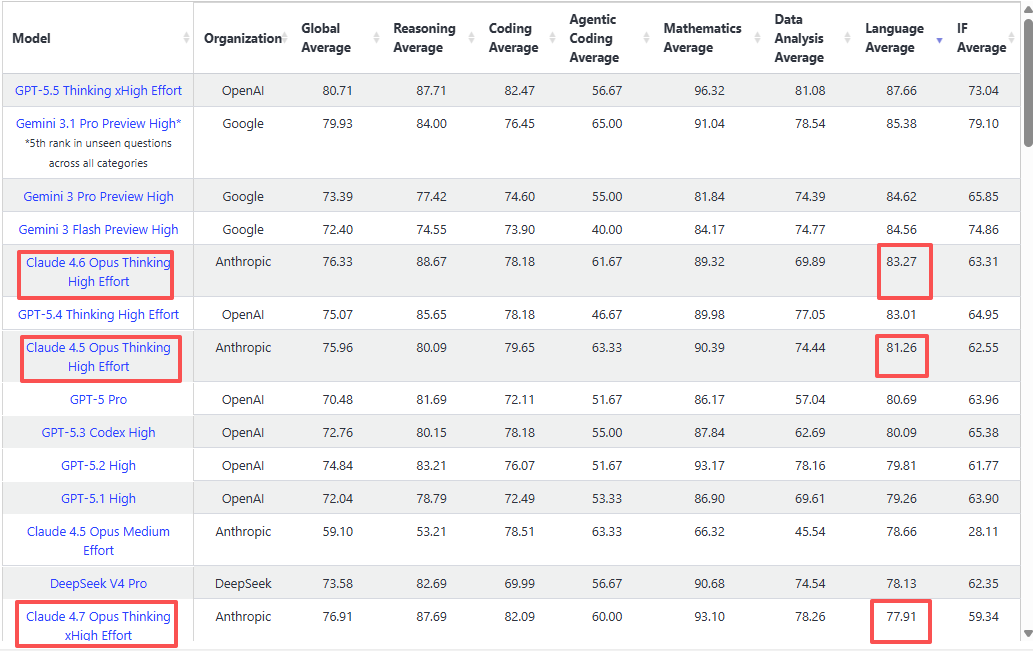

冷知识:人人叫好的 Opus 4.6 价格偷偷涨了近3倍 在L站刷到一个大佬做的拟合测试,目前4.6写缓存价格15刀,4.7只要3刀。而在4.7没出之前,4.6的价格在五六刀左右 照这样的话目前最性价比的搭配,编程任务交给4.7,写作类任务交给4.6(4.7体感老不说人话,LiveBench评分居然还不如4.5😂)

You've been asking for this one... Now in preview: Codex in the ChatGPT mobile app. Start new work, review outputs, steer execution, and approve next steps, all from the ChatGPT mobile app. Codex will keep running on your laptop, Mac mini, or devbox.

BIG one for devs today. Introducing the Notion Developer Platform: - Notion CLI, ntn (Notion in your terminal) - Workers (run code on Notion's infra) - Database sync (any data source into Notion) - Agent tools (build any workflow) - Webhook triggers (trigger Notion from any app) - External Agents API (bring any agent into Notion) - Notion Agents SDK (use Notion Agents anywhere) - …and a bunch more API improvements And soon, you won't need to be a developer to build on Notion. Your agent will be one for you.

everything you need to know about how the team built the new @raycast from the ground up honestly worth a read 👉 raycast.com/blog/a-technic… there's nothing to hide

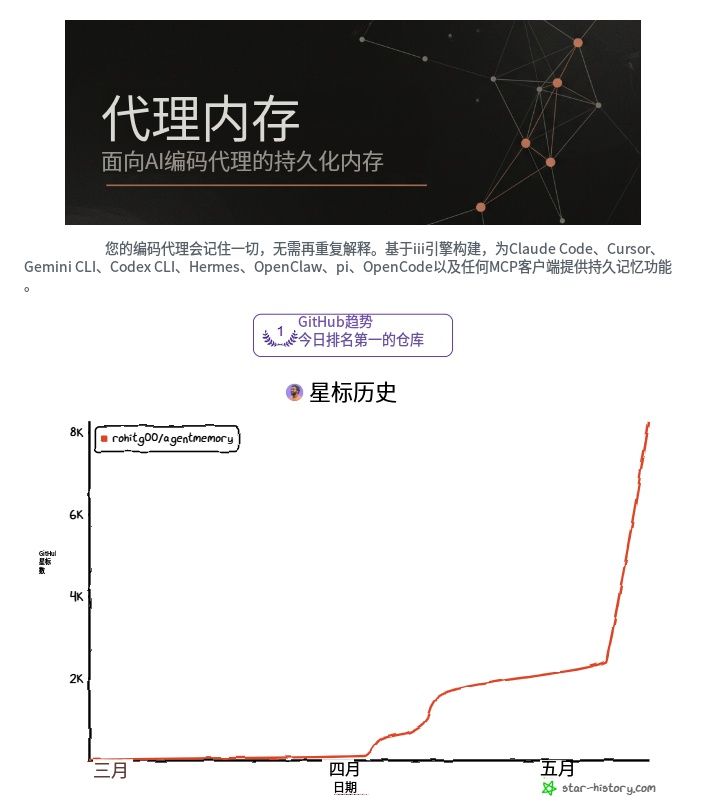

Meet Kimi Web Bridge - Kimi's browser extension. Agent can now interact with websites like a human: search, scroll, click, type and complete tasks. Supports Kimi Code CLI, Claude Code, Cursor, Codex, Hermes, and more. Available now on kimi.com/features/webbr… and the Chrome Web Store.