Martin Elstner

682 posts

@ElstnerMartin

Building AI knowledge system @ElstnerAnalytic | Product-focused | Passionate about LLMs, search systems & data science | Knowledge for LLMs

MCP is dead. Join us for a celebration of its life on April 1 in NYC ahead of the MCP Dev Summit. Wear black. luma.com/htkxoidx

Wenn dein Schwimmlehrer vor deinen Augen ertrinkt, fängst du an, seine Qualifikation zu hinterfragen. McKinsey ist gerade ertrunken. McKinseys KI-Chatbot "Lilli" wurde in 2 Stunden gehackt. 46,5 Millionen Chat-Nachrichten im Klartext. M&A-Deals, Kundenstrategien, vertrauliche Dateien. 728.000 Dokumente. 57.000 Nutzerkonten. Alles offen. Alles editierbar. Die Schwachstelle? SQL Injection. Die kennt jeder Informatik-Erstsemester. McKinseys eigene Scanner haben sie zwei Jahre lang übersehen. Ein KI-Agent hat sie in 2 Stunden gefunden. Ohne Zugangsdaten. Einfach so. Das wäre peinlich genug für jedes Unternehmen. Aber McKinsey positioniert sich als globaler Vorreiter für KI-Transformation. Berät DAX-Konzerne und Regierungen, wie man KI sicher einsetzt. Und kriegt das eigene Produkt nicht in den Griff. Und es sind nicht McKinseys Daten, die da schwimmen. Es sind deine. Alles landet in Lilli. Dein M&A-Deal teilt sich die Datenbank mit der Frage, ob Hafermilch im Flat White zulässig oder eine Todsünde ist. Überrascht mich das? Kein bisschen. Ich habe in etlichen Projekten mit McKinsey zusammengearbeitet. Brillante Strategen, exzellente Folien. Aber echte technologische Expertise? Dünn. Sehr dünn. Wer KI-Transformation verkauft, aber SQL Injection nicht findet, hat kein Sicherheitsproblem. Der hat ein Glaubwürdigkeitsproblem. Aber das Glaubwürdigkeitsproblem hat nicht nur McKinsey. Ich führe hunderte Gespräche im Jahr mit Geschäftsführern, Bürgermeistern, IT-Leitern. Alle sagen: "Bei uns halten sich alle an die Regeln." Das ist - und ich wähle meine Worte hier sehr bewusst -Bullshit. (Das Thalia Theater hat angerufen, die wollen das Stück aufführen.) Du stehst unter Zeitdruck und knallst eine komplette Mail mit Kundendaten per Copy & Paste in eine KI. Compliance auf dem Papier schützt keine einzige Zeile Daten. Menschen schützen keine Daten. Technologie schützt Daten. Security by Design. Genau das hat McKinsey nicht gehabt. Und die meisten anderen auch nicht. Letztens habe ich einen IT-Leiter gefragt: "Würden Sie zustimmen, wenn jeder Mitarbeiter seine eigene Software von zu Hause mitbringt und auf Ihren Systemen installiert?" Er hat mich angeguckt, als hätte ich ihm vorgeschlagen, die Firewall abzuschalten. "Nein. Natürlich nicht." Und warum darf dann hier jeder seine eigene KI mitbringen und machen was er will? Schweigen. Lautes Schweigen. Nach außen Rettungsschwimmer. Nach innen Seepferdchen. Aber die Rechnung ist für Olympia-Gold.

Übrigens, weil das dem normalen Bürger, der nicht in der Automobilindustrie arbeitet, vielleicht nicht ganz klar ist: Im Durchschnitt kommen auf einen Arbeitsplatz bei einem OEM (hier VW) circa 3-5 Arbeitsplätze bei den Zulieferern, die dann in der Regel ebenfalls wegfallen (müssen).

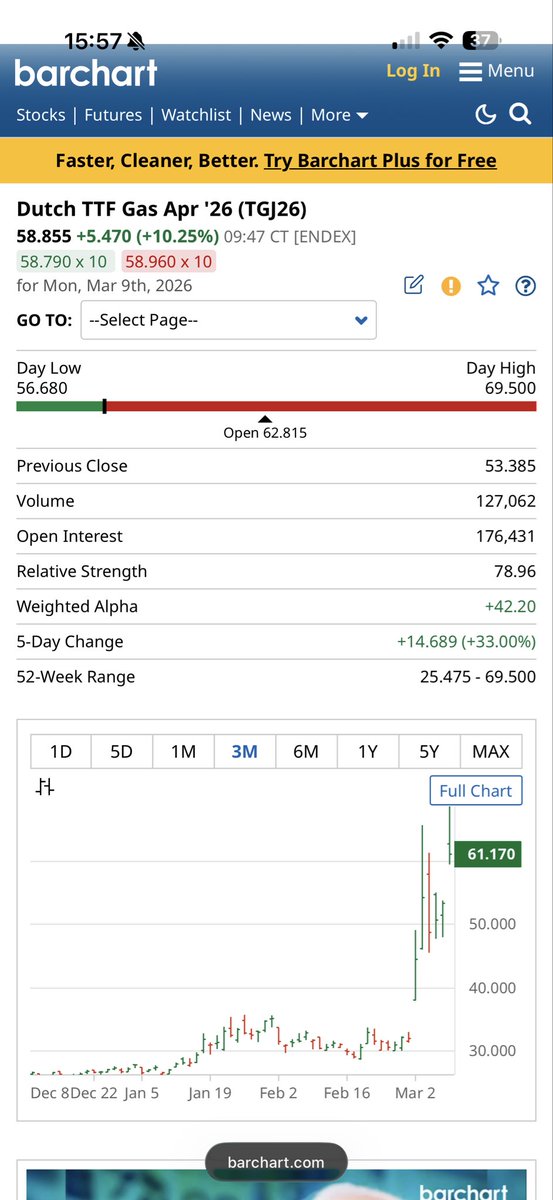

Good Morning from Germany, where spot gas prices have surged to above €60 per megawatt hour. That makes natural gas roughly 6 times more expensive here than in the US.

@PSHolstein @INTERNETZKAISER Achso, also wenn ich die japanische Staatsangehörigkeit habe, bin ich automatisch Japaner obwohl ich nicht asiatisch aussehe? Das ist ja lustig. Die Asiaten würden das niemals so anerkennen.

I have had a few hours to read through the code and also run two experiments. For a modest input document set of about 200K of text documents, the Anthropic API cost was about $2.50 and the resulting KG and the visualization component are very cool. I had difficulties getting it set up to use local models, still TBD: