Carlos Esteban

4 posts

Carlos Esteban

@EstebanFoxDev

🇨🇴 “La mente no es un recipiente que llenar, sino un fuego que encender.” -Plutarco-

Quindio, Colombia Katılım Mart 2026

32 Takip Edilen0 Takipçiler

La capacidad de imaginar y crear todos la tenemos, pocos son los que la utilizan con sabiduría y constancia 🌿

Pol Turrents@polispol

Yo cada vez que leo que la IA acabará con el cine me acuerdo de que todo el mundo tiene un lápiz en casa y no hay muchos Shakespeares por el mundo.

Español

@_nasch_ Y yo que apenas estoy aprendiendo código con Java... que largo y poco alentador es el camino.

Pero me gusta que tengo el amor por aprender, sería bueno entrar a este curso.

Español

@G_Programming No entiendo un carajo jeje pero es increíble tanto conocimiento, espero llegar algún día a tal nivel.

No me pierdo video alguno de estos temas aunque no los comprenda bien.

Español

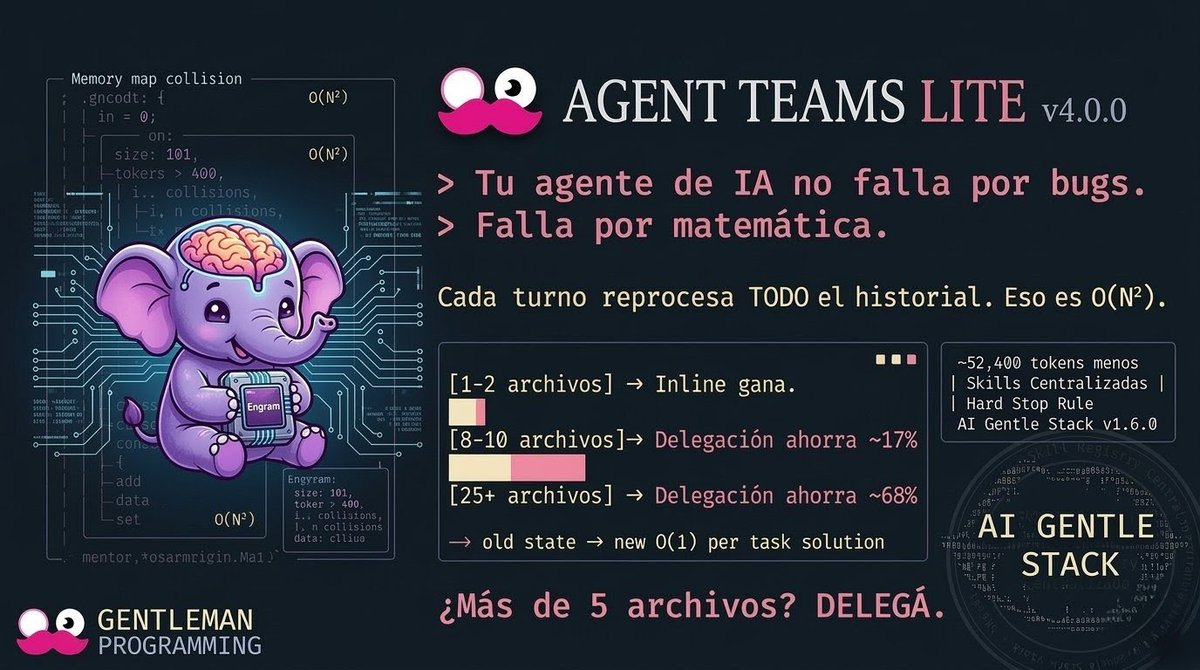

Tu agente de IA no falla por bugs. Falla por matemática.

Cada turno reprocesa TODO el historial. Eso es O(N²).

Cuando la ventana se llena, compacta. Pierde estado, pierde decisiones, pierde lo que ya había leído. Intenta recuperarse. Eso genera más contexto. Más compactación. Un ciclo que no tiene fondo.

No es el modelo. Es la arquitectura.

Agent Teams Lite resuelve esto con un patrón simple:

Un coordinador delega TODO a sub-agentes especializados. Cada uno arranca fresco, ejecuta, devuelve el resultado y se descarta. El coordinador nunca se contamina. Los sub-agentes son O(1) por tarea.

Lo medimos con la comunidad. Con un proyecto real.

144 archivos Go. 59,513 palabras de código:

📊 1-2 archivos → inline gana. El overhead no se justifica.

📊 8-10 archivos → delegación ahorra ~17%.

📊 25+ archivos → delegación ahorra ~68%. Inline colapsa.

No son estimaciones. Son mediciones.

¿Qué trae v4.0.0?

→ Hard Stop Rule: el orquestador NUNCA toca archivos. Cero excepciones.

→ Skill registry centralizado: ~11,400 tokens ahorrados por pipeline.

→ Word budgets en SDD: artefactos chicos, menos tokens en cascada.

→ Lecturas paralelas de Engram en lugar de secuenciales.

Total: ~52,400 tokens menos por pipeline SDD completo.

Todo esto ya viene preconfigurado en AI Gentle Stack v1.6.0.

Un install y listo — Claude Code, Cursor, Gemini CLI, OpenCode, Copilot, Codex. Sin configuración manual.

La pregunta no es si usar orquestación.

Es: ¿cuántos archivos toca tu tarea?

Si son más de 5, delegá. Los números no mienten.

📄 Análisis completo con tablas: github.com/Gentleman-Prog…

🚀 Agent Teams Lite v4.0.0: github.com/Gentleman-Prog…

🛠️ AI Gentle Stack v1.6.0: github.com/Gentleman-Prog…

#AI #AgentTeams #DeveloperTools #OpenSource #GentlemanProgramming

Español