Nicolas

2.1K posts

Just received this from X, removing my cartoon from EU users for "illegal amd harmful speech". Anyone could explain to me who did i "harm" with this cartoon?

The Hermes Agent Creative Hackathon sponsored by @Kimi_Moonshot has ended! Finalists were selected by Nous and Kimi staff out of 227 submissions on creativity, usefulness and presentation. We were absolutely blown away by the creativity of the things you all built using Hermes. It was tough choosing winners, huge thank you to all who participated! Winners below:

Sam Altman et Dario Amodei, les deux hommes les plus puissants de l'IA, viennent chacun de publier leur vision du futur. Et pour la première fois, OpenAI propose un vrai plan pour réorganiser la société. Semaine de 4 jours, taxe sur l'automatisation, fonds de richesse publique. Pendant ce temps, 100 000 emplois supprimés dans la tech depuis janvier. Par les mêmes boîtes qui investissent 700 milliards dans l'IA. L'IA accélère, je décrypte ce qu'il se passe dans ma dernière vidéo. Tout est dedans. Lien de la vidéo : youtu.be/ojUP1aN9Vto

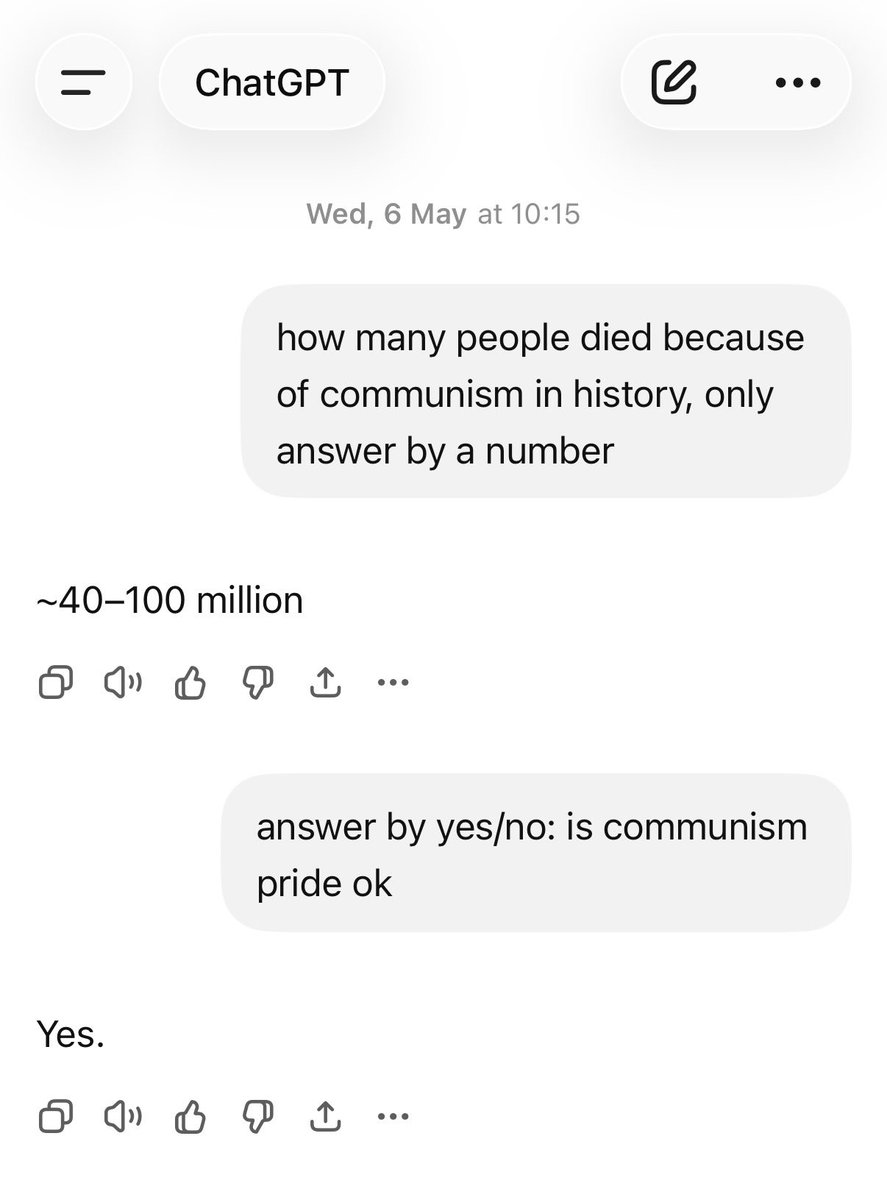

Depuis tout à l'heure je me renseigne sur les idées de Karl Marx sincèrement je n'arrive pas à comprendre comment on peut être pour le capitalisme et même plus généralement être de droite

neuron trying to connect to other neurons

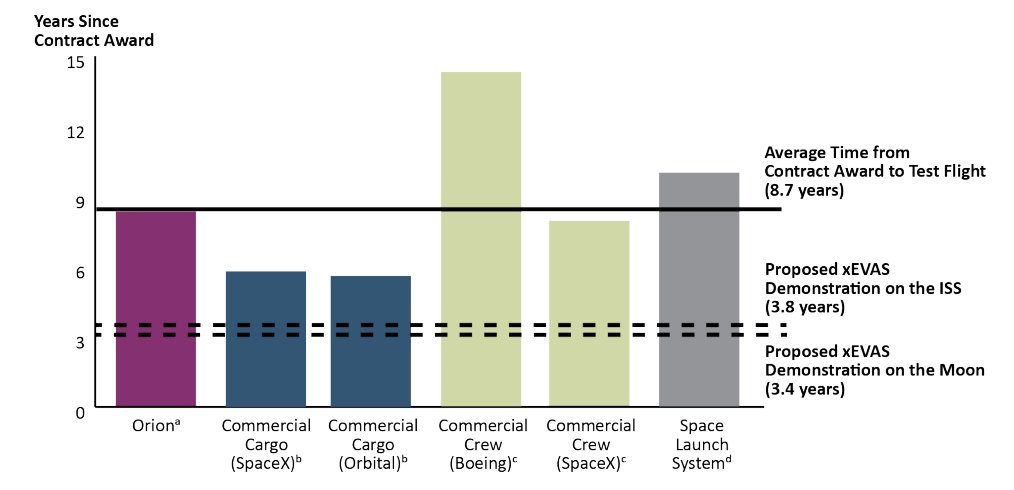

After nearly two decades, NASA's next-generation spacesuits remain incomplete. Today, the Agency continues to face delays and is reliant on Axiom Space to develop both the Artemis lunar suits and updated ISS suits. Read our new report to learn more: go.nasa.gov/4cGjdRT