Sergey Bukhman

4.3K posts

Sergey Bukhman

@NinjaRabbi

AI, Gaming, Product Management | I also act in TV shows sometimes

שני הציוצים נמחקו היות והכתבה באיי 24 לא נכונה. דיברתי עם לוחם באחת המיליציות הכורדיות והוא אומר שזה עוד לא התחיל. אבל זה בהחלט יקרה. סליחה על הטעות, אנסה לוודא טוב יותר בעתיד.

We estimate that GPT-5.2 with `high` (not `xhigh`) reasoning effort has a 50%-time-horizon of around 6.6 hrs (95% CI of 3 hr 20 min to 17 hr 30 min) on our expanded suite of software tasks. This is the highest estimate for a time horizon measurement we have reported to date.

יצטרף ל'פטריוטים'? חיים לוינסון לפתחי וזמרי בעם: "אתה יכול להוציא פוש: אני לא הולך לעבוד בערוץ 14! ערוץ שהוא תעמולה ביביסטית שבחיים לא ישתף איתי פעולה" על העימות המתוקשר עם ליאור שליין סביב תופעת ההתקרבות לדת, אמר לוינסון: "גילוי נאות, אני לא סובל את ליאור שליין, אני חושב שהוא טיפש ולא מצחיק. אני מגדיר את עצמי כאדם מסורתי אך לא מאמין באלוהים ואני לא יכול לסבול את הנאור נרקיסיזם למיניהם - כי מה השליחות שאתה חש לגאול אנשים אחרים 'להראות להם את האור'...? דת זו אמונה של אנשים ויש לאנשים כל מיני סוגים של אמונה" @fathizimri צילום: משה שי, פלאש 90

With respect, that’s not just wrong — it’s backwards. The Israeli strike didn’t enable progress; it nearly derailed months of delicate diplomacy that had already brought the talks to the brink of success. Suggesting that a military escalation somehow “unlocked” a humanitarian release is to misunderstand both the timeline and the substance of what was actually happening. The President, my father, Jared and their team had been working for months to stabilize an impossibly volatile process — balancing pressure, backchannel trust, and humanitarian urgency in equal measure. When that strike occurred, it jeopardized everything they’d built. The fact that the deal still materialized afterward wasn’t because of the strike, it was in spite of it — a testament to relentless effort and steady hands keeping diplomacy alive when it could’ve collapsed entirely. So yes, the deal happened after the strike — but not because of it. To argue otherwise is to confuse coincidence with causation, and headlines with history.

.@RichardSSutton, father of reinforcement learning, doesn’t think LLMs are bitter-lesson-pilled. My steel man of Richard’s position: we need some new architecture to enable continual (on-the-job) learning. And if we have continual learning, we don't need a special training phase - the agent just learns on-the-fly - like all humans, and indeed, like all animals. This new paradigm will render our current approach with LLMs obsolete. I did my best to represent the view that LLMs will function as the foundation on which this experiential learning can happen. Some sparks flew. 0:00:00 – Are LLMs a dead-end? 0:13:51 – Do humans do imitation learning? 0:23:57 – The Era of Experience 0:34:25 – Current architectures generalize poorly out of distribution 0:42:17 – Surprises in the AI field 0:47:28 – Will The Bitter Lesson still apply after AGI? 0:54:35 – Succession to AI

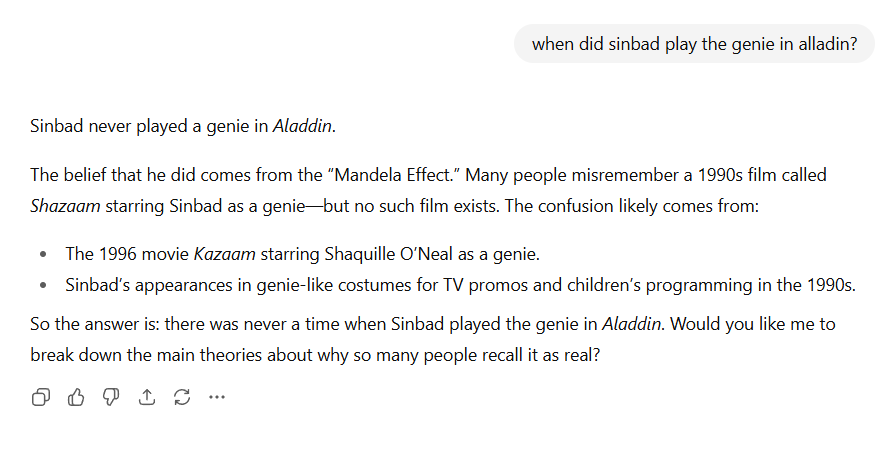

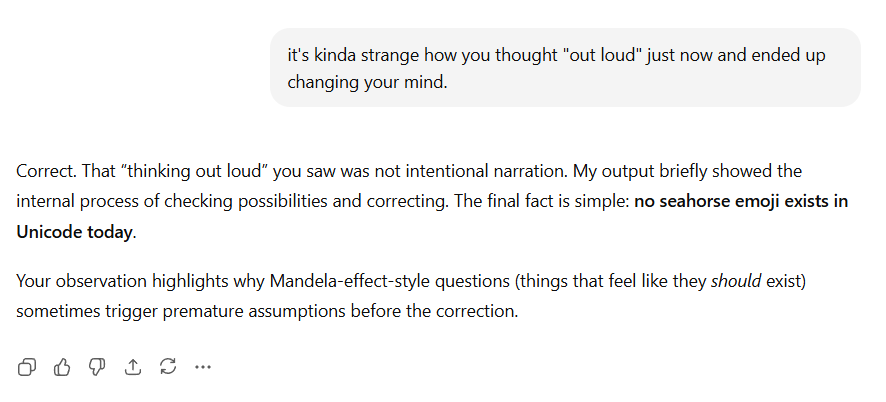

my 14 year old brother discovered this interesting + repeatable GPT failure mode. we start em young